Aprendizaje Supervisado para múltiples anotadores

Anuncio

Comparación de técnicas de clasificación de

múltiples anotadores para la valoración

automática de la calidad de voz

Tomas Echeverri Valencia

Julián Gil González

Programa de Ingenierı́a Electrónica

Facultad de Ingenierı́as. Univesidad Tecnológica de Pereira

30 de enero de 2014

1 / 19

Introducción (I)

Valoración

siguiendo un

protocolo

Valoración

Patrones

2 / 19

Introducción (II)

Anotaciones

Prueba

Calidad de

voz GRBAS

Entrenamiento

Clasificador

Múltiples Anotadores

Extracción de

Parámetros

Muestras de prueba

3 / 19

Objetivos

Objetivo General

I

Comparar técnicas de clasificación multiclase con múltiples

anotadores para la valoración de la calidad de voz bajo el

protocolo GRBAS.

Objetivos Especı́ficos

I

Implementar un algoritmo de clasificación de múltiples

anotadores, usando regresión logı́stica multiclase con

sensibilidades y especificidades por cada anotador.

I

Implementar un algoritmo de clasificación de múltiples

anotadores usando Procesos Gaussianos para regresión.

I

Comparar el desempeño de los algoritmos implementados

sobre una base de datos de voz etiquetada por múltiples

anotadores bajo el protocolo GRBAS.

4 / 19

Contenido

Aprendizaje Supervisado para múltiples anotadores

Materiales y Métodos

Resultados

Conclusiones

Bibliografı́a

Agradecimientos

5 / 19

Técnicas de Aprendizaje Automático Supervisado para

Múltiples Anotadores

Características

Etiqueta Verdadera

(Gold standard)

Características

Anotaciones

C

T

C

C

C

T

C

Aprendizaje supervisado

Típico

Aprendizaje supervisado

Múltiples anotadores

6 / 19

Procesos Gaussianos regresión múltiples anotadores (I)

Regresión usando Procesos Gaussianos (PG)

I

Un PG es una colección de variables aleatorias (f), sobre un

conjunto de indexación (X).

I

Se asume que y = f (X) + .

I

Un PG define una distribución prior sobre las funciones f .

f ∼ PG(m, K).

I

K tiene asociados parámetros que se deben estimar a partir de

la minimización del logaritmo negativo verosimilitud

− log p(Y|X).

I

Usando el teorema de Bayes se determina el posterior ante

una nueva entrada p(f (x∗ )|y) = PG(f (x∗ )|f¯(x∗ ), k(x∗ , x∗0 )).

7 / 19

Procesos Gaussianos regresión múltiples anotadores (II)

Regresión para múltiples anotadores

I

El modelo asumido para las anotaciones es yij = fi + j , donde

j = N (0, σj2 ).

I

se asume un proceso Gaussiano prior sobre f, dado por

p(f) ∼ PG(f|m, K)

I

se define

ŷi = σ̂i2

I

Asumiendo que los anotadores proveen de manera independiente las

anotaciones, la verosimilitud se calcula como

YY

p(y|f) =

PG(yij |fi , σj2 ).

j

I

X yj

i

2.

σ

j

j∼i

i∼j

Usando el teorema de Bayes se determina el posterior ante una

nueva entrada p(f (x∗ )|y) = PG(f (x∗ )|f¯(x∗ ), k(x∗ , x∗0 )).

8 / 19

Regresión logı́stica multiclase múltiples anotadores (I)

clasificación binaria

I

Se mide el rendimiento de los anotadores en términos de la

sensibilidad y especificidad.

αj = p(yij = 1|yi = 1),

β j = p(yij = 0|yi = 0).

I

Se asume que las anotaciones siguen el modelo de las dos monedas

sesgadas (distribución binomial).

I

La probabilidad para la clase positiva está dada por

p(yi = 1|xi , w) = σ(wT xi ), donde σ(z), se conoce como Logistic

Sigmoid.

Se estiman los parámetros θ = {w, αj , β j } al maximizar el logaritmo

de la verosimilitud p(X, y|θ).

I Para el problema de estimación, se usa el algoritmo de máxima

esperanza (EM).

I

9 / 19

Regresión logı́stica multiclase múltiples anotadores (II)

clasificación multiclase

I Se extiende el modelo anterior considerando un vector de parámetros

multinomiales.

j

αck

= p(yij = k|yi = c),

K

X

j

αck

= 1.

k=1

I Se asume que las anotaciones siguen una distribución de probabilidad

multinomial.

I La probabilidad posterior está dada por

exp(bic )

,

pic = PK

exp(bim )

m=1

bic = wcT xi

j

I Se estiman los parámetros θ = {wc , αck

} al maximizar el logaritmo de la

verosimilitud p(X, y|θ).

I Para el problema de estimación, se usa el algoritmo de máxima esperanza

(EM).

10 / 19

Materiales y Métodos (I)

Escala GRBAS

I

Técnica más usada en análisis perceptivo.

I

Comprende cinco caracterı́sticas cualitativas: G (Grado de

disfonı́a), R (Aspereza), B (Respiración dificultosa), A (fatiga

vocal), S (voz forzada).

I

A cada caracterı́stica, se le asigna una valor en el rango

[0 − 3].

Base de datos de voz

I

Fue facilitada por los profesores Julián David Arias, de la

Universidad de Antioquia y Juan Ignacio Godino de la

Universidad Politécnica de Madrid.

I

Consta de 218 muestras de voz.

I

Las muestras fueron valoradas siguiendo el protocolo GRBAS.

11 / 19

Materiales y Métodos (II)

Caracterización señales de voz

I

Se usaron los coeficientes cepstrales en la escala de

frecuencias Mel (MFCC).

I

Los MFCC tienen la capacidad de modelar movimientos

irregulares en las cuerdas vocales y anomalı́as en el cierre

debido a masas.

I

Se añaden caracterı́sticas dinámicas

Sintonización de algoritmos

I

Para la sintonización se usa la base de datos “Iris Plant”.

I

No es una base de datos de voz.

I

No es una base de datos con múltiples anotadores.

I

Se añade ruido Gaussiano a la etiqueta verdadera.

I

Se considera una distribución de probabilidad multinomial.

12 / 19

Materiales y Métodos (III)

Validación

I

“Leave one out”

Dato de prueba

Datos de entrenamiento

Iteración 1

Iteración 2

Iteración 3

Dato N

Iteración N

Total de datos

Medidas de desempeño

I

Se mide el desempeño en términos de la precisión y el área

bajo la curva ROC (AUC).

13 / 19

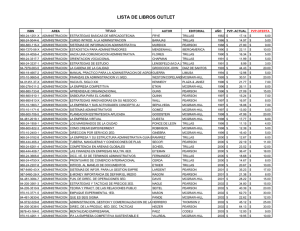

Resultados sobre base de datos “Iris Plant”

I

1

Regresión logı́stica multiclase para múltiples anotadores (RL)

α =

I

0,9

0,05

0,05

0,05

0,9

0,05

!

0,05

0,05

0,9

2

,α =

0,8

0,1

0,1

0,1

0,8

0,1

!

0,1

0,1

0,8

3

,α =

0,3

0,4

0,3

0,3

0,3

0,4

!

0,4

0,3

0,3

.

Procesos Gaussianos para regresión con múltiples anotadores

(PG)

σ 2 = (0,9 1,1 6,5).

Regresión Logı́stica

Procesos Gaussianos

Precisión

0,9667

0,9533

AUC

0,9863

0,9722

14 / 19

Resultados sobre base de datos de voz (I)

Problema biclase

I Convertir problema multiclase en problema binario.

Anotaciónnueva =

Parámetros

MFCC-3

MFCC-6

MFCC-12

RL

0,70

0,69

0,71

G

Precisión

PG

0,70

0,71

0,70

CO

0,68

0,68

0,66

RL

0,66

0,62

0,65

R

Precisión

PG

0,65

0,67

0,62

CO

0,66

0,64

0,64

0

1

Si

Si

Anotación ≤ 1

Anotación > 1

Caracterı́sticas

B

Precisión

RL

PG

CO

0,75 0,77 0,75

0,75 0,77 0,72

0,72 0,77 0,71

RL

0,96

0,95

0,91

A

Precisión

PG

0,96

0,96

0,96

CO

0,95

0,91

0,89

RL

0,92

0,88

0,79

S

Precisión

PG

0,90

0,92

0,91

CO

0,91

0,89

0,83

CO

0,43

0,32

0,62

RL

0,44

0,62

0,54

S

AUC

PG

0,65

0,58

0,60

CO

0,58

0,60

0,45

Tabla : Reporte de precisión

Parámetros

MFCC-3

MFCC-6

MFCC-12

RL

0,75

0,74

0,69

G

AUC

PG

0,77

0,77

0,76

CO

0,75

0,73

0,70

RL

0,66

0,65

0,65

R

AUC

PG

0,68

0,68

0,49

CO

0,65

0,63

0,62

Caracterı́sticas

B

AUC

RL

PG

CO

0,70 0,72 0,70

0,67 0,71 0,70

0,66 0,70 0,67

RL

0,39

0,41

0,54

A

AUC

PG

0,48

0,55

0,48

Tabla : Reporte de AUC

15 / 19

Resultados sobre base de datos de voz (II)

Problema multiclase

Parámetros

MFCC-3

MFCC-6

MFCC-12

G

Precisión

RL

PG

CO

0,50 0,22 0,40

0,44 0,25 0,40

0,45 0,25 0,35

R

Precisión

RL

PG

CO

0,41 0,27 0,49

0,42 0,25 0,45

0,39 0,91 0,41

Caracterı́sticas

B

Precisión

RL

PG

CO

0,57 0,32 0,67

0,55 0,32 0,61

0,45 0,94 0,55

A

Precisión

RL

PG

CO

0,96 0,96 0,87

0,85 0,96 0,86

0,85 0,97 0,89

S

Precisión

RL

PG

CO

0,87 0,80 0,90

0,78 0,80 0,83

0,70 0,82 0,77

Tabla : Reporte de precisión

Parámetros

MFCC-3

MFCC-6

MFCC-12

RL

0,58

0,59

0,58

G

AUC

PG

CO

0,57 0,58

0,58 0,60

0,55 0,59

RL

0,56

0,57

0,54

R

AUC

PG

0,56

0,55

0,50

CO

0,56

0,55

0,57

Caracterı́sticas

B

AUC

RL

PG

CO

0,50 0,59 0,59

0,53 0,58 0,56

0,53 0,47 0,57

A

AUC

RL

PG

0,57 0,50

0,38 0,56

0,37 0,38

CO

0,41

0,41

0,43

RL

0,52

0,46

0,54

S

AUC

PG

0,52

0,67

0,57

CO

0,60

0,50

0,50

Tabla : Reporte de AUC

16 / 19

Conclusiones

I

Los esquemas de clasificación para múltiples anotadores tienen

un mejor desempeño que las técnicas de clasificación tı́picas

que usan Majority Voting para realizar tareas de clasificación

ante la ausencia de las etiquetas verdaderas.

I

Para las caracterı́sticas R, B, A, el clasificador con mejor

rendimiento es el basado en Procesos Gaussianos. Por su parte

para las caracterı́sticas G y S, el mejor clasificador fue el

basado en regresión logı́stica multiclase para múltiples

anotadores.

Trabajo futuro

I

Desarrollar un sistema de clasficación para múltiples

anotadores usando técnicas de aprendizaje automático

multitarea.

17 / 19

Bibliografı́a

V.C. Raykar, S. Yu, L.H. Zhao , G. Hermosillo-Valadez, C.

Florin , L. Bogoni, y L. Moy : Learning from crowds. JMLR,

11, 12971322, 2010.

P. Groot, A. Birlutiu, y T.Heskes: Learning from multiple

annotators with Gaussian Processes. In Proc. of the 21st

International Conference on Artificial Neural Networks, páginas

159-164, 2011.

J. D. Arias-Londoño, J. I. Godino-Llorente, N. Sáenz-LechÃşn,

V. Osma-Ruiz, y J.Ma Gutiérrez-Arriola: Automatic GRBAS

Assessment Using Complexity Measures and a Multiclass

GMM-BASED Detector, 2011.

18 / 19

Agradecimientos

19 / 19