Cap´ıtulo 2 Representación digital de la información

Anuncio

Capı́tulo 2

Representación digital de

la información

2.1

2.2

2.3

2.4

2.5

Conceptos previos . . . . . . . . .

Representación digital de los datos

Códigos redundantes . . . . . . . .

Ejercicios . . . . . . . . . . . . . .

Comentarios bibliográficos . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

29

35

49

55

57

La representación de la información en los computadores digitales

persigue dos objetivos: en primer lugar, procesarla, permitiendo su manipulación eficiente, para lo cual se han ideado diferentes convenios, de

los que veremos los más importantes; y en segundo, asegurarla contra

errores durante su almacenamiento o durante las transmisiones, lo que

se consigue incorporando en la codificación el empleo de la redundancia

para detectar y corregir dichos errores.

2.1

2.1.1

Conceptos previos

Información analógica y digital

Las magnitudes continuas son las que pueden adoptar los infinitos

valores de un intervalo de números reales, tales como la longitud de un

segmento, velocidad, temperatura, intensidad de un sonido, etc.

30

Capı́tulo 2. Representación de la información

Las magnitudes discretas tienen naturaleza discontinua, tales como

la longitud (número de sı́labas) de una palabra, capacidad (número de

pasajeros) de un vehı́culo, etc.

En la práctica, es frecuente que las magnitudes continuas sean tratadas como discretas: el peso de una persona (que se redondea en kilos); la

temperatura (en grados y décimas de grado); la longitud de un segmento,

medida con un dispositivo de precisión hasta los milı́metros.

En relación con ambos tipos de magnitud se considera la información

analógica, que es de naturaleza continua, pudiendo tomar infinitos valores; y la información digital, que es de naturaleza discreta. Aunque esta

última puede tomar infinitos valores ( IN), en un computador digital la

información es discreta y, además, finita.

En las calculadoras, la digitalización de variables analógicas produce

un efecto de redondeo, que debe ser tenido en cuenta y tratado convenientemente para evitar errores de cálculo (véase la sección 2.3); en

el monitor de un ordenador, supone el ajuste de la imagen proyectada

sobre una matriz de puntos.

2.1.2

Unidades de información en los sistemas digitales

La razón de ser de un computador es el procesamiento de información. Para poder hablar con propiedad de este procesamiento, debemos definir unidades de medida que nos permitan cuantificar de algún

modo la acción del computador sobre la información suministrada. Consideramos las siguientes:

• Bit (BInary digiT ) es la cantidad de información que puede almacenarse en una variable binaria. No hay que confundir el bit con

la variable ni con su valor: una variable binaria es la que puede

tomar dos valores estables: 0 ó 1, blanco o negro, sı́ o no, etc.

La necesidad de codificar informaciones más complejas ha llevado

a agrupar varios bits, apareciendo ası́ las siguientes unidades:

• El byte u octeto es la cantidad de información que puede codificarse

en 8 bits; representa por tanto 28 = 256 valores.

2.1. Conceptos previos

31

• La palabra se define en relación con la máquina considerada, como

la cantidad de información que la máquina puede manejar de una

sola vez. Para evitar equı́vocos, se habla de palabras de 8 bits, 16

bits, 32 bits, etc.

• 1 Kbyte = 210 bytes = 1.024 bytes. Se suele llamar kilobyte, aunque esto puede resultar equı́voco, ya que el prefijo “kilo” significa

1.000 (y no 1.024).

• 1 Mbyte = 1.048.576 bytes (220 = 1.0242 ). Análogamente, debe

advertirse que “mega” no significa un millón en este contexto.

2.1.3

Sistemas de numeración posicionales

Aunque se conocen sistemas no posicionales, tales como el de numeración romana o el sexagesimal, que usamos para medir el tiempo y los

ángulos, el sistema de numeración más difundido en la actualidad es sin

duda el sistema decimal posicional, o sistema arábigo-hindú, inventado

hacia el siglo VIII.

Por otra parte, en el contexto de la informática se usan frecuentemente sistemas de numeración posicional en bases tales como 2 (ya que

el bit tiene dos posiciones), 16 (como compactación de palabras de 4

bits), etc.

Para aprender a manejarlos, se recurre frecuentemente a la analogı́a

con el sistema de numeración más conocido: el de base 10. Se llama

decimal porque cada cifra o dı́gito puede tomar diez posibles valores: del

0 al 9; se llama posicional porque el valor real de cada dı́gito depende

de su posición.

10475 = 1 ∗ 104 + 0 ∗ 103 + 4 ∗ 102 + 7 ∗ 101 + 5 ∗ 100

A la cantidad 10 se le llama base; las potencias de 10 son los pesos

asociados a cada posición, y los factores o coeficientes de cada peso son

las cifras de la representación. También se podrı́a haber representado

en forma polinómica del siguiente modo:

10475 = 1 ∗ 104 + 0 ∗ 103 + 47 ∗ 101 + 5 ∗ 100

32

Capı́tulo 2. Representación de la información

pero la primera forma es la única donde las cifras son todas menores

que la base. En general, esta afirmación adopta la siguiente forma, cuya

demostración se incluye al final de este capı́tulo.

Teorema 2.1 En un sistema de numeración en base b > 1, todo entero

N positivo tiene una única representación de la forma

N = cp bp + cp−1 bp−1 + . . . + c1 b1 + c0 b0

donde 0 ≤ ci < b para todo i = 0, 1, . . . , p

Conversión entre sistemas

En primer lugar, la expresión decimal de un número de cifras cp . . . c0

en base b se obtiene sencillamente sumando los valores reales correspondientes a los diferentes dı́gitos:

[cp . . . c0 ](b = cp ∗ bp + . . . + c0 ∗ b0

Por ejemplo, 275(8 = 2 ∗ 82 + 7 ∗ 81 + 5 ∗ 80 = 189(10

En segundo lugar, representar el número 241(10 en el sistema de base

5, equivale a expresarlo en forma polinómica con las sucesivas potencias

de esa base, siguiendo la idea de la demostración del teorema:

241

5

1

48

5

3

9

4

⇒

241

=

48 * 5 + 1

⇒

48

=

9*5+3

5

⇒

9

=

1*5+4

1

⇒

1

=

0*5+1

Por lo tanto,

241

=

48

∗5+1

=

(9 ∗ 5 + 3)

∗5+1

=

((1 ∗ 5 + 4) ∗ 5 + 3)

∗5+1

=

1 ∗ 53 + 4 ∗ 52 + 3 ∗ 51 + 1 ∗ 50

= 1431(5

33

2.1. Conceptos previos

Sistemas de numeración más usuales

El sistema más empleado en electrónica digital es el de base 2, llamado binario (natural). En informática tienen interés los sistemas cuya

base es una potencia de dos: 2, 4, 8, 16. La siguiente tabla recoge los

primeros números naturales, expresados en algunos de esos sistemas y

en el decimal:

dec.

binario

octal

hexad.

dec.

binario

octal

hexad.

0

1

2

3

4

5

6

7

8

0

1

10

11

100

101

110

111

1000

0

1

2

3

4

5

6

7

10

0

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

1001

1010

1011

1100

1101

1110

1111

10000

10001

11

12

13

14

15

16

17

20

21

9

A

B

C

D

E

F

10

11

En el sistema hexadecimal se usan los dı́gitos 0, . . . , 9, A, . . . F para las

cantidades cero, . . . , nueve, diez, . . . , quince respectivamente. Ası́ por

ejemplo, C7A(16 = 12 ∗ 162 + 7 ∗ 161 + 10 ∗ 160 = 3194(10 , ya que los

valores de A y C en el sistema de base 16 son 10 y 12, respectivamente.

Se observa que, en una base cualquiera b, con N cifras (o menos)

es posible expresar bN cantidades distintas; inversamente, para poder

componer C combinaciones distintas se necesita disponer de un número

de cifras igual a logb C, redondeado por exceso.

Como consecuencia de lo anterior, cuanto mayor sea la base adoptada

se pueden expresar más cantidades (combinaciones) para un número fijo

de cifras; inversamente, cuanto mayor sea la base, es posible usar menos

cifras para expresar una misma cantidad.

34

Capı́tulo 2. Representación de la información

Observación

La conversión de binario en octal o en hexadecimal se puede abreviar

del siguiente modo:

11 001 111 010 101 100(2

= 11 001 111 010 101 100

= 3

1

7

2

5

4 = 317254(8

= 1 1001 1110 1010 1100

= 1

9

14

10

12

= 19EAC(16

¿A qué se debe el funcionamiento de este mecanismo?

Operaciones aritméticas en base dos

Para las operaciones elementales se usan las tablas correspondientes

a la base de que se trate. Por ejemplo, para el caso binario la tabla de

sumar es la siguiente:

+ 0

1

0 0

1

1 1 10

Y entonces, son válidas las reglas conocidas para las operaciones en base

diez. Por ejemplo, en el sistema binario natural, tenemos:

+

1001

1011

10100

−

100101

11011

01010

Para la resta se usa frecuentemente el método del complemento: en

lugar de la resta propuesta, se halla la suma correspondiente complementando el sustraendo (min − sus → min + comp(sus), siendo el complemento (comp) el número resultante de cambiar cada cero por un uno

y viceversa), suprimiendo la cifra excedente, posiblemente aparecida por

el arrastre, y sumando una unidad al resultado obtenido:

−

100101

11011

→

+

100101

100100

1001001

→

001010

2.2. Representación digital de los datos

2.2

35

Representación digital de los datos

En los sistemas digitales, no resulta viable dar una representación

válida para codificar todos los números; por otra parte, los diversos

sistemas empleados dan diferentes tratamientos a números tan usuales

como el uno (según se considere como real o como entero). Estudiaremos

diversos convenios para diferentes conjuntos de números, ası́ como sus

limitaciones.

En este apartado, supondremos que disponemos de un espacio de N

bits, con lo que es posible representar 2N enteros distintos.

2.2.1

Representación de los números enteros

Números enteros positivos

Si se considera únicamente números enteros positivos, con N bits de

espacio serı́a posible representar los números de 0 a 2N −1. La forma más

natural de lograrlo consiste en interpretar cada combinación mediante

la cantidad que representa en binario. Por ejemplo, con 1 byte (es decir,

N = 8) se representarı́an los números 0, . . . , 255 en este sistema.

Números enteros con signo. Convenio del signo-magnitud

Para representar los números enteros (con signo), el sistema más

simple es el convenio de signo-magnitud, consistente en reservar el primer dı́gito binario para codificar el signo (suele representarse el signo

+ con un cero y el − con un uno) y los siguientes N − 1 para el valor absoluto. Ası́, en este sistema tienen representación las cantidades

±0, . . . , ±(2N − 1). En el caso particular de 1 byte, esas cantidades son

−127, . . . , −0, +0, . . . , +127.

En este sistema, la aritmética es bastante simple: la suma de cantidades del mismo signo y la resta de cantidades de distinto signo siguen

la regla básica en binario. Para sumar cantidades de distinto signo, o

restar cantidades del mismo signo, resulta más práctico el método del

complemento.

36

Capı́tulo 2. Representación de la información

Se observa el inconveniente de que el cero tiene una doble representación, por lo que el test de la comparación para la igualdad en este

sistema debe tenerlo en cuenta. Por otra parte, la suma/resta de signos

y valores absolutos necesita dos algoritmos distintos, que no resultan

muy eficientes. Los siguientes sistemas surgen precisamente para tratar

de paliar estas deficiencias.

Números enteros con signo. Complemento restringido

Para comprender mejor el funcionamiento de este convenio en binario, conviene introducirlo primero en base diez. Si consideramos palabras

de N = 2 dı́gitos (decimales), es posible representar 102 = 100 cantidades distintas. En este convenio se opta por considerar los números

negativos de {−49, . . . , −0}, y los positivos de {0, . . . , 49}, del siguiente

modo: los números positivos se representan en decimal natural, mientras

que para cada negativo −z se toma la cantidad 99 − z (complemento de

z respecto de 102 − 1, que es la N=2 potencia de la base menos uno).

Ası́ por ejemplo, tenemos:

2

repr(29) =

repr(−29) = 99 − 29 =

9

7

0

Con este convenio, las cantidades

−49, −48, . . . , −0, 0, 1, . . . , 48, 49

se representan respectivamente mediante

5 0 , 5 1 , ... , 9 9 , 0 0 , 0 1 , ... , 4 8 , 4 9

Aunque se observa el inconveniente de que el cero tiene dos representaciones, la ventaja de este convenio consiste en que la suma de dos

números, sea cual fuere su signo, se lleva a cabo con un mismo algoritmo,

que sólo se diferencia de la suma de enteros en que el posible arrastre se

agrega al resultado final:

+

+ 23

− 15

→

→

+

1

2

8

0

3

4

7

+1

→

0

8

37

2.2. Representación digital de los datos

Consideremos ahora esta representación con palabras de N = 4 dı́gitos

binarios: las cantidades representables son

−7, −6, . . . , −0, +0, . . . , +6, +7

→ −111(2 , −110(2 , . . . , −0(2 , +0(2 , . . . , +110(2 , +111(2

que, al complementar las negativas respecto de 1111, resulta:

→ 1000, 1001, . . . , 1111, 0000, . . . , 0110, 0111

Números enteros con signo. Complemento auténtico

Empezamos nuevamente con la base decimal como punto de partida,

y consideremos también palabras de longitud N = 2. Ahora se opta por

considerar los números negativos de {−50, . . . , −1}, y los positivos de

{0, . . . , 49}, del siguiente modo: los números positivos se representan en

binario natural, mientras que para cada negativo −z se toma la cantidad

100 − z (complemento de z respecto de 10, que es la base para N = 2).

repr(29) =

2

9

repr(−29) = 100 − 29 =

7

1

Con frecuencia se emplea otra regla equivalente para complementar

los números negativos, consistente en añadir una unidad al correspondiente complemento restringido.

Con este convenio, las cantidades

−50, −49, . . . , −1, 0, 1, . . . , 48, 49

se representan respectivamente mediante

5 0 , 5 1 , ... , 9 9 , 0 0 , 0 1 , ... , 4 8 , 4 9

Este sistema tiene las mismas ventajas que el anterior, y además el

cero se representa de un único modo.

38

Capı́tulo 2. Representación de la información

Como en el caso anterior, consideremos ahora la base dos, con palabras de N = 4 dı́gitos, donde tienen cabida las cantidades

−8, −7, . . . , −1, +0, . . . , +7

→ −1000(2 , −111(2 , . . . , −1(2 , +0(2 , . . . , +110(2 , +111(2

que, al complementar las negativas respecto de 10000, resulta:

→ 1000, 1001, . . . , 1111, 0000, . . . , 0110, 0111.

En este sistema, la suma también se lleva a cabo con un mismo algoritmo, igual al usado para el complemento restringido, pero ignorando

la posible cifra de arrastre:

+

+ 23

− 15

→

→

+

1

2

8

0

3

5

8

→

0

8

Funcionamiento de las operaciones aritméticas

Debe subrayarse que las operaciones anteriores no coinciden con las

aritméticas, debido a la posibilidad de que se produzca un desbordamiento; los diferentes sistemas responden ante esta circunstancia de diferentes modos: por ejemplo, ignorando la última cifra de arrastre, o

interrumpiendo su trabajo para delatar una condición de error. Por lo

tanto, es necesario prever esta posibilidad y conocer de qué modo reacciona nuestro sistema. Sobre este asunto volveremos más adelante,

dentro de este mismo capı́tulo.

Formatos de los números enteros en las computadoras

Entre los convenios presentados, el más frecuente es el del complemento auténtico en base dos, llamado simplemente complemento a dos.

Ahora bien, dependerá de la longitud de palabra la cantidad de combinaciones posibles y, por tanto, el rango de enteros considerado. Por

otra parte, aunque ciertos sistemas trabajan con palabras de longitud

variable, lo corriente es optar por uno o varios formatos con tamaño fijo:

simple (1 byte), doble (2 bytes), cuádruple (4 bytes) u óctuple (8 bytes).

39

2.2. Representación digital de los datos

2.2.2

Representación de los números reales

Debe resaltarse que, en general, sólo resulta posible representar aproximaciones de los números reales mediante números decimales, con sólo

unas pocas cifras significativas. En el siguiente apartado estudiaremos

los efectos de este redondeo.

En este apartado, supondremos que disponemos de un espacio de N

bits, con lo que es posible representar 2N enteros distintos.

Convenio con coma fija

Si disponemos de un espacio de N bits para representar un número

real, la caracterı́stica principal de este convenio es la reserva implı́cita

de algunos bits fijos para la parte decimal, asumiéndose la coma en una

posición fija. A su vez, existen los siguientes modos de representación

en coma fija:

• Sistema signo y valor absoluto

En este convenio se reserva un bit para codificar el signo, y del resto

se destina una cantidad fija para representar el valor absoluto de

la parte entera, y los demás para la decimal:

1

|{z}

±

0

1

0

0

1

|

0

0

{z

p. entera

1

0

1

1

}

1

1

. |

0

1

{z }

dec.

Si consideramos por ejemplo N = 16, siendo el primer bit el que

codifica el signo, los siguientes 12 los de la parte entera, y los

3 restantes los de la parte decimal, resulta que la representación

anterior significarı́a

−010010010111.101

= −(210 + 27 + 24 + 22 + 21 + 20 + 2−1 + 2−3 )

= −11750 625.

40

Capı́tulo 2. Representación de la información

• Complemento restringido y complemento auténtico

Sea D = 3 el número (fijo) de decimales asumidos. La representación de un número x, en cualquiera de estos convenios, consiste

en codificar en su lugar la parte entera de x ∗ 23 en el convenio

elegido. La cantidad despreciada al truncar los decimales de x ∗ 23

es menor que 00 125(10 (= 2−3 ).

Por ejemplo, para representar −20 8 en palabras de N = 8 y D = 3,

debemos conformarnos con una aproximación: al ser D = 3, sólo podemos representar cantidades decimales múltiplos enteros de 00 001(2 =

0

0

0

2−3

(10 = 0 125(10 . Como trunc(−2 8 ∗ 8) = trunc(−22 4) = −22, representamos −22/8 = −20 75. Comprobamos que esta cantidad es efectivamente múltiplo de 00 125, y que el siguiente múltiplo (−20 875) excede la

cantidad inicial (−20 8).

• Signo y valor absoluto:

2.75 = 2 +

1 1

+

2 4

=

1

0

|{z}

±

|

0

1

0

{z

} .

p. entera

1

1

0

| {z }

dec.

• Complemento restringido (8 dı́gitos):

(

−22 = −

11111111

10110(2

)

→ 11101001 = 1 1 1 0 1 0 0 1

• Complemento auténtico (8 dı́gitos):

(

−22 = −

100000000

10110(2

)

→ 11101010 = 1 1 1 0 1 0 1 0

Convenios con coma flotante

El principal inconveniente de la coma fija consiste en condicionar

el orden de magnitud de las cantidades codificadas. Un sistema más

general deberá adaptarse a órdenes tan distantes como los de la masa de

2.2. Representación digital de los datos

41

la tierra y la del átomo. El sistema más conocido con esta caracterı́stica

es la llamada notación exponencial (o cientı́fica):

140 = +0.14 ∗ 103 = +0.14E3

6.02215 ∗ 1023

= +0.602215E24

0.00000015

= +0.15E − 6

Los convenios con coma flotante funcionan del mismo modo, dividiendo la información sobre una cantidad en tres partes: su signo, su

mantisa (es decir, las cifras significativas de mayor orden), y el exponente

(que expresa el orden de magnitud). Ası́ por ejemplo, consideremos la

siguiente representación en palabras de N bits:

• El signo, adscrito al primer bit, donde el uno representa al signo

menos.

• El exponente (z), situado en los siguientes e bits, puede tomar los

valores de {−2e−1 , . . . , 2e−1 − 1}. Frecuentemente se representa

desplazado en +2e−1 unidades:

z ∈ {−2e−1 , . . . , 2e−1 − 1} ⇒ repr(z) ∈ {0, . . . , 2e − 1}

• Para la mantisa quedan M = N − e − 1 bits con lo que, para su

representación, se toman los primeros M dı́gitos de su escritura en

binario natural.

Como ejemplo concreto, consideremos el convenio estándar IEEE 754

(real con precisión simple, o real corto), que es una de las codificaciones

de reales más utilizadas. Su representación requiere un total de 32 bits,

de los cuales un bit se utiliza para el signo, 8 bits para el exponente

y 23 bits para la mantisa. Este convenio en concreto, utiliza un truco

llamado bit oculto: como el bit más significativo de la mantisa es un 1,

ahorramos un bit simplemente asumiéndolo. Se logra ası́ espacio para

una mantisa de 24 dı́gitos significativos. El inconveniente de emplear un

bit oculto consiste en que se requiere una representación especial para

el cero.

42

2.2.3

Capı́tulo 2. Representación de la información

Limitaciones de los sistemas de representación

digital de los números

Debido a que los sistemas de codificación considerados están inmersos en sistemas finitos, sólo pueden representar una cantidad finita de

elementos distintos. Esta limitación resulta crı́tica a la hora de representar elementos pertenecientes a conjuntos infinitos, como son los de

los números enteros o reales. Como consecuencia, pueden producirse

situaciones de error no deseables, por lo cual se hace necesario estudiar

el alcance de esas limitaciones, ası́ como la manera de afrontarlas.

Limitaciones en los enteros

En los enteros, las representaciones se limitan a un intervalo reducido

[mı́n, máx ], de cardinal no superior a 2n , siendo n el tamaño (en bits)

de la representación. Ası́, cuando surge la codificación de números fuera

del rango considerado, se produce el llamado desbordamiento (overflow

en inglés).

Por ejemplo, en una representación con 4 bits serán posibles 16 configuraciones. Si optamos por el convenio de complementación auténtica,

el intervalo considerado será [−8, 7]. Veamos qué ocurre al sumar 5 y 6.

+

5

6

→

→

+

0101

0110

1011

→

−5

El comportamiento de las operaciones de suma y resta en el sistema

de complementación auténtica para una representación de n bits se puede

describir ası́: llamemos x0 e y 0 a la representación de x e y, y +0 y −0 a las

operaciones de suma y resta en este sistema, ∀x, y ∈ [−2n−1 , 2n−1 − 1],

tenemos:

x0 ±0 y 0 =

n 0

(x ± y + 2 ) ,

(x ± y)0 ,

(x ± y − 2n )0 ,

si x ± y < −2n−1

si x ± y ∈ [−2n−1 , 2n−1 − 1]

si x ± y > 2n−1 − 1

Para paliar en cierta medida esta limitación, es frecuente incorporar tipos de datos correspondientes a rangos de enteros más amplios

2.2. Representación digital de los datos

43

(por ejemplo, duplicando la longitud de palabra de la representación),

pudiendo ası́ manipular con seguridad enteros de mayor orden. Ası́

por ejemplo, el cálculo de 8! desbordará un sistema de complemento

auténtico con 16 dı́gitos, resultando en cambio correcto para palabras

más largas. En ocasiones, el programador tiene la posibilidad de cambiar¡ de

estrategia para evitar el desbordamiento. Por ejemplo, el cálculo

8¢

8!

de 3 se puede obtener evaluando 3!∗5!

o 8∗7∗6

3∗2∗1 indistintamente; sin embargo, el primero de ellos necesita manipular números mayores, por lo

que el segundo nos permite eludir en cierta medida el error por desbordamiento.

Por otra parte, muchos de los lenguajes que se comercializan en la

actualidad ofrecen la opción de verificar o no los desbordamientos que

puedan producirse durante la ejecución, para que los consiguientes errores no pasen inadvertidos.

Finalmente, la mayorı́a de los lenguajes de alto nivel presentan sistemas de construcción de tipos de datos con capacidad para definir codificaciones (y operaciones de manipulación sobre los objetos cifrados)

a la medida de nuestras necesidades.

Limitaciones en los reales

En este caso, incluso limitándonos a los reales contenidos en un pequeño intervalo acotado, éstos serı́an infinitos, por lo cual las limitaciones

en su representación no sólo afectan al tamaño de los números considerados, sino también a la precisión. En efecto, en cualquiera de los

convenios estudiados se toma como mantisa sólo cierto número reducido

de dı́gitos(binarios) significativos, despreciándose los demás.

En otras palabras, cada codificación de un número real en coma

flotante representa en realidad un intervalo, cuyo tamaño varı́a según

la magnitud del real representante. Por consiguiente, la distribución de

representantes no es uniforme: un intervalo tan pequeño como [0’1, 1]

cuenta con tantos representantes como [1000, 10000].

Además de las limitaciones de la precisión, la representación de los

reales está limitada por su tamaño: existe un valor a partir del cual no

44

Capı́tulo 2. Representación de la información

hay representantes reales y que determina el rango de desbordamiento.

Debe observarse en este punto que existen cantidades cuya expresión

decimal es exacta, sin serlo su expresión escrita en binario natural (por

ejemplo, 00 1(10 = 00 0 0011 0011 . . .(2 ), por lo que, en principio, debe desconfiarse de la precisión en la codificación de todo número no entero.

Aunque esta diferencia entre una cantidad y su representación es en

muchos casos despreciable, su aparición puede ocasionar grandes desviaciones respecto del comportamiento teórico.

Una situación ası́ se produce cuando se comparan dos números reales

para determinar su igualdad, ya que el resultado de la comparación

ignora si esa diferencia producida es pequeña o grande, lo que puede

ocasionar una respuesta drásticamente distinta de la correcta. Ası́ por

ejemplo, la ejecución del siguiente programa escrito en Pascal

Program errores (output);

var suma: real;

begin

suma := 0;

repeat

suma := suma + 0.1;

writeln(suma);

until suma = 1

end.

no para.1 Frecuentemente esta situación puede evitarse cambiando la

expresión x = y por | x − y |< ε, siendo ε la diferencia admitida.

En realidad, la aparición de errores intolerables es posible incluso

en expresiones sencillas. Concretamente, deberı́an evitarse las operaciones de suma y resta, cuando uno de los operandos es muy pequeño

en comparación con el otro, y la división cuando el divisor es cero o

“próximo a cero”. Por ejemplo, la relación |t/x| ≤ ε deberı́a sustituirse

por |t| ≤ ε ∗ |x|.

1

Suponiendo una representación en binario puro.

2.2. Representación digital de los datos

45

Más aún, aun cuando se trate de un error despreciable, es frecuente

que ese error intervenga en cálculos repetidos, como ocurre en la manipulación de matrices, el cálculo con series recurrentes, etc.; en tales

situaciones, la propagación de un error inicial, aunque pequeño, puede

generar un error mucho mayor. El estudio y la cuantificación de los

errores, ası́ como su propagación en cálculos repetitivos y los métodos

para encontrar soluciones satisfactorias, escapan del alcance y objetivos

de este curso, siendo materia propia de los métodos numéricos.

Otros sistemas de representación (paquetes matemáticos)

Durante la pasada década, se han desarrollado y difundido paquetes

de programas matemáticos, capaces de resolver eficientemente un extenso número de problemas, manipulando expresiones tanto numéricas

como simbólicas. Para ello están provistos (aparte de otros mecanismos)

de potentes sistemas aritméticos de representación no convencionales.

Veamos dos ejemplos de estas posibilidades:

• Capacidad de representar enteros con tamaño limitado sólo por

la memoria del ordenador, fracciones y reales con una precisión

arbitraria, elegida por el usuario. Por ejemplo:

sea precisión decimales = 25

escribir pi

3.1415926535897932384626433

• Capacidad de establecer valores numéricos (reales o complejos)

mediante su definición, en lugar de su cálculo, con lo que no hay

pérdida de precisión. Ası́, es posible establecer sentencias del estilo

de las siguientes:

sea x0 := x tal que x2 + 5 = 0

escribir (1 − x0 2 )/2

cuya ejecución producirı́a la escritura de 3, exactamente.

46

Capı́tulo 2. Representación de la información

2.2.4

Representación de los caracteres

Existen otros convenios, además de los numéricos, para representar

los caracteres disponibles habitualmente en un teclado de computador:

los dı́gitos, las letras minúsculas y mayúsculas, los signos de puntuación

y de operación y otros sı́mbolos especiales, tales como #, &, @, %, etc.

Inicialmente surgieron numerosos convenios para codificar los caracteres, variando el número n de bits empleados (y con él su capacidad de

representación), ası́ como la posición, entre 0 y 2n − 1, asignada a cada

carácter. Sin embargo, en seguida se observó la necesidad de adoptar

convenios normalizados, ası́ como la conveniencia de que éstos tengan

ciertas cualidades:

• Debe incluirse el juego de letras mı́nimo internacional, en dos intervalos de posiciones consecutivas, correspondientes a las letras

minúsculas y mayúsculas.

• Los caracteres correspondientes a los dı́gitos deben ocupar también

posiciones correlativas, de “fácil” cifrado y descifrado.

Además, cuando la capacidad de representación lo permita, será deseable

que en un sistema sea posible:

• Añadir otros caracteres más especı́ficos: frecuentemente, los propios de una lengua (las “á” y “ñ” españolas, la “û” francesa, etc.)

• Destinar ese exceso de capacidad a prevenir y subsanar posibles

errores, como veremos en el siguiente apartado.

Uno de los convenios más extendidos en la actualidad es el ASCII, con

7 bits, por lo que admite hasta 27 = 128 caracteres. Damos la siguiente

tabla, omitiendo los primeros 32 caracteres, por ser caracteres de control.

47

2.2. Representación digital de los datos

32

33

34

35

36

37

38

39

40

41

42

43

!

”

#

$

%

&

’

(

)

*

+

44

45

46

47

48

49

50

51

52

53

54

55

,

.

/

0

1

2

3

4

5

6

7

56

57

58

59

60

61

62

63

64

65

66

67

8

9

:

;

¡

=

¿

?

@

A

B

C

68

69

70

71

72

73

74

75

76

77

78

79

D

E

F

G

H

I

J

K

L

M

N

O

80

81

82

83

84

85

86

87

88

89

90

91

P

Q

R

S

T

U

V

W

X

Y

Z

[

92

93

94

95

96

97

98

99

100

101

102

103

\

]

ˆ

‘

a

b

c

d

e

f

g

104

105

106

107

108

109

110

111

112

113

114

115

h

i

j

k

l

m

n

o

p

q

r

s

116

117

118

119

120

121

122

123

124

125

126

t

u

v

w

x

y

z

{

|

}

˜

En este convenio, se observa en primer lugar que los dı́gitos decimales

“0”, . . . , “9” ocupan las posiciones 48, . . . , 57: sus valores (0000, . . . ,

1001 ) coinciden con las terminaciones de sus posiciones (0110000, . . . ,

0111001 ).

Siguiendo la segunda condición, las letras mayúsculas y minúsculas

se hallan situadas en las posiciones 65 a 90 y 97 a 122, respectivamente.

En la práctica no se utilizan palabras de 7 bits, siendo frecuente

en cambio adoptar el byte (= 8 bits) como unidad. Ası́, es posible

extender el convenio anterior y dar cabida a otros caracteres de uso

también interesante en ciertas aplicaciones; he aquı́ algunos ejemplos:

Posición:

Carácter:

2.2.5

130

é

145

æ

156

£

164

ñ

165

Ñ

168

¿

248

◦

Organización de datos más complejos

Los computadores no sólo almacenan y manipulan números y caracteres, sino que también deben organizar y tratar informaciones más

complejas, tales como sucesiones de datos (por ejemplo, cadenas de caracteres), vectores, tablas, etc., ya sea formadas por datos simples o bien

por conjuntos de información con alguna organización. Con tal finalidad

se han ideado diversas estrategias; aunque su estudio excede el alcance

de este capı́tulo, veamos un ejemplo orientativo.

48

Capı́tulo 2. Representación de la información

Supongamos una máquina de 1 byte (tamaño de palabra). Si se

adopta para los números enteros un convenio de 2 bytes, cada número

ocupará dos palabras consecutivas. Una forma natural y sencilla de

organizar un vector de n enteros consiste en situarlos secuencialmente,

empezando en las posiciones m0 , m0 + 2, . . . , m0 + 2(n − 1), y la componente i-ésima del vector reside en las posiciones m0 +2(i−1) y m0 +2i−1,

para i ∈ {1, . . . , n}.

Si se tratase de una matriz de m ∗ n, cuyas componentes ocupan k

palabras de memoria, se establece fácilmente la posición inicial para la

componente i, j-ésima:

m0 + k(n(i − 1) + j − 1)

para i ∈ {1, . . . , n}, j ∈ {1, . . . , m} y siendo m0 la posición inicial de la

matriz.

2.2.6

Representación de las instrucciones

Aunque podrı́a parecer impropio considerar las instrucciones como

informaciones, lo cierto es que los programas se almacenan en la memoria

del ordenador y manipulan del mismo modo que los datos. De hecho,

desde el punto de vista de la máquina, un programa no es más que una

secuencia de elementos, cada uno de los cuales es un descriptor de una

instrucción elemental.

El formato de las instrucciones (es decir, de sus descriptores) depende

de la máquina destinada a seguirlas. Si consideramos por ejemplo una

máquina de tres direcciones (véase cap. 3), sus instrucciones se componen de cuatro campos que codifican respectivamente la operación que

debe efectuarse y las posiciones de memoria en que se encuentran los

(como máximo dos) argumentos y la de la palabra donde debe situarse

finalmente el resultado. En el capı́tulo siguiente se presenta con detalle

uno de estos formatos.

2.3. Códigos redundantes

2.3

2.3.1

49

Códigos redundantes

Información y redundancia

Información e incertidumbre.- El término información tiene en general un significado muy amplio: piénsese en la información proporcionada por una fotografı́a o un poema. Por eso, en el contexto de la informática como ciencia que trata sobre el tratamiento automático de la

información, se asocia a ésta un significado más restringido y manejable.

Para definir este significado, consideremos que deseamos determinar

un cierto fenómeno, que puede presentar una cantidad finita de estados.

Entonces, una información (sobre ese fenómeno) es una sentencia capaz

de aportar algún conocimiento sobre tal fenómeno; esto es, capaz de

delimitar en cierta medida su estado.

Ası́ por ejemplo, si consideramos el fenómeno “colores del atuendo

que llevaba anoche el asesino del callejón”, sabiendo que el pantalón

era negro o marrón, que la camisa era azul, gris o marrón, y que el

sombrero era gris o negro, resulta que el número de estados es 12. Una

información sobre este fenómeno podrı́a consistir en la sentencia “la

camisa y el pantalón eran de distinto color”; con esta información, sólo

son posibles 10 estados de nuestro fenómeno. Ahora, la afirmación “la

camisa y el pantalón no eran ambos marrones” resulta redundante puesto

que, considerándola, siguen siendo posibles los mismos 10 estados que

ignorándola.

En lugar de hablarse de cantidad de información, resulta más fácil

manipular la de incertidumbre. Una medida indirecta de ello consiste

en la cantidad de estados posibles: su grado de indeterminación. Si

cierto fenómeno ofrece 12 estados posibles, su grado de indeterminación

es 12, pero resulta más conveniente considerar como medida de la incertidumbre el logaritmo (en base dos) de esta cantidad, puesto que la

incertidumbre crece de forma exponencial (con base dos) respecto de la

longitud (número de bits) del mensaje. Esta medida de la incertidumbre

se llama entropı́a asociada a un fenómeno, y se denota mediante H:

H = log2 (número de estados posibles de un fenómeno)

50

Capı́tulo 2. Representación de la información

Entonces, la información asociada a una sentencia se define como

disminución de incertidumbre proporcionada. Siendo H0 = log2 (n0 )

y H1 = log2 (n1 ) las entropı́as correspondientes a los estados previo y

posterior a la sentencia, con n0 y n1 posibles estados, respectivamente,

tenemos:

µ ¶

n0

I = H0 − H1 = log2 (n0 ) − log2 (n1 ) = log2

.

n1

Por ejemplo, para la primera sentencia, tenemos:

I1 = log2 10 2 > 0

mientras que la segunda proporciona una cantidad de información nula,

al ser redundante.

La redundancia en la codificación.- En los convenios de codificación/decodificación estudiados hasta ahora, se ha supuesto que su transmisión o su almacenamiento se efectúa siempre sin ruido. En ellos, el

objetivo principal consiste en diseñar convenios eficaces (sin emplear más

dı́gitos que los estrictamente necesarios, minimizando ası́ la redundancia), unı́vocos (donde el cifrado es único) y sin ambigüedad, siendo única

toda decodificación.

Para prever la posibilidad de que se produzcan perturbaciones, se

han ideado métodos capaces de descubrir en ciertas condiciones cuándo

se ha alterado un mensaje (códigos detectores), ası́ como otros capaces

de restituir su estado inicial (códigos correctores).

Ambas clases de mecanismos se apoyan en el uso de la redundancia. Anticipamos un par de ejemplos para aclarar ambos tipos de mecanismos.

Adición de un bit de paridad.- Para un mensaje de n bits se añade

uno, cuyo valor consigue que haya en total un número par de unos. Se

ignora la posibilidad de que se altere más de un bit, por considerarla

extremadamente improbable. En la interpretación del mensaje se verifica

previamente la paridad, detectándose un error si se ha producido, aunque

no será posible identificar cuál para restablecer su estado.

51

2.3. Códigos redundantes

Código dos entre tres.- Este mecanismo consiste sencillamente en

triplicar las copias de cierta información. Se consideran dos posibilidades: que no se produzca ninguna alteración, o que se produzca en una de

las copias, descartándose mayores perturbaciones. En ambos casos, se

interpreta el mensaje cifrado en la mayorı́a de las copias: dos (al menos)

entre tres.

2.3.2

Códigos sólo autodetectores: p de n

Si en una palabra de n bits (que admite 2n configuraciones) establecemos la restricción de considerar válidas sólo aquéllas con exactamente

p unos (y n−p ceros), será posible detectar si se efectúa una perturbación

simple, o una múltiple, siempre que no se alteren tantos unos como ceros. En un código p de n, el grado de indeterminación es el número de

permutaciones con repetición de p unos y n − p ceros

à !

n

p

=

n!

p!(n − p)!

que alcanza su máximo cuando p = n div 2.

2.3.3

Códigos autocorrectores: Hamming

Fundamento

Consideremos un mensaje de n bits. La idea básica consiste en añadir

un cierto número p de bits, cada uno de los cuales asegura un cierto

subconjunto de los n + p dı́gitos totales mediante un control de paridad.

Se considera la posibilidad de que exista, a lo sumo, una alteración en

uno de los n + p bits y deseamos conocer si ha habido o no perturbación

y, en caso afirmativo, cuál de los n + p bits ha sido alterado. Puesto que

el mensaje debe codificarse en los n bits, la información sobre el estado

de perturbación debe cifrarse en los p bits, para poder ası́ restablecerla.

Por tanto, conocido n, p debe ser la mı́nima cantidad de bits tal que los

2p estados posibles de los p bits de paridad acepten al menos n + p + 1

estados distintos: no alteración (1) o la posición del bit alterado (n + p).

Es decir:

p = mı́n k ∈ IN tal que 2k ≥ n + k + 1

52

Capı́tulo 2. Representación de la información

Por otra parte, los p conjuntos de bits deben elegirse de modo que

el estado de los p bits de paridad asociados a esos conjuntos permita

localizar el bit alterado, en su caso y, si es posible, con facilidad.

Un modo de conseguir el objetivo descrito consiste en intercalar el

bit i-ésimo en la posición 2i−1 , para i = 1, . . . , p, siendo su conjunto

asociado el de los dı́gitos cuyo número de posición, escrito en binario

natural, tiene un 1 como cifra i-ésima.

Sea por ejemplo n = 4. Necesitamos p = 3 bits de paridad, que

colocaremos en las posiciones 1, 2 y 4:

posición :

id. en binario :

1

001

2

010

3

011

4

100

5

101

6

110

7

111

Ahora, el bit 001(2 está asociado al conjunto de los bits del mensaje

cuya posición acabe en 1 (1, 3, 5 y 7); el bit 010(2 está asociado al

conjunto de los bits del mensaje cuya posición tenga un 1 en la segunda

cifra (2, 3, 6 y 7), y el bit 100(2 está asociado al conjunto de los bits del

mensaje cuya cifra inicial sea un 1 (4, 5, 6 y 7).

Codificación

Sencillamente, se trata de ajustar los bits de paridad con respecto a

sus conjuntos asociados. Por ejemplo, si se desea transmitir el mensaje

0110

0

1

1

0

bastará con ajustar el bit 10 con los 30 , 50 y 70 (resultando un 1); el bit

20 con los 30 , 60 y 70 (resultando un 1), y el bit 40 con los 50 , 60 y 70

(resultando un 0):

1

1

0

0

1

1

0

53

Anexo

Decodificación con autocorrección

Para rectificar y descifrar un mensaje recibido, se detectan en primer lugar los bits de paridad que reflejan alguna alteración. Si no hay

ninguno, el mensaje se ha mantenido intacto durante la transmisión; en

caso contrario, la suma de las posiciones de los bits alterados señala el

bit modificado.

Por ejemplo, si el mensaje anterior se recibe ası́:

1

1

0

0

0

1

0

el control de paridad arroja el siguiente resultado:

bit 10 (+3 + 5 + 7) = 1 (impar) ⇒ alterado

bit 20 (+3 + 6 + 7) = 2 (par) ⇒ sin alterar

bit 40 (+5 + 6 + 7) = 1 (impar) ⇒ alterado

Al ser 1 + 4 = 5, concluimos que el 50 bit es erróneo, por lo que el

mensaje original era

1

1

0

0

1

1

0

Anexo: demostración del teorema 2.1

Incluimos aquı́ esta demostración por ser constructiva, mostrando

el proceso de expresar una cantidad en cualquier base mayor que uno.

Procederemos en cuatro fases: en primer lugar, la existencia de esa

representación en las condiciones del teorema se demuestra fácilmente

por inducción, dando un método para hallar esa construcción. En segundo, se demuestra (también por inducción) que ese método converge

y a continuación que la solución que proporciona equivale efectivamente

a la cantidad dada. Finalmente, se demuestra que no hay más que una

representación de un número en una base (≥ 2) dada.

54

Capı́tulo 2. Representación de la información

1. Dada la cantidad entera y positiva N , y la base b > 1, la representación de N en base b sigue el siguiente esquema:

reprb (N ) =

N

si N < b

reprb (D).R

en otro caso, donde

D = N div b y R = N mod b

donde el punto expresa la separación entre las cifras de N , expresado en la base b, y donde div y mod representan, respectivamente,

el cociente y el resto de la división entera.

2. La convergencia del método resulta obvia considerando que, partiendo de cualquier número entero positivo N , la secuencia N =

N0 , N1 , ... conduce al conjunto {0, ..., b} mediante la aplicación de

Ni = Ni−1 div b, en un número finito, trunc(logb N ), de pasos.

3. La equivalencia queda demostrada por inducción sobre el número

de cifras de la representación obtenida: cuando N < b, tenemos el

caso base reprb (N ) = N ; en caso contrario, basta considerar que

la cantidad representada por reprb (D).R es

b ∗ reprb (D) + R= b ∗ reprb (N div b) + (N mod b)

Asumiendo ahora como hipótesis inductiva que reprb (N div b) representa la cantidad N div b, podemos expresar la cantidad anterior como

= b ∗ (N div b) + (N mod b)

que es precisamente N : recuérdese que

dividendo = divisor ∗ cociente + resto

4. En las condiciones del teorema, esa representación es única. Lo demostraremos por reducción al absurdo. Supongamos que es posible

expresar una cantidad x de dos modos distintos, cuyas representaciones tienen las cifras ...a0 y ...a00 , siendo L la posición de las

cifras distintas de mayor peso, y consideremos por ejemplo que es

aL > a0L . Entonces, se tiene:

55

2.4. Ejercicios

(a) La diferencia entre aL y a0L representa al menos bL unidades:

aL ∗ bL > a0L ∗ bL ⇒ aL ∗ bL ≥ (a0L + 1) ∗ bL = a0L ∗ bL + bL

(b) Por otra parte, la cantidad máxima que pueden representar

los dı́gitos siguientes es de

L−1

X

(b − 1) ∗ bi = bL − 1.

i=0

Resulta entonces que la diferencia que supone la cifra distinta de

mayor orden (≥ bL ) no puede compensarse por ninguna combinación de las siguientes (≤ bL − 1). Por tanto, si dos representaciones son distintas en alguna cifra, también lo son las cantidades

representadas.

2.4

Ejercicios

1. Exprese los siguientes números en las demás bases:

binario puro

1001110011

decimal

hexadecimal

6723

1A9E

2. Efectúe las siguientes operaciones, en la base indicada:

• 11011101(2 + 11110000(2

• 11000101(2 ∗ 101001(2

• A2396(16 + 24BC2(16

• A2396(16 ∗ 1A(16

Para el último apartado es recomendable construir previamente la tabla

de multiplicar por A, en base hexadecimal.

3. Halle el rango de los posibles enteros,

• si consideramos palabras de tamaño medio

• si consideramos palabras de tamaño simple

56

Capı́tulo 2. Representación de la información

• si consideramos palabras de tamaño doble

4. Represente 7 y −3 en los siguientes formatos, y realizar la suma correspondiente:

• complemento restringido, en decimal

• ı́dem, en binario

• complemento auténtico, en decimal

• ı́dem, en binario

Haga lo mismo con 12 y 7.

5. Represente los números 35, 0’25 y 2’6 en los siguientes formatos:

• en coma fija, con 5 bits enteros y 3 decimales

• coma flotante: signo (1 bit), mantisa (9) y exponente (6)

6. Generalice la representación en memoria de vectores y matrices a matrices tridimensionales.

7. Se desea diseñar un código capaz de cifrar una información con 33 posibles

estados.

• ¿Cuántos bits son necesarios?

• Con ese número de dı́gitos, ¿cuántos estados son posibles?

• Un control del tipo 2 de n, ¿cuántos dı́gitos necesita?

8. Se desea transmitir mensajes de 31 bits, asegurándolos mediante un

código de Hamming.

• ¿Cuántos dı́gitos de paridad se necesitan?

• ¿En qué posiciones?

• ¿Cuáles son los dı́gitos asociados a cada uno de los de paridad?

9. Para el código de Hamming para mensajes de 4 bits introducido en el

apartado 2.3.3, se desea transmitir la información 1001.

• Cifre el mensaje que debe enviarse

• Si consideramos las cinco posibilidades: que el mensaje llegue inalterado a su destino, o que uno de sus cuatro dı́gitos haya cambiado

su valor, descifre cada uno de esos mensajes.

2.5. Comentarios bibliográficos

57

10. Para cifrar un código de Hamming para mensajes de 11 bits, construimos

un vector de 15 bits.

• Dé fórmulas apropiadas para hallar la paridad de los bits insertados.

• Ídem para la autocorrección que se efectúa en el descifrado.

2.5

Comentarios bibliográficos

El material incluido en este capı́tulo sobre la representación de los números

reales en coma flotante sólo es una aproximación conceptual. En [Gol91] se

encontrarán muchos de los detalles técnicos omitidos aquı́, tales como el tratamiento dado en la práctica a los errores (absolutos y relativos) debidos al

redondeo, el manejo de las excepciones producidas por el desbordamiento y su

concreción en los sistemas normalizados por la IEEE.

Aunque el sistema de numeración sexagesimal no puede considerarse posicional (tal como lo usamos para medir el tiempo o los ángulos) por expresarse

el peso asociado a las “cifras” de una cantidad explı́citamente, y no mediante

su posición, este sistema es probablemente el precursor de los sistemas posicionales. Para completar la referencia histórica, debe decirse que, en la antigua

Babilonia, también se conocı́a un sistema de coma flotante, que seguramente

es el primero de esta clase [Knu72].

En [For70, Rum83, KM86] puede encontrarse una gran diversidad de ejemplos sobre la aparición de discrepancias intolerables entre los resultados teóricos

y los hallados en diversas máquinas.

Los convenios presentados en este capı́tulo constituyen tan sólo una pequeña parte de los ideados para mantener o proteger la información. Se han

escogido algunos de los códigos más ilustrativos y los más difundidos, aunque faltan otros, tales como el llamado binario reflejado y los de Gray. Una

introducción a los mismos puede consultarse en [Mei73].

Un aspecto de gran interés relacionado con la protección de la información

es la criptologı́a, que estudia mecanismos para ocultarla, cifrándola en claves

secretas (criptografı́a), ası́ como para descifrarla (criptoanálisis). En [Dew88,

Dew89] puede encontrarse una sencilla introducción a estos temas.

Capı́tulo 3

Estructura fı́sica de un

computador

3.1

3.2

3.3

3.4

3.5

3.6

3.7

Componentes de un computador

Lenguajes de máquina . . . . . .

Un ejemplo de recapitulación . .

Observaciones complementarias .

Otras arquitecturas . . . . . . . .

Ejercicios . . . . . . . . . . . . .

Comentarios bibliográficos . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

60

77

80

88

95

98

99

El principal objetivo de este tema es introducir algunos conceptos

básicos acerca de la estructura fı́sica (hardware) de un computador; pero

¿es de verdad útil preocuparse por la estructura interna de un computador?

Entre las dos posiciones extremas (el simple usuario y el informático

profesional) se encuentra una gran cantidad de profesionales que requieren conocer los computadores con un cierto detalle. Al menos, siempre es

necesario conocer las caracterı́sticas del computador y los requerimientos

(fı́sicos) de los programas que deben usarse.

En las siguientes secciones estudiamos el hardware de una computadora, formado por la UCP, la memoria y los periféricos (también llamados dispositivos de entrada y salida, E/S).

60

Capı́tulo 3. Estructura fı́sica de un computador

El significado del término hardware no es fácil de expresar en español

con una sola palabra; literalmente se debe entender como “conjunto de

útiles duros”; en el contexto que nos ocupa, el hardware de un computador es el conjunto de dispositivos fı́sicos que lo componen, mientras que

otra palabra inglesa, software, designa los programas que puede ejecutar

el computador.

En cierto modo, el hardware es comparable al cerebro o, más generalmente, al cuerpo fı́sico del computador mientras que el software

serı́a lo equivalente a las ideas que pueblan el cerebro. Es conveniente

señalar, a pesar de su evidencia, que el hardware y el software son perfectamente inútiles aisladamente: de nada nos sirve un computador si

no tenemos ningún programa que ejecutar, y de nada nos sirve tener

muchos programas si no disponemos de un computador que los ejecute.

Nuestra visión del sistema formado por el hardware y el software es

funcional, y en la última parte del capı́tulo será patente esta relación

de dependencia mutua: explicaremos el funcionamiento del hardware

siguiendo la ejecución de algunos programas sencillos, escritos en su

propio lenguaje.

3.1

Componentes de un computador

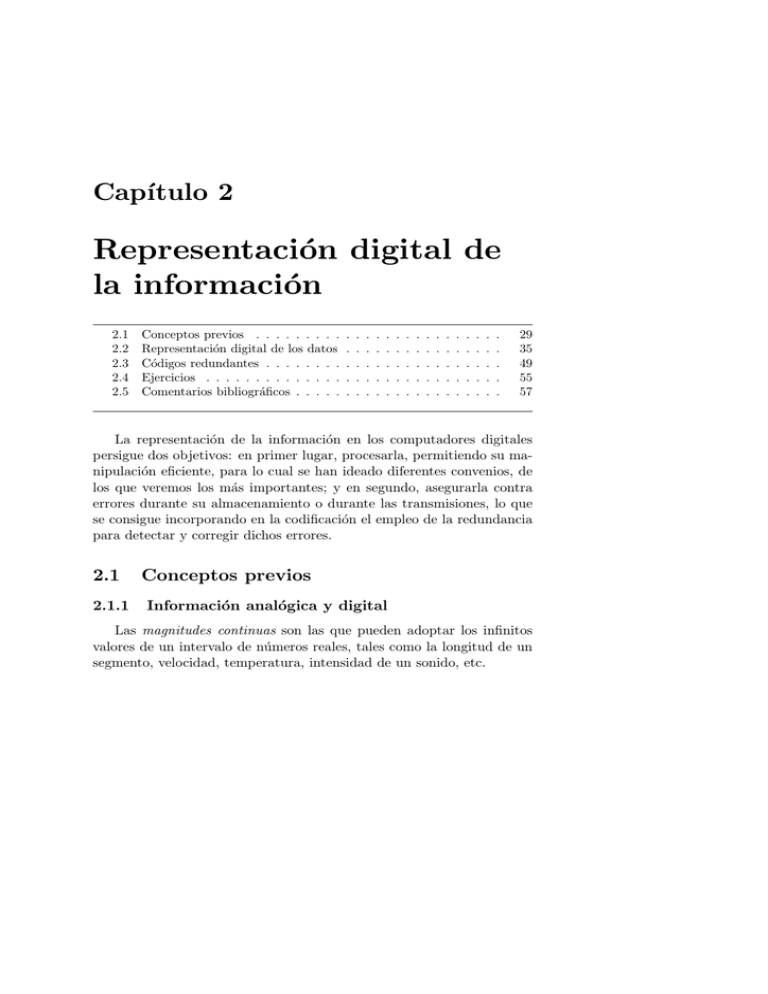

Para introducir los conceptos básicos que estudiaremos dentro de

esta sección consideramos un computador como una unidad de producción. Una unidad de producción adquiere materia prima, la elabora

y, finalmente, vende la materia elaborada. Esto mismo es lo que hace un

computador: toma algunos datos, los procesa y, finalmente, devuelve el

resultado obtenido al procesar la información.

Más concretamente, consideremos una panaderı́a ideal. En esta panaderı́a se compra harina, levadura, . . . (entrada de datos) que posteriormente se elaboran (procesamiento) para producir pan que, finalmente,

se vende (salida de datos). Para comprar y vender se necesitan personas que se relacionen con el exterior; en un computador esta labor se

realiza mediante los periféricos. Dentro de la panaderı́a podemos encontrar dos zonas bien diferenciadas e indispensables: la primera es la zona

61

3.1. Componentes de un computador

U.C.P.

U.C.

U.A.L.

M.P.

BUS

Contr.

Pantalla

Contr.

Teclado

Contr.

Disco

Contr.

Serie

Contr.

Paralelo

b

b

Teclado

U. Disco

Puerto

Serie

Puerto

Paralelo

Monitor

Figura 3.1. Estructura básica de un computador.

de amasado junto con el horno, y la segunda es el almacén.

En el computador el almacén lo representa la memoria y la zona

de trabajo es la unidad central de proceso o UCP que, a su vez, consta

de la unidad de control o UC (el encargado que controla los procesos

de amasado y horneado) y la unidad aritmética y lógica o UAL (zona

de amasado y horno). Naturalmente, entre las distintas zonas deben

existir pasillos de comunicación para poder sincronizar las acciones de

cada uno; en un computador esta información se envı́a y recibe a través

de los buses.

En las siguientes secciones estudiaremos cada una de las partes que

componen la estructura fı́sica de un computador. La figura 3.1 presenta

un esquema de la misma.

62

3.1.1

Capı́tulo 3. Estructura fı́sica de un computador

Memoria principal

Mencionábamos en el párrafo anterior que la memoria representa el

almacén donde se guarda la información, en esta sección estudiaremos

algunos detalles del almacenamiento de información en la memoria y de

los tipos de memoria existentes.

En la memoria principal se guarda el conjunto de instrucciones (programa) que está siendo ejecutado, junto con los datos de entrada y de

salida de la ejecución. Estudiaremos la memoria de un computador desde

un punto de vista fı́sico (distintos medios de almacenamiento) y desde

un punto de vista lógico (de tratamiento de la información).

Podemos encontrar similitudes entre la organización fı́sica de la memoria y el almacén de la panaderı́a ideal que introducı́amos al principio

del capı́tulo: en el almacén encontramos estanterı́as repletas de bandejas

iguales, y cuando un trabajador entra en el almacén, bien trae o bien

retira algunas de estas bandejas. La unidad mı́nima a la que se accede

no es una barra de pan (bit) sino una bandeja completa (palabra). La

longitud de palabra de memoria viene representada por la capacidad de

cada bandeja.

No podemos acceder a cada bit de la memoria aisladamente; la

mı́nima cantidad de memoria a la que podemos acceder está formada

por una palabra de memoria. Fı́sicamente, la memoria está dividida

en celdas (con una capacidad de información de un bit), agrupadas en

palabras de memoria.

Funcionamiento de la memoria

Para acceder a cada palabra de memoria debemos poder referirnos a

ellas. Esto se hace asignando una dirección numérica binaria a cada palabra a modo de “dirección postal”. La dirección de memoria determina

una palabra de memoria, que es la que contiene la información.

Supongamos que tenemos un computador que tiene palabras de memoria de 1 byte (8 bits) y dispone de 1 Mb (220 bytes) de memoria principal. Cada dirección de memoria tiene asignado un número en binario

3.1. Componentes de un computador

63

entre 0 y 220 − 1. Para poder denotar todas las palabras de memoria

disponibles necesitaremos al menos 20 dı́gitos ya que, en general, con

d bits es posible direccionar 2d palabras de memoria. Téngase en cuenta

que, en principio, la longitud de palabra de memoria no tiene relación

con la longitud de las direcciones de memoria; en el apartado sobre optimización de memorias tendremos la oportunidad de profundizar algo

más sobre ello.

En la memoria se realizan operaciones elementales de lectura y escritura, que escriben o leen la información contenida en una sola palabra

de memoria. Tanto la UCP como la memoria se sirven de unas cuantas

palabras de acceso muy rápido, llamadas registros. Para las operaciones de lectura y escritura, los dispositivos de memoria disponen de dos

registros: el de dirección (RD) y el de intercambio de memoria (RIM).

El RD indica la dirección de memoria que se quiere leer o en la que se

quiere escribir; puesto que debe tener capacidad para albergar cualquier

dirección de memoria, es un registro de d bits siguiendo la notación

anterior. Por su parte, el RIM alberga la palabra leı́da o que se va a

escribir en la dirección dada por el RD y, por lo tanto, tiene tantos bits

como la longitud de palabra de memoria. La memoria está conectada

con la UCP y con los periféricos a través de los buses de direcciones, de

datos y de control que describiremos más adelante.

El proceso de lectura o escritura se puede dividir en los siguientes

pasos:

1. A través del bus de direcciones llega un número de dirección de

memoria que se almacena en el RD.

2. Simultáneamente, por el bus de control, llega una señal que indica

si la operación que debe realizarse es de lectura o de escritura.

3. Si la operación es de escritura, por el bus de datos llega la palabra

que se quiere escribir. Ésta se almacena en el RIM y se escribe

donde indique RD. Si la operación es de lectura se lee la información que se encuentra en la dirección almacenada en el RD y se

escribe en el RIM.

64

Capı́tulo 3. Estructura fı́sica de un computador

4. La memoria genera, por el bus de control, una señal de control que

indica el fin de la operación.

Clasificación de las memorias

La memoria se encarga de intercambiar información con el procesador

según las necesidades de éste. Con la tecnologı́a actual los procesadores alcanzan velocidades de varios millones de cómputos por segundo,

lo que obliga a la memoria a tener una velocidad semejante a fin de

no menguar la eficiencia del computador. Por otra parte, la capacidad

de memoria es otra caracterı́stica interesante, ya que, en principio,1 no

podrı́amos ejecutar programas que no pudieran ser cargados completamente en memoria. Las caracterı́sticas de velocidad y capacidad están

reñidas entre sı́, por lo que es necesario alcanzar un compromiso entre

ambas dependiendo de la finalidad. Según el nivel de compromiso alcanzado podemos destacar varios niveles jerárquicos de memoria: de más

rápida y cara (por lo que suelen tener menor capacidad) a menos rápida

y mayor capacidad:

1. Memoria principal

2. Memoria secundaria

3. Memoria auxiliar

Los dos últimos tipos de memoria serán desarrollados en la sección de

periféricos, pues pueden ser considerados como periféricos de almacenamiento.

Hemos dicho anteriormente que las memorias son dispositivos de lectura y escritura, y esto es cierto cuando hablamos de la memoria principal de un computador. Sin embargo, existe otro tipo de memorias

de sólo lectura que hace las veces de manual de comportamiento de la

máquina que la contiene.

1

En realidad, cada programa tendrá unos requerimientos mı́nimos de memoria, aunque ello no significa que tenga que caber completo en la memoria.

3.1. Componentes de un computador

65

Las memorias de sólo lectura reciben el nombre genérico de memorias

ROM (acrónimo del inglés Read Only Memory). Los computadores vienen dotados con una memoria de este tipo donde se almacena la rutina

de arranque. Otras aplicaciones de este tipo de memoria las encontramos en las lavadoras automáticas (los programas de lavado se almacenan

en una ROM) y en los juguetes electrónicos. En este tipo de memoria

la información es almacenada de forma permanente.

Algunas variantes de la memoria ROM son la PROM (ROM programable), EPROM (PROM borrable, erasable PROM) y la EEPROM

(PROM eléctricamente borrable). Estos tipos de memoria son útiles en

la fase de desarrollo de un sistema, en la cual aún no se ha fijado el

contenido final de la ROM.

Las memorias de lectura y escritura suelen llamarse memorias RAM

(del inglés Random Access Memory). Dentro de este tipo de memorias podemos distinguir las RAM estáticas y las RAM dinámicas. Las

estáticas se caracterizan por tener un tiempo de acceso2 igual a cada dirección de memoria (cada dirección tiene su propio camino de acceso

dentro del microchip, generalmente construido con semiconductores).

Por otra parte, son memorias volátiles en el sentido de que necesitan

la alimentación eléctrica para conservar la información.

En las RAM dinámicas la información necesita ser recordada periódicamente, ya que se va descargando con el tiempo. Esta pérdida de

información es debida a que están construidas usando pequeños condensadores. La razón de ser de este tipo de memorias es la economı́a, pues

generalmente son más baratas que las estáticas.

Optimización de memorias

Sabiendo la necesidad de contar con memorias cada vez más rápidas

y con más capacidad se han ideado métodos de optimización para la memoria principal. Dependiendo del aspecto por optimizar encontramos las

2

El tiempo requerido para leer o escribir una palabra de memoria. En una memoria

estática puede ser de unos 20 ns, mientras que en una dinámica puede alcanzar los 80

ns.

66

Capı́tulo 3. Estructura fı́sica de un computador

memorias caché y la memoria virtual que, respectivamente, aumentan

la rapidez y la capacidad de la memoria principal.

Las memorias caché son memorias hasta mil veces más rápidas que

las usuales pero, debido a su alto coste, suelen tener una capacidad

muy pequeña. La idea que define las memorias caché no puede ser más

simple: se trata de guardar en registros los contenidos de las posiciones

de memoria de uso más frecuente, de modo que sea mucho más rápido

acceder a la información que hay en ellas.

El funcionamiento de la memoria caché ejerce una acción de filtro

sobre las direcciones de memoria que solicita la UCP. La secuencia de

acciones que se producen en las operaciones de lectura y escritura con

memoria caché son las siguientes:

1. La UCP genera una dirección de memoria que se envı́a a las memorias principal y caché.

2. Si la dirección se encuentra en la caché, será ésta la que devuelva

el dato e inhiba la salida de la memoria principal. De lo contrario,

será la memoria principal la que dé el dato.

3. Finalmente, se actualizan las direcciones y los datos contenidos en

la caché.

Existen distintas estrategias para seleccionar las direcciones que se guardan en la memoria caché de modo que se mantengan en ella las direcciones más usadas (obsérvese que el conjunto de direcciones de memoria

más utilizadas variará con la fase del programa que se esté ejecutando).

Una buena estrategia de selección puede conllevar una tasa de aciertos

(la dirección requerida está en la caché) muy elevada, de donde la velocidad aparente de la memoria se asemejará mucho a la velocidad de la

memoria caché.

La memoria virtual se desarrolla con el propósito de poder hacer uso

de más memoria de la que fı́sicamente se dispone. Si un programa es demasiado grande para la memoria disponible se solı́a dividir en módulos

que cupieran en memoria mediante la técnica del solapamiento (overlay). Esta técnica tiene el serio inconveniente de que los programas no

3.1. Componentes de un computador

67

son transportables, puesto que, en general, no funcionarı́an en un computador con menos memoria.

Para solventar estos problemas se desarrolló la memoria virtual como

un método automático para realizar el solapamiento. La idea consiste en

usar la memoria secundaria, generalmente un disco duro, como memoria principal. Un programador que dispone de memoria virtual tiene la

impresión de estar trabajando con un mapa de direcciones de memoria

(direcciones lógicas) mucho mayor del que fı́sicamente dispone (direcciones fı́sicas).

Existen otras técnicas para mejorar la utilización de la memoria como

son la paginación y la segmentación. Estas técnicas utilizan programas

de gestión de memoria que forman parte del sistema operativo; en el

capı́tulo 4 se presentarán más detalles sobre ellas.

3.1.2

Unidad central de proceso

La UCP representa el cerebro de la computadora y allı́ es donde se

procesa la información recibida, por lo que casi siempre nos referiremos

a ella como el procesador. La UCP está formada por la unidad de control

(UC), que clasifica y organiza las instrucciones recibidas (encargado), y

la unidad aritmética y lógica (UAL), que las ejecuta (donde se “amasa

y cuece” la información).

Fı́sicamente el procesador es un microchip y consta de unos circuitos

electrónicos que permiten realizar operaciones elementales con la información. El procesador se conecta con el resto de los componentes de

un computador mediante unas patillas metálicas, cada una de las cuales

transporta información binaria, a través de los buses de comunicación

que estudiaremos más adelante.

El cometido de la UC consiste en recibir la instrucción que se va a

ejecutar, determinar su tipo (cálculo aritmético, lógico, . . . ), determinar si esa instrucción necesita argumentos almacenados en la memoria,

leer (en su caso) las direcciones de memoria que contienen los argumentos de la instrucción y dar la orden correspondiente a la UAL. Por su

parte, la labor de la UAL es la de ejecutar las instrucciones aritméticas

68

Capı́tulo 3. Estructura fı́sica de un computador

y lógicas, una vez que la UC ha determinado su tipo y ha leı́do sus argumentos (si los hubiera). Las instrucciones que llegan a la UAL son

muy sencillas, y se reducen a un cálculo aritmético elemental (según

el tipo de procesador, “elemental” significará bien suma-resta o bien

suma-resta-multiplicación-división), un cálculo lógico (and, or, . . . ), o

una instrucción de salto o bifurcación.

Unidad de control

La UC se encarga de clasificar las instrucciones que recibe, controlar

su ejecución y leer las zonas de la memoria que almacenan los argumentos

de estas instrucciones. La UC está dotada de unos cuantos registros

internos de memoria que usa para almacenar datos elementales durante

la ejecución de una instrucción elemental. Esta memoria dispone de

un cierto número de registros con un cometido particular, entre los que

destacan el registro de instrucción y el contador de programa.

El registro de instrucción almacena aquélla que está siendo ejecutada

y, por su parte, el contador de programa almacena la dirección de la

siguiente instrucción que debe ser ejecutada. Existen, además, otros

registros que almacenan los resultados parciales de la ejecución de una

instrucción.

El funcionamiento de la UC está regido por los impulsos de un reloj

que sincroniza la realización de las distintas operaciones y determina la

velocidad del procesador. Su frecuencia se mide en MHz (megaherzios,

millones de ciclos por segundo).

El trabajo desempeñado por la unidad de control al ejecutar una

instrucción puede descomponerse en pequeños pasos como los descritos

a continuación:

1. Leer el contador de programa.

2. Almacenar en el registro de instrucción el contenido de la dirección

de memoria que aparece en el contador de programa.

3. Averiguar si la instrucción necesita argumentos y, en su caso, determinar sus direcciones de memoria.

3.1. Componentes de un computador

69

4. Leer los argumentos y almacenarlos en los registros internos.

5. Ordenar a la UAL que ejecute el cómputo necesario.

6. Almacenar el resultado de la ejecución.

7. Actualizar el contador de programa con la siguiente instrucción

por ejecutar.

La UC dispone de un dispositivo denominado secuenciador que efectúa esta descomposición en pasos elementales.

Unidad aritmética y lógica

La unidad aritmética y lógica es el horno donde se cuece la información; su tarea consiste en recibir instrucciones junto con sus argumentos y ejecutarlas, dando a cambio el resultado de su operación.

Esta unidad consta de un(os) operador(es) que ejecuta(n) fı́sicamente

las instrucciones recibidas, una serie de registros para almacenar información mientras se ejecuta una instrucción (entre estos registros destaca

el registro acumulador , al que se hará referencia de nuevo cuando estudiemos el direccionamiento de las instrucciones) y algunos señalizadores

de estado que indican resultados interesantes obtenidos al realizar un

cómputo (resultado cero, overflow o desbordamiento, . . . )

Los operadores son dispositivos fı́sicos (circuitos electrónicos) que

pueden realizar operaciones elementales sobre datos binarios. Las operaciones que son capaces de hacer estos dispositivos pueden ser de desplazamiento, lógicas o aritméticas.

Las operaciones de desplazamiento consisten en desplazar los bits de

una palabra varios lugares hacia la izquierda o hacia la derecha. Dependiendo de la acción del desplazamiento sobre los extremos de la palabra

podemos distinguir varios tipos de desplazamiento:

1. Desplz. lógico: si el extremo de la palabra que queda vacı́o tras el

desplazamiento se completa con ceros.

70

Capı́tulo 3. Estructura fı́sica de un computador

2. Desplz. aritmético: es similar al anterior, pero se mantiene el bit

de signo. Se utiliza para representar multiplicaciones y divisiones

de una potencia de 2.

3. Desplz. circular: los bits que quedan fuera tras el desplazamiento se

emplean en llenar los huecos libres del otro extremo de la palabra.

4. Desplz. concatenado: se desplaza conjuntamente el contenido de

dos o más registros.

Las operaciones lógicas tales como NOT, AND y OR se realizan bit

a bit. La primera de estas operaciones sólo depende de un argumento,

mientras que las restantes necesitan dos argumentos.

Las operaciones aritméticas más importantes que se realizan en la

UAL son las de suma, resta, multiplicación y división, la de cambio de

signo y la de extensión de signo. Esta última operación se hace necesaria cuando se transmite información a un elemento con mayor longitud

de palabra pues es necesario completar los bits restantes sin alterar la

información. En general las operaciones de multiplicar y dividir se hacen

usando sumas y restas mediante un algoritmo apropiado; sólo computadores muy potentes (y caros) disponen de operadores particulares que

las realicen directamente.

Se puede mejorar la capacidad de cálculo numérico de algunos procesadores añadiendo un coprocesador matemático. Los dispositivos de este

tipo complementan la UAL del procesador por otra más potente; con mayores y más numerosos registros operativos, con una representación interna de los datos de mayor precisión y con instrucciones numéricas más

complejas (funciones exponenciales, logarı́tmicas y trigonométricas).

Para ello, comparten el flujo de instrucciones y datos del procesador

y cuando detectan alguna instrucción numérica toman el control del

programa, ejecutan la instrucción, calculan el resultado y devuelven el

control al procesador.

3.1.3

Periféricos

Damos en esta sección una visión general de los periféricos. Podemos considerar periféricos de entrada, de salida y de almacenamiento;

3.1. Componentes de un computador

71

asimismo podemos distinguir entre periféricos locales y periféricos remotos, según su conexión al computador. Un periférico local, como el ratón,