Universidad Nacional de San Antonio Abad del

Cusco

Departamento Académico de Informática

Algoritmica III

Capítulo III

TECNICAS DE DISEÑO

DE ALGORITMOS

Iván Medrano Valencia

2015

TECNICAS DE DISEÑO DE

ALGORITMOS

A través de los años, los científicos de la computación

han identificado diversas técnicas generales que a

menudo producen algoritmos eficientes para la

resolución de muchas clases de problemas. Este

capitulo presenta algunas de las técnicas más

importantes como dividir para vencer, programación

dinámica, técnicas ávidas, el método de retroceso y

otros.

Sin embargo, debe subrayarse que hay algunos

problemas, como los NP completos, para los cuales ni

éstas ni otras técnicas conocidas producirán

soluciones eficientes.

ALGORITMOS GOLOSOS

El término “algoritmo goloso” es una traducción

libre del inglés “greedy algorithms”, en algunos

textos se refiere a este tipo de algoritmos como

“ávidos”, “codiciosos”, “glotones”, etc.

Se utilizan para resolver problemas de

optimización y son extremadamente sencillos, se

basan en un principio fundamental.

ALGORITMOS GOLOSOS

Principio.

“Un algoritmo goloso, siempre toma la decisión que

parece mejor de acuerdo al estado actual del

problema”

Funciona construyendo una solución en base a

una secuencia de decisiones golosas, se dice

que la decisión que toman estos algoritmos es

golosa, porque si bien son óptimas en el estado

actual del problema no implica que lleven

necesariamente a un solución óptima del

problema

ALGORITMOS GOLOSOS

Importante.

Una solución localmente óptima no

necesariamente lleva a una solución globalmente

óptima.

FUNDAMENTOS.

El problema debe poder ser descompuesto en

varios sub-problemas, de forma tal que si la

solución del problema es óptima la solución de los

sub-problemas también lo es.

Debe ser posible demostrar que una elección

localmente óptima lleva a una solución globalmente

óptima.

Método general

Los algoritmos voraces, ávidos o de avance

rápido (en inglés greedy) se utilizan normalmente

en problemas de optimización.

El problema se interpreta como: “tomar algunos

elementos de entre un conjunto de candidatos”.

El orden el que se cogen puede ser importante o no.

Un algoritmo voraz funciona por pasos:

Inicialmente partimos de una solución vacía.

En cada paso se escoge el siguiente elemento para añadir a

la solución, entre los candidatos.

Una vez tomada esta decisión no se podrá deshacer.

El algoritmo acabará cuando el conjunto de elementos

seleccionados constituya una solución.

Método general

Se puede generalizar el proceso intuitivo a un

esquema algorítmico general.

El esquema trabaja con los siguientes conjuntos de

elementos:

C: Conjunto de elementos candidatos, pendientes

de seleccionar (inicialmente todos).

S: Candidatos seleccionados para la solución.

R: Candidatos seleccionados pero rechazados

después.

¿Cuál o cuáles son los candidatos? Depende de

cada problema.

Método general

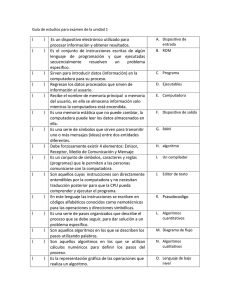

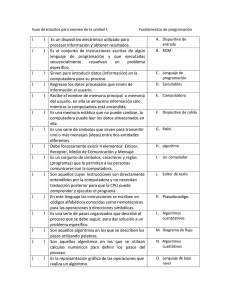

Esquema general de un algoritmo voraz:

voraz (C: CjtoCandidatos; var S: CjtoSolución)

Inicio

S:= Ø

mientras (C Ø) Y NO solución(S) hacer

Inicio

x:= seleccionar(C)

C:= C - {x}

si factible(S, x) entonces

insertar(S, x)

finsi

fin

si NO solución(S) entonces

devolver “No se puede encontrar solución”

Fin

A.E.D.

8

Método general

Funciones genéricas

solución (S). Comprueba si un conjunto de candidatos es una

solución (independientemente de que sea óptima o no).

seleccionar (C). Devuelve el elemento más “prometedor” del

conjunto de candidatos pendientes (no seleccionados ni

rechazados).

factible (S, x). Indica si a partir del conjunto S y añadiendo x, es

posible construir una solución (posiblemente añadiendo otros

elementos).

insertar (S, x). Añade el elemento x al conjunto solución.

Además, puede ser necesario hacer otras cosas.

Función objetivo (S). Dada una solución devuelve el coste

asociado a la misma (resultado del problema de optimización).

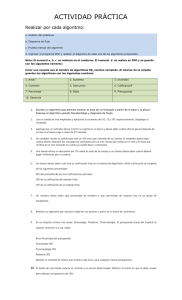

ALGORITMOS GOLOSOS

EJEMPLO 1.

Dado un conjunto de n números se solicita

escoger k números, de entre todas las formas

que hay para elegir los k números del conjunto

dado, de modo que la suma se éstos k

números sea máxima

ALGORITMOS GOLOSOS

SOLUCIÓN

Para resolver este problema podrían probarse

todas las formas posibles que hay para

escoger k números de un conjunto de n

números. Por supuesto ésta es una forma

absurda de resolver el problema.

Simplemente podrían escogerse los k números más grandes,

los mismos que constituirían la solución.

15

2

17

11

6

ALGORITMOS GOLOSOS

El algoritmo sería:

para (i=1; i<= k; i++)

Inicio

{Escoger el número más grande y

eliminarlo dela lista}

Fin

El algoritmo anterior es ún método codicioso típico.

En cada etapa se selcciona el número más grande

ALGORITMOS GOLOSOS

El algoritmo sería:

para (i=1; i<= k; i++)

Inicio

{Escoger el número más grande y

eliminarlo dela lista}

Fin

El algoritmo anterior es ún método codicioso típico.

En cada etapa se selcciona el número más grande

ALGORITMOS GOLOSOS

EJEMPLO 2.

En la fig. se solicita encontrar la ruta más corta

de v0 a v3

Mediante el método ávido se puede resolver el problema.

El camino más corto será: 1 + 2 + 4 = 7

ALGORITMOS GOLOSOS

EJEMPLO 3.

Encontrar el camino más corto en el siguiente

grafo.

Greedy method: v0v1,2v2,1v3 = 23

Optimal: v0v1,1v2,2v3 = 7

El método goloso no funciona

ALGORITMOS GOLOSOS

EJEMPLO 4.

Se trata de devolver una cantidad de SOLES con el

menor número posible de billetes y monedas.

Se parte de un conjunto de tipos de billetes y monedas

válidas, de las que se supone que hay cantidad

suficiente para realizar el desglose, y de un importe a

devolver.

SON 111 soles

AHÍ VAN 5 SOLES

TOMA EL CAMBIO,

389 SOLES

Problema del cambio de monedas.

Construir un algoritmo que dada una cantidad P devuelva esa

cantidad usando el menor número posible de monedas.

Disponemos billetes y monedas con valores de

200,100,50,20,10 5,2,1

Ejemplo: Devolver 563 Soles con el menor nº de

billetes y monedas.

2 billetes de 200 = 400

1 billete de 100

= 100

1 billete de 50

= 50

1 billete de 10

= 10

1 moneda de 2

=2

1 moneda de 1 = 1

TOTAL: 7 BILLETES Y MONEDAS

El método intuitivo se puede entender como un algoritmo

voraz: en cada paso añadir una moneda nueva a la

solución actual, hasta llegar a P.

Conjunto de candidatos: todos los tipos de monedas

disponibles. Supondremos una cantidad ilimitada de

cada tipo.

Solución: conjunto de monedas que sumen P.

Función objetivo: minimizar el número de monedas.

Representación de la solución:

(x1, x2, x3, x4, x5, x6, x7, x8), donde xi es el número de

monedas usadas de tipo i.

Suponemos que la moneda i vale ci.

Formulación: minimizar xi, sujeto a xi·ci = P, xi≥0

i=1..8

i=1..8

Funciones del esquema:

inicialización. Inicialmente xi= 0, para todo i= 1..8

solución. El valor actual es solución si xi·ci = P

seleccionar. ¿Qué moneda se elige en cada paso de

entre los candidatos?

Respuesta: elegir en cada paso la moneda de valor

más alto posible, pero sin sobrepasar la cantidad

que queda por devolver.

factible. Valdrá siempre verdad.

En lugar de seleccionar monedas de una en una,

usamos la división entera y cogemos todas las

monedas posibles de mayor valor.

Implementación. Usamos una variable local act para acumular

la cantidad devuelta hasta este punto.

Suponemos que las monedas están ordenadas de menor a

mayor valor.

DevolverCambio (P: entero; C: array [1..n] de entero;

var X: array [1..n] de entero)

Inicio

act:= 0

j:= n

inicialización

para i:= 1,...,n hacer

X[i]:= 0

no solución(X)

mientras act P hacer

seleccionar(C,P,X)

Inicio

mientras (C[j] > (P - act)) AND (j>0) hacer j:= j - 1

si j==0 entonces devolver “No existe solución”

no factible(j)

X[j]:= (P - act) / C[j]

act:= act + C[j]*X[j]

insertar(X,j)

fin

fin

¿Cuál es el orden de complejidad del algoritmo?

¿Garantiza siempre la solución óptima?

Para este sistema monetario sí. Pero no siempre...

Ejemplo. Supongamos

que tenemos monedas

de 100, 90 y 1. Queremos

devolver 180.

Algoritmo voraz. 1 moneda de 100 y 80 monedas de

1: total 81 monedas.

Solución óptima. 2 monedas de 90: total 2 monedas.

3.2. Análisis de tiempos de ejecución

El orden de complejidad depende de:

El número de candidatos existentes.

Los tiempos de las funciones básicas utilizadas.

El número de elementos de la solución.

...

Ejemplo. n: número de elementos de C. m: número de

elementos de una solución.

Repetir, como máximo n veces y como mínimo m:

Función solución: f(m). Normalmente O(1) u O(m).

Función de selección: g(n). Entre O(1) y O(n).

Función factible (parecida a solución, pero con una solución

parcial): h(m).

Inserción de un elemento: j(n, m).

Análisis de tiempos de ejecución

Tiempo de ejecución genérico:

t(n,m) O(n*(f(m)+g(n)+h(m)) + m*j(n, m))

Ejemplos:

Algoritmos de Prim y Dijkstra: n candidatos, la función de

selección e inserción son O(n): O(n2).

Devolución de monedas: podemos encontrar el siguiente

elemento en un tiempo constante (ordenando las

monedas): O(n).

El análisis depende de cada algoritmo concreto.

En la práctica los algoritmos voraces suelen ser

bastante rápidos, encontrándose dentro de

órdenes de complejidad polinomiales.

A.E.D.

24

Problema de la mochila no 0/1

20 Kg.

Tenemos:

n objetos, cada uno con un peso (pi) y un beneficio (bi)

Una mochila en la que podemos meter objetos, con una

capacidad de peso máximo M.

Objetivo: llenar la mochila, maximizando el beneficio de los

objetos transportados, y respetando la limitación de capacidad

máxima M.

Los objetos se pueden partir en trozos.

Problema de la mochila no 0/1

Datos del problema:

n: número de objetos disponibles.

M: capacidad de la mochila.

p = (p1, p2, ..., pn) pesos de los objetos.

b = (b1, b2, ..., bn) beneficios de los objetos.

Representación de la solución:

Una solución será de la forma S = (x1, x2, ..., xn), con 0≤xi≤1,

siendo cada xi la fracción escogida del objeto i.

Formulación matemática:

Maximizar

xi bi; sujeto a la restricción xi pi ≤ M, y 0≤xi≤1

i=1..n

i=1..n

3.3.1. Problema de la mochila no 0/1

Ejemplo: n = 3; M = 20

p = (18, 15, 10)

b = (25, 24, 15)

18 kg

20 Kg.

PVP 25

Solución 1: S = (1, 2/15, 0)

Beneficio total = 25 + 24*2/15 = 28,2

15 kg

PVP 24

10 kg

PVP 15

18 kg

2 kg

PVP 25

Solución 2: S = (0, 2/3, 1)

Beneficio total = 24*2/3+15 = 31

10 kg

PVP 24

10 kg

PVP 15

PVP 24

3.3.1. Problema de la mochila no 0/1

El problema se ajusta bien a la idea de algoritmo voraz.

Diseño de la solución:

Candidatos: cada uno de los n objetos de partida.

Función solución: tendremos una solución si hemos introducido en

la mochila el peso máximo M, o si se han acabado los objetos.

Función seleccionar: escoger el objeto más prometedor.

Función factible: será siempre cierta (podemos añadir trozos de

objetos).

Añadir a la solución: añadir el objeto entero si cabe, o en otro caso

la proporción del mismo que quede para completarla.

Función objetivo: suma de los beneficios de cada candidato por la

proporción seleccionada del mismo.

Queda por definir la función de selección. ¿Qué criterio podemos

usar para seleccionar el objeto más prometedor?

Problema de la mochila no 0/1

Mochila (M: entero; b, p: array [1..n] de entero;

var X: array [1..n] de entero)

Inicio

para i:= 1, ..., n hacer

X[i]:= 0

pesoAct:= 0

mientras pesoAct < M hacer

Inicio

i:= el mejor objeto restante

si pesoAct + p[i] M entonces

Inicio

X[i]:= 1

pesoAct:= pesoAct + p[i]

fin

caso contrario

Inicio

X[i]:= (M - pesoAct)/p[i]

pesoAct:= M

fin

fin

Fin

Problema de la mochila no 0/1

Posibles criterios para seleccionar el mejor objeto de

los restantes:

1. El objeto con más beneficio bi: argmax bi

i= 1, ..., n

2. El objeto menos pesado pi (para poder añadir muchos

objetos): argmin pi

i= 1, ..., n

3. El objeto con mejor proporción bi/pi (coste por unidad

de peso): argmax bi/pi

i= 1, ..., n

¿Cuál es el mejor criterio de selección?

¿Garantiza la solución óptima?

Problema de la mochila no 0/1

Ejemplo 1: n = 4; M = 10

p = (10, 3, 3, 4)

b = (10, 9, 9, 9)

Criterio 1: S = (1, 0, 0, 0). Beneficio total = 10

Criterio 2 y 3: S = (0, 1, 1, 1). Beneficio total = 27

Ejemplo 2: n = 4; M = 10

p = (10, 3, 3, 4)

b = (10, 1, 1, 1)

Criterio 1 y 3: S = (1, 0, 0, 0). Beneficio total = 10

Criterio 2: S = (0, 1, 1, 1). Beneficio total = 3

Los criterios 1 y 2 pueden dar soluciones no muy buenas.

El criterio 3 garantiza siempre una solución óptima.

EL PROBLEMA DE LA MOCHILA

n

Teorema:

Si seleccionamos los objetos por orden decreciente de

vi/wi, y se permite dividirlos, el algoritmo de la mochila

encuentra una solución óptima.

n

Complejidad:

Si están ordenados (creciente de vi/wi): O(n)

Incluyendo ordenación: O(n lg n)

n

El problema de la mochila no se resuelve de manera

óptima con Avidos, al no dejar que los los objetos se

dividan. En este caso, sí se obtiene una solución

óptima con Programación Dinámica.

EL CAMIONERO CON PRISA

Un camionero conduce desde Arequipa a Cusco siguiendo

una ruta dada y llevando un camión que le permite, con el

tanque de gasolina lleno, recorrer n kilómetros sin parar. El

camionero dispone de un mapa de carreteras que le indica

las distancias entre las gasolineras que hay en su ruta.

Como va con prisa, el camionero desea pararse a repostar

el menor número de veces posible. Deseamos diseñar un

algoritmo ávido para determinar en qué gasolineras tiene

que parar y demostrar que el algoritmo encuentra siempre

la solución óptima.

TYPE SOLUCION = ARRAY [1..G-1] OF BOOLEAN;

TYPE DISTANCIA = ARRAY [1..G-1] OF CARDINAL;

PROCEDURE Deprisa(n:entero; VAR d:DISTANCIA;

VAR sol:SOLUCION);

VAR i,numkilometros:CARDINAL;

Inicio

para (i:=1; i<= G-1;i++)

sol[i]:=FALSE

i:=0;

numkilometros:=0;

REPEAT

REPEAT

i++;

numkilometros:=numkilometros+d[i];

UNTIL (numkilometros>n) OR (i=G-1);

SI numkilometros>n

ENTONCES (*si nos hemospasado... *)

Inicio

i--; (* volvemos atras una gasolinera *)

sol[i]:=TRUE; (* y repostamos en ella. *)

numkilometros:=0; (* reset contador *)

Fin

UNTIL (i=G-1);

EL FONTANERO DILIGENTE

Un fontanero necesita hacer n reparaciones urgentes, y sabe de

antemano el tiempo que le va a llevar cada una de ellas: en la

tarea i-ésima tardará ti minutos. Como en su empresa le pagan

dependiendo de la satisfacción del cliente, necesita decidir el

orden en el que atenderá los avisos para minimizar el tiempo

medio de espera de los clientes. En otras palabras, si llamamos

Ei a lo que espera el cliente i-ésimo hasta ver reparada su

avería por completo, necesita minimizar la expresión:

Deseamos diseñar un algoritmo ávido que resuelva el problema y

probar su validez.

EL FONTANERO DILIGENTE

En primer lugar hemos de observar que el fontanero siempre

tardará el mismo tiempo global T = t1 + t2 + ... + tn en realizar

todas las reparaciones, independientemente de la forma en que

las ordene. Sin embargo, los tiempos de espera de los clientes

sí dependen de esta ordenación.

En efecto, si mantiene la ordenación original de las tareas (1, 2, ...,

n), la expresión de los tiempos de espera de los clientes viene

dada por:

E1 = t1

E2 = t1 + t2

.....

En = t1 + t2 + ... + tn .

Lo que queremos encontrar es una permutación de las tareas en

donde se minimice la expresión de E(n)

Anuncio

Documentos relacionados

Descargar

Anuncio

Añadir este documento a la recogida (s)

Puede agregar este documento a su colección de estudio (s)

Iniciar sesión Disponible sólo para usuarios autorizadosAñadir a este documento guardado

Puede agregar este documento a su lista guardada

Iniciar sesión Disponible sólo para usuarios autorizados