∑ s + ui k

Anuncio

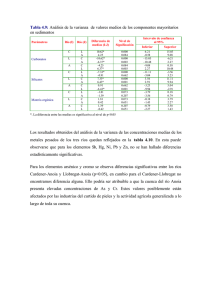

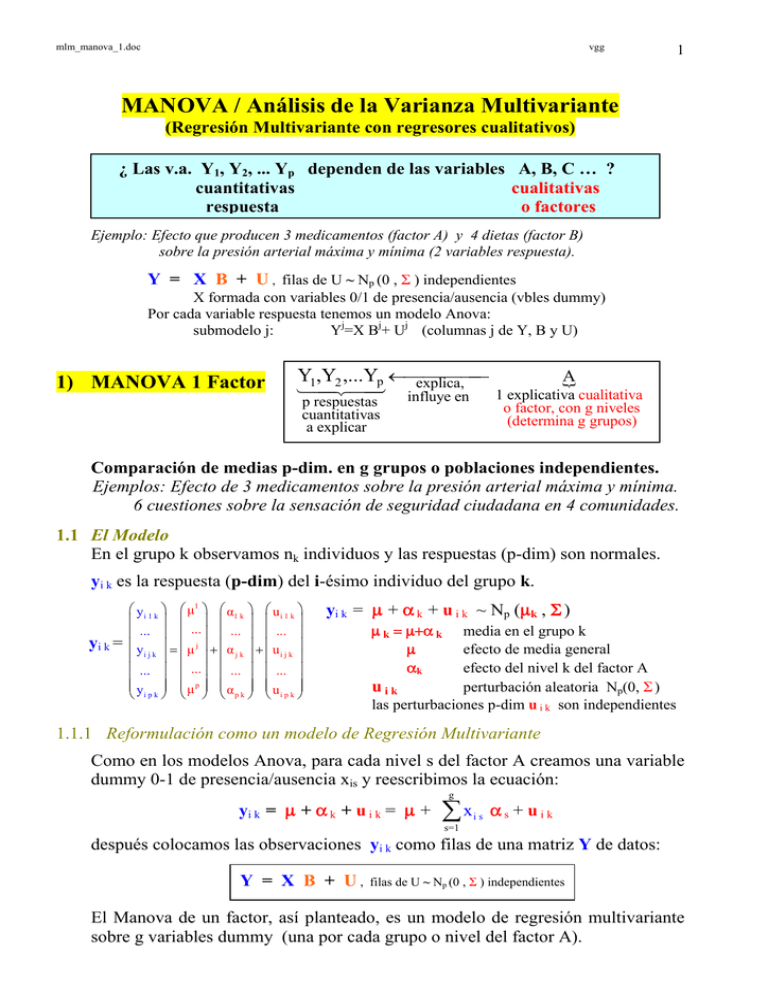

mlm_manova_1.doc vgg 1 MANOVA / Análisis de la Varianza Multivariante (Regresión Multivariante con regresores cualitativos) ¿ Las v.a. Y1, Y2, ... Yp dependen de las variables A, B, C … ? cuantitativas cualitativas respuesta o factores Ejemplo: Efecto que producen 3 medicamentos (factor A) y 4 dietas (factor B) sobre la presión arterial máxima y mínima (2 variables respuesta). Y = XB + U , filas de U ~ Np (0 , ) independientes X formada con variables 0/1 de presencia/ausencia (vbles dummy) Por cada variable respuesta tenemos un modelo Anova: submodelo j: Yj=X Bj+ Uj (columnas j de Y, B y U) 1) MANOVA 1 Factor Y ,Y ,...Y explica, 1 2 p p respuestas cuantitativas a explicar influye en A 1 explicativa cualitativa o factor, con g niveles (determina g grupos) Comparación de medias p-dim. en g grupos o poblaciones independientes. Ejemplos: Efecto de 3 medicamentos sobre la presión arterial máxima y mínima. 6 cuestiones sobre la sensación de seguridad ciudadana en 4 comunidades. 1.1 El Modelo En el grupo k observamos nk individuos y las respuestas (p-dim) son normales. yi k es la respuesta (p-dim) del i-ésimo individuo del grupo k. yi k = yi 1 k μ1 α1 k u i 1 k ... ... ... ... y μj α u ijk jk ijk ... ... ... ... p yi p k μ α p k u i p k yi k = +k+u i k ~ Np (k , ) k k k media en el grupo k efecto de media general efecto del nivel k del factor A uik perturbación aleatoria Np(0,) las perturbaciones p-dim u i k son independientes 1.1.1 Reformulación como un modelo de Regresión Multivariante Como en los modelos Anova, para cada nivel s del factor A creamos una variable dummy 0-1 de presencia/ausencia xis y reescribimos la ecuación: yi k = +k+u i k = + g x is s +u i k s=1 después colocamos las observaciones yi k como filas de una matriz Y de datos: Y = XB + U , filas de U ~ Np (0 , ) independientes El Manova de un factor, así planteado, es un modelo de regresión multivariante sobre g variables dummy (una por cada grupo o nivel del factor A). mlm_manova_1.doc vgg 2 1.1.2 Diferencias con Anova: X no cambia, pero Y, U ahora son matrices en lugar de vectores: X matriz de diseño, es la misma que en el Anova de un factor: n= n 1+…+ n g filas del tipo (1 | 0 … 1 … 0 ) B matriz de parámetros U matriz de perturbaciones; n filas Np (0, ) independientes Y matriz de observaciones elemento yijk n filas con las respuestas p-dim de cada individuo (yi k) p columnas y j (una por cada variable dependiente) El Manova de un factor yuxtapone p modelos Anova, uno por cada variable Y. El submodelo j se forma con las columnas j-ésimas de Y, B y U: y j = Xj + u j , j=1…p Estos p submodelos están relacionados: Las filas de U son independientes entre sí (corresponden a observaciones de individuos no relacionados), pero las p perturbaciones de un individuo (una fila de U) están correladas. Toda inferencia sobre parámetros de 2 o más submodelos entremezclados deberá tenerlo en cuenta. 1.1.3 Resumen de los requisitos del modelo Igual que en Anova, habrá que contrastar los supuestos del modelo: Normalidad e Independencia de las perturbaciones analizaremos el esquema de muestreo y los residuos. Homocedasticidad (igualdad de las matrices de dispersión en los grupos) En 1.4 veremos cómo contrastar Ho: 1=2==g. 1.2 Estimación y contrastes. Descomposición de la variabilidad. 1.2.1 Estimación Como en el modelo Anova, la matriz de diseño X contiene filas de g tipos (uno por cada nivel del factor A). Entonces, la matriz de medias XB sólo contiene filas de g tipos, que son las medias k de los g grupos. Estimar XB se reduce por tanto a estimar la media k de cada grupo. Aplicamos al Manova de un factor la expresión general = P [X] Y =X(XtX)¯ Xt Y para estimar XB en el modelo lineal multivariante: XB y resulta μ̂ k = y + k (p-dim.) mlm_manova_1.doc vgg 3 1.2.2 Descomposición de la variabilidad (matrices de dispersión) La variabilidad se descompone como en un ANOVA, pero ahora con matrices SSPC: Total (T)= Inter clases (H) + Intra clases (E) T= H + E Las matrices SSPC de sumas de cuadrados T, H y E siguen distribuciones Wishart: y+k = Sk= y= 1 nk nk 1 nk 1 1 n g yik media en el grupo k. (vector p-dim.) i=1 nk i=1 nk (yik - y+k )(yik - y+k )t yik matriz de covarianzas en el grupo k. media global de la muestra completa. k 1 i=1 Matriz T SSCP Total corregida: variabilidad total. nk g T= (yik - y )(yik - y )t Wp(n-1, ) k 1 i=1 S 1 T n 1 es el habitual estimador insesgado de cuando 1= 2= …= g utiliza las desviaciones de cada observación yik al centro global y . Matriz H SSCP Inter (Betwin, Among o de la Hipótesis): variabilidad entre grupos (variabilidad explicada por el factor A) g nk H= ( y +k - y )( y +k - y )t = k 1 i=1 g n k 1 k ( y +k - y )( y +k - y )t Wp(g-1, ) utiliza las desviaciones de cada media de grupo, y +k , a la media global y . Matriz E SSCP Intra (Within): variabilidad dentro de los grupos (variabilidad no explicada o error) g nk E = (yik - y+k )(yik - y+k )t = (n1-1)S1 +…+(ng-1)Sg= (n-g) S Wp(n-g, ) k 1 i=1 1 E es un estimador insesgado de bajo H ng utiliza las desviaciones de cada observación yik al centro de su grupo y +k en lugar de a y . La matriz de covarianzas “pooled” S 1.2.3 Contraste básico de no efecto del factor A: Las g medias (p-dim) son iguales. H0: 1= 2= …= g Aplicamos al Manova de un factor la teoría general de contrastes en un modelo lineal y se obtienen los habituales cuatro contrastes de Wilks, Lawley-H, Pillai y Roy Test 1: Basado en el estadístico de Wilks (TRV): = |E| (Eo= T= E+H) |EH| es una de Wilks de parámetros [p, g-1, n-g]: (p = nº de Y’s, g-1 =g.del. de H, n-g= g.de l. de E) aproximación F de Rao (ley asintótica bajo H0: y exacta para p=1,2 y para g=2) mlm_manova_1.doc vgg m 2 (1 1/ ) ~ Fm1, m2 , m11/ 4 p 2 (g 1) 2 4 m1= p(g-1) p 2 (g 1) 2 5 Y m2= [n-(p+g+2)/2]- p (g 1) /2+ 1 donde = aproximación asintótica 2; – [n-1-(p+g)/2] ln ~ 2p(g-1) Otros tets: Lawley-Hotelling, traza de Pillai y mayor valor propio de Roy. *a* Ejemplo datos de seguridad en cuatro comunidades: Aproximación de Rao F=6.24; distribución F18, 257.9; p-valor 0.0001 Rechazo H0. Las medias de las seis variables difieren de un grupo a otro. Dos niveles: Si g=2, el contraste coincide con el test T2 para H0: 1= 2, (1=2). En este sentido, el Manova de un factor generaliza la comparación de medias a más de dos poblaciones independientes con covarianzas iguales. 1.2.4 Fuerza de la asociación lineal: En Regresión múltiple y Anova se utiliza el coeficiente de determinación R2, que mide la proporción de variabilidad en la respuesta explicada por los regresores. SSR SSE SSWithin =1– R2= = 1– prop. explicada ANOVA SST SST SST Extensión a MANOVA SSW 'generalizado' |E| = 1– prop. explicada MANOVA 1– = 1– |EH| SST 'generalizado' Se utilizan otras alternativas menos sesgadas: 2 = 1- p2 (g 1) 2 y 2c = 2 (1-2) 3n ng Ejemplo datos seguridad: 1- = 0.6403; 2 = 0.6267; 2c= 0.5707 Conclusión: En torno al 60% de la variabilidad total entre observaciones es explicada por las diferencias de medias entre los cuatro grupos que define el factor A. 1.2.5 Comparaciones múltiples (localización de las diferencias). Igual que hacíamos en un ANOVA, cuando se rechaza H0: 1= 2= …= g pasamos a localizar las diferencias. Paso 1: Detección de grupos con medias significativamente diferentes. Comparamos 2 a 2 las medias p-dim de todos los grupos. Aplico test T2 de g Hotelling en cada una de las comparaciones posibles (utilizando Bonferroni): 2 (y r y s ) t S 1 (y r y s ) n r ns nr nr ns p 1 ns n r ns 2 ~ F α , p, n * r ns p 1 S (n r 1)Sr (n s 1)Ss nr ns 2 con α * = α 2 g(g-1) mlm_manova_1.doc vgg 5 Paso 2: Para dos grupos de medias diferentes, busco variables diferenciadoras. Tras detectar que los grupos r y s tienen medias significativamente diferentes, nos planteamos ¿en qué variables difieren? Para cada variable j empleamos las comparaciones múltiples de un ANOVA univariante, que decide si la media de esta variable Yj varía significativamente del grupo r al s. t-intervalos de Bonferroni: (x jr x js ) t t ** sjj2 ( 1 ns donde **= */p y sjj2 = elemento jj de 1 ns ) (n1 1)S1 ... (n g 1)Sg n g Comparaciones múltiples de Tukey. 1.3 Análisis Discriminante. Cuando el Manova de un factor detecta que los valores medios de las variables respuesta difieren entre grupos, podemos realizar un Análisis Discriminante (AD) para detectar las variables que más cambian a través de los grupos, caracterizar los grupos y construir nuevas variables artificiales que recojan las diferencias entre ellos. El AD también se emplea para asignar un nuevo individuo a uno de estos grupos (diagnóstico automático, reconocimiento de formas…). Lo estudiaremos más adelante. 1.4 Validación del modelo mediante análisis de los resíduos Normalidad e independencia de las observaciones (como en Regresión Multivariante) xi k ~ Np (k , k) independientes Homocedasticidad: igualdad de las matrices de covarianzas a través de los g grupos: H0: 1= 2= …= g g Estadístico M: M= | Sk | k 1 |S| n k 1 2 n g 2 Distribución de M: aproximación 1 aproximación 2 donde S 1 (n k 1)Sk n g k -2(1-c1) ln M ~ 2p(p+1)(g-1)/2 -2b log M ~ F1 2 (ver en Jobson p. 221 los valores de las constantes c1, b, 1 y 2) aproximación 3 -2f -1 m ln M ~ 2p(p+1)/2 (ver en Srivastava p. 490 los valores de las constantes) Ejemplo datos seguridad: 2 test= 259.38 ~ 263 p-valor=0.0001 Rechazo H0: sigmas iguales (causa del rechazo: 1 y 3 son mucho mayores que 2 y 4 ) a) Proc Discrim de SAS ofrece la opción pool=test proc discrim data=safety method=normal pool=test ; class com; var x1--x6; run; mlm_manova_1.doc vgg 6 b) Programa realizado con SAS/IML: proc iml; reset noprint; /*******************************************************************/ / A Test for Equality of Covariances (Sriva p.489-491) / / Ho: sigma1=...=sigmak / / routina SIGMAS_IGUALES(X); / / ================== / / columna 1 de X : indicador del grupo con valores 1, 2 ...k / / columnas 2, 3 ... p+1: las p variables observadas; / /*******************************************************************/ /* funcion auxiliar SAS/IML ORDENAMAT(X,j) / / ============== / / Ordena las filas de una matriz X / / en sentido creciente de la columna j / /*******************************************************************/ start ORDENAMAT(X,j); *chequeo: existe columna j?; if j<1 | j>ncol(x) then do; print 'la columna ' j ' no existe'; abort; end; xcopy=x; x[rank(x[,j]),]=xcopy; return(x); finish; start SIGMAS_IGUALES(X); /********************************************************* Calculos para contrastar la igualdad de sigmas: =============================================== * reordeno X por grupos (col1) */ X=ordenamat(X,1); *print X ; * calculo n, p, k, f, ni, nicum, f, fi, ri p variables k grupos n total de individuos= n1+...+nk ni individuos en cada grupo nicum sumas acumuladas de ni fi ni-1 f n-k=f1+...+fk ri fi/f ; n=nrow(x); p=ncol(x)-1; k=x[n,1]; f=n-k; ni=repeat(0,k); do i=1 to n; ni[x[i,1]]=ni[x[i,1]]+1; end; fi=ni-1; ri=fi/f; nicum=cusum(ni); print n p k f, ni nicum fi ri ; *elimino de X la columna 1, (indicadora de grupo); X=X[,2:(p+1)]; *bucle sobre los grupos. En cada grupo i, computo Si, acumulo las Qi en Q, aniado factor a lambda (L), inicializo Q y L antes de entrar; Q=repeat(0,p,p); logL=0; do i=1 to k; **selecciono los datos del grupo i, ni individuos, p variables: Xi *ini es el primer individuo del grupo i; if i=1 then ini=1; else ini=nicum[i-1]+1; Xi=X[ini:(nicum[i]),]; **claculo medias ximed y cuasi-covarianzas Si del grupo i; ximed=Xi[:,]`; Qi=Xi`*Xi-ni[i]*ximed*ximed`; Q=Q+Qi; Si=Qi/(ni[i]-1); print i 'S' (round(Si,0.01)); **computo un nuevo factor del estadistico lambda (L) y un nuevo sumando de S; logL=logL+(fi[i]/2)*log(det(Si)); end; S=Q/f; ' global S'(round(S,0.01)); *computo el valor final del estadistico log-lambda modificado; logL=logL-(f/2)*log(det(S)); * lo transformo: -2m*log(L)/f sigue ley asintotica chi-cuadrado g (aproximación 3); g=p*(p+1)/2; alfa=sum(1/ri)-1; alfa=alfa*(2*p**2+3*p-1)/(12*(p+1)*(k-1)); m=f-2*alfa; Chi0=-2*m*logL/f; * rechazamos la igualdad de sigmas cuando Chi0 es grande **calculo el p-valor que corresponde a Chi0 en una chi-2 con g g.l. ; p_valor=1-probchi(Chi0,g); **escribo las salidas y decision; print Chi0 p_valor;; if p_valor<0.001 then print '---> rechazo Ho:Sigma1=...=Sigmak (a todos los niveles habituales)'; else if p_valor>0.05 then print '---> NO rechazo Ho:Sigma1=...=Sigmak (a ninguno de los niveles habituales)'; else print '---> rechazo Ho:Sigma1=...=Sigmak a niveles menores que ' p_valor; finish; print mlm_manova_1.doc vgg 7 1.5 Estudio de las medias: Análisis de Perfiles/ Medidas repetidas. Perfil de un grupo k: medias de las p variables dentro del grupo k. Como caso particular, las p variables respuesta de un Manova pueden ser Medidas Repetidas, es decir, observaciones de una misma variable sobre la misma unidad experimental en p condiciones diferentes: Medidas en p días consecutivos, o a p diferentes horas del día o bajo p diferentes tratamientos (factor de repetición) … Sean medidas repetidas o no, en Manova comparamos los perfiles de los grupos. 20 perfil del grupo 1 18 20 grupo 1 grupo 2 grupo 3 16 18 14 16 12 14 10 12 8 10 8 V1 V2 V3 V4 V1 V2 V3 V4 A la vista del gráfico de perfiles, sospechamos que en este caso un Manova va a rechazar la hipótesis de no efecto e ideamos nuevas hipótesis para contrastar. Por ej.: Los perfiles del grupo 1 y 2 son iguales. V2 es la variable causante del rechazo, pues en el grupo 3 toma valores mucho menores que en los otros. Las medias de V3 y V4 son iguales dentro de cada grupo… etc. En todos los grupos las condiciones producen efectos significativos. Tres contrastes de interés al analizar perfiles: a) g perfiles iguales: Ho: 1=2=…=g no hay efecto de grupo (o factor A) Es la hipótesis básica de no efecto en MANOVA Si se rechaza a) Ho, aún podrían darse b) c) o d) b) g perfiles paralelos: HoP: 1║2║…║g no hay efecto de interacción condiciones*grupo. HoP: ij la diferencia i–j es constante sobre las p condiciones (o vbles respuesta) HoP: ij i–j tiene las componentes iguales 20 grupo 1 18 16 grupo 2 14 12 grupo 3 10 8 V1 V2 V3 V4 20 18 16 14 12 10 8 grupo 1 grupo 2 grupo 3 V1 V2 V3 V4 c) perfiles con la misma media general: HoM : 1+ = 2+ =…= g+ d) g perfiles horizontales: no hay efecto de las condiciones (vbls. respuesta) HoH: i, i es constante sobre las p condiciones (o vbles respuesta) HoH: i, i tiene las componentes iguales 20 grupo 1 18 16 grupo 2 14 12 grupo 3 10 8 V1 V2 V3 V4 mlm_manova_1.doc vgg 8 Contraste a) Perfiles iguales. Es la hipótesis básica de no efecto del factor en Manova. Contraste b) Perfiles paralelos (las condiciones no interaccionan con los grupos) HoP : 1║2║…║g HoP: ij la diferencia i–j es constante sobre las p condiciones (o vbles respuesta) HoP: i=2…g la diferencia 1–i es constante sobre las p condiciones μ1t 1 1 0 ... 0 t μ 2 1 0 1 ... 0 Las g medias son B; ... ... μ t 1 0 0 ... 1 g μ1t 1 1 0 ... 0 t 1 0 1 ... 0 μ2 t t 1 –2 = 1 -1 0 ... 0 = 1 -1 0 ... 0 B = 0 1 -1 0 ... 0 B ... ... μt 1 0 0 ... 1 g 1–2 es constante sobre las p condiciones 1 1 1 ... 1 1 1 1 ... 1 -1 0 0 ... 0 -1 0 0 ... 0 (μ1t -μ 2t ) 0 -1 0 ... 0 O 0 1 -1 0 ... 0 B 0 -1 0 ... 0 O ... ... 0 0 0 ... -1 0 0 0 ... -1 Análogamente las otras diferencias 1–i, y así queda finalmente: 1 1 0 1 -1 0 ... 0 0 1 0 -1 ... 0 -1 0 B 0 -1 HoP: ... 0 1 0 0 ... -1 0 0 1 ... 1 0 ... 0 0 ... 0 O que ya es de la forma general ABM=O ... 0 ... -1 Ejemplo de Seguridad: *b* HoP : F=5.334 ~ F15, 254.5 p-valor: 0.0001 Rechazo paralelismo. Existe interacción entre las respuestas y la comunidad 5 4 grupo 1 grupo 2 3 grupo 3 grupo 4 2 1 Xl X2 X3 X4 X5 X6 La figura de los perfiles sugiere que 1=3 y 2=4 Los niveles de inseguridad parecen más altos en las comunidades 1 y 3. mlm_manova_1.doc vgg 9 Contraste c) Suma de las p medias en el grupo, constante a través de los grupos. Cuando dos perfiles son paralelos, serán iguales si la suma de las p medias en el grupo (1tk) no depende del grupo: 1t1 = 1t2 =…= 1tg es decir, HoM : 1+ = 2+ =…= g+ (Nota: Si HoP no es cierta, entonces HoM tiene escaso valor, pues en ese caso sólo indicaría que el promedio de las p medias es el mismo en todos los perfiles) HoM se puede expresar también en la forma general ABM=O : HoM : 1 -1 0 ... 0 μ1+ 1 0 -1 ... 0 μ 2+ O , o bien ... ... 1 0 0 ... -1 μ g+ t 1 -1 0 ... 0 μ1 1 0 -1 ... 0 μ t 2 ... ... t 1 0 0 ... -1 μ g 1 1 = O ... 1 1 -1 0 ... 0 1 1 0 ... 0 1 1 0 -1 ... 0 1 0 1 ... 0 1 B = O en definitiva, HoM : ... ... ... 1 0 0 ... -1 1 0 0 ... 1 1 es decir, 0 1 -1 0 ... 0 0 1 0 -1 ... 0 B ... 0 1 0 0 ... -1 1 1 = O ... 1 Contraste d) Perfiles horizontales (no efecto de las condiciones): HoH: j Si los perfiles son paralelos –no interacción- (HoP no se rechaza), podrían además ser horizontales –no efecto de las condicionesEn todo caso, sin necesidad de contrastar el paralelismo previamente, podemos contrastar la horizontalidad de los perfiles directamente: HoH para cada k, la hipótesis de que k tiene las componentes todas iguales se escribe: 1 1 -1 0 μ kt 0 -1 0 0 1 ... 1 μ1t 0 ... 0 t μ 0 ... 0 = (0 0 ... 0) … y esto k=1..g : 2 ... ... μt g 0 ... -1 1 1 1 ... 1 1 1 0 ... 0 1 0 1 ... 0 -1 0 0 ... 0 B 0 -1 0 ... 0 = O En definitiva, HoH : ... ... 1 0 0 ... 1 0 0 0 ... -1 1 1 -1 0 0 -1 0 0 1 ... 1 0 ... 0 0 ... 0 = (0 0 ... 0) ... 0 ... -1 1.6 Ejemplo de Seguridad *d* F=9.27 ~ F20, 306 ; p-valor< 0.0001 rechazo *c* Habíamos rechazado ya el paralelismo de los perfiles (*b*), luego no tiene sentido contrastar la horizontalidad (pues horizontalidad paralelismo). En cualquier caso, si contrastamos HoM se obtiene: F=31.392 ~ F3,96 p-valor: 0.0001 Rechazo que en los g grupos la sensación global de inseguridad sea la misma. (Nota final: Los perfiles están dibujados con Excel. Puede hacerse con Statistica > Anova) mlm_manova_1.doc vgg 2) Manova 2 Factores Y ,Y ,...Y explican, 1 2 p influyen en p respuestas cuantitativas a explicar 10 A B 2 explicativas cualitativas o factores, con a y b niveles (determinan ab celdas) Ejemplos: Efecto de 4 medicamentos (A) y 3 dietas (B) sobre la presión arterial máx. y mín. 6 cuestiones sobre la sensación de seguridad en 4 comunidades y 5 niveles educativos. 2.1 El Modelo El cruce de a niveles del factor A y b del B da lugar a ab celdas. Observamos nkl individuos en la celda kl y las respuestas son normales. El modelo se denomina balanceado cuando los nkl son todos iguales El vector de medias en la celda kl se obtiene como suma de varios efectos: kl k +l () kl media en el grupo k efecto de media general k efecto del nivel k del factor A l efecto del nivel l del factor B () k l efecto de interacción entre los niveles k de A y l de B La perturbación aleatoria (p-dim) u i k l ~ Np(0,) reune las fuentes de variabilidad no contempladas por el modelo perturbaciones de observaciones diferentes, independientes. La respuesta (p-dim) del individuo i de la celda kl: yi k l = kl u i k l +k+l + () k lu i kl ~ Np (kl , ) yi 1 k l μ1 α1 k β1 l (αβ)1 k l u i 1 k l ... ... ... ... ... ... yijkl = yi j k l μ j α j k β j l (αβ) j k l u i j k l ... ... ... ... ... ... p yi p k l μ α p k β p l (αβ) p k l u i p k l 2.1.1 Reformulación como un modelo de Regresión Multivariante Igual que hacíamos en los modelos Anova, con ayuda de variables dummy x de presencia/ausencia para cada nivel y cada interacción escribimos a b a yi k l = +k +l +() k lu i kl = + x i s αs + x i r β r + s=1 A r =1 B s =1 b x r =1 AB i sr (α )sr u i kl y colocamos las observaciones yi k como filas de una matriz Y de datos: Y = XB + U , filas de U ~ Np (0 , ) independientes El Manova de dos factores queda así planteado como un modelo de regresión multivariante sobre variables dummy (una por cada nivel de cada factor e interacción). mlm_manova_1.doc vgg 11 2.2 Estimación y contrastes. Descomposición de la variabilidad. 2.2.1Estimación Igual que en el modelo Anova de dos factores, la matriz de diseño X contiene filas de ab tipos (uno por cada celda). Entonces, la matriz de medias XB sólo contiene filas de ab tipos: las medias kl de las ab celdas. Estimar XB se reduce por tanto a estimar la media ks de cada celda. Al plicar al Manova de dos factores con interacción =X(XtX)¯ Xt Y para estimar XB en el modelo lineal la expresión general XB multivariante resulta: μ k l = y + k l . (p-dim.) 2.2.2 Descomposición de la variabilidad (matrices de dispersión) La variabilidad se descompone como en un Anova de dos factores, sólo que en Manova debemos manejar matrices de sumas de cuadrados. Para un modelo balanceado con c réplicas por celda se tiene: Total (T)= factor A (A)+factor B (B) + interacción AB (W) + intra o error (E) T= A + B + W + E Las matrices de sumas de cuadrados T, B, W y E siguen distribuciones Wishart: Matriz SS Total: variabilidad total. b n kl c a T = (yikl - y )(yikl - y )t Wp(n-1, ) k 1 l=1 i =1 utiliza las desviaciones de cada observación yikl al centro global y . Matriz SS A: variabilidad explicada por el factor A. a A = bc ( y +k+ - y )( y +k+ - y )t Wp(a-1, ) k 1 utiliza las desv. de las medias y +k+ de cada nivel de A al centro global y . Matriz SS B: variabilidad explicada por el factor B. b B = ac ( y ++ l - y )( y ++l - y )t Wp(b-1, ) l 1 utiliza las desv. de las medias y ++ l de cada nivel de B al centro global y . Matriz SS W: variabilidad explicada por la interacción de los factores A y B. W= a b c ( y + k l - y )( y + k l - y )t Wp((a-1)(b-1), ) k 1 l=1 utiliza las desv. de cada observación yikl al centro de su celda y kl. Matriz SS E: variabilidad no explicada o error. E= a b n kl c (yikl - y kl)(yikl - y kl)t Wp(ab(c-1), ) k 1 l=1 i =1 utiliza las desv. de cada observación yikl al centro de su celda y kl. mlm_manova_1.doc vgg 12 2.2.3 Contrastes básicos de no efecto de los factores y la interacción Aplicamos al Manova de dos factores la teoría general de contrastes en un modelo lineal multivariante y se obtienen los habituales cuatro contrastes de Wilks, LawleyH, Pillai y Roy. Los estadísticos para los tests de Wilks (TRV) se expresan a partir de las anteriores matrices SS (tipo I secuenciales, II jerárquicos, III y IV ortogonales) : Estadístico Hipótesis |E| |EA| |E| B = |E B| |E| AB = |EW| A = No efecto factor A No efecto factor B No efecto interacción A B 2.2.4 Ejemplo de Seguridad Incorporamos un segundo factor explicativo con 5 niveles: EDCAT (Educación) El cruce COMUNIDAD*EDCAT da lugar a 20 celdas. El diseño es balanceado con 4 observaciones 6-dimensionales por celda. Medias en las celdas: Factores Medias en las celdas COMUNIDAD EDCAT X1 X2 X3 X4 X5 X6 1 1 2 3 4 5 4.6 3.2 3.2 2.0 2.2 3.8 2.2 2.0 2.0 1.2 2.6 2.2 2.0 1.8 1.2 5.4 4.6 4.0 3.2 1.6 2.6 2.4 2 2.4 1.2 5.8 4.8 4.8 4.2 3.0 2 1 2 3 4 5 2.0 1.8 1.6 1.2 1.0 1.6 2.0 1.4 1.0 1.0 1.6 1.2 1.0 1.0 1.0 3.6 2.0 1.6 1.4 1.0 1.6 1.0 1.0 1.0 1.0 2.8 2.0 1.8 1.4 1.0 3 1 2 3 4 5 4.0 3.0 3.4 2.4 1.2 3.0 2.4 2.0 1.2 1.0 3.2 2.0 1.6 1.0 1.2 5.0 3.8 2.8 2. 1.4 3.8 2.2 2.0 1.6 1.0 5.2 5.2 4.8 3.8 1.8 4 1 2 3 4 5 2.4 2.0 1.0 1.0 1.0 1.6 1.4 1.0 1.0 1.0 1.6 1.0 1.0 1.0 1.0 3.0 1.6 1.0 1.0 1.0 1.2 1.0 1.0 1.0 1.0 3.0 2.0 1.2 1.0 1.0 mlm_manova_1.doc vgg 13 En los 6 Anovas (uno por cada variable dependiente) todos los efectos son significativos en todas las variables, salvo acaso la interacción de los dos factores para X1 (p-valor 0.037)) X1 Fuente de variación Comunidad Educación Interacción Error Total SS F 51.15 44.54 12.10 40.80 148.59 33.43 21.83 1.98 X2 pvalor 0.000 0.000 0.037 SS F 16.99 26.44 10.76 29.20 83.39 15.52 18.11 2.46 X4 Fuente de variación Comunidad Educación Interacción Error Total SS F 85.16 88.90 16.94 30.00 221.00 75.70 59.27 3.76 X3 pvalor 0.000 0.000 0.009 SS 14.03 16.64 6.72 17.60 54.99 X5 pvalor 0.000 0.000 0.000 SS 21.26 18.91 2.55 pvalor 0.000 0.000 0.007 X6 F 27.12 16.30 13.38 21.20 78.00 F 34.11 15.38 4.21 pvalor 0.000 0.000 0.000 SS F 173.55 71.16 15.40 40.80 300.91 113.43 34.88 2.52 pvalor 0.000 0.000 0.007 En el Manova resultan también significativos los dos factores y su interacción. MANOVA Fuente de variación Comunidad Educación Interacción 0.0728 0.0889 0.1620 F 18.02 10.96 2.28 p-valor 0.000… 0.000… 0.000… Perfiles de la sensación de inseguridad según el nivel de educación 4 edcat 1 edcat 2 edcat 3 edcat 4 edcat 5 3 2 1 Xl X2 X3 X4 X5 X6 La sensación de inseguridad disminuye cuando aumenta el nivel de educación. Para cada variable se observa esta asociación negativa entre educación e inseguridad, especialmente en las comunidades 1 y 3, donde es mayor la pendiente decreciente al aumentar el nivel de educación. Esta diferencia de pendiente de unos mlm_manova_1.doc vgg 14 grupos a otros debe de ser la causa de que la interacción entre comunidad y educación resulte significativa en el modelo. (Ver los gráficos) 2.2.5 Otros modelos Lo mismo que en Anova, en Manova también se utilizan modelos no balanceados, modelos con varios factores (sin interacciones, anidamientos…), factores aleatorios… También pueden incorporarse covariables (variables explicativas cuantitativas), dando lugar a modelos llamados Mancova. Éstos son la versión multivariante (variable dependiente p-dimensional) de los Ancova. 2.2.5 Factores Intra sujeto Trabajando con medidas repetidas, podemos encontrar el caso de que cada sujeto sea observado (en una o varias características) bajo diferentes niveles de un factor. Diremos entonces que se trata de un factor “Intra sujeto”, dado que sus diferentes niveles se observan dentro de cada una de las unidades experimentales disponibles, dando lugar a esta estructura de medidas repetidas. La estructura de medidas repetidas puede complicarse con la presencia de dos o más factores Intra. Contrastaremos las hipótesis básicas de no efecto de cada factor Intra y las interacciones entre ellos. Cada hipótesis se puede traducir en condiciones sobre la matriz de medias Z y su correspondiente forma genérica ABM=O. Cuando los factores Inter van acompañados de otros de tipo Intra, surge también la opción de valorar interacciones de tipo Inter*Intra. Programa SAS: Manova Proc GLM Dibujar los perfiles en SAS.