Curso en pdf

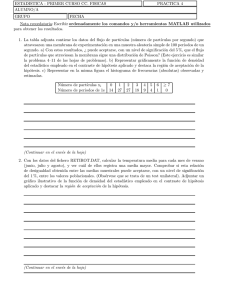

Anuncio

Aprendizaje Computacional

Eduardo Morales y Jesús González

Objetivo General

La capacidad de aprender se considera como una de los atributos distintivos del ser humano y ha sido una de las principales áreas de investigación

de la Inteligencia Artificial desde sus inicios. En los últimos años se ha visto

un crecimiento acelerado en la capacidad de generación y almacenamiento de

información, debido a la creciente automatización de procesos y los avances

en las capacidades de almacenamiento de información. En gran parte debido

a esto, se han desarrollado una gran cantidad de herramientas y técnicas que

tienen que ver con el análisis de información. En este aspecto, el desarrollo en

el área de aprendizaje ha sido fundamental. El área de aprendizaje en general

trata de construir programas que mejoren su desempeño automáticamente

con la experiencia.

Los objetivos del curso son: dar un panoráma general de lo que es aprendizaje computacional y conocer a detalle las técnicas más importantes empleadas.

Temario

Los temas que se van a ver en clase son:

1. Introducción a aprendizaje computacional

2. Técnicas principales:

• Árboles de decisión y regresión

• Reglas de clasificación

• Reglas de asociación

• Programación lógica inductiva

• Aprendizaje basado en grafos

• Aprendizaje bayesiano y Redes bayesianas

• Aprendizaje basado en instancias y casos

• Clustering

i

• Aprendizaje por refuerzo

3. Evaluación de algoritmos (intercalado con las técnicas)

4. Conclusiones

Existen muchos otros temas de aprendizaje. Algunos de estos se ven en

el segundo curso de aprendizaje (ver página) como:

• Aprendizaje basado en Kernels y Support Vector Machines

• Ensambles de clasificadores

• Selección de atributos

• Aprendizaje semi-supervisado

Otros temas se cubren en otros cursos:

• Algoritmos genéticos

• Redes neuronales

Existen temas que se pueden incluir en el segundo curso de aprendizaje

como son:

• Colonias de hormigas (ant colony optimization o ACO) y de enjambres

(particle swarm optimization o PSO)

• Modelos lineales de regresión, Bayesianos.

• Modelos lineales para clasificación (funciones discriminantes, modelos

generativos, modelos discriminativos, regresión logı́stica)

• Modelos basados en muestreo

• Procesos Gaussianos

• Análisis de componentes principales

ii

• Modelos para secuencias

Evaluación

La evaluación del curso se hará en base a dos examenes y un proyecto

final (cada uno contando 1/3 parte de la calificación final).

Lista de posibles Proyectos:

La siguiente es una lista tentativa (no exhaustiva) de posibles proyectos

del curso.

• Analizar como afecta el ruido a las técnicas de muestreo (sobre y submuestreo).

• Algoritmo de selección de atributos favoreciendo la clase minoritaria

• Aprendizaje por refuerzo distribuido

• Aprendizaje de acciones continuas (en un simulador de vuelo o en

robótica móvil)

• Aprendizaje de reglas por imitación (aplicado a ajedrez o simulador de

vuelo o robot móvil)

• Aprendizaje semi-supervisado (evaluar asignación de pesos diferentes a

las instancias no clasificadas).

• Crear nuevos atributos (constructive induction)

• Reimplementar algún algoritmo reciente de las técnicas vistas en clase

con alguna mejora.

• Aprendizaje jerárquico multiclase

• Aprendizaje en secuencias

iii

Referencias

1. T. Mitchell (1997) Machine Learning, McGraw–Hill.

2. I.H. Witten, E. Frank (2005) Data Mining: practical machine learning tools and techniques 2nd. Edition. Morgan Kaufmann

3. J. Han, M. Kamber (2001) Data Mining: concepts and techniques,

Morgan Kaufmann.

4. D. Hand, H. Mannila, P. Smyth (2001). Principales of Data Mining,

MIT Press

5. R. Michalski, I. Bratko, M. Kubat (1998) Machine Learning and

data mining: methods and applications, John Wiley and Sons.

6. B. Schölfopf, A. Smola (2002). Learning with Kernels: Suport Vector Machines, Regularizartion, Optimization, and Beyond, MIT

Press.

7. R. Sutton, A. Barto (1998). Reinforcement Learning: An Introduction. MIT Press.

8. N. Lavrac, S. Džeroski (1994). Inductive Logic Programming: Techniques and Applications. Ellis Horwood.

9. T. Hastie, R. Tibshirani, J. Friedman (2001). The Elements of

Statistical Learning: Data Mining, Inference, and Prediction.

Springer-Verlag.

10. C. Bishop (2006). Pattern Recognition and Machine Learning.

Springer.

iv

Capı́tulo 1

Aprendizaje

Posiblemente la caracterı́stica más distintiva de la inteligencia humana es el

aprendizaje. Desde el comienzo de las computadoras se cuestionó si serı́an

capaces de aprender.

El darles la capacidad de aprendizaje a las máquinas abre una amplia

gama de nuevas aplicaciones. El entender también como pueden aprender

las máquinas nos puede ayudar a entender las capacidades y limitaciones

humanas de aprendizaje.

El aprendizaje humano en general es muy diverso e incluye entre otras

cosas:

• adquisición de conocimiento

• desarrollo de habilidades a través de instrucción y práctica

• organización de conocimiento

• descubrimiento de hechos

• ...

De la misma forma el aprendizaje computacional (ML) se encarga de

estudiar y modelar computacionalmente los procesos de aprendizaje en sus

diversas manifestaciones.

1

En general, se busca contruir programas que mejoren automáticamente

con la experiencia.

Aunque no se tienen programas que aprenden tan bien como los humanos,

existen algoritmos que han probado ser muy efectivos para ciertas tareas.

Se tienen más resultados teóricos y una mayor cantidad de aplicaciones

reales, lo cual refleja cierto proceso de maduración del área.

Aprendizaje: cambios adaptivos en el sistema para hacer la misma tarea(s)

de la misma problación de una manera más eficiente y efectiva la próxima

vez [Simon, 83].

Aprendizaje: un programa de computadora se dice que aprende de experiencia E con respecto a una clase de tareas T y medida de desempeño D, si

su desempeño en las tareas en T , medidas con D, mejoran con experiencia

E [Mitchell, 97].

Muchas veces los objetivos dependen de la perspectiva que se les de:

• ingenieril (resolver tareas)

• simulación cognitiva

• análisis teórico

Instruir una máquina a realizar cierta tarea lleva mucho tiempo. ML

trata de suavizar la carga mediante herramientas que pueden automatizarlo.

Desde el punto de vista de sistemas basados en conocimiento...

“. . . knowledge is currently acquired in a very painstaking way;

individual computer scientists work with individual experts to explicate the expert’s heuristics – the problem of knowledge acquisition is the critical bottleneck in artificial intelligence.” Feigenbaum and McCorduck [Feigenbaum, pp. 79-80]

“Knowledge engineers have generally assumed that the procedural knowledge which drives an expert’s skilled behavior can be

2

elicited by dialogue. The findings of the past decade in brain science, cognitive psychology and commercial software do not support this idea. Evidence is lacking that skills, having once reached

the “automization” stage, can be de-automized by dialogue so as

to make their inner workings accessible to introspective report.”

Donald Michie [Michie, pp. 1]

Existen diversas tareas que se pueden hacer con sistemas de aprendizaje.

Entre ellas podemos en general clasificarlas como sigue:

• Descripción: normalmente es usada como análisis preliminar de los

datos (resumen, caracterı́sticas de los datos, casos extremos, etc.). Con

esto, el usuario se sensibiliza con los datos y su estructura.

Busca derivar descripciones concisas de caracterı́sticas de los datos

(e.g., medias, desviaciones estándares, etc.).

• La Predicción la podemos dividir en dos: Clasificación y Estimación.

– Clasificación: Los datos son objetos caracterizados por atributos

que pertenecen a diferentes clases (etiquetas discretas).

La meta es inducir un modelo para poder predecir una clase dados

los valores de los atributos.

Se usan por ejemplo, árboles de decisión, reglas, SVM, etc.

– Estimación o Regresión: las clases son continuas.

La meta es inducir un modelo para poder predecir el valor de la

clase dados los valores de los atributos.

Se usan por ejemplo, árboles de regresión, regresión lineal, redes

neuronales, LWR, etc.

• Segmentación: separación de los datos en subgrupos o clases interesantes.

Las clases pueden ser exhaustivas y mutuamente exclusivas o jerárquicas

y con traslapes.

Se puede utilizar con otras técnicas de minerı́a de datos: considerar

cada subgrupo de datos por separado, etiquetarlos y utilizar un algoritmo de clasificación.

3

Se usan algoritmos de clustering, SOM (self-organization maps), EM

(expectation maximization), k-means, etc.

Normalmente el usuario tiene una buena capacidad de formar las clases

y se han desarrollado herramientas visuales interactivas para ayudar al

usuario.

• Análisis de dependencias: El valor de un elemento puede usarse para

predecir el valor de otro. La dependencia puede ser probabilı́stica,

puede definir una red de dependencias o puede ser funcional (leyes

fı́sicas).

También se ha enfocado a encontrar si existe una alta proporción de

valores de algunos atributos que ocurren con cierta medida de confianza

junto con valores de otros atributos.

Se pueden utilizar redes bayesianas, redes causales, y reglas de asociación.

• Detección de desviaciones, casos extremos o anomalias: Detectar los

cambios más significativos en los datos con respecto a valores pasados

o normales. Sirve para filtrar grandes volúmenes de datos que son

menos probables de ser interesantes. El problema está en determinar

cuándo una desviación es significativa para ser de interés.

• Aprendizaje de cuál es la mejor acción a tomar a partir de experiencia: Esto involucra búsqueda y exploración del ambiente. Esto está

relacionado principalmente con aprendizaje por refuerzo, pero también

con técnicas como aprendizaje de macro-operadores, chunking y EBL.

• Optimización y búsqueda: Existen una gran cantidad de algoritmos de

búsqueda tanto determinı́stica como aleatoria, individual como poblacional, local como global, que se utilizan principalmente para resolver

algún problema de optimización. Aquı́ podemos incluir a los algoritmos genéticos, recocido simulado, ant-colony, técnicas de búsqueda

local, etc.

Algunas de las técnicas más comunes son:

• Arboles de decisión y reglas de clasificación: realizan cortes sobre una

variable (lo cual limita su expresividad, pero facilita su comprensión).

4

Generalmente se usan técnicas heurı́sticas en su construcción (e.g., ID3,

C4.5, CN2). Ver figura 1.1.

• Métodos de clasificación y regresiones no–lineales: tratan de ajustar

combinaciones de funciones lineales y no–lineales, por ejemplo, redes

neuronales (e.g., backpropagation), métodos de splines adaptativos,

etc. Ver figura 1.2

• Métodos basados en ejemplos prototı́picos: se hacen aproximaciones en

base a los ejemplos o casos más conocidos (Examplar–based learning y

Case–based resoning). El problema es cómo determinar una medida de

similaridad adecuada. Ver figura 1.3.

• Modelos gráficos de dependencias probabilı́sticas: básicamente se utilizan redes bayesianas, en donde dado un modelo estructural y probabilı́stico, se encuentran los valores de ciertas variables dados valores de

otras variables. Ver figura 1.4.

• Modelos relacionales: Programación lógica inductiva (o ILP), en donde

la búsqueda del modelo se basa en lógica y heurı́sitcas. Ver figura 1.5.

• Reglas de Asociación: reglas que relacionan un conjunto de pares atributovalor con otros pares atributo-valor. Por ejemplo:

edad(X, 20 . . . 29) ∧ ingresos(X, 20K..29K) ⇒ compra(X, CD)

[soporte = 2%,confianza = 60%]

• Clustering: agrupan datos cuya distancia multidimensional dentro de

la clase es pequeña y entre clases es grande. Ver figura 1.6.

Algunos ejemplos de aplicaciones que usan aprendizaje:

• Sistemas de reconocimiento de voz (e.g., SPHINX, Lee 89),

• Manejo de vehı́culos autónomos (ALVINN, Pomerleau 89)

• Clasificación de nuevas estructuras de astronomı́a (SkyCat, Fayyad et

al. 95)

• Aprendiendo a jugar Backgammon (TD-Gammon, Tesauro 92)

5

DV_T

O3_Q

120

NO2_F

57

11

O3_Q

NO2_X

C5

DV_X

49

46

SO2_F

SO2_L

DV_F

72

C7

32

C4

C4

C7

39

89

39

C4

O3_L

C5

C1

DV_L

RH_Q

RH_F

219

286

484

C10

C5

C1

C10

NOX_X

NO2_T

45

87

DV_T

RH_L

TMP_L

C2

168

291

219

C11

C13

O3_X

C3

TMP_F

C11

231

NO2_T

227

VV_Q

C3

C7

43

HORA

23

10

C3

NOX_X

RH_Q

C6

C7

77

346

VV_T

RH_L

C2

DV_X

43

162

423

C12

C6

C8

C6

C2

C3

Figura 1.1: Predicción de Ozono en la Ciudad de México.

6

Salidas

Entradas

Figura 1.2: Red Neuronal prototı́pica.

Figura 1.3: Aprendizaje basado en instancias.

7

nivel

socioecono.

edad

auto

extra

buen

estudian.

ano

auto

marca

experien.

seguri.

habilid.

manejo

anti

robo

kilome.

ABS

valor

comerc.

histor.

manejo

calidad

manejo

bolsas

aire

lugar

hogar

accident

robo

condic.

camino

defensas

costo

medico

danos

persona.

costo

coche

propio

costo

otros

autos

costo

personal

costo

propied.

Figura 1.4: Red bayesiana de seguros de coches.

8

ACTIVO

+

O=N

+

CH = N - NH - C - NH

-

O

N=O

-

O

O

nitrofurazone

4-nitropenta[cd]pyrene

INACTIVO

-

O

O

+

N

+

N

NH

-

O

O

6-nitro-7,8,9,10-tetrahydrobenzo[a]pyrene

4-nitroindole

U

V

Y=Z

W

X

Figura 1.5: Predicción de mutagénesis.

9

x

x

x

x

x

x

Figura 1.6: Ejemplo de Clustering.

10

Por otro, existe una gran cantidad de aplicaciones reales relacionadas con

descubrimiento de conocimiento en base de datos que utilizan algún algoritmo

de aprendizaje. Estas aplicaciones se encuentran en áreas tales como:

• astronomı́a: clustering y clasificación de cuerpos celestes

• biologı́a molecular: predicción de substancias cancerı́genas, genoma humana, etc.

• aspectos climatológicos: predicción de tormentas, etc.

• medicina: caracterización y predicción de enfermedades

• industria y manufactura: diagnóstico de fallas

• mercadotécnia: identificar clientes susceptibles de responder a ofertas

de productos y servicios por correo, selección de sitios de tiendas, etc.

• inversión en casas de bolsa y banca: análisis de clientes, aprobación de

prestamos, etc.

• detección de fraudes y comportamientos inusuales: telefónicos, seguros,

electricidad, etc.

• análisis de canastas de mercado para mejorar la organización de tiendas

• aprendizaje de tareas en robótica

• ...

Aprendizaje tiene muchas áreas relacionadas:

• Inteligencia Artificial: manejo simbólico, búsqueda, uso de conocimiento

del dominio

• Métodos Bayesianos: teorema de Bayes, algoritmos para estimar valores de variables no observadas

• Teorı́a de complejidad computacional: cotas teóricas de complejidad,

número de ejemplos para aprender, etc.

11

• Teorı́a de control: para optimizar objetivos y predecir el estado siguiente de lo que se está controlando.

• Teorı́a de información: medidas de entropı́a, principio de longitud de

descripción mı́nima.

• Filosofı́a: principio de Occam, inducción

• Psicologı́a y neurobiologı́a: modelos de aprendizaje y neuronales

• Estadı́stica: caracterización de errores, niveles de confianza, pruebas.

Consideraciones y retos actuales

Existen muchos puntos que aclarar cuando se quiere correr o desarrollar

algún algoritmo de aprendizaje. Algunos de estos son:

• Qué algoritmos existen para resolver cierta tarea? cuándo y cómo usarlos? qué propiedades tienen?

• Cuántos datos o tiempo de entrenamiento necesito? qué tanta confianza

puedo tener en los resultados?

• Cómo y cuándo usar conocimiento del dominio?

• ...

Se espera que algunas de estas preguntas se puedan resolver al final del curso.

Existen otros retos actuales para el área de aprendizaje. Tales como:

• Volúmen de datos (mega, giga y hasta terabytes)

• Alta dimensionalidad

• Muchos atributos y pocos datos

• Sobreajuste (overfitting) de modelos en los datos

• Datos y conocimiento dinámicos (datos en BD y los patrones encontrados cambian continuamente)

12

• Ruido, incertidumbre (tanto en datos como en conocimiento del dominio y en patrones descubiertos) y datos incompletos y/o esparsos

• Relaciones complejas entre campos, jerarquı́as, relaciones entre atributos, nuevos atributos., etc.

• Interpretación de los resultados

• Incorporación de conocimiento del dominio

• Interacción activa del usuario

• Integración con otros sistemas

1.1

Aprendizaje Inductivo

El aprendizaje inductivo puede verse como el proceso de aprender una función.

Por ejemplo, en aprendizaje supervisado, al elemento de aprendizaje se le dá

un valor correcto (o aproximadamente correcto) de una función a aprender para entradas particulares y cambia la representación de la función que

está infiriendo, para tratar de aparear la información dada por la retroalimentación que ofrecen los ejemplos.

Un ejemplo es un par (x, f (x)), donde x es la entrada (que generalmente

es un vector) y f (x) la salida. El proceso de inferencia inductiva pura (o

inducción) es: dada una colección de ejemplos de f , regresar una función h

tal que se aproxime a f . A la función h se le llama la hipótesis.

En principio existen muchas posibilidades para escoger h, cualquier preferencia se llama bias o sesgo. Todos los algoritmos de aprendizaje exhiben

algún tipo de sesgo.

La selección de una representación para la función deseada es probablemente el factor más importante en el diseño de un sistema de aprendizaje.

Desde un punto de vista más tradicional (hablando de representaciones

simbólicas/reglas,...), podemos decir que una buena parte de ML está dedicada a inferir reglas a partir de ejemplos. Descripciones generales de clases

13

de objetos, obtenidas a partir de un conjunto de ejemplos, pueden ser usadas

para clasificar o predecir.

En general, el interes no está en aprender conceptos de la forma en que

lo hacen los humanos, sino aprender representaciones simbólicas de ellos.

Angluin y Smith listan cinco elementos que deben de especificarse para

caracterizar un problema de inferencia inductiva:

1. La clase de reglas

2. El espacio de hipótesis

3. El conjunto de ejemplos y su presentación

4. La clase del método de inferencia

5. El criterio de éxito

La clase de reglas:

La clase de reglas denota la clase de funciones o lenguaje bajo consideración. Por ejemplo, todas las expresiones regulares sobre un alfabeto especı́fico, lenguajes libres de contexto, funciones recursivamente enumerables,

programas en Prolog, etc.

El espacio de hipótesis:

El espacio de hipótesis es el conjunto de descripciones tal que cada regla

en la clase tiene por lo menos una descripción en el espacio de hipótesis.

Diferentes espacios de hipótesis pueden usarse para la misma clase de reglas.

El lenguaje de hipótesis debe de tener descripciones para todas las reglas

en la clase, pero puede contener más.

Por conveniencia, normalmente se asume que el lenguaje descrito por el

espacio de hipótesis (i.e., el lenguaje de hipótesis) es el mismo que el de la

clase de reglas:

• Lenguaje de Hipótesis: la sintáxis usada en la construcción de hipótesis

14

• Espacio de Hipótesis: el conjunto de todas las posibles hipótesis dentro

del lenguaje de hipótesis

El lenguaje de hipótesis determina el espacio de hipótesis del cual el

método de inferencia selecciona sus reglas. El lenguaje impone ciertas restricciones (o preferencias) en lo que puede ser aprendido y qué estrategias

de razonamiento son permitidas. Al escoger un lenguaje, debemos de considerar no sólo lo que queremos que el sistema realice, sino también qué

información se le debe de proporcionar al sistema de entrada para permitirle

resolver el problema, y si lo va a resolver a tiempo.

Al igual que en los mecanismos de razonamiento utilizados para representar conocimiento, aquı́ existe un balance fundamental entre la expresividad y

la eficiencia (ver figura 1.7 y 1.8).

El lenguaje de hipótesis depende del área de aplicación. Una vez definido,

una buena parte del tiempo de desarrollo se dedica a seleccionar cuidadosamente las estructuras de conocimiento adecuadas para la tarea de aprendizaje.

Este tiempo se vuelve más crı́tico cuando el lenguaje de hipótesis restringe la expresividad de tal forma que el conocimiento del dominio tiene

que adaptarse al formalismo adoptado.

El proceso de indución puede verse como una búsqueda de hipótesis o

reglas.

El espacio puede buscarse sistemáticamente, hasta encontrar la regla adecuada. Dado un espacio de hipótesis particular, podemos tener una enumeración de descripciones, digamos d1 , . . . , dn , tal que cada regla en el espacio

de hipótesis tiene una o más descripciones en esta enumeración.

Dada una colección de ejemplos, identificación en el lı́mite recorre esta

lista encontrando la primera descripción, digamos di , que es compatible con

los ejemplos vistos y conjetura a di .

Este método a pesar de ser poderoso y general es impráctico, para todos

exceptuando un número limitado de casos, debido al tamaño del espacio de

búsqueda.

15

X

XY

X

XY

Y

Y

XY

XY

f(X).

f(a).

f(X) :- g(Y).

f(c).

f(b).

f(X) :- h(Y).

f(c) :- h(c).

f(a) :- g(X).

f(a) :- g(b), h(c).

Figura 1.7: El espacio de hipótesis depende de la expresividad del lenguaje.

16

f(x)

f(x) = mx + b

f(x) = ax3+ bx2+ cx + d

f(x) = ax2+ bx + c

x

Figura 1.8: Qué tan bien se ajusta el modelo depende de la expresividad del

lenguaje.

Para que el aprendizaje puede realizarse en forma eficiente, es normalmente crucial estructurar el espacio de hipótesis. Esto se puede hacer con un

modelo de generalización.

A grandes razgos una regla R1 es más general que otra regla R2 (o R2 es

más especı́fica que R1 ), si en cualquier mundo R1 puede mostrar los mismos

resultados que R2 .

Esta estructuración permite cortar ramas durante la búsqueda sabiendo

que especializaciones o generalizaciones de reglas hereden alguna propiedad.

Las propiedades más comunes son: incapacidad de cubrir un ejemplo

conocido como verdadero o probar un ejemplo conocido como falso.

Conjunto de ejemplos y su presentación:

Existen diferentes tipos de presentación de datos y sus efectos en la inferencia de lenguajes.

Los ejemplos pueden dar una retroalimentación directa o indirecta. Por

ejemplo, al aprender a jugar un cierto juego, la retroalimentación se puede

dar en cada jugada o al final del juego o después de un conjunto de jugadas

que provocaron una pérdida de material, etc. Aquı́, surge el problema de

asignación de crédito (cuál jugada es responsable del éxito o fracaso).

17

Una presentación puede consistir en: (i) sólo ejemplos positivos y (ii)

positivos y negativos.

Casi todos los algoritmos requieren presentaciones admisibles, esto es,

para cada regla falsa que es consistente con los ejemplos positivos, existe un

ejemplo negativo que la refuta (se relaciona con Popper: Las teorı́as deben

de ser refutables con hechos).

Los ejemplos se usan para probar y formar hipótesis. En la práctica una

selección de ejemplos se hace sobre el espacio de ejemplos.

Esta selección puede hacerla un: oráculo, el medio ambiente, seleccionada

en forma aleatoria, propuesta por el sistema.

Una “buena” selección de ejemplos puede mejorar el desempeño de un

sistema (ver por ejemplo Active Learning).

A veces esa selección puede mejorarse con conocimiento del dominio.

Es deseable que la distribución que sigan los ejemplos sea similar a la que

van a tener ejemplos futuros.

Finalmente, si el sistema es quién tiene el control sobre cuándo experimentar situaciones novedosas o no, entonces se tiene el problema de formar

un balance entre exploración y explotación.

Métodos de inferencia:

Intuitivamente un método de inferencia es un proceso computacional de

algún tipo que lee ejemplos y produce hipótesis del espacio de hipótesis.

Existe una gran cantidad de métodos. Algunos realizan ajustes graduales en base a refuerzos sobre predicciones sucesivas (e.g., aprendizaje por

refuerzo, redes neuronales, regresión, etc.). Otros construyen incrementalmente hipótesis tratando de cubrir la mayor parte de un conjunto de ejemplos (e.g., reglas de clasificación, programas lógicos) o en base a mejores

particiones de ejemplos (e.g., árboles de decisión). Otros, guardan ejemplos

prototı́picos (e.g., aprendizaje basado en casos y aprendizaje basado en instancias). Algunos buscan relaciones entre variables (e.g., redes Bayesianas).

Finalmente, algunos algoritmos combinan o modifican hipótesis promisorias

18

(e.g., algoritmos genéticos).

Criterio de éxito:

Un componente importante dentro de la especificación de un problema

de inferencia es el criterio de éxito. Identificación en el lı́mite es uno de ellos,

sin embargo, normalmente es difı́cil saber cuándo el método ha convergido.

Recientemente Valiant, propuso un criterio de identificación correcta de

una regla a partir de ejemplos usando un criterio estocástico.

La idea es que después de un muestreo aleatorio de ejemplos positivos y

negativos de una regla, un procedimiento de identificación debe de producir

una regla que con “alta probabilidad” no sea “muy diferente” de la regla

correcta.

Esto se basa en dos parámetros: ǫ y δ. ǫ es una medida de tolerancia

o un lı́mite de la diferencia permitida entre la regla correcta y la hipótesis

generada. δ es una medida de confianza.

Informalmente, un procedimiento de identificación se dice ser probablemente aproximadamente correcto o PAC si la diferencia entre la regla correcta

y la hipótesis es menos que ǫ con probabilidad mayor a 1 − δ.

En la práctica queremos ciertas garantias de la calidad de la hipótesis.

Las más comunes son que sea completo y consistente (ver figura 1.9):

• Una hipótesis es completa si cubre todos los ejemplos positivos

• Una hipótesis es consistente si no cubre a ninguno de los ejemplos

negativos

A veces el usuario determina el criterio de paro. Si el sistema genera sus

propios ejemplos, éste lo determina.

19

x

x

x

x

x

x

x

x

x

x

x

x

H

H

Completo e Inconsistente

Completo y Consistente

x

x

x

x

x

x

x

x

H

x

x

x

x

H

Incompleto e Inconsistente

Inompleto y Consistente

Figura 1.9: Completo y Consistente (X positivos y O negativos).

20

1.2

Espacio de Versiones

Desde el punto de vista de lógica, en aprendizaje computacional, normalmente empezamos con un predicado meta (M) y tratamos de encontrar una

expresión lógica equivalente que nos sirva para clasificar ejemplos correctamente.

Cada hipótesis propone una expresión, y la llamaremos la definición candidata del predicado meta.

Como lo mencionamos antes, el espacio de hipótesis H es el conjunto de

todas las hipótesis {H1 , H2 , . . . , Hn }, que el algoritmo de aprendizaje está

diseñado a producir.

Cada hipótesis predice que un cierto conjunto de ejemplos (aquellos que

satisfacen su definición candidata) son ejemplos del predicado meta. A estos

ejemplos también se les llama la extensión del predicado.

En este sentido dos hipótesis son lógicamente equivalentes si tienen la

misma extensión.

Los ejemplos son objetos para los cuales el predicado meta puede o no

satisfacerse.

Una hipótesis es consistente lógicamente con los ejemplos si se cumple o

no dependiendo si el ejemplo es positivo o negativo.

Las condiciones por las cuales una hipótesis puede ser inconsistente con

algún ejemplo son:

• Un ejemplo es un negativo falso para la hipótesis (i.e., la hipótesis dice

que debe de ser negativo y en realidad es positivo)

• Un ejemplo es un positivo falso para la hipótesis (i.e., la hipótesis dice

que debe de ser positivo y en realidad es negativo)

Si asumimos que el ejemplo es una observación correcta, un falso positivo

o negativo implica que la hipótesis tiene que ser rechazada.

21

Desde un esquema de lógica, podemos caracterizar el aprendizaje inductivo eliminando gradualmente hipótesis que sean inconsistentes con los ejemplos (ver figura 1.10).

Sin embargo, el espacio es muy grande (e incluso infinito en muchos casos)

haciendo su implantación directa impráctica (sino imposible).

Búsqueda de la mejor hipótesis actual:

La idea es mantener una sola hipótesis, e irla ajustando conforme nuevos

ejemplos se consideran, manteniendo consistencia.

El algoritmo básico puede encontrarse descrito desde 1943 (John Stuart

Mill).

Si tenemos una hipótesis Hr y recibimos un negativo falso, entonces la

extensión de la hipótesis debe aumentarse para incluirlo. A esto se le llama

generalización.

Si tenemos un positivo falso, entonces la extensión de la hipótesis debe

reducirse para excluirlo. A esto se le llama especialización.

Definimos generalización y especialización como operaciones que cambian

la extensión de una hipótesis (ver figura 1.11). Intuitivamente H1 es más

general que H2 si la “cubre”.

Ahora debemos de ver cómo implementarlas como operaciones sintácticas.

Una posible forma de generalizar es eliminando condiciones volviendo

las definiciones más débiles y por lo tanto cubriendo un conjunto mayor de

ejemplos o añadiendo disjunciones (ver tabla 1.1).

De forma dual, podemos especializar añadiendo condiciones o eliminando

disjunciones.

La estrategia de la tabla 1.1, sigue básicamente una búsqueda en profundidad. Podemos empezar con una generalización o con una especialización

que sea consistente con los ejemplos.

Las ideas de éste algoritmo se han usado en varios sistemas de aprendizaje,

sin embargo, tiene algunos problemas:

22

??

Ejemplo: 4 Espadas (+)

Num ?

? Num

Num Negro

4?

4 Negro

? Espadas

Num Espadas

Ejemplo: 7 Espadas (+)

4 Espadas

??

Num ?

? Num

Num Negro

Ejemplo: 5 Corazones (-)

? Espadas

? Num

Num Negro

Num Espadas

? Espadas

Num Espadas

Ejemplo: 3 Treboles (+)

? Num

Ejemplo: Reina Treboles (-)

Num Negro

Num Negro

Figura 1.10: Proceso de eliminación de hipótesis.

23

x

x

x

x

x

x

x

Generalizar

Especializar

x

x

x

x

x

x

x

x

x

x

x

x

x

x

x

Figura 1.11: Proceso de especializar y generalizar.

24

Tabla 1.1: Algoritmo de Mejor Hipótesis Actual.

función mejor-hipótesis-actual(ejemplos)

regresa una hipótesis

H ← cualquier hipótesis consistente con el primer ejemplo

en ejemplos

para cada uno de los ejemplos restantes hacer

si e es positivo falso para H entonces

H ← selecciona una especialización de H consistente

con ejemplos

sino si e es negativo falso para H entonces

H ← selecciona una generalización de H consistente

con ejemplos

si no se puede construir una especialización /

generalización consistente entonces falla

regresa H

1. Verificar todas las instancias anteriores cada vez que se hace una modificación

2. Es difı́cil encontrar buenas heurı́sticas de búsqueda y el hacer backtracking puede volverse “eterno”

El hacer backtracking sucede porque en el algoritmo anterior escoge una

hipótesis particular como la mejor (aunque no se tenga suficiente información

para estar seguros de tal decisión).

Alternativamente, podemos seguir una búsqueda a lo ancho (i.e., mantener varias hipótesis a la vez). Si seguimos una estrategia de especı́fico a

general, podemos tratar de tener en el conjunto todas las generalizaciones

más especı́ficas que son consistentes con las observaciones (también podemos

hacerlo de general a especı́fico). Ver tabla 1.2.

Los ejemplos positivos forzan las generalizaciones y los negativos eliminan

generalizaciones. Sigue un proceso monotónico de especı́fico a general.

25

Tabla 1.2: Algoritmo de Especı́fico a General a lo ancho.

función espec-a-general-breadth(ejemplos)

H ← el conjunto de generalizaciones más especı́ficas

consistentes con los ejemplos vistos en ejemplos

para cada uno de los ejemplos restantes hacer

si e es positivo falso para alguna hipótesis en H

entonces H ← las hipótesis que no son

consistentes con el ejemplo

sino si e es negativo falso para alguna hipótesis en H

entonces H ← generaliza miembros de H, pero

sólo al punto de aceptar el ejemplo

Elimina de H cualquier elemento que sea

(i) más general que otro elemento o

(ii) aparea otros negativos

si no se puede construir una generalización consistente

entonces falla

regresa H

26

Sin embargo, cada vez que generalizamos, seguimos teniendo que verificar

consistencia con todos los ejemplos positivos.

Búsqueda con el menor compromiso

Una alternativa es mantener todas y sólo aquellas hipótesis que son consistentes con todos los datos.

Con cada instancia nueva, o no se hace nada, o se eliminan algunas

hipótesis.

Asumiendo que el espacio de hipótesis inicial tiene una respuesta correcta,

la disjunción de hipótesis reducida, va a seguir teniendola. Al conjunto de

hipótesis que quedan se le llama espacio de versiones (version space).

Una propiedad importante del algoritmo es que es incremental (nunca se

tiene que regresar para examinar ejemplos viejos).

Problema obvio: si el espacio es gigantesco, como podemos escribir la

disjunción completa de hipótesis. El punto es que no la tenemos que escribir!

Se puede hacer una analogı́a con números reales. Si queremos representar

todos los números entre 1 y 2 ⇒ [1, 2].

Esto lo podemos hacer porque existe un ordenamiento.

La generalización / especialización también nos da un orden, en este caso

un orden parcial (ver figura 1.12).

En este caso, las fronteras no son puntuales, sino conjuntos de hipótesis

o conjuntos frontera (boundary sets).

Lo bueno es que podemos representar todo el espacio de versiones usando

sólo 2 conjuntos de frontera:

• la frontera más general (el conjunto G)

• la frontera más especı́fica (el conjunto S)

Todo lo que está entre S y G está garantizado a ser consistente con los

ejemplos (el tamaño de S y G depende del lenguaje).

27

Muy general

mas

general

mas

especifico

Muy especifico

Figura 1.12: Orden parcial entre hipótesis.

Resumiendo:

• el espacio de versiones actual es el conjunto de hipótesis consistente con

todos los ejemplos vistos

• cada elemento del conjunto S es consistente con todas las observaciones

hasta el momento y no existen hipótesis consistentes que sean más

especı́ficas

• cada elemento del conjunto G es consistente con todas las observaciones

hasta el momento y no existen hipótesis consistentes que sean más

generales

El espacio de versiones inicial tiene que representar a todas las hipótesis.

Esto se puede lograr haciendo G = True (contiene todo) y S = False (su

extensión es vacı́a).

Se tienen que cumplir dos propiedades:

• Toda hipótesis consistente está entre S y G

28

generalizar

+

H no cubre e

H cubre e

especializar

Figura 1.13: Actualización en el espacio de versiones

• Toda hipótesis entre S y G es consistente

Lo único que queda es como actualizar S y G. Si Si es una de las hipótesis

en S y Gi una en G (ver figura 1.13):

1. Positivo falso para Si : Si es muy general, pero por definición no existe

una especialización de Si consistente, por lo que la eliminamos

2. Negativo falso para Si : Si es muy especı́fico y tenemos que substituirlo

por su generalización inmediata

3. Positivo falso para Gi : Gi es muy general y tenemos que substituirlo

por su especialización inmediata

4. Negativo falso para Gi : Gi es muy especı́fico, pero por definición no

existe una generalización de Gi consistente, por lo que la eliminamos

Continuamos con estas operaciones hasta que (ver tabla 1.3):

29

Tabla 1.3: Algoritmo de Espacio de Versiones.

Inicializa los conjuntos S y G con Falso y Verdadero

Para cada ejemplo ei subsecuente

si e es negativo entonces

• Manten en S sólo las hipótesis que no

cubren a ei

• Especializa en G aquellas hipótesis que

cubran a ei , pero sólo al punto para no

cubrirlo y que sigan siendo las más generales

• Elimina de G cualquier elemento más especı́fico

sino si ei es positivo entonces

• Manten en G sólo las hipótesis que

cubren a ei

• Generaliza en S aquellas hipótesis

que no cubran a ei , pero sólo al punto para

cubrirlo y que sigan siendo las más especı́ficas

• Elimina de S cualquier elemento más general

1. En el espacio de versiones queda una sola hipótesis

2. El espacio de versiones se colapsa (S y G se vuelven vacı́as), por lo que

no hay una hipótesis consistente con los ejemplos

3. Se acabaron los ejemplos y tenemos varias hipótesis en el espacio de versiones, i.e., una disjunción de hipótesis (con un nuevo ejemplo, si todas

las hipótesis están de acuerdo, clasificamos el ejemplo, sino, podemos

tomar un voto mayoritario)

Ventajas:

• Detecta cuando acaba (cuando los ejemplos son suficientes)

• Cuando hay sólo algunos ejemplos, sigue dando resultados

Problemas:

30

1. Asume que podemos calcular la relación más-general-que

2. Si el dominio tiene ruido o insuficientes atributos para una clasificación

exacta, el espacio de versiones se colapsa

3. Si permitimos una disjunción ilimitada en el espacio de hipótesis, el

conjunto S va a tener una disjunción de los ejemplos positivos y G va

a tener la negación de la disjunción de los ejemplos negativos

Para el manejo de ruido no existe una solución general (pero vamos a ver

varias). Para el caso de disjunciones ilimitadas, podemos usar una jerarquı́a

de generalizaciones.

El algoritmo de espacio de versiones se uso en Meta-Dendral (reglas para

predecir como se rompen moleculas quı́micas) y en LEX (resolver problemas

de integración simbólica).

Puede servir para generar automáticamente ejemplos que dividan el espacio de búsqueda.

Unos años depués, se desarrolló una generalización del espacio de versiones, que permite manejar ruido, valores faltantes e incorporar conocimiento

del dominio. Para esto utiliza conjuntos de frontores que permiten cierta cantidad de ruido y desarrollo métodos para fusionar elementos de las fronteras.

31

Capı́tulo 2

Aprendizaje Basado en

Similaridades (SBL)

Atributos

Peludo? Edad? Tamaño?

si

viejo

grande

no

joven grande

si

joven mediano

si

viejo

pequeño

si

joven pequeño

si

joven grande

no

joven pequeño

no

viejo

grande

If Tamaño = mediano

Then león

If Tamaño = grande

and Peludo = si

Then león

If Tamaño = pequeño

Then no león

32

Clase

león

no león

león

no león

no león

león

no león

no león

~

Tamano

~

pequeno

mediano

grande

leon

Peludo

no leon

no

si

no leon

leon

Figura 2.1: Arbol de decisión.

If Tamaño = grande

and Peludo = no

Then no león

2.1

Inducción de Árboles de Decisión (TDIDT:

Top Down Induction of Decision Trees)

Existe una serie de algoritmos desarrollados desde los principios de los 60’s

para la construcción de árboles de decisión. CLS (Hunt et al., 1966), ID3

(Quinlan, 1979), CART (Breiman et al., 1984), ACLS (Niblett et al., 1982),

ASSISTANT (Cestnik et al., 1987), C4.5 (Quinlan, 1993), etc.

Muchos de estos desarrollos se han convertido en herramientas comerciales, por ejemplo, RuleMaster (1984), Ex-Tran (1984), Expert-Ease (1983),

y C5/See5 (2000). Por otro lado, la gran mayorı́a de los ambientes de KDD

incluyen alguna versión de ID3 o de CART.

El aprendizaje de árboles de decisión es uno de los más sencillos y fáciles

de implementar y a su vez de los más poderosos.

33

Un árbol de decisión toma de entrada un objeto o situación descrita por

un conjunto de atributos y regresa una decisión “verdadero/falso”.

En general pueden tener un rango más amplio que simples funciones

Booleanas, pero por simplicidad, consideremos primero sólo estas.

Cada nodo interno corresponde a una prueba en el valor de uno de los

atributos y las ramas están etiquetadas con los posibles valores de la prueba.

Cada hoja especifica el valor de la clase.

Expresividad

Los árboles de decisión están limitados a hablar de un solo objeto, osea,

son escencialmente proposicionales, siendo cada prueba de atributo una proposición.

Por lo mismo no podemos usar los árboles de decisión para expresar pruebas sobre dos o más objetos diferentes, e.g. ∃r2 Cercano(r2 , r)∧P recio(r2, p2 )∧

P recio(r, p) ∧ MasBarato(p2 , p)

Claro que podrı́amos añadir un atributo Booleano que se llame:

RestMásBaratoCerca, pero es intratable para todas las combinaciones de

atributos.

Por otro lado, los árboles de decisión son completamente expresivos dentro

de la clase de lenguajes proposicionales. Osea que cualquier función Booleana

puede ser descrita por un árbol de decisión.

Trivialmente, podemos tomar cada fila como un camino en la construcción

de un árbol. Sin embargo, la tabla es exponencial en el número de atributos.

Para muchas funciones, los árboles son relativamente pequeños. Sin

embargo, para otras funciones puede requerir un árbol exponencialmente

grande. Por ejemplo, la función paridad (i.e., regresa 1 si la suma de 1’s es

par) o la función de mayorı́a (regresa 1 si más de la mitad de la entrada es

un 1).

Para n atributos, hay 2n filas. Podemos considerar la salida como una

n

función definida por 2n bits. Con esto hay 22 posibles funciones diferentes

para n atributos (para 6 atributos, hay 2 × 1019 ).

34

Por lo mismo, tenemos que usar algún algoritmo ingenioso para encontrar

una hipótesis consistente en un espacio de búsqueda tan grande.

Inducción de árboles de decisión a partir de ejemplos

Un ejemplo es descrito por los valores de los atributos y el valor del

predicado meta. El valor del predicado meta se le llama la clasificación del

ejemplo.

Si el predicado es verdadero, entonces el ejemplo es positivo, sino el ejemplo es negativo.

En caso de existir más clases, los ejemplos de una sola clase son positivos

y el resto de los ejemplos son considerados negativos.

Cuando se tiene un conjunto de ejemplos (datos), normalmente se divide

aleatoriamente en dos subconjuntos. Uno de entrenamiento (con el cual se

construye la hipótesis) y otro de prueba (con el que se prueba la hipótesis

encontrada).

Más formalmente:

1. Junta una gran cantidad de ejemplos

2. Dividelos en dos conjuntos disjuntos: entrenamiento y prueba

3. Usa el algoritmo de aprendizaje para generar una hipótesis H

4. Mide el porcentage de clasificación correcta de H en el conjunto de

prueba

5. Repite los pasos 1 - 4 para diferentes tamaños de conjuntos de entrenamiento y diferentes conjuntos seleccionados aleatoriamente

Encontrar un árbol puede ser trivial (e.g., construir un camino por cada

ejemplo). Sin embargo, no es bueno para predecir casos no vistos. El problema es que sólo memoriza lo visto, por lo que no extrae ningún patrón de

los ejemplos (por lo que no podemos esperar que extrapole).

El extraer un patrón significa el poder describir una gran cantidad de

ejemplos en forma concisa. Esto también sigue un principio general en los

35

algoritmos de inducción llamada: Ockham’s razor (muchas veces escrito como

Occam): dar preferencia a hipótesis más simples que sean consistentes con

todas las observaciones.

Encontrar el árbol más pequeño es intratable, pero se pueden usar heurı́sticas

para encontrar árboles pequeños.

Idea: probar primero el atributo más “importante” (el que diferencia

mejor los ejemplos).

Después que el primer atributo particiona los ejemplos, cada subconjunto

es un nuevo problema de aprendizaje a su vez, con menos ejemplos y un atributo menos. Este proceso recursivo tiene 4 posibles resultados (ver tabla 2.1):

1. Si existen ejemplos positivos y negativos, escoge el mejor atributo para

particionarlos

2. Si todos los atributos restantes son positivos (o negativos), termina y

regresa True (o False)

3. No quedan ejemplos (no ha sido observado un ejemplo con esa combinación de atributos). Regresa un default en base a la clasificación

mayoritaria de su nodo padre

4. No hay más atributos, pero seguimos con ejemplos positivos y negativos

(i.e., existen ejemplos con la misma descripción, pero diferente clasificación). Posiblemente por ruido y/o falta de atributos y/o dominio no

determinı́stico. Posible solución: tomar la clasificación mayoritaria

El árbol resultante no necesariamente es el “correcto”. Para eso lo probamos

con el conjunto de prueba.

Aplicaciones:

Es la técnica que posiblemente se ha usado más en aplicaciones reales.

Tres ejemplos:

• GASOIL (1986): Diseño de sistemas de separación de hidrocarburos

en plataformas petroleras de BP, 2,800 reglas, 1 año-hombre de tiempo

36

Tabla 2.1: Algoritmo de construcción de árboles de decisión.

función Arbol-decisión(ejemplos,atributos,default)

regresa un árbol de decisión

entradas:ejemplos: conjunto de ejemplos

atributos: conjunto de atributos

default: valor de default para el predicado meta

if ejemplos = vacı́o then regresa default

else if todos los ejemplos tienen la misma clasificación

then regresa la clasificación

else if atributos = vacı́o

then regresa VALOR-MAYORITARIO(ejemplos)

else

Mejor ← ESCOGE-ATRIBUTO(atributos, ejemplos)

Arbol ← nuevo árbol de decisión con Mejor como raı́z

para cada valor vi de Mejor do

ejemplos i ← {ejemplos con Mejor = vi }

Subárbol ← ARBOL-DECISION(ejemplos i ,

atributos - mejor,

VALOR-MAYORITARIO(ejemplos))

añade una rama a Arbol con etiqueta vi y

subárbol Subárbol

end

return Arbol

37

Tabla 2.2: Tabla de ejemplos para decidir si jugar o no golf.

Ambiente

soleado

soleado

nublado

lluvia

lluvia

lluvia

nublado

soleado

soleado

luvia

soleado

nublado

nublado

lluvia

Temp.

alta

alta

alta

media

baja

baja

baja

media

baja

media

media

media

alta

media

Humedad

alta

alta

alta

alta

normal

normal

normal

alta

normal

normal

normal

alta

normal

alta

Viento

no

si

no

no

no

si

si

no

no

no

si

si

no

si

Clase

N

N

P

P

P

N

P

N

P

P

P

P

P

N

Ambiente

soleado

lluvioso

nublado

Humedad

alta

N

Viento

P

si

normal

P

N

no

P

Figura 2.2: Arbol de decisión para jugar Golf.

38

de desarrollo, 0.1 de mantenimiento, mejor que expertos y ahorro de

millones de dolares.

• BMT (1990): Configuración de equipo de protección de incendios en

edificios, > 30,000 reglas, 9 años hombre de desarrollo y 2 de mantenimiento (comparado con: MYCIN: 400 reglas, 100 años-hombre de

desarrollo o R1/XCON: 8,000 reglas, 180 años-hombre de desarrollo y

30 de mantenimiento).

• Aprendiendo a volar (1992): En lugar de construir un modelo preciso

de la dinámica del sistema, se aprendió un mapeo adecuado entre el

estado actual y la decisión de control correcta para volar un Cessna en

un simulador de vuelo. Los datos se obtuvieron de 3 pilotos experimentados haciendo un plan de vuelo asignado 30 veces. Cada acción

del piloto creaba un ejemplo. Se usaron 90,000 ejemplos descritos por

20 atributos. Se uso C4.5 que generó un árbol y se convirtió a C. Se

insertó en el simulador y logro volar. Los resultados fueron sorprendentes en el sentido de que aparte de aprender a volar a veces tomaba

decisiones mejores que las de sus “maestros”

2.1.1

Cómo le hace?

La medida utilizada en ESCOGE-ATRIBUTO debe de tener su valor máximo

cuando el atributo sea perfecto (i.e., discrimine perfectamente ejemplos positivos y negativos) y mı́nimo cuando el atributo no sea relevante.

Una posibilidad es basar la medida en la cantidad de información que da

el atributo (basado en la teorı́a de Shannon y Weaver ’49).

La cantidad de información mide la (im)pureza en una colección arbitraria

de ejemplos.

La cantidad de información recibida respecto a la ocurrencia de un evento

es inversamente proporcional a la probabilidad de ocurrencia de dicho evento.

La información se mide en bits (un bit de información es suficiente para

responder Verdadero/Falso a una pregunta cuya respuesta no se sabe).

39

E

1

1/2

1 P(x)

Figura 2.3: Función de Entropı́a.

Si se tienen vi posibles respuestas con probabilidades P (vi ), el contenido

de información es:

I(P (v1), . . . , P (vn )) = −

n

X

P (vi )log2 P (vi )

i=1

Nos representa el contenido promedio de información para los diferentes

eventos (ver figura 2.3).

En el caso de los árboles de decisión queremos estimar las probabilidades

de las respuestas. Esto se hace por la proporción de ejemplos positivos y

negativos.

Si se tienen p ejemplos positivos y n ejemplos negativos, entonces:

I(

p

n

p

p

n

n

,

)=−

log2

−

log2

p+n p+n

p+n

p+n p+n

p+n

Un solo atributo normalmente no nos proporciona toda esta información,

pero podemos estimar cuanta, viendo cuanta información necesitamos después de utilizar ese atributo,

Cada atributo A, divide a los ejemplos del conjunto de entrenamiento en

subconjuntos E1 , E2 , . . . , Ev de acuerdo a los v valores del atributo.

40

Cada subconjutno Ei tiene pi ejemplos positivos y ni ejemplos negativos,

pi

por lo que para cada rama necesitamos: I( pi +n

, ni ) cantidad de infori pi +ni

mación para responder a una pregunta.

Un ejemplo aleatorio tiene el valor i-ésimo del atributo A con probai +ni

bilidad: pp+n

. Por lo que en promedio, después de probar el atributo A,

necesitamos:

E(A) =

v

X

pi + ni

ni

pi

,

)

I(

pi + ni pi + ni

i=1 p + n

La cantidad de información que ganamos al seleccionar un atributo está

dada por:

Ganancia(A) = I(

n

p

,

) − E(A)

p+n p+n

La ganancia de A me dice el número de bits que ahorramos para responder

a la pregunta de la clase de un ejemplo, dado que conocemos el valor del

atributo A.

Dicho de otra forma, mide que tan bien un atributo separa a los ejemplos

de entrenamiento de acuerdo a la clase meta.

La función de evaluación escoge el atributo de mayor ganancia.

Por ejemplo, si calculamos las ganancias para los atributos con los datos

de la tabla 2.2 (asumimos que 0 × log2 (0) = 0):

9

9

I(9, 5) = − 14

log2 ( 14

)−

5

5

log2 ( 14

)

14

= 0.941

Para Ambiente:

soleado: p1 = 2, n1 = 3, I(p1, n1 ) = 0.971

nublado: p2 = 4, n2 = 0, I(p2 , n2 ) = 0

lluvia: p3 = 3, n3 = 2, I(p3 , n2 ) = 0.971

4

5

I(p1 , n1 ) + 14

I(p2 , n2 ) +

Entropı́a(Ambiente) = 14

Para Humedad :

alta: p1 = 3, n1 = 4, I(p1, n1 ) = 0.985

41

5

I(p3 , n3 )

14

= 0.694

normal: p2 = 6, n2 = 1, I(p2 , n2 ) = 0.592

Entropı́a(Humedad) = 0.798

Para Viento:

no: p1 = 6, n1 = 2, I(p1 , n1 ) = 0.811

si: p2 = 3, n2 = 3, I(p2, n2 ) = 1.0

Entropı́a(Viento) = 0.892

Para Temperatura, Entropı́a(Temperatura) = 0.9111

Las ganancias son entonces:

Ganancia(Ambiente) = 0.246 (MAX)

Ganancia(Humedad) = 0.151

Ganancia(Viento) = 0.048

Ganancia(Temperatura) = 0.029

Por lo que ID3 escoge el atributo Ambiente como nodo raı́z y procede a

realizar el mismo proceso con los ejemplos de cada rama.

Para Ambiente tenemos tres subconjuntos: soleado (2+, 3−), nublado

(4+, 0−), lluvioso (3+, 2−). Para nublado, no tenemos que hacer nada, mas

que asignarle la clase P .

Por ejemplo, para soleado hariamos el mismo proceso:

Ganancia(Humedad) = 0.97 - [(3/5)0 + (2/5)0] = 0.97 (MAX)

Ganancia(Temperatura) = 0.97 - [(2/5)0 + (2/5)1 + (1/5)0] = 0.570

Ganancia(Viento) = 0.97 - [(2/5)1 + (3/5)0.918] = 0.019

Uso del Arbol de Decisión

Con el árbol construido, podemos preguntar si esta bien jugar el sábado

en la mañana con ambiente soleado, temperatura alta, humedad alta y con

viento, a lo cual el ábol me responde que no.

ID3 sigue una estrategia hill-climbing, sin backtracking, incrementando en

cada paso la complejidad del árbol. Utiliza todos los ejemplos, con los cuales

extrae estadı́sticas y que lo hace más robusto que un algoritmo incremental

y por otro lado lo hace fácilmente extendible para manejar ruido. Tiende a

preferir construir árboles pequeños con atributos con ganancia de información

alta cerca de la raı́z.

42

Criterio de Selección:

El criterio de selección basado en contenido de información tiende a favorecer atributos que tienen más valores.

Por ejemplo, si un atributo tiene valores aleatorios o es un identificador

único de cada ejemplo (su clasificación serı́a perfecta y su información al

seleccionarlo serı́a 0 (ganancia máxima). Con esto el algoritmo básico construye un árbol de un solo nivel o decision stump.

Posible solución: árbol binario, dividiendo los posibles valores de los atributos

en dos. Desventaja: árboles difı́ciles de entender + computacionalmente caro

(2n subconjuntos para n valores).

Otra solución: Para compensar esto se definió una razón de ganancia de

información. Esto es dividir la ganancia de información entre la información

de la división (la cantidad de información en los ejemplos que se dividió).

La información de la división (split information) se define como:

SI(A) = −

n

X

P (Ai )log2 P (Ai )

i=1

Esto es, la entropı́a de los datos con respecto a los valores del atributo

(versus entropı́a con respecto a la clase).

E.g., si un atributo binario divide el conjunto de ejemplos en dos subconjuntos de igual tamaño, el contenido de información de su división es

1. Mientras que un atributo que divide los ejemplos en 14 subconjuntos de

tamaño 1, serı́a: 14(−1/14log2(1/14)) = −log2 (1/14).

Sin embargo, no siempre funciona ya que puede sobrecompensar. Una

práctica común es usar el atributo de la razón de ganancia de información

máxima si su ganancia de información es al menos tan grande como el promedio de ganacia de información del resto de los atributos.

Además de medidas basadas en ganancia de información, se han propuesto un gran número de diferentes medidas heurı́sticas para seleccionar al

“mejor” nodo y construir árboles de decisión. Otra medida muy utilizada es

43

el ı́ndice Gini del sistema CART:

Gini(t) = 1 −

m

X

(p(j | t))2

j=1

donde p(j | t) es la frecuencia relativa de la clase j en t.

Lo que se quiere es minimizar el ı́ndice Gini al seleccionar un atributo.

Para esto se calcula el ı́ndice Gini en cada rama del atributo tomando en

cuenta su proporción de ejemplos. Si se divide en k ramas:

GiniA =

k

X

ni

Gini(k)

i=1 n

donde ni son los ejemplos de la rama y n los del nodo.

2.1.2

Atributos numéricos y manejo de ruido

Hasta ahora hemos visto como funciona el algoritmo con atributos con valores

discretos finitos y con datos sin ruido. Veremos ahora algunas extensiones

para estos casos.

Atributos numéricos:

Qué hacer si un atributo es numérico?

Lo que normalmente se hace es que se ordena el atributo numérico, se

identifican ejemplos adyacentes que tengan valor de clase diferente y se consideran como candidatos los puntos medios de división del valor del atributo.

A cada uno de estos se le calcula su ganancia de información.

Supongamos que en el ejemplo de la tabla 2.2 la temperatura toma valores enteros, y que los desplegamos en forma ordenada (de menor a mayor)

juntando los valores iguales:

64 65 68 69

P N P P

70 71 72 75 80

P N N P N

P P

81 83 85

P P N

Existen 8 posibles lugares de corte que separan el valor de la clase. Para

cada uno de ellos se puede calcular su ganancia de información tomando el

44

punto medio. Por ejemplo, si se toma el punto 71.5, Temperatura < 71.5

tiene 4 P y 2 N, mientras que Temperatura > 71.5 tiene 5 P y 3 N.

Cada posible partición entra en competencia con el resto de los atributos

y el de mayor ganancia de información es el que se selecciona.

Esto implica que en el caso de atributos numéricos, estos pueden aparecer

varias veces en una rama de un árbol.

Para evitar ordenar ejemplos cada vez que se selecciona un atributo, se

guarda con cada subconjunto el orden de acuerdo a un atributo numérico.

Esto se puede hacer al principio y no volverlo a repetir.

Valores faltantes:

Una forma de tratar valores faltantes es como si fueran otro posible valor

del atributo. Esto solo funciona si el valor faltante tiene un significado especial en algun sentido.

Ignorar los datos es demasiado drástico ya que algunas veces el valor del

atributo puede no ser relevante para tomar una decisión.

Se han hecho diferentes propuestas para manejar datos faltantes, como

llenar estos huecos con el valor más probable o con el valor más probable

dada la clase.

Lo que hace C4.5 es distribuir los objetos con valores desconocidos entre

los demas. En donde se calcula la ganacia en información como si pi fuera:

pi + pd · razoni

razoni = P

pi + ni

i (pi + ni )

y pd es la probabilidad de los datos desconocidos. Haciendo lo equivalente

para ni .

La otra “cara de la moneda” es cómo clasificar (dado que se tiene un

árbol) un objeto con atributos desconocidos.

Idea: seguir todas las posibles ramas pero tomando en cuenta que algunas

45

son más probables que otras (tienen mas datos que la sorportan).

T · razoni

Al final se puede calcular el nivel de “confianza” para una clasificación.

Si se sabe cierta información acerca del posible valor del atributo, se puede

usar algún método probabilı́stico.

Costo de clasificación:

Si existe un costo en la clasificación, y este se conoce, entonces se puede

incorporar a la probabilidad de la predicción de la clase (se multiplica).

Normalmente se hace definiendo una matriz de costo en donde la diagonal

es 0 y los elementos fuera de la diagonal representan el costo de equivocarse en la clasificación. Entonces, se multiplican las probabilidades de las

clases predichas por el clasificador, por la columna correspondiente a la clase

predicha en la matriz de costo y se selecciona la clase de menor costo esperado. Variando las matrices de costo se puede variar la clasificación.

Recientemente se han estado estudiado el crear árboles cuando el costo de

(error en la) clasificación es diferente (e.g., dianosticar cancer). Esto afecta

en general el proceso de crecer y de podar (ver abajo) los árboles.

Cuando veamos formas de evaluar algoritmos, se mostrara cómo se puede

tomar en cuenta el costo de la clasificación definiendo diferentes umbrales

dentro de curvas ROC.

Por lo pronto una forma simple y general es generar datos de entrenamiento con diferente proporción en las clases. Si lo que nos interesa es

que clasifique bien una clase, entonces aumentamos la proporción de ejemplos de esa clase. Esto se puede hacer duplicando instancias de la clase a

predecir y/o reduciendo instancias de las otras clases.

Algunos algoritmos generan instancias artificialmente y las clasifican de

acuerdo a sus vecinos más cercanos.

Finalmente, algunos algoritmos permiten incorporarle pesos a los ejemplos de entrenamiento y con esto considerar el costo de una mala clasificación.

Ruido y “Overfitting”

46

Algunas de las ventajas de ID3 es que es útil en dominios con un alto

grado de no homogeneidad (diferentes relaciones entre atributos en diferentes regiones del espacio de problemas) y alta dimensionalidad (muchos

atributos).

En general, podemos hablar de que a pesar de que falte información

relevante, se pueda construir un árbol con los atributos irrelevantes.

Con muchas posibles hipótesis se tiene que tener cuidado en no encontrar

“regularidades con poco sentido” a partir de los datos. A este problema se

le llama overfitting y afecta a todos los tipos de aprendizaje (i.e., no sólo a

los árboles de decisión).

Definición: dado un espacio de hipótesis H, una hipótesis h ∈ H se dice

que sobreajusta los datos de entrenamiento si existe otra hipótesis h′ ∈ H, tal

que h tiene errores más pequeños que h′ en los ejemplos de entrenamiento,

pero h′ tiene errores más pequeños que h en toda la distribución de ejemplos.

Uno de los problemas a los que se enfrentan los sistemas de aprendizaje,

y que provocan el sobreajuste, es cuando los ejemplos de entrenamiento contienen ruido:

• valores de atributos erroneos, subjetivos

• clasificación equivocada

• valores desconocidos

Con ruido, se pueden tener dos ejemplos con los mismos valores de atributos, pero clase diferente. En presencia de ruı́do, el algoritmo básico (ID3)

tiende a construir árboles de decisión que son más grandes de lo necesario, y

no clasifican adecuadamente.

En el caso de árboles de decisión se tiene que decidir:

• cómo trabajar con atributos inadecuados

• cuándo al añadir atributos extra no mejora la predicción del árbol de

decisión

47

En general, podemos hablar de dos métodos utilizados para manejar ruido

(basados en la condición de terminación):

• pruning (o pre-pruning): cambiar el criterio de paro del árbol de decisión para “podar” ramas.

• post-pruning: “podar” ramas una vez construı́do el árbol.

Pruning: En este caso, lo que se tiene que decidir es cuándo parar o dejar

de construir el árbol a pesar de no tener hojas con ejemplos de una sola clase.

Se han propuesto técnicas usando un umbral de ganancia de información

(si no es mayor al umbral parar), técnicas usando validación cruzada (si no

mejora la clasificación con datos desconocidos parar) o medidas basadas en el

principio de longitud de descripión mı́nima (MDL). Si el utilizar el atributo

aumenta la medida de MDL entonces parar.

El problema principal es que en todos estos métodos el criterio de paro

está basado en información local. A pesar de que no se tengan buenos criterios

en un nodo, puede darse el caso que se puedan hacer buenas particiones en

sus descendientes.

Post-pruning: Esta es la técnica más utilizada, y algunos de los métodos

mencionados arriba se han utilizado para podar el árbol una vez ya construido.

Pasos:

1. Crece el árbol como antes (sólo verifica cuando se tienen ejemplos

iguales y clases diferentes).

2. “Poda” el árbol.

Los problemas que se enfrentan estas técnicas es cuál árbol podado considerar (pueden existir muchas opciones) y cómo estimar el error de clasificación

de los árboles.

48

El estimado de re-substitución está dado por la proporción de ejemplos

en el nodo mal clasificados si se toma la clase mayoritaria en el nodo. El

problema es que el árbol más grande nos dá la mejor clasificación.

Una de las técnicas más populares es hacer una estimación directa del

error por re-substitución (poda). Como se hace con los mismos datos, se

asume que los datos siguen una distribución Bernoulli (por ser unos cuantos

(< 100), la cual se aproxima a una Normal con muchos datos), y considerando

una estimación pesimista dentro de un nivel de confianza.

Para estimar errores se especifican niveles de confianza y las estadı́sticas

(media y varianza) se obtienen directamente de los datos y los valores de

tablas (e.g., z).

2.1.3

Ejemplo

Supongamos que medimos el error de un clasificador con datos de prueba, y

nos da 25%. Lo que nos gustaria saber es qué tan confiable es esa estimación.

Si obtenemos eso con 100 datos o con 10,000 claramente le vamos a creer

más a la estimación con los 10,000 datos.

En estadı́stica, un conjunto de eventos independientes se conoce como un

proceso Bernoulli (e.g., lanzar una moneda).

Podemos pensar en el porcentage de éxito, por lo que queremos saber es

qué tanto se acerca ese 75% de éxito al verdadedo porcentage de éxito.

Esto se expresa normalmente con intervalos de confianza.

Para 750 éxitos de 1,000 pruebas se tiene un 80% de confianza de que el

verdadero porcentage de éxito este entre 73.3% y 76.8%.

Para 75 éxitos de 100 pruebas el mismo 80% de confianza tiene un intervalo de 70% y 81%.

La media y la varianza de un proceso Bernoulli con porcentage de éxito

p son p y p(1 − p) respectivamente.

49

Tabla 2.3: Niveles de confianza de una distribución normal.

P r[X ≥ z] z

0.1%

3.09

0.5%

2.58

1%

2.33

5%

1.65

10%

1.28

20%

0.84

40%

0.25

Para N pruebas del proceso Bernoulli el porcentage de éxito es f = E/N

(E = número de éxitos), y la varianza se reduce por un factor N a p(1−p)/N

El valor de éxito se puede tomar como una variable aleatoria, con su

media y su varianza.

La probabilidad de que una variable aleatoria con media cero esté en un

intervalo de confianza de tamaño 2z es P r[−z ≤ X ≤ z] = c.

Para una distribución normal los valores de c y de z están dados en

tablas (ver tabla 2.3) que expresan la probabilidad de que X sea mayor a z

(P r[X ≥ z]).

Las tablas nos dan sólo una mitad, pero al ser simétrica la distribución

normal podemos considerar la mitad del intervalo que queremos y ese buscarlo en la tabla.

Las tablas asumen que se tiene una media 0 y varianza de 1 (z nos mide

las desviaciones estandar fuera de la media).

Osea que para un 5% nos dice que existe un 5% que la variable X se

encuentre a más de 1.65 desviaciones estandar arriba de la media, o un 10%

que esté 1.65 desviaciones estandar (arriba o abajo) de la media.

P r[−1.65 ≤ X ≤ 1.65] = 90%

Para cambiar a una media 0 y varianza

1 tenemos que restar la media p

q

y dividirlo por la deviación estandar p(1 − p)/N. Esto nos da:

50

f −p

≤ z] = c

P r[−z ≤ q

p(1 − p)/N

Para esto dado un nivel de confiaza c le restamos 1 y dividimos el resultado

entre 2 y consultamos la tabla.

Tenemos que encontrar una expresión para p. Después de cierta matemática

nos queda:

s

z2

f

f2

z2

z2

p = (f +

±z

−

+

)/(1

+

)

2N

N

N

4N 2

N

Esto nos da dos valores uno pesimista y otro optimista.

La distribución normal es válida sólo para valores grandes de N (e.g.,

N > 100).

Regresando a la poda de árboles. Como ya vimos, una forma es guardar

datos y usarlos para estimar estos errores. Otra posibilidad es usar los mismos

datos de entrenamiento para esta estimación, que es lo que hace C4.5.

El usar un estimado de éxito p o de error q es lo de menos, p + q = 1.

Como los valores obtenidos son de los datos de entrenamiento se usa el valor

pesimista que nos da:

s

f

f2

z2

z2

z2

+z

−

+

)/(1

+

)

p = (f +

2N

N

N

4N 2

N

Para ver como funciona esto, supongamos que tenemos el subárbol de la

figura 2.4.

Usamos c = 25% (z = 0.69). Para la rama izquierda tenemos 2 éxitos

de 6 casos, lo cual nos da una f = 0.33, Poniendo esto en la fórmula nos da

p = 0.47 (aquı́ se ve la parte pesimista ya que en lugar un 33% nos da un

47%). Para la rama de enmedio, tenemos 1 éxito de 2, lo cual nos da p = 72.

La rama de la derecha es igual a la izquierda.

51

Temp.

alta

2P

4N

baja

media

2P

1P

4N

1N

Figura 2.4: Subarbol de decisión.

La combinación de estos valores tomando en cuenta el porcentage de

ejemplos de cada uno, nos da 0.51.

Ahora para la clase mayoritaria del nodo tenemos f = 5/14 lo cual nos

da p = 0.46, que como es menor, entonces podamos esa rama.

Al cambiar el criterio de paro, podemos tener hojas con ejemplos de

diferentes clases. Posibles soluciones:

• que las clases tomen valores fraccionarios (p/(p+n))

• tomar la clase mayoritaria (mejor si se quiere minimizar el error esperado)

En general con poco nivel de ruido, se comportan bien. No conviene

quitarle ruido a los datos si se van a probar en ambientes ruidosos.

Análisis de Complejidad:

La complejidad de contruir un árbol es:

O(mnlogn) + O(n(logn)2)

52

Donde n es el número de datos y m el número de atributos.

El primer término se refiere a construir un árbol de decisión sin considerar

podado. El segundo término se refiere cuando realizamos podado. Esto es

independiente de que los atributos sean continuos o no.

2.1.4

Algunas Extensiones

Se han propuesto varias extensiones, como en lugar de hacer una búsqueda

tipo hill climbing usar beam search, o hacer búsqueda tipo look-ahead.

Una de las más populares es generar varios árboles de decisión y luego

combinar sus resultados. Esto se puede hacer en forma paralela a partir de

varias subconjuntos de los datos de entrenamiento (bagging), en forma secuencial considerando errores de clasificación y modificando los datos (boosting) o usando varias muestras de los datos de entrenamiento e introduciendo

aleatoriedad en la selección de atributos a considerar en cada nodo (random

forest).

2.1.5

Árboles de Regresión y de Modelos

Cuando la clase a predecir es numérica existen dos variantes:

• Regression trees: guardan el valor promedio de los valores en las hojas

• Model trees: utilizan una regresión lineal para predecir los valores de

las clases

Los dos tipos de árboles se construyen muy parecido a los árboles de

decisión para construir un árbol inicial.

En lugar de usar ganancia de información, seleccionan el atributo que

minimiza la variación entre subconjuntos de la clase en cada rama.

El criterio se basa en tratar la desviación estandar de la clase como una

medida de error de ese nodo y calcular la reducción esperada de error (stan53

dard deviation reduction) como resultado de probar cada atributo en ese

nodo.

SDR = destd(T ) −

X

i

Ti

× destd(Ti )

T

donde T1 , T2 , . . . son los conjuntos que resultan de dividir al nodo de

acuerdo

al atributo seleccionado y destd es desviación estandar (destd =

qP

Pn

n

2

i (x(i) − µ) /(n − 1), µ =

i x(i)/n).

El proceso termina o cuando se tienen muy pocas instancias en el nodo o

cuando la desviación estandar es una pequeña fracción (5%) de la desviación

estandar original de los datos.

Cuando se usa un árbol de modelos para predecir el valor normalmente

se construyen modelos lineales en cada nodo interno del árbol para suavizar

discontinuidades en las hojas.

Los valores predichos se suavizan combinando los valores predichos en

cada nodo. El proceso de suavizamiento usa la siguiente fórmula:

p′ =

np + kp

n+k

donde p′ es el nuevo valor suavizado que se pasa al nodo de arriba, p es

la predicción del nodo de abajo, q es el valor que se obtiene con el modelo

asociado al nodo, n es el número de instancias asociadas al nodo de abajo y

k es una constante.

Para valores desconocidos se ajusta la fórmula de reducción esperada de

error.

Para construir y probar un modelo con un valor desconocido, se usan dos

técnicas:

• Se reemplaza el valor del atributo por el valor del atributo más fuertemente correlacionado a él (surrogate splitting).

• Se utiliza el valor de la clase (para entrenamiento). Se cambia por el

valor promedio de los datos en ese nodo (para prueba).

54

Capı́tulo 3

Aprendizaje de Reglas

El aprendizaje de reglas normalmente produce resultados más fáciles de entender.

Splitting vs. Covering

La estrategia básica de la construcción de árboles de decisión se basa en

splitting, esto es, dividir el conjunto de datos en subconjuntos considerando

un atributo seleccionado por una heurı́stica particular. Aqui se consideran

todas las clases dentro de la partición.

La idea básica es añadir atributos al árbol que se esta construyendo buscando maximizar la separación entre las clases.

La estrategia utilizada para aprender reglas, está basada en covering, esto

es, encontrar condiciones de reglas (par atributo-valor) que cubra la mayor

cantidad de ejemplos de una clase, y la menor del resto de las clases. Se

considera el cubrir una sola clase.

La idea básica es añadir pruebas a cada regla que se esta construyendo

buscando maximizar covertura minimizando errores.

Las reglas pueden expresar disjunciones de manera más fácil que los