Procesamiento estadístico de señales

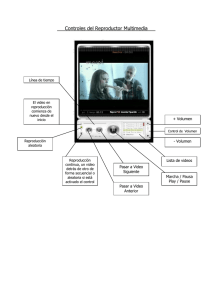

Anuncio

Procesamiento estadístico de señales Gastón Schlotthauer [email protected] Laboratorio de Señales y Dinámicas no Lineales – Facultad de Ingeniería Universidad Nacional de Entre Ríos http://pes2012.wikidot.com 2012 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Contenidos 1 Introducción 2 Vector aleatorio 3 Procesos Aleatorios 4 Estimación Gastón Schlotthauer FI-UNER - Bioingeniería 2012 2 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Contenidos 1 Introducción 2 Vector aleatorio 3 Procesos Aleatorios 4 Estimación Gastón Schlotthauer FI-UNER - Bioingeniería 2012 3 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 1 Introducción. Vectores aleatorios. Señales aleatorias a tiempo discreto. Matrices de correlación y covarianza. Esperanza y momentos. Tema 2 Diagonalización. SVD. Blanqueo. PCA. Ejemplos y aplicaciones. Tema 3 Filtros óptimos. Filtro de coincidencias. Aplicación a ECG. Filtros de Wiener. Principio de ortogonalidad. Formulaciones en tiempo y en frecuencia. Aplicación a reducción de ruido en habla Gastón Schlotthauer FI-UNER - Bioingeniería 2012 4 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 1 Introducción. Vectores aleatorios. Señales aleatorias a tiempo discreto. Matrices de correlación y covarianza. Esperanza y momentos. Tema 2 Diagonalización. SVD. Blanqueo. PCA. Ejemplos y aplicaciones. Tema 3 Filtros óptimos. Filtro de coincidencias. Aplicación a ECG. Filtros de Wiener. Principio de ortogonalidad. Formulaciones en tiempo y en frecuencia. Aplicación a reducción de ruido en habla Gastón Schlotthauer FI-UNER - Bioingeniería 2012 4 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 1 Introducción. Vectores aleatorios. Señales aleatorias a tiempo discreto. Matrices de correlación y covarianza. Esperanza y momentos. Tema 2 Diagonalización. SVD. Blanqueo. PCA. Ejemplos y aplicaciones. Tema 3 Filtros óptimos. Filtro de coincidencias. Aplicación a ECG. Filtros de Wiener. Principio de ortogonalidad. Formulaciones en tiempo y en frecuencia. Aplicación a reducción de ruido en habla Gastón Schlotthauer FI-UNER - Bioingeniería 2012 4 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 1 Introducción. Vectores aleatorios. Señales aleatorias a tiempo discreto. Matrices de correlación y covarianza. Esperanza y momentos. Tema 2 Diagonalización. SVD. Blanqueo. PCA. Ejemplos y aplicaciones. Tema 3 Filtros óptimos. Filtro de coincidencias. Aplicación a ECG. Filtros de Wiener. Principio de ortogonalidad. Formulaciones en tiempo y en frecuencia. Aplicación a reducción de ruido en habla Gastón Schlotthauer FI-UNER - Bioingeniería 2012 4 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 4 Filtros adaptativos. Filtro de máxima pendiente. Algoritmos LMS, RLS. Variantes. Tema 5 Filtro de Kalman. Tema 6 Algoritmos de proyección en subespacios. Reducción de ruido con SVD. Descomposición en autovalores (EVD). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 5 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 4 Filtros adaptativos. Filtro de máxima pendiente. Algoritmos LMS, RLS. Variantes. Tema 5 Filtro de Kalman. Tema 6 Algoritmos de proyección en subespacios. Reducción de ruido con SVD. Descomposición en autovalores (EVD). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 5 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 4 Filtros adaptativos. Filtro de máxima pendiente. Algoritmos LMS, RLS. Variantes. Tema 5 Filtro de Kalman. Tema 6 Algoritmos de proyección en subespacios. Reducción de ruido con SVD. Descomposición en autovalores (EVD). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 5 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 4 Filtros adaptativos. Filtro de máxima pendiente. Algoritmos LMS, RLS. Variantes. Tema 5 Filtro de Kalman. Tema 6 Algoritmos de proyección en subespacios. Reducción de ruido con SVD. Descomposición en autovalores (EVD). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 5 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 7 Métodos de estimación espectral : Métodos no paramétricos. Métodos paramétricos. Métodos de alta resolución basado en subespacios. Método de Pisarenko. Método MUSIC. Tema 8 Análisis de componentes independientes (ICA). Restricciones. Ejemplos. Tema 9 Descomposición Empírica en Modos (EMD). Transformada de Hilbert-Huang. Algoritmos asistidos por ruido. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 6 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 7 Métodos de estimación espectral : Métodos no paramétricos. Métodos paramétricos. Métodos de alta resolución basado en subespacios. Método de Pisarenko. Método MUSIC. Tema 8 Análisis de componentes independientes (ICA). Restricciones. Ejemplos. Tema 9 Descomposición Empírica en Modos (EMD). Transformada de Hilbert-Huang. Algoritmos asistidos por ruido. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 6 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 7 Métodos de estimación espectral : Métodos no paramétricos. Métodos paramétricos. Métodos de alta resolución basado en subespacios. Método de Pisarenko. Método MUSIC. Tema 8 Análisis de componentes independientes (ICA). Restricciones. Ejemplos. Tema 9 Descomposición Empírica en Modos (EMD). Transformada de Hilbert-Huang. Algoritmos asistidos por ruido. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 6 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Contenidos Tema 7 Métodos de estimación espectral : Métodos no paramétricos. Métodos paramétricos. Métodos de alta resolución basado en subespacios. Método de Pisarenko. Método MUSIC. Tema 8 Análisis de componentes independientes (ICA). Restricciones. Ejemplos. Tema 9 Descomposición Empírica en Modos (EMD). Transformada de Hilbert-Huang. Algoritmos asistidos por ruido. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 6 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Introducción Norbert Wiener 1894 - 1964 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 7 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Señales determinísticas La señal o serie temporal puede expresarse mediante una fórmula matemática explícita. (Salida de una fuente, oscilador, generador de señales). Señales portadoras de información Aleatorias(?) El grado de predictibilidad está determinado por la dependencia entre observaciones consecutivas. El caso máximo de aleatoriedad ocurre cuando cada muestra es independiente de todas las otras (ruido blanco). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 8 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Señales determinísticas La señal o serie temporal puede expresarse mediante una fórmula matemática explícita. (Salida de una fuente, oscilador, generador de señales). Señales portadoras de información Aleatorias(?) El grado de predictibilidad está determinado por la dependencia entre observaciones consecutivas. El caso máximo de aleatoriedad ocurre cuando cada muestra es independiente de todas las otras (ruido blanco). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 8 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Señales determinísticas La señal o serie temporal puede expresarse mediante una fórmula matemática explícita. (Salida de una fuente, oscilador, generador de señales). Señales portadoras de información Aleatorias(?) El grado de predictibilidad está determinado por la dependencia entre observaciones consecutivas. El caso máximo de aleatoriedad ocurre cuando cada muestra es independiente de todas las otras (ruido blanco). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 8 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Señales determinísticas La señal o serie temporal puede expresarse mediante una fórmula matemática explícita. (Salida de una fuente, oscilador, generador de señales). Señales portadoras de información Aleatorias(?) El grado de predictibilidad está determinado por la dependencia entre observaciones consecutivas. El caso máximo de aleatoriedad ocurre cuando cada muestra es independiente de todas las otras (ruido blanco). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 8 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Algunas aplicaciones Detección de señales en ruido. Ej. tonos puros, detección de QRS. Seguimiento de trayectoria de objetivos (tracking). Ej. radar, sonar, robótica. Modelización de sistemas. Ej. síntesis del habla. Estimación espectral. Separación (ciega) de fuentes. Ej. EEG, ECG materno - fetal, cocktail party. Descomposición en modos AM - FM. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 9 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Algunas aplicaciones Detección de señales en ruido. Ej. tonos puros, detección de QRS. Seguimiento de trayectoria de objetivos (tracking). Ej. radar, sonar, robótica. Modelización de sistemas. Ej. síntesis del habla. Estimación espectral. Separación (ciega) de fuentes. Ej. EEG, ECG materno - fetal, cocktail party. Descomposición en modos AM - FM. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 9 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Algunas aplicaciones Detección de señales en ruido. Ej. tonos puros, detección de QRS. Seguimiento de trayectoria de objetivos (tracking). Ej. radar, sonar, robótica. Modelización de sistemas. Ej. síntesis del habla. Estimación espectral. Separación (ciega) de fuentes. Ej. EEG, ECG materno - fetal, cocktail party. Descomposición en modos AM - FM. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 9 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Algunas aplicaciones Detección de señales en ruido. Ej. tonos puros, detección de QRS. Seguimiento de trayectoria de objetivos (tracking). Ej. radar, sonar, robótica. Modelización de sistemas. Ej. síntesis del habla. Estimación espectral. Separación (ciega) de fuentes. Ej. EEG, ECG materno - fetal, cocktail party. Descomposición en modos AM - FM. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 9 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Algunas aplicaciones Detección de señales en ruido. Ej. tonos puros, detección de QRS. Seguimiento de trayectoria de objetivos (tracking). Ej. radar, sonar, robótica. Modelización de sistemas. Ej. síntesis del habla. Estimación espectral. Separación (ciega) de fuentes. Ej. EEG, ECG materno - fetal, cocktail party. Descomposición en modos AM - FM. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 9 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Algunas aplicaciones Detección de señales en ruido. Ej. tonos puros, detección de QRS. Seguimiento de trayectoria de objetivos (tracking). Ej. radar, sonar, robótica. Modelización de sistemas. Ej. síntesis del habla. Estimación espectral. Separación (ciega) de fuentes. Ej. EEG, ECG materno - fetal, cocktail party. Descomposición en modos AM - FM. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 9 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesamiento estadístico de señales Algunas aplicaciones Detección de señales en ruido. Ej. tonos puros, detección de QRS. Seguimiento de trayectoria de objetivos (tracking). Ej. radar, sonar, robótica. Modelización de sistemas. Ej. síntesis del habla. Estimación espectral. Separación (ciega) de fuentes. Ej. EEG, ECG materno - fetal, cocktail party. Descomposición en modos AM - FM. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 9 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Definiciones Variable Aleatoria (VA) Una variable aleatoria X es una regla para asignar a cada salida ζ de un experimento S un número x = X(ζ). VVAA independientes e idénticamente distribuidas (iid) Si X1 , X2 , · · · , XN son variables aleatorias mutuamente independientes y cada variable aleatoria tiene la misma distribución de probabilidades, se dice que son iid. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 10 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Definiciones Variable Aleatoria (VA) Una variable aleatoria X es una regla para asignar a cada salida ζ de un experimento S un número x = X(ζ). VVAA independientes e idénticamente distribuidas (iid) Si X1 , X2 , · · · , XN son variables aleatorias mutuamente independientes y cada variable aleatoria tiene la misma distribución de probabilidades, se dice que son iid. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 10 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Repaso Función de distribución acumulada (cdf) def FX (x) = Pr {X ≤ x} Función densidad de probabilidades (pdf) def fX (x) = Gastón Schlotthauer dFX (x) dx FI-UNER - Bioingeniería 2012 11 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Momentos de una VA Media y varianza def Z mX = E {X} = ∞ −∞ xfX (x)dx def 2 varX = σX = E [X − mX ]2 Momento central de orden n (n) def γX n = E {[X − mX ] } = Gastón Schlotthauer Z ∞ −∞ (x − mX )n fX (x)dx FI-UNER - Bioingeniería 2012 12 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Variables Aleatorias Coeficiente de asimetría, oblicuidad (skewness) ( ) X − mX 3 1 def Skew = E = 3 γX(3) σX σX Si vale cero, la función densidad es simétrica alrededor de su valor medio. Si es positivo, la “cola” tiende a la derecha, si es negativa tiende a la izquierda. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 13 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Variables Aleatorias Coeficiente de asimetría, oblicuidad (skewness) ( ) X − mX 3 1 def Skew = E = 3 γX(3) σX σX Si vale cero, la función densidad es simétrica alrededor de su valor medio. Si es positivo, la “cola” tiende a la derecha, si es negativa tiende a la izquierda. 0.2 Skewness: 1 Skewness: -1 Skewness: 0 p(x) 0.15 0.1 0.05 0 0 5 Gastón Schlotthauer 10 15 x FI-UNER - Bioingeniería 20 25 30 2012 14 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Variable Aleatoria Curtosis (apuntamiento o concentración central) ( 4 ) 1 X − m def X − 3 = 4 γX(4) − 3 Curtosis = E σX σX Suele llamarse exceso de curtosis. Si es positiva, la función densidad tiene un pico más pronunciado que una normal. Si la curtosis es negativa, la función densidad es más aplanada que una normal. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 15 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Variable Aleatoria Curtosis (apuntamiento o concentración central) ( 4 ) 1 X − m def X − 3 = 4 γX(4) − 3 Curtosis = E σX σX Suele llamarse exceso de curtosis. Si es positiva, la función densidad tiene un pico más pronunciado que una normal. Si la curtosis es negativa, la función densidad es más aplanada que una normal. 0.7 Kurtosis: 0 Kurtosis: 3 Kurtosis:-1.2 0.6 0.5 p(x) 0.4 0.3 0.2 0.1 0 -10 -8 Gastón Schlotthauer -6 -4 -2 0 x 2 FI-UNER - Bioingeniería 4 6 8 10 2012 16 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Contenidos 1 Introducción 2 Vector aleatorio 3 Procesos Aleatorios 4 Estimación Gastón Schlotthauer FI-UNER - Bioingeniería 2012 17 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Definiciones Vector aleatorio Un vector aleatorio real X se define como: X1 X2 X = . . . XN con X1 , X2 , . . . , XN variables aleatorias reales. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 18 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Vectores aleatorios Definición Un vector aleatorio complejo X con componentes Xk = Xrk + Xik se define como: X = Xr + X Xi donde Xr y Xi son los vectores aleatorios reales Xr1 Xi1 Xr2 Xi2 Xr = . ; Xi = . .. .. Xr N Gastón Schlotthauer FI-UNER - Bioingeniería Xi N 2012 19 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Vectores aleatorios Representación de una serie temporal como vector aleatorio x[n] serie temporal definida para 0 ≤ n ≤ N − 1. x[0] x[1] x= .. . x[N − 1] Recordar que X es la función variable aleatoria y x es un valor numérico que toma X. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 20 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Caracterización de vectores aleatorios Función distribución multivariada Sea x un valor específico del vector aleatorio: x1 x2 x= . .. xN La probabilidad del evento X ≤ x, que se define como: X ≤ x : X1 ≤ x1 , X2 ≤ x2 , . . . , XN ≤ xN , es función de x y se conoce como la función distribución (multivariada) para el vector aleatorio X . def X ≤ x] FX (x) = P r [X Gastón Schlotthauer FI-UNER - Bioingeniería 2012 21 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Caracterización de vectores aleatorios Función densidad multivariada La función densidad se define como la derivada de la función distribución con respecto a todos los componentes del vector: fX (x) = ∂ ∂ ∂ ··· F (x) ∂X1 ∂X2 ∂XN X Ejemplo: función densidad gaussiana multivariada Para un vector aleatorio real x, esta función densidad tiene la siguiente forma: T 1 1 x−mX ) CX −1 (x−mX ) 2( fX (x) = e . (2π)N/2 |CX |1/2 donde N es la dimensión del vector aleatorio, mX es la media y CX la matriz de autocovarianza. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 22 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Contenidos 1 Introducción 2 Vector aleatorio 3 Procesos Aleatorios 4 Estimación Gastón Schlotthauer FI-UNER - Bioingeniería 2012 23 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesos Aleatorios Variable Aleatoria (VA) Una variable aleatoria X es una regla para asignar a cada salida ζ de un experimento S un número x = X(ζ). Proceso aleatorio o proceso estocástico Un proceso estocástico X(t) es una regla para asignar a cada ζ una función X(t, ζ). Un proceso estocástico es una familia de funciones del tiempo que dependen también del parámetro ζ. El dominio de ζ es el conjunto de todas las salidas del experimento y el dominio de t es un conjunto de números R ∈ R. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 24 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesos Aleatorios Variable Aleatoria (VA) Una variable aleatoria X es una regla para asignar a cada salida ζ de un experimento S un número x = X(ζ). Proceso aleatorio o proceso estocástico Un proceso estocástico X(t) es una regla para asignar a cada ζ una función X(t, ζ). Un proceso estocástico es una familia de funciones del tiempo que dependen también del parámetro ζ. El dominio de ζ es el conjunto de todas las salidas del experimento y el dominio de t es un conjunto de números R ∈ R. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 24 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesos Aleatorios Variable Aleatoria (VA) Una variable aleatoria X es una regla para asignar a cada salida ζ de un experimento S un número x = X(ζ). Proceso aleatorio o proceso estocástico Un proceso estocástico X(t) es una regla para asignar a cada ζ una función X(t, ζ). Un proceso estocástico es una familia de funciones del tiempo que dependen también del parámetro ζ. El dominio de ζ es el conjunto de todas las salidas del experimento y el dominio de t es un conjunto de números R ∈ R. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 24 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesos Aleatorios Tipos de procesos aleatorios Si R es el eje real, entonces X(t) es un proceso de tiempo continuo. Si R es el conjunto de enteros se trata de un proceso de tiempo discreto. En este caso indicaremos el proceso como X[n], con n ∈ Z. Un proceso aleatorio es un proceso de estados discretos si sus valores son contables. De otra forma es un proceso de estados continuos. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 25 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesos Aleatorios Tipos de procesos aleatorios Si R es el eje real, entonces X(t) es un proceso de tiempo continuo. Si R es el conjunto de enteros se trata de un proceso de tiempo discreto. En este caso indicaremos el proceso como X[n], con n ∈ Z. Un proceso aleatorio es un proceso de estados discretos si sus valores son contables. De otra forma es un proceso de estados continuos. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 25 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Procesos Aleatorios Tipos de procesos aleatorios Si R es el eje real, entonces X(t) es un proceso de tiempo continuo. Si R es el conjunto de enteros se trata de un proceso de tiempo discreto. En este caso indicaremos el proceso como X[n], con n ∈ Z. Un proceso aleatorio es un proceso de estados discretos si sus valores son contables. De otra forma es un proceso de estados continuos. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 25 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Momentos de un proceso aleatorio Serie de medias mX [n] = E {X[n]} . Serie de varianzas n o 2 σX [n] = E (X[n] − mX [n])2 . Gastón Schlotthauer FI-UNER - Bioingeniería 2012 26 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Momentos de un proceso aleatorio 4 x1[n] 2 0 -2 -4 0 5 10 15 20 25 30 0 5 10 15 20 25 30 0 5 10 15 n 20 25 30 4 x2[n] 2 0 -2 -4 4 x3[n] 2 0 -2 -4 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 27 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Momentos de un proceso aleatorio 4 x1[n] 2 0 -2 -4 0 5 10 15 20 25 30 0 5 10 15 20 25 30 0 5 10 15 n 20 25 30 4 x2[n] 2 0 -2 -4 4 x3[n] 2 0 -2 -4 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 28 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Correlación y covarianza de un proceso aleatorio Serie de correlación rX [n1 , n2 ] = E {X[n1 ]X ∗ [n2 ]} Serie de covarianza cX [n1 , n2 ] = E {(X[n1 ] − mX [n1 ]) (X[n2 ] − mX [n2 ])∗ } = E {X[n1 ]X ∗ [n2 ]} − E {X[n1 ]} E {X ∗ [n2 ]} = rX [n1 , n2 ] − mX [n1 ]m∗X [n2 ] Gastón Schlotthauer FI-UNER - Bioingeniería 2012 29 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Correlación y covarianza de un proceso aleatorio Serie de correlación rX [n1 , n2 ] = E {X[n1 ]X ∗ [n2 ]} Serie de covarianza cX [n1 , n2 ] = E {(X[n1 ] − mX [n1 ]) (X[n2 ] − mX [n2 ])∗ } = E {X[n1 ]X ∗ [n2 ]} − E {X[n1 ]} E {X ∗ [n2 ]} = rX [n1 , n2 ] − mX [n1 ]m∗X [n2 ] Gastón Schlotthauer FI-UNER - Bioingeniería 2012 29 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Correlación y covarianza de un proceso aleatorio Serie de correlación rX [n1 , n2 ] = E {X[n1 ]X ∗ [n2 ]} Serie de covarianza cX [n1 , n2 ] = E {(X[n1 ] − mX [n1 ]) (X[n2 ] − mX [n2 ])∗ } = E {X[n1 ]X ∗ [n2 ]} − E {X[n1 ]} E {X ∗ [n2 ]} = rX [n1 , n2 ] − mX [n1 ]m∗X [n2 ] Gastón Schlotthauer FI-UNER - Bioingeniería 2012 29 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Procesos estacionarios Un proceso aleatorio se dice que es estacionario en sentido estricto si la distribución de probabilidades no depende del tiempo. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 30 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Proceso aleatorio débilmente estacionario Un proceso aleatorio es estacionario en sentido amplio (WSS) o débilmente estacionario si su valor medio mX [n] no depende del tiempo y la autocovarianza (autocorrelación) cX [n1 , n2 ] (rX [n1 , n2 ]) depende solamente de la separación temporal entre muestras k = |n2 − n1 |. mX [n] = mX , cX [n1 , n2 ] = g[k], Gastón Schlotthauer −∞ < n < ∞ −∞ < n1 < ∞, −∞ < n2 < ∞ FI-UNER - Bioingeniería 2012 31 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Proceso aleatorio débilmente estacionario Un proceso aleatorio es estacionario en sentido amplio (WSS) o débilmente estacionario si su valor medio mX [n] no depende del tiempo y la autocovarianza (autocorrelación) cX [n1 , n2 ] (rX [n1 , n2 ]) depende solamente de la separación temporal entre muestras k = |n2 − n1 |. mX [n] = mX , cX [n1 , n2 ] = g[k], Gastón Schlotthauer −∞ < n < ∞ −∞ < n1 < ∞, −∞ < n2 < ∞ FI-UNER - Bioingeniería 2012 31 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Procesos ergódicos ¿Es posible estimar estadísticos a partir de promedios temporales? No podemos estimar mX si E {X[n]} depende de n. Si X[n] es WSS y: MX = N X 1 x[n], 2N + 1 n=−N observamos que MX es una VA. Si lı́m MX = mX , X[n] es ergódico en N →∞ la media. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 32 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Procesos ergódicos ¿Es posible estimar estadísticos a partir de promedios temporales? No podemos estimar mX si E {X[n]} depende de n. Si X[n] es WSS y: MX = N X 1 x[n], 2N + 1 n=−N observamos que MX es una VA. Si lı́m MX = mX , X[n] es ergódico en N →∞ la media. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 32 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Procesos ergódicos ¿Es posible estimar estadísticos a partir de promedios temporales? No podemos estimar mX si E {X[n]} depende de n. Si X[n] es WSS y: MX = N X 1 x[n], 2N + 1 n=−N observamos que MX es una VA. Si lı́m MX = mX , X[n] es ergódico en N →∞ la media. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 32 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios 4 x1[n] 2 0 -2 -4 0 5 10 15 20 25 30 0 5 10 15 20 25 30 0 5 10 15 n 20 25 30 4 x2[n] 2 0 -2 -4 4 x3[n] 2 0 -2 -4 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 33 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios 4 x1[n] 2 0 -2 -4 0 5 10 15 20 25 30 0 5 10 15 20 25 30 0 5 10 15 n 20 25 30 4 x2[n] 2 0 -2 -4 4 x3[n] 2 0 -2 -4 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 34 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Ejemplo Supongamos que la variable aleatoria Y tiene media mY y: X[n] = Y, mX = E {X[n]} = E {Y } = mY Sin embargo, cada realización del proceso X[n] tendrá un promedio temporal diferente de mY . X[n] NO es ergódico en la media. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 35 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Ejemplo Supongamos que la variable aleatoria Y tiene media mY y: X[n] = Y, mX = E {X[n]} = E {Y } = mY Sin embargo, cada realización del proceso X[n] tendrá un promedio temporal diferente de mY . X[n] NO es ergódico en la media. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 35 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Ejemplo Supongamos que la variable aleatoria Y tiene media mY y: X[n] = Y, mX = E {X[n]} = E {Y } = mY Sin embargo, cada realización del proceso X[n] tendrá un promedio temporal diferente de mY . X[n] NO es ergódico en la media. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 35 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Tipos de procesos aleatorios Procesos ergódicos Si lı́m rX [k] = 0 puede demostrarse que el proceso aleatorio X[n] es k→∞ ergódico en la autocorrelación, o ergódico de segundo orden. En este caso podemos estimar las series de autocovarianza y de autocorrelación con una sola realización. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 36 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza y momentos - caso vectorial Esperanza X ) una cantidad deducida de él. La Sea X un vector aleatorio y ψX (X X )} y se define por la operación: esperanza de ψX se escribe E {ψX (X Z∞ X )} = E {ψX (X ψX (x) fX (x)dx −∞ El primer momento o media de un vector aleatorio X se define por: Z ∞ def X} = mX = E {X xfX (x)dx. −∞ Gastón Schlotthauer FI-UNER - Bioingeniería 2012 37 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza y momentos - caso vectorial Matriz de Correlación La matriz de correlación RX representa el conjunto completo de momentos de segundo orden del vector aleatorio, y se define mediante: RX = E XX H . Esta matriz tiene la forma: E {X1 X1∗ } E {X2 X ∗ } 1 RX = .. . E {X1 X2∗ } E {X2 X2∗ } .. . E X1 XN∗ E X2 XN∗ .. . E {XN X1∗ } E {XN X2∗ } · · · E XN XN∗ ··· ··· ¿Qué espera que ocurra con RX en caso de un WSS? RX Toeplitz! Gastón Schlotthauer FI-UNER - Bioingeniería 2012 38 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza y momentos - caso vectorial Matriz de Correlación La matriz de correlación RX representa el conjunto completo de momentos de segundo orden del vector aleatorio, y se define mediante: RX = E XX H . Esta matriz tiene la forma: E {X1 X1∗ } E {X2 X ∗ } 1 RX = .. . E {X1 X2∗ } E {X2 X2∗ } .. . E X1 XN∗ E X2 XN∗ .. . E {XN X1∗ } E {XN X2∗ } · · · E XN XN∗ ··· ··· ¿Qué espera que ocurra con RX en caso de un WSS? RX Toeplitz! Gastón Schlotthauer FI-UNER - Bioingeniería 2012 38 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza y momentos - caso vectorial Matriz de Correlación La matriz de correlación RX representa el conjunto completo de momentos de segundo orden del vector aleatorio, y se define mediante: RX = E XX H . Esta matriz tiene la forma: E {X1 X1∗ } E {X2 X ∗ } 1 RX = .. . E {X1 X2∗ } E {X2 X2∗ } .. . E X1 XN∗ E X2 XN∗ .. . E {XN X1∗ } E {XN X2∗ } · · · E XN XN∗ ··· ··· ¿Qué espera que ocurra con RX en caso de un WSS? RX Toeplitz! Gastón Schlotthauer FI-UNER - Bioingeniería 2012 38 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza y momentos - caso vectorial Matriz de Covarianza La matriz de covarianza CX es el conjunto completo de momentos centrales de segundo orden del vector aleatorio, y se define mediante: X − mX )(X X − m X )H . CX = E (X Gastón Schlotthauer FI-UNER - Bioingeniería 2012 39 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza y momentos - caso vectorial Propiedades Tanto la matriz de correlación como la de covarianza tienen simetría Hermitiana: RX = RX H ; CX = CX H . Ambas matrices son semidefinidas positivas: aH RX a ≥ 0; aH CX a ≥ 0. para cualquier vector complejo a. En la mayoría de los casos reales la matriz de correlación es estrictamente definida positiva. Relación entre RX y CX : RX = CX + mX mX H . Gastón Schlotthauer FI-UNER - Bioingeniería 2012 40 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza conjunta: correlación y covarianza cruzada Si una cantidad ψXY depende de dos vectores aleatorios X e Y , su esperanza se define como: Z ∞Z ∞ E{ψXY (x, y)} = ψXY (x, y)fXY (x, y)dydx. −∞ −∞ Se define la matriz de correlación cruzada RXY : RXY = E X Y H y la matriz de covarianza cruzada: X − mX )(Y Y − mY )H CXY = E (X Gastón Schlotthauer FI-UNER - Bioingeniería 2012 41 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza conjunta: correlación y covarianza cruzada Si una cantidad ψXY depende de dos vectores aleatorios X e Y , su esperanza se define como: Z ∞Z ∞ E{ψXY (x, y)} = ψXY (x, y)fXY (x, y)dydx. −∞ −∞ Se define la matriz de correlación cruzada RXY : RXY = E X Y H y la matriz de covarianza cruzada: X − mX )(Y Y − mY )H CXY = E (X Gastón Schlotthauer FI-UNER - Bioingeniería 2012 41 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza conjunta: correlación y covarianza cruzada Si una cantidad ψXY depende de dos vectores aleatorios X e Y , su esperanza se define como: Z ∞Z ∞ E{ψXY (x, y)} = ψXY (x, y)fXY (x, y)dydx. −∞ −∞ Se define la matriz de correlación cruzada RXY : RXY = E X Y H y la matriz de covarianza cruzada: X − mX )(Y Y − mY )H CXY = E (X Gastón Schlotthauer FI-UNER - Bioingeniería 2012 41 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza conjunta: correlación y covarianza cruzada Se dice que dos vectores aleatorios X e Y no están correlacionados si: X } E Y H = mX mY H . RXY = E X Y H = E {X Esto es equivalente a decir que dos vectores aleatorios no están correlacionados si: X − mX )(Y Y − mY )H = 0. CXY = E (X Se dice que dos vectores aleatorios son ortogonales si: RXY = E XY H = 0. (El uso de la terminología no correlacionado cuando la covarianza cruzada es cero es desafortunada, pero convencional.) Gastón Schlotthauer FI-UNER - Bioingeniería 2012 42 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza conjunta: correlación y covarianza cruzada Se dice que dos vectores aleatorios X e Y no están correlacionados si: X } E Y H = mX mY H . RXY = E X Y H = E {X Esto es equivalente a decir que dos vectores aleatorios no están correlacionados si: X − mX )(Y Y − mY )H = 0. CXY = E (X Se dice que dos vectores aleatorios son ortogonales si: RXY = E XY H = 0. (El uso de la terminología no correlacionado cuando la covarianza cruzada es cero es desafortunada, pero convencional.) Gastón Schlotthauer FI-UNER - Bioingeniería 2012 42 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Esperanza conjunta: correlación y covarianza cruzada Se dice que dos vectores aleatorios X e Y no están correlacionados si: X } E Y H = mX mY H . RXY = E X Y H = E {X Esto es equivalente a decir que dos vectores aleatorios no están correlacionados si: X − mX )(Y Y − mY )H = 0. CXY = E (X Se dice que dos vectores aleatorios son ortogonales si: RXY = E XY H = 0. (El uso de la terminología no correlacionado cuando la covarianza cruzada es cero es desafortunada, pero convencional.) Gastón Schlotthauer FI-UNER - Bioingeniería 2012 42 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Contenidos 1 Introducción 2 Vector aleatorio 3 Procesos Aleatorios 4 Estimación Gastón Schlotthauer FI-UNER - Bioingeniería 2012 43 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación a partir de las muestras Histograma K es el número total de muestras, Kx es el número de muestras en el intervalo x < X ≤ x + ∆x. Si K → ∞ y ∆x → 0, entonces Kx /K y fX (x) ∆x son buenos estimadores de la probabilidad de que X esté en el intervalo dado y: fX (x) ∆x ' Kx /K. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 44 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación a partir de las muestras Histograma K es el número total de muestras, Kx es el número de muestras en el intervalo x < X ≤ x + ∆x. Si K → ∞ y ∆x → 0, entonces Kx /K y fX (x) ∆x son buenos estimadores de la probabilidad de que X esté en el intervalo dado y: fX (x) ∆x ' Kx /K. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 44 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación a partir de las muestras Si f (x) y ψ(x) varían poco sobre cada intervalo, la esperanza puede aproximarse como: E{ψ (x)} ' X ψ (x) fX (x) ∆x ' 1 X ψ (x) Kx . K ∀x ∀x En la última suma, si en cada intervalo x < X ≤ x + ∆x suponemos que para todas las muestras x(k) , k = 1, . . . , K que caen en este intervalo ψ(x(i) ) ' ψ (x), podemos escribir: E{ψ(x)} ' K 1 X (k) . ψ x K k=1 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 45 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación a partir de las muestras Si f (x) y ψ(x) varían poco sobre cada intervalo, la esperanza puede aproximarse como: E{ψ (x)} ' X ψ (x) fX (x) ∆x ' 1 X ψ (x) Kx . K ∀x ∀x En la última suma, si en cada intervalo x < X ≤ x + ∆x suponemos que para todas las muestras x(k) , k = 1, . . . , K que caen en este intervalo ψ(x(i) ) ' ψ (x), podemos escribir: E{ψ(x)} ' K 1 X (k) . ψ x K k=1 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 45 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación a partir de las muestras La estimación de la esperanza de una cantidad que involucra dos vectores aleatorios, a partir de las muestras x(1) , x(2) , . . . , x(K) y y(1) , y(2) , . . . , y(K) toma la forma: E {ψ(x, y)} ' K 1 X (k) (k) ψ x ,y . K k=1 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 46 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación a partir de las muestras Ejemplo 1 −2 2 0 (1) (2) (3) (4) x = , x = , x = , x = . 0 1 −2 2 Una estimación de la media puede calcularse como: K 1 X (k) 1 1 −2 2 0 m̂ = x = + + + = 0 1 −2 2 K 4 k=1 1 4 1 4 . Ejercicio Encuentre una estimación de la matriz de correlación K T P R̂X = K1 x(k) x(k) . k=1 Gastón Schlotthauer FI-UNER - Bioingeniería 2012 47 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Matriz de datos Para estimar la matriz de correlación de una manera más conveniente, definamos la matriz de datos: ← x(1)H → ← x(2)H → X= .. . ← x(K)H → (X tiene K filas y N columnas si tenemos K vectores de dimensión N ). Ahora podemos escribir más convenientemente la ecuación para estimar la matriz de correlación: 1 R̂X = XH X K Gastón Schlotthauer FI-UNER - Bioingeniería 2012 48 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Matriz de datos Para estimar la matriz de correlación de una manera más conveniente, definamos la matriz de datos: ← x(1)H → ← x(2)H → X= .. . ← x(K)H → (X tiene K filas y N columnas si tenemos K vectores de dimensión N ). Ahora podemos escribir más convenientemente la ecuación para estimar la matriz de correlación: 1 R̂X = XH X K Gastón Schlotthauer FI-UNER - Bioingeniería 2012 48 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Matriz de datos Volviendo al ejemplo anterior: 1 0 −2 1 X= 2 −2 0 2 (X tiene K filas y N columnas si tenemos K vectores de dimensión N ). La matriz de correlación estimada se calcula: 1 0 1 1 −2 2 0 −2 1 R̂X = 1 −2 2 2 −2 4 0 0 2 Gastón Schlotthauer FI-UNER - Bioingeniería 1 = 4 9 −6 −6 9 2012 49 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Matriz de datos Volviendo al ejemplo anterior: 1 0 −2 1 X= 2 −2 0 2 (X tiene K filas y N columnas si tenemos K vectores de dimensión N ). La matriz de correlación estimada se calcula: 1 0 1 1 −2 2 0 −2 1 R̂X = 1 −2 2 2 −2 4 0 0 2 Gastón Schlotthauer FI-UNER - Bioingeniería 1 = 4 9 −6 −6 9 2012 49 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la serie de autocorrelación En el caso ergódico, podemos estimar la función de autocorrelación a partir de una realización del proceso aleatorio: r̂X [k] = NX −1−k 1 x[n]x∗ [n + k] k = 0, 1, . . . , N − 1. N −k n=0 Atención: en MATLAB la función xcorr(x) utiliza por defecto la estimación sesgada de la correlación: r̂X [k] = NX −1−k x[n]x∗ [n + k] k = 0, 1, . . . , N − 1. n=0 Para obtener la estimación no sesgada debe utilizar: r=xcorr(x, ’unbiased’). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 50 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la serie de autocorrelación En el caso ergódico, podemos estimar la función de autocorrelación a partir de una realización del proceso aleatorio: r̂X [k] = NX −1−k 1 x[n]x∗ [n + k] k = 0, 1, . . . , N − 1. N −k n=0 Atención: en MATLAB la función xcorr(x) utiliza por defecto la estimación sesgada de la correlación: r̂X [k] = NX −1−k x[n]x∗ [n + k] k = 0, 1, . . . , N − 1. n=0 Para obtener la estimación no sesgada debe utilizar: r=xcorr(x, ’unbiased’). Gastón Schlotthauer FI-UNER - Bioingeniería 2012 50 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la serie de autocorrelación En el caso ergódico, podemos estimar la función de autocorrelación a partir de una realización del proceso aleatorio: NX −1−k 1 x[n]x∗ [n + k] k = 0, 1, . . . , N − 1. r̂X [k] = N −k n=0 Compruebe las diferencias entre: [r, l]=xcorr(x, x) [ru, l]=xcorr(x, x, ’unbiased’) [rb, l]=xcorr(x, x, ’biased’) [rc, l]=xcorr(x, x, ’coeff’) Gastón Schlotthauer FI-UNER - Bioingeniería 2012 51 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Método de la autocorrelación Dado el proceso X[n] estacionario y ergódico, podemos estimar la matriz de autocorrelación R̂X = N1 XH X, de tamaño P × P , con X de tamaño (N + P − 1) × P dada por: x[0] 0 ··· 0 x[1] x[0] ··· 0 .. .. .. . . . X = x[N − 1] x[N − 2] · · · x[N − P ] .. .. .. . . . .. 0 0 . x[N − 1] Gastón Schlotthauer FI-UNER - Bioingeniería 2012 52 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Propiedades del método de autocorrelación R̂X es Toeplitz. Estrictamente definida positiva (las columnas de X son LI). Supone que los datos son cero fuera del rango 0 ≤ n ≤ N − 1 y por lo tanto estará siempre sesgada. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 53 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Método de la covarianza Dado el proceso X[n] estacionario y ergódico, definimos X de tamaño (N − P + 1) × P dada por: x[P − 1] x[P − 2] · · · x[0] x[P ] x[P − 1] · · · x[1] X= .. .. .. . . . x[N − 1] x[N − 2] · · · x[N − P ] Construimos la estimación de la matriz de correlación mediante: R̂X = Gastón Schlotthauer 1 XH X. N −P +1 FI-UNER - Bioingeniería 2012 54 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Propiedades del método de covarianza La estimación no está sesgada. R̂X es semidefinida positiva La estimación no es Toeplitz. Estimaciones a partir de la serie de autocorrelación no sesgada, resultan en matrices de autocorrelación que no son definidas positivas y no suelen utilizarse. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 55 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Propiedades del método de covarianza La estimación no está sesgada. R̂X es semidefinida positiva La estimación no es Toeplitz. Estimaciones a partir de la serie de autocorrelación no sesgada, resultan en matrices de autocorrelación que no son definidas positivas y no suelen utilizarse. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 55 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Caso ergódico: una sola realización Se observa la relación entre la matriz de autocorrelación rX [n] : rX [0] rX [−1] r [1] rX [0] X R̂X = . .. .. . rX [p] rX [p − 1] autocorrelación RX y la serie de ··· rX [−p] · · · rX [−p + 1] .. . ··· rX [0] Con MATLAB [r, k]=xcorr(x,N,’biased’); r tiene 2N + 1 elementos, y k=-N:N. Tomamos los valores del retardo k entre 0 y P < N y estimamos la matriz de autocorrelación mediante: R=toeplitz(r(N+1:N+P)); Gastón Schlotthauer FI-UNER - Bioingeniería 2012 56 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Caso ergódico: una sola realización Se observa la relación entre la matriz de autocorrelación rX [n] : rX [0] rX [−1] r [1] rX [0] X R̂X = . .. .. . rX [p] rX [p − 1] autocorrelación RX y la serie de ··· rX [−p] · · · rX [−p + 1] .. . ··· rX [0] Con MATLAB [r, k]=xcorr(x,N,’biased’); r tiene 2N + 1 elementos, y k=-N:N. Tomamos los valores del retardo k entre 0 y P < N y estimamos la matriz de autocorrelación mediante: R=toeplitz(r(N+1:N+P)); Gastón Schlotthauer FI-UNER - Bioingeniería 2012 56 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Caso ergódico: una sola realización Se observa la relación entre la matriz de autocorrelación rX [n] : rX [0] rX [−1] r [1] rX [0] X R̂X = . .. .. . rX [p] rX [p − 1] autocorrelación RX y la serie de ··· rX [−p] · · · rX [−p + 1] .. . ··· rX [0] Con MATLAB [r, k]=xcorr(x,N,’biased’); r tiene 2N + 1 elementos, y k=-N:N. Tomamos los valores del retardo k entre 0 y P < N y estimamos la matriz de autocorrelación mediante: R=toeplitz(r(N+1:N+P)); Gastón Schlotthauer FI-UNER - Bioingeniería 2012 56 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Estimación de la matriz de autocorrelación Usando Matlab [X, R] = corrmtx(x,m,’autocorrelation’); [X, R] = corrmtx(x,m,’covariance’); Gastón Schlotthauer FI-UNER - Bioingeniería 2012 57 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Próxima clase Contenidos Diagonalización. SVD. Blanqueo. PCA. Ejemplos y aplicaciones. Conceptos previos necesarios Elementos básicos de álgebra lineal: autovalores, autovectores, base, transformaciones. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 58 / 58 Introducción Variable Aleatoria Vector aleatorio Procesos Aleatorios Estimación Próxima clase Contenidos Diagonalización. SVD. Blanqueo. PCA. Ejemplos y aplicaciones. Conceptos previos necesarios Elementos básicos de álgebra lineal: autovalores, autovectores, base, transformaciones. Gastón Schlotthauer FI-UNER - Bioingeniería 2012 58 / 58