Particulas Brownianas de Yukawa en capas planas: un modelo de

Anuncio

Centro de Investigación y de Estudios Avanzados

del

Instituto Politécnico Nacional

DEPARTAMENTO DE FISICA

Coloides en capas planas paralelas: un

modelo de control coloidal

Tesis que presenta

Claudio Contreras Aburto

para obtener el Grado de

Doctor en Ciencias

en la Especialidad de

Física

Director de tesis: Dr. José Miguel Méndez Alcaraz

México, Distrito Federal

Diciembre, 2008.

“Colloids in parallel planar layers: A model for colloidal control”

Abstract

Colloidal dispersions are a special case of soft condensed matter we usually find every

day. They are excellent models of the mesoscopic world, where length scale interplay,

time scale separation, effective interactions, hydrodynamic interactions, and memory

effects are fundamental concepts. Given the relevance of these systems, it is imperative to

develop methods to control them, either by confining them or by means of an external

field.

In this work we systematically study the effective interaction potentials, as well as the

collective and cooperative memory functions, of model colloidal systems composed of

Yukawa particles contained in parallel planar layers. We demonstrate that this special

geometry allows for the separation between layer to be an excellent control parameter for

the effective interaction and memory functions, and, therefore, for the structural and

transport properties of the system. In order to carry out our calculations, we implement

Brownian dynamics computer simulations, apply integral equations theory of simple

liquids, mode-coupling theory in Smoluchowski dynamics, and solve for the memory in

the memory equation by using the cosine and sine transforms. Effective potentials were

accounted for by a contraction of the description in the framework of the integral

equations theory of simple liquids. We also studied the memory functions of

paramagnetic two-dimensional colloids.

Among other not less important technical aspects, we found that the control induced in

the layered system is so strong, that we can induce an effective attraction between like

charged colloids. Comparisons between theory and simulation allowed us to see that

HNC is not a good approximation when calculating effective potentials in confined

systems. Regarding the memory functions, we obtained a new mathematical model for

collective and cooperative memory functions. This model consists of an infinite time

series with only three adjustable parameters. Comparison between the convolution

approximation, in the mode-mode-coupling theory (MMC), with simulations, shows that

MMC predicts memory functions that decay faster than the memories predicted by the

simulations.

“Coloides en capas planas paralelas: Un modelo de control coloidal”

Resumen

Las dispersiones coloidales son una clase de materia condensada blanda que encontramos

comúnmente en nuestra vida diaria. Como sistemas modelo, los coloides nos auxilian en

el desarrollo de descripciones en la mesoescala, en donde, la combinación de escalas de

longitud, la separación de escalas de tiempo, las interacciones efectivas e hidrodinámicas

y los efectos de memoria, son conceptos fundamentales. Dada la importancia de estos

sistemas, resulta imperante desarrollar modelos que nos permitan aprender a controlarlos,

ya sea mediante alguna condición de confinamiento, o mediante un campo externo.

En este trabajo, un estudio sistemático de los potenciales efectivos y de las funciones de

memoria colectiva y cooperativa, de un sistema coloidal modelo compuesto de coloides

de Yukawa distribuidos sobre capas planas paralelas es realizado. Mostramos que esta

geometría permite que la separación entre las capas sea un excelente parámetro de control

del potencial efectivo y de las funciones de memoria y, consecuentemente, de las

propiedades estructurales y de transporte de estos sistemas. Para realizar nuestros

cálculos, implementamos simulaciones por computadora de dinámica browniana sin

interacciones hidrodinámicas, aplicamos la teoría de ecuaciones integrales de los líquidos

simples, la teoría de acoplamiento de modos en la dinámica de Smoluchowski e

invertimos la ecuación de memoria mediante el par de transformaciones seno y coseno.

Los potenciales efectivos de interacción fueron evaluados por medio de una contracción

de la descripción en el marco de la teoría de ecuaciones integrales de los líquidos simples.

Las funciones de memoria también fueron calculadas para sistemas bidimensionales de

coloides paramagnéticos.

Entre otros aspectos técnicos no menos importantes, obtuvimos que el tipo de control que

puede ejercerse en estos sistemas consigue ser lo suficientemente fuerte como para

inducir una atracción efectiva entre partículas igualmente cargadas. En este aspecto, la

comparación entre teoría y simulación nos permitió emitir juicios sobre la validez de la

aproximación HNC para calcular potenciales efectivos en sistemas confinados. En cuanto

a las funciones de memoria, obtuvimos un nuevo modelo matemático para la función de

memoria. Este modelo consiste en una serie infinita de lorentzianas con solamente tres

parámetros de ajuste. Además, la comparación entre la teoría de modos acoplados en la

aproximación de convolución, con los resultados de simulación, muestran que la teoría

de modos acoplados predice memorias que decaen mucho más rápido que las memorias

obtenidas con la simulación.

Agradecimientos.

Agradezco a Conacyt por la beca 172596 que me otorgó para poder realizar estos

estudios de doctorado en ciencias.

A Cinvestav por todos los apoyos que me otorgó durante mi estancia en esta institución.

A los sinodales de esta tesis por sus valiosos comentarios. En especial al Dr. José

Méndez, por dirigir éste trabajo pacientemente.

A todos aquellos amigos que he tenido a lo largo de mi etapa como estudiante.

A la familia Cortina Bello, por ser como mi familia desde hace ya unos 20 años.

A mi padre Anselmo Contreras y a mi tutor Ezequiel Cortina, cuyas enseñanzas me

permitieron seguir de pie ante las adversidades. En memoria de ellos dedico éste humilde

trabajo.

Potenciales efectivos y funciones de memoria en

dispersiones coloidales

Coloides en capas planas paralelas: un

modelo de control coloidal

Claudio Contreras Aburto

Departamento de Física, Cinvestav

Febrero, 2005 – Diciembre, 2008

Índice general

Índice de figuras

V

1. Introducción

1

2. Generalidades

2.1. Dispersiones coloidales . . . . . . . . . . . . . . . . . . . . . . . . . . .

2.2. Potenciales efectivos y funciones de memoria . . . . . . . . . . . . . . .

7

7

9

3. Marco teórico y conceptual

3.1. Potenciales efectivos . . . . . . . . . . . . . . . . . . . . . . . . . . .

3.1.1. Estructura estática de dispersiones coloidales . . . . . . . . . .

3.1.1.1. Potencial DLVO . . . . . . . . . . . . . . . . . . . .

3.1.1.2. Funciones de estructura estática . . . . . . . . . . . .

3.1.1.3. Funciones de estructura estática en mezclas . . . . .

3.1.1.4. Función de correlación directa y función puente . . .

3.1.2. Función de correlación directa efectiva . . . . . . . . . . . . .

3.1.3. Potenciales efectivos como una contracción de la descripción .

3.2. Funciones de memoria . . . . . . . . . . . . . . . . . . . . . . . . . .

3.2.1. Variables dinámicas y correlaciones espacio-temporales . . . .

3.2.2. Operadores de proyección . . . . . . . . . . . . . . . . . . . .

3.2.3. Movimiento browniano . . . . . . . . . . . . . . . . . . . . . .

3.2.4. Funciones de autocorrelación en la dinámica de Smoluchowski

3.2.5. Ecuación de Langevin generalizada . . . . . . . . . . . . . . .

3.2.6. Estructura dinámica de suspensiones coloidales . . . . . . . .

3.2.7. Función de memoria y difusión colectiva . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

13

13

14

14

15

18

19

21

23

25

26

27

29

35

39

41

42

4. Estudios previos sobre los efectos de memoria

4.1. Efectos de memoria: Dinámica de Liouville . . . . . . . . . . . . .

4.2. Efectos de memoria: Dinámicas disipativas . . . . . . . . . . . . .

4.2.1. Dinámica de Smoluchowski I . . . . . . . . . . . . . . . .

4.2.2. Hidrodinámica generalizada y aproximación viscoelástica .

4.2.3. Hidrodinámica generalizada y teorema de estacionaridad .

4.2.4. Dinámica de Smoluchowski II. Teoría de modos acoplados

4.2.4.1. Ideas generales . . . . . . . . . . . . . . . . . . .

4.2.4.2. Acoplamiento de modos en dispersiones coloidales

4.2.5. Otros estudios . . . . . . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

47

48

50

50

58

62

69

70

75

78

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

iii

Índice general

IV

5. Estructura estática de coloides en capas planas

5.1. Sistema, simulación, escalas y potencial por pares

5.2. Estructura . . . . . . . . . . . . . . . . . . . . . .

5.2.1. Notación . . . . . . . . . . . . . . . . . . .

5.2.2. Dos capas . . . . . . . . . . . . . . . . . .

5.2.3. Tres capas . . . . . . . . . . . . . . . . . .

5.2.3.1. Una especie . . . . . . . . . . . .

5.2.3.2. Dos especies . . . . . . . . . . . .

6. Potenciales efectivos

6.1. Introducción . . . . . .

6.2. Sistemas de dos capas

6.3. Sistemas de tres capas

6.3.1. Una especie . .

6.3.2. Dos especies . .

6.4. Comentarios finales . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

7. Funciones de memoria en dos dimensiones.

7.1. Introducción . . . . . . . . . . . . . . . . . . . . . . . . .

7.2. Efecto de las interacciones directas y de la concentración

7.2.1. Función intermedia de dispersión . . . . . . . . .

7.2.2. Función de memoria . . . . . . . . . . . . . . . .

7.2.3. Modelo lorentziano . . . . . . . . . . . . . . . . .

7.2.4. Modelo hipergeométrico gaussiano . . . . . . . . .

7.3. Dependencia en el número de onda y en la frecuencia . .

7.4. Teoría de modos acoplados . . . . . . . . . . . . . . . . .

7.5. Sistemas bidimensionales de coloides paramagnéticos. . .

7.6. Dinámica colectiva de sistemas en capas: dos capas y una

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

. . . . .

especie

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

81

81

84

84

88

92

92

97

.

.

.

.

.

.

101

101

104

108

109

110

111

.

.

.

.

.

.

.

.

.

.

113

114

115

115

118

124

129

134

139

147

150

8. Conclusiones y perspectiva de este trabajo

155

Bibliografía

159

Índice de figuras

1.1. Tres capas de partículas coloidales. La figura ilustra a uno de los sistemas

estudiados en este trabajo. Las esferitas representan a los coloides. Los centros

de las esferitas definen planos paralelos al plano xy. Los planos trazados en la

figura son imaginarios y solamente funcionan como una guía para el ojo. . .

3

2.1. Coloides en caricatura. Ilustración del entorno de una partícula coloidal rodeada de muchas otras partículas coloidales más pequeñas. El solvente se ilustra

como el fondo rugoso. Los símbolos + y - representan a los iones libres. Los iones libres provienen de la disolución de una sal en el solvente y de los radicales

que se disocian de los coloides. . . . . . . . . . . . . . . . . . . . . . . .

8

3.1. Interpretación (3.5) de la función de distribución de un líquido coloidal bidimensional. La figura es una “fotografía” de una capa de uno de los sistemas

estudiados en este trabajo. El origen del sistema coordenado se toma en la

posición instantánea de una partícula arbitraria. El radio vector r es el radio medio del anillo de longitud dr y área da. Dada la densidad numérica

microscópica de partículas n, la g(r) nos proporciona el número promedio de

partículas que caen dentro del anillo. . . . . . . . . . . . . . . . . . . . . .

3.2. Ejemplo de función de distribución. La figura ilustra la función de distribución

del sistema en la figura 3.1. La escala σ es el diámetro de las partículas. Esta

función nos dice que cada coloide ve con mucha frecuencia a otro coloide a

una distancia 2σ respecto a él. Por otro lado, cuando ve a distancias muy

lejanas, solamente ve una distribución homogénea de partículas pues en ese

caso g(r) = 1. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

5.1. Ilustración de un sistema de q capas bidimensionales abiertas y planas.

Todas las capas serán paralelas al plano xy. Se considerará solamente el

caso za+1 − za = `, siendo za la coordenada z de la capa a. Cada capa

estará compuesta de un solo tipo de coloides, aunque distintas capas

podrían constituirse de distintos tipos de coloides. A los “distintos tipos”

los llamaremos especies. Todos los coloides serán esféricos y tendrán el

mismo diámetro, aunque podrán tener distinta carga. Todo el espacio

estará caracterizado por un parámetro de apantallamiento constante. Los

coloides no podrán saltar de una a otra capa. La numeración de las capas

será desde el z menor hasta el z mayor y solamente consideraremos q = 2

y q = 3. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

16

17

81

v

VI

Índice de figuras

11

22

5.2. Función de distribución radial g11

(r) = g11

(r)√de un sistema de dos

1,2

capas y una especie con los parámetros A1 = 50, b = 1, x11,2 = 0.5 y

σ = 0.357. Se muestran los resultados para tres valores distintos de la

distancia entre capas `. El inset muestra al factor de estructura estática

para ` = 1.2σ. Los símbolos muestran los resultados de simulación BD y

las lineas los que se obtienen resolviendo numéricamente OZ con HNC,

mediante el método numérico de Ng [123]. . . . . . . . . . . . . . . . .

88

12

21

5.3. Función de distribución radial cruzada g11

(r) = g11

(r) en el sistema de

dos capas introducido en la figura 5.2. El inset muestra la variación de la

altura del máximo principal con la distancia entre las capas `. Note como

la correlación cruzada varía no monotónicamente con `. Inicia aumentando en ` = 0 hasta alcanzar su máximo en ` = σ y luego disminuye hasta

el valor del gas ideal. Como se mostró en [1], este efecto de aumento de

correlación, reduce el coeficiente de autodifusión de tiempos largos. . .

89

5.4. Factores de estructura estática parciales del sistema de dos capas y una

11

especie introducido en la figura 5.2. Las lineas negras representan a S11

=

21

12

22

S11 y las grises a S11 = S11 . Se muestran resultados para dos valores

distintos de `. Las lineas segmentadas corresponden a ` = 1.2σ y las

líneas sólidas a ` = 1.5σ. . . . . . . . . . . . . . . . . . . . . . . . . . .

90

5.5. Funciones de distribución√de un sistema de tres capas y una especie con

= 50, b = 1, x11,3 = 0.25, x21 = 0.5 y σ = 0.357.

los parámetros A1,2,3

1

22

33

11

. Se muestran los resultados para

(r); en (b): g11

(r) = g11

En (a): g11

tres valores distintos de la distancia entre capas `: lineas continuas para

` = σ, lineas segmentadas para ` = 2σ y lineas de puntos para ` = 5σ. .

93

12

21

23

5.6. Funciones de distribución radial cruzadas g11

(r) = g11

(r) = g11

(r) =

32

13

31

g11 (r) en (a) y g11 (r) = g11 (r) en (b), que corresponden al sistema de

tres capas y una especie en la figura 5.5. Se muestran los resultados para

lo mismos valores de `: linea continua para ` = σ, linea segmentada para

` = 2σ y linea de puntos para ` = 5σ. Nótese la correlación positiva en

r = 0 para ` = 2σ lo cual indica que, en términos efectivos, existe una

atracción entre coloides con cargas iguales. . . . . . . . . . . . . . . . .

94

11

33

5.7. Factores de estructura estática de índices iguales S11

(k) = S11

(k) en (a)

22

y S11 (k) en (b), del sistema de tres capas en la figura 5.5. Se muestran

los resultados para los mismos tres valores de la distancia entre capas

`: linea continua para ` = σ, linea segmentada para ` = 2σ y linea de

puntos para ` = 5σ. . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

95

12

21

5.8. Factores de estructura estática de índices distintos S11

(k) = S11

(k) =

23

32

13

31

S11 (k) = S11 (k) en (a) y S11 (k) = S11 (k) en (b), del sistema de tres

capas en la figura 5.5. Se muestran los resultados para los mismos tres

valores de la distancia entre capas `: linea continua para ` = σ, linea

segmentada para ` = 2σ y linea de puntos para ` = 5σ. . . . . . . . . .

96

Índice de figuras

22

5.9. Funciones de distribución radial de los coloides en la capa interna g√

22 (r)

1,3

en un sistema

de tres capas y dos especies con los parámetros A1 = 50,

√

1,3

2

2

A22 = − 30, A1,3

2 = A1 = 0, b = 1, x1 = 0.25, x1 = 0.5 y σ = 0.357.

Se muestran los resultados para cuatro valores distintos de la distancia

entre capas `: linea gris continua para ` = σ, linea negra continua para

` = 1.5σ, linea gris dash para ` = 2σ y linea negra dash para ` = 5σ.

El inset es una fotografía de la capa interna, correspondiente al caso

` = 1.5σ. A escala, el tamaño de los círculos representa alrededor de 3/4

del tamaño real de los coloides. . . . . . . . . . . . . . . . . . . . . . .

13

5.10. Funciones de distribución radial de partículas en capas distintas g11

(r) =

31

12

21

23

32

g11 (r) en el recuadro principal y g12 (r) = g21 (r) = g21 (r) = g12 (r) en el

inset, del sistema de tres capas y dos especies en la figura 5.9. Se muestran

los resultados para cuatro valores distintos de la distancia entre capas

`: círculos transparentes para ` = σ, triángulos transparentes ` = 1.5σ,

triángulos opacos ` = 2σ y círculos opacos ` = 5σ. . . . . . . . . . . . .

5.11. Factores de estructura estática parciales en el caso ` = 1.5σ correspondientes al sistema de 3 capas y dos especies en la figura 5.9. En línea

22

33

11

, en linea gris

, en linea negra segmentada S22

= S11

negra continua S11

31

13

32

23

21

12

. .

= S11

continua S12 = S21 = S21 = S12 y en linea gris segmentada S11

11

11eff

6.1. Transformación Fourier-Bessel ∆u11

11 (k) = u11 (k) − u11 (k), correspondiente al sistema efectivo bidimensional que resulta de la primera

√ y única

reducción en el sistema de dos capas y una especie con A11,2 = 50, b = 1,

x1,2

1 = 0.5 y σ = 0.357. Este sistema se introdujo en la sección 5.2.2. . .

11

11eff

= 0 y (b) el co− B11

6.2. (a) Potencial efectivo en la aproximación B11

11

rrespondiente ∆u11 , del sistema dos capas y una especie en la figura

6.1. Las lineas representan los resultados que se obtienen con la solución

numérica del esquema OZ+HNC obtenidos por Castañeda Priego. Los

símbolos representan los resultados que se obtienen al usar los factores

de estructura que fueron calculados directamente de la simulación, como

se especificó en la sección 5.2. . . . . . . . . . . . . . . . . . . . . . . .

6.3. Comparación entre las funciones de distribución del sistema de dos capas

y una especie de la figura 6.1 (identificadas como BD, ya que se obtuvieron mediante dinámica browniana), con las del sistema bidimensional

de coloides que interactúan a través del potencial efectivo en la primera,

y única, contracción (identificadas como MC, ya que se obtuvieron mediante Monte Carlo). Se muestran los resultados para dos valores de `.

Notemos que la región de discrepancia se localiza principalmente alrededor de máximo principal, precisamente donde los efectos de las funciones

puente empiezan a tomar relevancia. . . . . . . . . . . . . . . . . . . .

13

31

6.4. Funciones de distribución radial g11

(r) = g11

(r)

√ del sistema de1,3tres capas

1,2,3

y una especie con los parámetros A1

= 50, b = 1, x1 = 0.25,

2

13

x1 = 0.5 y σ = 0.357. El inset muestra la variación con ` de g11

(r = 0)

en un sistema de tres capas y una especie similar pero con x1,3

1 = 3/8,

2

x1 = 2/8. Este segundo sistema se presentó en [1]. . . . . . . . . . . . .

VII

97

98

99

104

106

107

108

VIII

Índice de figuras

6.5. Potenciales efectivos entre las partículas de las capas externas, que se

obtienen por eliminación de la capa interna en la descripción del sistema

de tres capas y una especie de la figura 6.4. Las lineas negras muestran

13

los potenciales efectivos ueff

(1) 11 para ` = 1σ en linea continua, ` = 2σ

en linea segmentada y ` = 5σ en linea punteada. Las lineas grises en

trazos correspondientes muestran los potenciales por pares u(0) 13

11 . El inset

13

muestra el término de corrección ∆u(0) 11 . . . . . . . . . . . . . . . . . .

6.6. Potencial efectivo entre los coloides internos que se obtiene eliminando

las capas 1 y 3 en la descripción del sistema de tres capas y dos espe22

cies de la figura 5.9. La linea negra muestra al potencial efectivo ueff

(2) 22

para ` = 1.5σ, mientras que la linea gris muestra el potencial por pares

22

eff 22

correspondiente u(0) 22

22 . El inset muestra a u(2) 22 − u(0) 22 . . . . . . . . .

7.1. Variación de la función intermedia de dispersión F (kmax , t) con la concentración, en un sistema de coloides que interactúan débilmente. . . .

7.2. Variación de la función intermedia de dispersión F (kmax , t) con la concentración, en un sistema de coloides que interactúan moderadamente. .

7.3. Variación de la función intermedia de dispersión F (kmax , t) con el alcance

del potencial, en un sistema de coloides moderadamente interactuantes.

7.4. Variación de la función intermedia de dispersión F (kmax , t) con la intensidad de interacción, a alcance y concentración moderadas. . . . . . . .

7.5. Variación con la concentración en un sistema débilmente interactuante,

de la transformación Fourier coseno MC (kmax , z) de la función de memoria . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.6. Variación con la concentración en un sistema moderadamente interactuante, de la transformación Fourier coseno MC (kmax , z) de la función

de memoria. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.7. Variación con el alcance del potencial, en un sistema moderadamente

interactuante, de la transformación Fourier coseno MC (kmax , z). . . . .

7.8. Variación con la intensidad de interacción de la transformación Fourier

coseno MC (kmax , z), en un sistema moderadamente denso. . . . . . . .

7.9. Variación de la función de memoria M (kmax , t) con la concentración, en

un sistema de coloides débilmente interactuantes. . . . . . . . . . . . .

7.10. Variación de la función de memoria M (kmax , t) con la concentración, en

un sistema de coloides moderadamente interactuantes. . . . . . . . . .

7.11. Variación de la función de memoria M (kmax , t), con el alcance del potencial, en un sistema medianamente denso de coloides moderadamente

interactuantes. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.12. Variación de la función de memoria M (kmax , t), con la intensidad de

interacción, en una dispersión coloidal moderadamente densa. . . . . .

7.13. Variación de ln [MC (k = kmax , z)] con la concentración, en un sistema

débilmente interactuante. . . . . . . . . . . . . . . . . . . . . . . . . . .

7.14. Variación de ln [MC (k = kmax , z)] con la concentración, en un sistema

moderadamente interactuante. . . . . . . . . . . . . . . . . . . . . . .

109

110

116

117

117

118

119

120

120

121

121

122

122

123

126

126

Índice de figuras

7.15. Variación de ln [MC (k = kmax , z)] con el alcance del potencial, en un

sistema moderadamente interactuante. . . . . . . . . . . . . . . . . . .

7.16. Variación de ln [MC (k = kmax , z)] con la con la intensidad de interacción.

7.17. Modelo Lorentziano para la función de memoria que resulta del ajuste

tipo distribución Boltzmann de MC . Las lineas en color representan los

modelos lorentzianos. En rosa para A2 = 7, en naranja para A2 = 35 y

en rojo para A2 = 70. . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.18. Ajuste tipo Bose para MC con las distintas amplitudes de interacción

A2 = 7 (trazos negros y rosa) A2 = 35 (trazos grises claros y naranja) y

A2 = 70 (trazos grises y rojos). . . . . . . . . . . . . . . . . . . . . . .

7.19. Modelo hipergeométrico de Gauss de M , que resulta del ajuste tipo Bose

en MC en lineas de colores. En rosa para A2 = 7, en naranja para A2 = 35

y en rojo para A2 = 70. . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.20. Dependencia de la función intermedia de dispersión en el número de onda

y en el tiempo. Los resultados corresponden al sistema bidimensional con

los parámetros A2 = 35, n = 1, b = 1 y σ = 0.357. Se muestra todo el

intervalo de tiempo hasta que la función decae completamente. . . . . .

7.21. La figura muestra a F (k, t) durante el intervalo de tiempo en donde la

parte de números de onda más grandes ha decaído completamente. . . .

7.22. MC (k, z)/F (k, 0) asociada a la función de memoria del sistema en la

figura 7.20. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.23. Comportamiento de MC (k, z)/F (k, 0) del sistema en la figura 7.20, en la

región cercana al máximo principal del factor de estructura. . . . . . .

7.24. Superficie ln [MC (k, t)/F (k, 0)] del sistema en la figura 7.20. . . . . . .

7.25. Comportamiento de ln [MC (k, t)/F (k, 0)] en la figura 7.24, en distintos

números de onda. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.26. Función de memoria irreducible de acuerdo a (7.24) para un sistema bidimensional en k = kmax . Como es usual, kmax indica la posición del máximo principal de S(k). También se muestran las memorias irreducibles

que se obtienen al emplear dos ajustes RY, y uno HNC, para interpolar

el S(k) de la simulación, y después usarlo para calcular V (kmax , k). . .

7.27. Función vértice V (q = 6.8, k) de la simulación (en negro). También se

muestran los resultados para cuatro ajustes de S usando las cerraduras

HNC y RY. Los números indican el valor de A2 empleado para hacer el

ajuste. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.28. Función vértice V (q = 8, k) de la simulación (en negro). También se

muestran para los cuatro ajustes de S empleados en la figura anterior. .

7.29. Comparación entre la MC (k = kmax , z) que se obtiene de las simulaciones (lineas grises) con la que se obtiene a partir de la teoría de modos

acoplados (lineas negras). El inset muestra un rompimiento de ejes. . .

7.30. Comparación entre el ln [MC (k = kmax , z)] de las simulaciones (linea gris)

y el que se obtiene de la teoría de modos acoplados (linea negra). . . .

IX

127

127

129

132

133

134

135

136

137

137

138

140

142

143

144

145

X

Índice de figuras

7.31. Función de memoria M (k = kmax , t) de la simulación (en gris) comparada con la función de memoria en la aproximación de convolución

de la teoría de modos acoplados (en lineas negras). El inset muestra al

ln [M (k = kmax , t)] de la función correspondiente a la teoría de modos

acoplados. . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . .

7.32. F (k = kmax , t) de un sistema bidimensional de coloides paramagnéticos.

7.33. MC (k, z) del sistema en la figura 7.32 La linea gris muestra su ajuste

tipo Bose y el inset al ln MC (k, z). . . . . . . . . . . . . . . . . . . . . .

7.34. Funciones intermedias de dispersión parciales del sistema de dos capas y

una especie estudiado en este trabajo (Secc. 5.2.2). Solamente se muestra

√

el resultado para el número de onda asociado a la escala de longitud 2d,

para tres valores de la distancia entre las capas: 1σ en líneas negras,

1.5σ en lineas grises claras y 5σ en lineas grises. Las funciones positivas

11

22

12

21

representan√a las correlaciones F11

= F11

y las negativas a F11

= F11

.

7.35. MC (kd = 2π, z) para cada uno de los casos en la figura anterior: 1σ

en líneas negras, 1.5σ en lineas grises claras y 5σ en lineas grises. Las

11

22

transformaciones de las memorias M11

= M11

se muestran en líneas

21

12

continúas y las de las memorias M11 = M11 en líneas cortadas. El inset

muestra al ln [MC (k, z)].

√ Las líneas en color naranja muestran los ajustes

tipo Bose de MC (k = 2π, z). . . . . . . . . . . . . . . . . . . . . . . .

146

147

149

150

152

1 Introducción

... como los pájaros del bosque, ligeros y siempre silenciosos incluso cuando cantan, incluso cuando se posan. Lo real es suficiente para lo real, y la

sencillez es lo real en sí mismo. ...

André Compte-Sponville.

La construcción del lenguaje que nos permite interpretar y entender a la naturaleza

es una tarea muy compleja. Sin embargo, la naturaleza está ahí con su sencillez y sutileza. A pesar de la complejidad que involucra estudiar los fenómenos naturales, las

conclusiones y expresiones finales que del trabajo científico emergen suelen ser sencillas

y fácilmente asimilables. En ocasiones sucede que las teorías, que se desarrollan estudiando sistemas muy simples, se pueden aplicar a sistemas más complejos, o bien, que

cálculos numéricos y experimentos computacionales muy complejos derivan en resultados simples que no son obvios a primera vista y que incluso en ocasiones hasta son

inesperados. Dos ejemplos representativos de estos dos aspectos son: (1) La aplicación

de la teoría de la estructura de los líquidos simples al estudio de los líquidos coloidales y

(2) la predicción –que se obtuvo en los inicios de las simulaciones por computadora– concerniente a que las esferas duras podrían formar cristales –predicción que renombrados

científicos intentaron refutar porque iba en contra de su sentido común–; actualmente

esta transición está perfectamente explicada.

En este trabajo usamos un modelo sencillo de sistema coloidal y nuestros cálculos,

aunque tediosos, son de una naturaleza muy simple. A pesar de esto, hemos obtenido

conclusiones muy interesantes acerca del cálculo de los potenciales efectivos, de la naturaleza de los mismos y de su relación con la estructura, y por otro lado, acerca de los

efectos de memoria de los sistemas bidimensionales. En cuanto a los efectos de memoria,

después de un arduo trabajo numérico, obtuvimos ajustes analíticos sencillos para las

funciones de memoria. Ahora mencionaremos los sistemas y las cantidades estudiadas.

En nuestra educación básica aprendemos a clasificar a la materia considerando sus propiedades físicas. Por ejemplo, a primera vista el aire que respiramos lo identificamos

como un gas –más precisamente el aire es una dispersión–. El agua –el principal constituyente de los seres vivos– se dice que pertenece al dominio de los líquidos. A los

metales los identificamos como pertenecientes a la categoría de los sólidos. Llamamos a

estas tres categorías de la materia –gas, líquido y sólido– los estados fundamentales de

la materia. La clasificación de los tres estados fundamentales de la materia nos resulta

muy familiar. En la actualidad poseemos una descripción completa de las propiedades

de los gases y de los sólidos. En cambio, el entendimiento de las propiedades de los líquidos –incluso de algunos que pordrían parecer muy simples, como el agua– representa

un reto actual en la investigación científica.

1

2

Capítulo 1. Introducción

Existen materiales que poseen propiedades físicas y químicas distintas a, o bien intermedias entre, las que poseen los materiales pertenecientes al dominio de los tres estados

fundamentales. Estos materiales también son muy comunes, tanto en la naturaleza como en la tecnología desarrollada por el ser humano. Los vidrios, los geles y los cristales

líquidos son algunos ejemplos de materiales prolíferos en nuestra vida diaria. Estos

ejemplos no pertenecen a la clasificación de los estados fundamentales. Otros ejemplos

son los materiales que presentan la coexistencia –en la escala mesoscópica, donde las

fluctuaciones térmicas son importantísimas– de los tres estados fundamentales. Dentro de estos materiales heterogéneos encontramos a las dispersiones. Las suspensiones

coloidales son un ejemplo típico de estados de la materia que contienen fases dispersas.

Los materiales que se mencionaron anteriormente, y que no pertenecen al dominio de

los tres estados fundamentales, forman parte de una clasificación de la materia a la

que se le denomina materia blanda. El estudio de este tipo de materiales comprende

la cooperación inter-disciplinaria de varias áreas de la ciencia, dentro de las cuales

encontramos a la física, a la química, a la biología y a las ciencias de la computación.

El objetivo de estos estudios es el de entender las propiedades de los materiales blandos

en distintos niveles de descripción. Uno de los aspectos más excitantes que de estos

estudios emerge es la conexión física-biología a nivel mesoscópico. No obstante, la meta

de lograr una descripción multi-escala de los procesos en seres vivos aún se ve lejana.

Por el momento, una área relacionada, conocida como bio-mimética, pretende avanzar

en esa dirección mediante el desarrollo de la teoría y de las técnicas relevantes para

sintetizar materiales que imiten algunas de las funciones que realizan los constituyentes

macro-moleculares de los seres vivos. Los sistemas coloidales, además de ser modelos

de estudio para las dispersiones, e incluso para proteínas o complejos como las micelas,

también son modelos muy útiles para estudios fundamentales relacionados con teorías

del caos y, en general, en el estudio del problema de muchos cuerpos.

Un esquema teórico muy importante en la descripción de la materia condensada blanda

y, en particular, de las dispersiones coloidales en estado líquido, es la teoría de los

líquidos simples –o simplemente, teoría de líquidos–. La teoría de líquidos se consolidó

entre 1950 y 1980 –en gran parte gracias al desarrollo de las micro-computadoras–

mediante el estudio de los líquidos cuyas partículas interactúan vía potenciales centrales,

y cuya energía potencial total es la suma de las energías potenciales entre pares de

partículas. Esta teoría se ha complementado con otros marcos teóricos con el objetivo de

describir líquidos más complejos, como las dispersiones coloidales líquidas –en algunos

casos sucede el proceso inverso: Siendo las dispersiones coloidales sistemas accesibles a

la observación experimental, algunas teorías de líquidos y formalismos relacionados se

han verificado dentro del marco de los modelos coloidales–. Entre otros marcos teóricos

no menos importantes, podemos mencionar como teorías relacionadas a la dinámica

disipativa y la hidrodinámica generalizada e, inclusive, a los tecnicismos generados en

la teoría cuántica de los campos.

Existen cuatro conceptos centrales en la descripción de los líquidos coloidales, estos

son: (a) El concepto de potencial efectivo de interacción entre pares de partículas –

a partir del cual se puede obtener todas las propiedades físicas en equilibrio–. (b) El

concepto de funciones de correlación espacio-temporal –caracterizan los procesos de

3

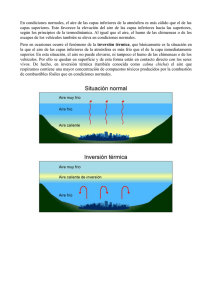

Figura 1.1: Tres capas

de partículas coloidales.

La figura ilustra a uno

de los sistemas estudiados en este trabajo. Las

esferitas representan a los

coloides. Los centros de

las esferitas definen planos paralelos al plano xy.

Los planos trazados en la

figura son imaginarios y

solamente funcionan como una guía para el ojo.

relajación de las fluctuaciones en o fuera de equilibrio–. (c) El concepto de funciones de

memoria –nos da información sobre la naturaleza de los procesos de relajación–. Y (d) la

noción de experimento computacional, o simulación por computadora –que, entre otras

cosas, nos permite verificar los modelos de interacción y las teorías–. En la medida en

que fortalezcamos la estructura y productos que de estos conceptos emergen, seremos

capaces de entender mejor a las dispersiones coloidales y en general a la materia blanda.

Este trabajo es un estudio que involucra a todos estos conceptos, contribuyendo así con

un granito de arena en la construcción de nuestro entendimiento de las propiedades de

las suspensiones coloidales.

Este trabajo se divide en dos partes. En la primera parte estudiamos el potencial efectivo entre coloides dispersos en capas planas paralelas. Nuestro sistema de capas planas

se compone de partículas brownianas de Yukawa que constituyen sistemas bidimensionales planos. Consideraremos dos y tres sistemas bidimensionales paralelos entre sí, y

a la vez paralelos al plano xy. A cada sistema bidimensional le llamamos una capa.

Las partículas estarán restringidas a moverse solamente sobre su plano, esto es, no se

estudiará el efecto de transferencia de partículas entre las capas. Cada capa, aparte

de las propiedades intrínsecas de sus coloides, se caracteriza por la coordenada z que

etiqueta a los planos. La figura 1.1 ilustra a un sistema de tres capas. Mostraremos que

la distancia entre las capas es un parámetro que nos permite controlar la estructura y,

por ende, los potenciales efectivos, de una forma muy simple y eficaz. También mostraremos cómo es que las escalas de longitud características se mezclan para dictar el

comportamiento del potencial efectivo.

El interés subyacente a un sistema modelo de este tipo radica en el concepto de control coloidal. Las investigaciones sobre los sistemas coloidales en distintas etapas del

siglo pasado hicieron posible un entendimiento casi completo de las propiedades mesoestructurales, no dependientes del tiempo, de las suspensiones coloidales abiertas en

4

Capítulo 1. Introducción

cualquier dimensión, es decir, de las suspensiones coloidales en dónde los efectos de

frontera son mínimos. No obstante, los procesos inherentes a la evolución temporal de

la meso-estructura, aún de sistemas abiertos, no se entienden del todo.

Desde hace unos veinte años ha surgido el interés por el estudio de suspensiones coloidales en donde el confinamiento de la suspensión es determinante en sus propiedades.

Este aspecto del área de los coloides está en desarrollo. Otro aspecto íntimamente relacionado con el confinamiento es el concepto de control coloidal. Como toda materia

blanda, es relativamente fácil manipular un sistema coloidal. Por ejemplo, si agregamos

gradualmente sal a una suspensión de esferitas de poli-estireno, podemos llevar a la

suspensión de un estado líquido coloidal hasta un estado de segregación de las esferitas

a medida que la cantidad de sal aumenta. Inclusive esa segregación se puede evitar si

vestimos a los coloides con algún polímero.

Otro ejemplo de manipulación coloidal se presenta en los sistemas coloidales confinados

entre dos placas. En este caso la dispersión coloidal puede presentar distintas fases,

dependiendo de la separación entre las placas. Y así, existen muchos otros mecanismos

de manipulación coloidal. Una vez que hemos aprendido a manipular los coloides, surge

la inquietud de controlarlos, esto es, ejercer una manipulación precisa de los mismos,

de la manera más eficaz que podamos. Otro de los objetivos de este trabajo es ilustrar

que el sistema de capas es un modelo teórico muy eficaz para el control coloidal.

En la segunda parte estudiamos sistemáticamente la dependencia espacio-temporal de

las funciones de memoria de la difusión colectiva de sistemas bidimensionales, y de dos

capas, compuestos de partículas de Yukawa. En este estudio desarrollamos un método

nuevo para obtener funciones de memoria. El método es numérica y matemáticamente

trivial. No obstante, los resultados revelan modelos matemáticos para las funciones de

memoria que nunca antes se habían considerado. Mostraremos que los nuevos modelos matemáticos para la función de memoria que obtuvimos en este trabajo son muy

generales, en cuanto a su aplicabilidad en una gama amplia de condiciones.

La importancia de las funciones de memoria radica en el hecho de que nos dan información sobre la naturaleza del proceso de relajación de las funciones de autocorrelación y,

por su parte, las funciones de autocorrelación nos permiten obtener las propiedades de

transporte de los sistemas. Inclusive, la función de memoria puede interpretarse como

una función de autocorrelación de un tensor de esfuerzos generalizado.

Este reporte consta de 8 capítulos. En el capítulo siguiente precisamos las ideas generales y el contexto de este trabajo. Nuestro propósito en ese capítulo es transmitir los

objetivos de este trabajo en una forma concreta para alguien que domina estos temas.

Los dos capítulos que le siguen proporcionan el marco teórico y los estudios previos, particularmente sobre los efectos de memoria, para alguien que no esté muy familiarizado

con estos temas.

El capítulo 3 está dedicado a la revisión del marco teórico base de este trabajo, así

como a la definición y explicación de los conceptos necesarios para interpretar nuestros

resultados. El capitulo 4 es una revisión y discusión de los estudios previos sobre funciones de memoria. El capítulo 5 contiene la descripción de la estructura de los coloides

en capas planas y funciona como un capítulo auxiliar al capítulo 6. En mi trabajo de

5

maestría [1] habíamos estudiado a este tipo de sistemas. La intención de este capítulo

no es repetir aquellos resultados, de hecho, muchos de los resultados en este capítulo no

están contenidos en [1] y reflejan nuestro mejor entendimiento de este tipo de sistemas.

El capítulo 6 presenta los resultados sobre los potenciales efectivos, mientras que el

capítulo 7 presenta nuestro estudio de las funciones de memoria. Finalizaremos este

reporte con un capítulo de conclusiones y de perspectivas de trabajo.

6

Capítulo 1. Introducción

2 Generalidades

Hay pintores quienes transforman al sol en una mancha amarilla, hay

otros quienes con la ayuda de su arte y su inteligencia transforman a una

mancha amarilla en el sol.

Pablo Picaso.

En muchos aspectos el trabajo de un físico de la materia blanda se asemeja al del

pintor. Debemos tener la visión para identificar las variables determinantes en el comportamiento de los sistemas blandos, en escalas de espacio y tiempo definidas, y en base

a ello desarrollar un modelo teórico que trate de representar lo más fielmente posible

al sistema real. A menudo sucede que nuestros modelos son como la mancha que representa al sol con todas sus tormentas dinámicas caprichosas. Otras veces se proponen

modelos teóricos y a la larga surgen problemas reales para los cuales el modelo es aplicable. Este trabajo pertenece a esta segunda clase, pues sabemos bien que hay muchos

sistemas que presentan estructuramiento en forma de capas, pero nuestro sistema no

es un modelo directo de alguno de esos sistemas. No obstante, aprenderemos mucho de

este modelo sencillo.

El objetivo de este pequeño capítulo es introducir de forma general el contexto dentro

del cual se desarrolla este trabajo. De esta manera hacemos una conexión directa hasta

la parte de los resultados de este trabajo que comprende los capítulos 5, 6 y 7. No

obstante, los dos capítulos que siguen detallan el esquema teórico y conceptual, así

como los estudios previos en la dirección de nuestro trabajo.

2.1.

Dispersiones coloidales

El dominio coloidal [2, 3, 4] es un subdominio de la materia blanda1 [5, 6, 7, 8]. En

general, se dice que un material es blando cuando presenta alguna de las siguientes

características inter-relacionadas:

Los materiales blandos poseen propiedades reológicas intermedias entre las de un

sólido cristalino y las de un líquido molecular. Esto se relaciona con el hecho de

que la materia blanda posee una densidad atómica y una conectividad más baja

que la materia sólida.

1

Los estadounidenses usan el nombre fluidos complejos para la materia blanda. Aunque no todos

los materiales blandos son fluidos, este nombre resalta el hecho de que los materiales blandos son

complejos. Esto implica que la descripción de los materiales blandos usualmente aglutina a muchas

áreas del conocimiento humano.

7

8

Capítulo 2. Generalidades

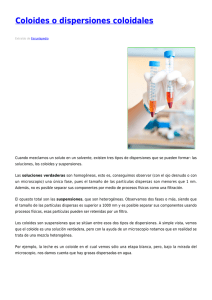

Figura 2.1: Coloides en caricatura. Ilustración del entorno de

una partícula coloidal rodeada de

muchas otras partículas coloidales

más pequeñas. El solvente se ilustra como el fondo rugoso. Los símbolos + y - representan a los iones

libres. Los iones libres provienen de

la disolución de una sal en el solvente y de los radicales que se disocian de los coloides.

Los constituyentes de los materiales blandos pueden interaccionar no covalentemente. Por ejemplo, los objetos que constituyen a un material blando pueden

presentar interacciones de Coulomb, de Yukawa, de enlaces de hidrógeno, etc.

La entropía es un factor determinante de las propiedades de los materiales blandos.

Los materiales blandos poseen la cualidad de auto-organización, uno de los eslabones del origen de las estructuras de los seres vivos.

Las funciones de respuesta (susceptibilidades) de los materiales blandos son enormes y usualmente bien comportadas. Esto significa que bajo fuerzas generalizadas

muy tenues, los materiales blandos pueden sufrir cambios muy drásticos en sus

propiedades macroscópicas. Por otra parte, esto también significa que los materiales blandos son flexibles, esto es, que aceptan factores de compresión muy elevados

(pueden deformarse mucho sin fracturarse), aunque soportan menos esfuerzos.

La estructura de un material blando puede ser manipulada y a veces hasta controlada por medios químicos, electroquímicos, mecánicos, etc., de una manera relativamente simple. Importante mencionar aquí que la estructura de los materiales

blandos fluctúa aleatoriamente de forma incesante por efecto de las fluctuaciones

térmicas. Por ello, cuando se habla de estructura de un material blando, uno se

refiere a la estructura promedio. La estructura promedio dicta las propiedades

macroscópicas del material en equilibrio termodinámico.

Algunos materiales blandos presentan la propiedad de simetría bajo magnificaciones. Esto significa que una sección de caminata aleatoria, que al menos abarca

un recorrido igual a la longitud de persistencia, se ve igual cuando se magnifica.

Esta simetría se caracteriza a través del decaimiento de la densidad de pasos con

la distancia. El exponente de decaimiento se llama el exponente de escalamiento

del sistema.

El dominio coloidal manifiesta la coexistencia de las fluctuaciones térmicas con las

constricciones características del estado sólido. Otros ejemplos de materia blanda son

los complejos poliméricos, las micro-emulsiones, las espumas y los cristales líquidos. En

este trabajo nos interesan las suspensiones coloidales.

2.2. Potenciales efectivos y funciones de memoria

9

Una suspensión coloidal es un fluido cuyas partículas2 se constituyen de grupos enormes

de moléculas ligadas, como en los sólidos3 . Los grupos se encuentran inmersos en un

líquido molecular. Los grupos son lo suficientemente grandes como para formar una

fase distinta a la del líquido y, a la vez, lo suficientemente pequeños como para que

las fluctuaciones térmicas sean relevantes en su descripción. A los grupos se les llama

coloides o partícula coloidal. Los coloides son las partículas que constituyen al soluto

en una suspensión coloidal. El solvente de la suspensión es un liquido molecular. Las

dimensiones lineales de un coloide van desde los nanómetros hasta los micrómetros. En

cambio, las dimensiones lineales de los sistemas atómicos y moleculares son del orden

de unos cuantos Å. La figura 2.1 ilustra el concepto de partícula coloidal.

2.2.

Potenciales efectivos y funciones de memoria

Imaginemos que un elemento de una suspensión coloidal, ya sea una molécula del solvente o bien un coloide, experimenta un pequeño desbalance de fuerzas que lo lleva a

una velocidad distinta a la velocidad promedio en equilibrio térmico de acuerdo a la

estadística de Boltzmann –en equilibrio térmico, estos desbalances son muy frecuentes

y se denominan fluctuaciones térmicas–. El tiempo que le toma a un coloide alcanzar

la velocidad de equilibrio térmico es, al menos, tres ordenes de magnitud mayor que el

tiempo que le toma a la molécula –el proceso durante el cual los objetos alcanzan la velocidad de equilibrio se llama relajación de la velocidad–. El coloide relaja su velocidad

mucho más lentamente que la molécula y eso permite que sea mucho más fácil rastrear

experimentalmente la dinámica de los coloides que la dinámica de las moléculas en una

suspensión coloidal.

A las posiciones y momentos de los coloides les llamaremos los grados de libertad

mesoscópicos, mientras que las posiciones y momentos de las moléculas del solvente se

denominarán los grados de libertad microscópicos. Se dice que dentro de una suspensión

coloidal existen grados de libertad rápidos y grados de libertad lentos. Los grados de

libertad microscópicos son los rápidos y los grados de libertad mesoscópicos son los

lentos. Esto es, los grados de libertad rápidos se asocian a las moléculas y los grados de

libertad lentos se asocian a los coloides.

Gracias a esta separación de escalas entre los coloides y las moléculas, podemos construir

descripciones de la dinámica de las suspensiones coloidales en las cuales solamente

intervengan los grados de libertad mesoscópicos. Este tipo de dinámicas se llaman

dinámicas disipativas. Si los grados de libertad que se consideran son la posición y la

2

Partícula se define como un objeto puntual sin estructura. Sin embargo, aun cuando sabemos que es

incorrecto se tiene la costumbre de usar este término para referirnos a objetos con estructura. Por

ejemplo, se habla de las partículas coloidales, y ¡por supuesto que las partículas coloidales tienen

estructura! Anticipando, también es costumbre usar la terminología potencial efectivo en lugar del

término energía potencial efectiva que es lo correcto.

3

También existe el término coloides suaves (soft colloids). En los coloides suaves las ligaduras son

menos rígidas que las de un sólido. Un ejemplo de coloide suave es una micela.

10

Capítulo 2. Generalidades

velocidad de los coloides, entonces se dice que se trabaja en una dinámica de FokkerPlanck. Si solamente se consideran las posiciones, entonces se dice que se trabaja en una

dinámica de Smoluchowski [14]. Nosotros trabajamos con la dinámica de Smoluchowski

de sistemas en equilibrio térmico.

Cualquier observable de un sistema coloidal que sea función de los grados de libertad

micro y mesoscópicos es denominado variable dinámica o función del sistema. Las fluctuaciones térmicas en los grados de libertad mesoscópicos se transmiten a las variables

dinámicas. De esta manera, las variables dinámicas son cantidades fluctuantes alrededor de un valor promedio de equilibrio. Uno se puede preguntar ¿cómo es el proceso

de relajación de las variables dinámicas? y ¿qué conclusiones acerca de la naturaleza del sistema podemos obtener de esta información? Para responder estas preguntas

podemos elegir muchas rutas. Una posibilidad es estudiar la dependencia temporal de

la variable dinámica. Otra ruta es estudiar la dependencia temporal de la función de

auto-correlación de la variable dinámica. La segunda ruta ha resultado muy fructífera

y se le llama el formalismo de las funciones de correlación espacio-temporales [9]. Las

funciones de correlación espacio-temporales juegan un papel muy importante en la descripción de las propiedades dependientes del tiempo de la materia blanda. Todos los

coeficientes de transporte pueden escribirse en términos de las funciones de correlación

espacio-temporales y, bajo ciertas circunstancias, su perfil espacial en el instante inicial

nos permite obtener todas las propiedades termodinámicas en equilibrio [9, 12].

En la dinámica de Smoluchowski, la función de correlación espacio-temporal natural

para describir las propiedades dependientes del tiempo de una suspensión coloidal en

equilibrio, o cerca de equilibrio, es la función de auto-correlación de la densidad local

de partículas. A esta función se le conoce como la función de van Hoove G(r, t) [15].

El perfil inicial de la función de van Hoove, g(r) ≡ G(r, t = 0) r 6= 0, llamada función

de distribución radial, su transformación de Fourier espacial F (k, t), llamada función

intermedia de dispersión y el factor de estructura estática S(k) ≡ F (k, t = 0)4 son

algunas funciones de correlación que se usan frecuentemente y son referidas como las

funciones de correlación de las fluctuaciones en la densidad.

Idealmente, en la mecánica clásica –así como en la mecánica cuántica– aprendemos que

la energía potencial de interacción entre pares de partículas, junto con las condiciones iniciales y de frontera, son suficientes para elaborar una descripción completa de

propiedades físicas de cualquier sistema en escalas de espacio y tiempo microscópicas,

esto es, al nivel de átomos o moléculas. Para describir un sistema clásico simplemente

tenemos que resolver su ecuación de Liouville, su ecuación de eigen-valores asociada, o

cualesquier otra ecuación de movimiento de los grados de libertad microscópicos. Para

un sistema líquido, aún siendo el más simple, esto sería una tarea inimaginablemente

4

En la literatura a la transformación de Fourier espacial de G(r, t) se le suele llamar indistintamente

como función intermedia de dispersión, denotándola como F (k, t), o bien como factor de estructura

dinámica, denotándola como S(k, t). También (en la literatura de los líquidos simples e iónicos) a

la transformación de Fourier doble espacio-temporal de G se le suele llamar factor de estructura

dinámica y denotar por S(k, ω), con ω la frecuencia. En este trabajo usaremos la letra F para

denotar a la función intermedia de dispersión y la S para denotar el factor de estructura estática,

evitando el inconveniente de usar la misma letra para dos objetos distintos.

2.2. Potenciales efectivos y funciones de memoria

11

tediosa, tal vez imposible. Sin embargo, aún cuando fuera posible, no sería útil si no

contamos con un esquema apropiado que nos permita interpretar los resultados en las

escalas mesoscópicas y/o en las macroscópicas. Por lo tanto, resulta imperante pensar

que es necesario plantear las ecuaciones que dictan el comportamiento de las variables dinámicas en la escala mesoscópica o la macroscópica, resolverlas y estudiar las

soluciones en condiciones arbitrarias.

El movimiento browniano es un ejemplo notable de descripción en escala mesoscópica5

–esta descripción nos proporciona conclusiones notables acerca de la naturaleza, sin considerar explícitamente los detalles microscópicos–. Los trabajos realizados por Brown,

Einstein, Langevin, Lorentz, Perrin y Smoluchowski fincaron la base de la descripción

fenomenológica del movimiento browniano y otros procesos estocásticos relacionados.

Su trabajo mostró la existencia de los átomos mediante su manifestación en la mesoescala, la cual se refleja como el movimiento errático de las partículas brownianas –en

analogía a la difusión del calor y dado que se gobiernan por ecuaciones similares a el

movimiento errático se le llamó la difusión de la partícula browniana6 –. Otros conceptos han surgido en el desarrollo de la física que no son obvios a partir de los detalles

moleculares, un ejemplo representativo es el concepto de irreversibilidad.

Describir un sistema usando escalas de espacio y tiempo mesoscópicas, como se hace en

la física de coloides y en muchos otros aspectos de la física de la materia blanda, conlleva

a que los potenciales de interacción entre pares de macro-partículas, llamados potenciales efectivos, no sean suficientes para realizar la descripción completa de las propiedades

dependientes del tiempo. Esto se debe a el hecho de que los potenciales efectivos solamente contienen información promedio-configuracional de las macro-partículas, de su

constitución y de su distribución espacial. La información concerniente al solvente queda reducida a algunos parámetros independientes del tiempo. Para tomar en cuenta

efectos de acoplamiento entre la dinámica del solvente –la dinámica rápida del sistema

– y la dinámica del soluto –la dinámica lenta del sistema– se introduce el concepto de

función de memoria. De esta manera, en una descripción mesoscópica completa, aparte

del potencial efectivo, se requiere conocer la función de memoria del sistema. La función

de memoria es el remanente de las fuerzas estocásticas asociadas al solvente. Más aún,

la función de memoria no solamente describe el acoplamiento con el solvente, también

describe por qué el decaimiento de las fluctuaciones no es una simple exponencial, pues

captura los efectos de las interacciones derivables de un potencial, así como el de las

interacciones hidrodinámicas. El origen físico del efecto de memoria puede interpretarse

como el efecto del encajonamiento dinámico que las partículas ejercen entre sí, el cual

5

En inglés el término “coarse-grained description” se refiere a una descripción de las propiedades de

un sistema que no contiene explícitamente algunos detalles (como por ejemplo, la existencia de

moléculas de agua en una suspensión acuosa), sino implícitamente a través de algunos parámetros

(como por ejemplo, la constante dieléctrica en las suspensiones acuosas). Usualmente una coarsegrained description es necesaria en el nivel mesoscópico de descripción, de esta manera, usaremos

en español “descripción mesoscópica” para traducir al español éste término anglosajón.

6

Por ejemplo, ahora hablamos del transporte difusivo, el cual surge de las fluctuaciones térmicas, para

distinguirlo del transporte dirigido, el cual es inducido por un campo externo o por las condiciones

de frontera.

12

Capítulo 2. Generalidades

a su vez, es determinante en el movimiento colectivo y de una partícula.

En el transcurso del desarrollo de la dinámica disipativa han emergido expresiones matemáticas exactas para las funciones de memoria. Usualmente, dichas expresiones nos

indican que debemos calcular alguna función de auto-correlación de todas las variables

rápidas del sistema, esto es, de las variables que no entran explícitamente en la dinámica

disipativa. Esto equivale a resolver la ecuación de Liouville y por lo tanto no es conveniente. Lo que se hace para salvar esta dificultad es estudiar las propiedades generales

que una función de memoria debe cumplir y, en base a ello, se proponen expresiones

matemáticas que sean capaces de modelarla en condiciones específicas.

Así, han surgido los modelos de decaimiento exponencial, de uno o dos tiempos de relajación, los modelos Gaussianos y las descomposiciones espectrales. También se han

formulado esquemas teóricos como la teoría de modos acoplados, la reducción de la

descripción en la jerarquía de ecuaciones de Langevin generalizadas, las teorías cinéticas y más recientemente las expansiones diagramáticas de las funciones de correlación

espacio-temporales. Estos modelos y esquemas teóricos son muy buenas aproximaciones

bajo ciertas circunstancias. Sin embargo, existen muy pocos estudios que se enfocan en

la función de memoria como un objeto de interés por sí mismo.

En este trabajo presentamos los resultados de un estudio sistemático, mediante simulaciones de dinámica Browniana, de los potenciales efectivos del sistema de capas paralelas ilustrado en la figura 1.1, en donde cada capa, aparte de las propiedades intrínsecas

de sus coloides, se caracteriza por la coordenada z que etiqueta a los planos. Mostraremos que la distancia entre las capas es un parámetro que nos permite controlar la

estructura y, por ende, los potenciales efectivos, de una forma muy simple y eficaz. El

cálculo de los potenciales efectivos se efectúa dentro del formalismo de contracción de

la descripción, en el marco de la teoría de ecuaciones integrales de Orstein y Zernike.

En cuanto a las funciones de memoria, se presenta un estudio sistemático de la memoria

colectiva en la dinámica de Smoluchowski de sistemas bidimensionales de partículas

brownianas de Yukawa. El estudio se basa en la inversión numérica de la ecuación de

memoria. De forma natural emergerán dos modelos para los efectos de memoria. Estos

son el modelo lorentziano y el modelo hipergeométrico de Gauss, como una extensión

del lorentziano a un espectro infinito de tiempos de relajación. Dado que el modelo

lorentziano de varios tiempos de relajación surge de forma natural, es decir, no se supone

ad hoc, concluiremos que es un modelo que debe tomarse como otro candidato serio para

estudiar los efectos, así como la naturaleza de las funciones de memoria colectivas. Las

propiedades de analiticidad del modelo, así como su justificación rigurosa dentro de un

esquema teórico se, dejarán como potenciales perspectivas de trabajo.

Los dos capítulos que siguen presentan una revisión teórica de los conceptos y estudios

previos, dentro de los cuales este trabajo se desarrolla. La intención es poner sobre bases

firmes la relevancia de este trabajo. Por lo tanto, alguien versado en estos temas puede

pasar directamente al capítulo 5.

3 Marco teórico y conceptual

El objetivo de este capítulo es presentar la teoría y los conceptos necesarios para hacer

este trabajo autocontenido. Empezamos proporcionando el formalismo de ecuaciones

integrales de Orstein y Zernike que usamos en este trabajo para calcular los potenciales efectivos. En este aspecto mencionamos un resumen de algunas investigaciones

–relevantes para este trabajo– sobre potenciales efectivos1 . Temas muy importantes y

muy activos como las técnicas de los Hamiltonianos efectivos [16] y la teoría de PoissonBoltzmann [17] para el cálculo de los potenciales efectivos no se contemplan en esta

revisión.

Posteriormente, precisaremos los conceptos y el esquema teórico que empleamos para describir la estructura dinámica de las suspensiones coloidales. En este aspecto,

no revisaremos el formalismo de la teoría cinética y las novedosas técnicas diagramáticas. En cambio, nos enfocaremos en el formalismo de las funciones de correlación

espacio-temporales, desde el punto de vista puramente microscópico del formalismo de

operadores de proyección de Mori-Zwanzig-Kawasaki [46, 47], contemplando desde la

dinámica de Liouville, pasando por la de Fokker-Planck y hasta la de Smoluchowski,

que es la que concierne a este trabajo. Reservaremos el capítulo que sigue para reportar

nuestras investigaciones sobre los estudios previos sobre los efectos de memoria. Reservamos un capítulo entero porque en este aspecto pretendemos ser exhaustivos, ya que

hemos obtenido resultados nunca antes reportados.

3.1.

Potenciales efectivos

El marco teórico que usamos en este trabajo para calcular los potenciales efectivos

es la teoría de ecuaciones integrales de los líquidos simples. Esta teoría consiste en la

ecuación integral de Orstein y Zernike y en un conjunto versátil de relaciones de cerradura. Este esquema teórico es complementado con la noción de función de correlación

directa efectiva y con la generalización de contracción de la descripción a las relaciones de cerradura. Antes de explicar el método para calcular los potenciales efectivos,

introduciremos éste marco teórico.

En la descripción de los líquidos coloidales a menudo se habla de tres tipos de potenciales: Del conocido como potencial de interacción por pares, del potencial de fuerza media

y del potencial efectivo. A continuación definimos a cada una de estas cantidades.

1

Como en este trabajo solamente estudiamos interacciones entre partículas, en lo sucesivo la frase

“potencial efectivo de interacción entre pares de partículas” se contraerá simplemente a la frase

“potencial efectivo”.

13

14

Capítulo 3. Marco teórico y conceptual

Consideremos que tenemos un sistema coloidal que consiste solamente de dos

coloides, el solvente y los iones libres. El potencial de interacción por pares describe

el cambio en la energía libre de este sistema cuando los coloides experimentan un

desplazamiento cuasiestático relativo.

Ahora consideremos a dos coloides en una suspensión coloidal de muchos coloides

y a la distribución de probabilidad de espacio fase en equilibrio.

• El potencial de interacción que se obtiene al integrar la energía potencial

total, pesada con la distribución de espacio fase, sobre los grados de libertad

del solvente, los de los iones libres, los de todos los coloides distintos a los dos

coloides bajo consideración y cuyo gradiente nos da la fuerza media entre los

dos coloides, es proporcional al potencial de fuerza media [12]. El potencial

de fuerza media describe el cambio en la energía libre de Helmoltz del sistema

cuando los dos coloides tienen un desplazamiento relativo.

• El potencial de interacción entre los dos coloides que se obtiene al integrar

los grados de libertad del solvente, así como los grados de libertad de un subconjunto de coloides, es el potencial efectivo. El potencial efectivo contiene

toda la información concerniente a las propiedades estructurales por pares

del conjunto de coloides observados, sin considerar explícitamente los grados

de libertad de los coloides integrados.

El potencial por pares, el potencial de fuerza media y el potencial efectivo coinciden en

el límite en que solamente hay dos coloides en el sistema. Una explicación más formal

de estos conceptos puede hallarse en [13]. Antes de proporcionar el método de cálculo

de los potenciales efectivos introduciremos la teoría de funciones de distribución en los

líquidos.

3.1.1.

Estructura estática de dispersiones coloidales

3.1.1.1.

Potencial DLVO

En este trabajo usaremos el potencial por pares de Yukawa:

(3.1)

u(rij ) = Ai Aj

exp [−κrij ]

,

rij

donde los subíndices significan que nos referimos a los coloides i y j, los cuales están

separados por una distancia rij . Las Ai,j dependen de las propiedades intrínsecas de los

coloides y del solvente, las llamaremos amplitudes de interacción. Si los coloides tienen

diámetro σi,j y carga qi,j entonces

(3.2)

Ai,j =

qi,j exp [κσi,j /2]

.

1 + κσi,j /2

El parámetro κ está dado por:

(3.3)

κ2 =

p

4π X

nα qα2 .

kB T α=1

3.1. Potenciales efectivos

15

Aquí es la constante dieléctrica del solvente, kB la constante de Boltzmann, T la temperatura, nα la densidad numérica de iones de la especie α y qα la carga electrónica de

cada ion de la especie α –en el sistema existen p especies distintas de iones libres–. En

la referencia [1] proporcionamos otros ejemplos de potenciales por pares. El potencial

(3.1) con las expresiones (3.2) y (3.3) recibe el nombre de la parte repulsiva del potencial DLVO. DLVO es una abreviación que recuerda los nombres de cuatro personas que

contribuyeron significantemente al estudio de la estabilidad de los coloides liofóbicos

en la década de los 1940’s. Estas personas son los soviéticos Boris Derjaguin y Lev

Landau, y los holandeses Ervert Verwey y Teo Overbeek [23]. La cantidad λD = κ−1

recibe el nombre de longitud de apantallamiento de Debye-Hückel. La longitud de apantallamiento de Debye-Hückel es una medida del alcance del potencial de Yukawa. El

potencial de Yukawa es una aproximación excelente cuando σ < λD < d, en donde d es

la distancia promedio entre coloides. La parte atractiva de los potenciales DLVO es la

interacción de van der Waals.

3.1.1.2.

Funciones de estructura estática

Las funciones de distribución representan la configuración promedio de las partículas

en un líquido. A esta distribución espacial promedio de partículas se le conoce como

la estructura del líquido. Como los coloides viven en el reino mesoscópico –en donde

las dimensiones lineales van desde los nanómetros hasta las micras– diremos que la

distribución espacial promedio de los coloides en una dispersión coloidal define a la

mesoestructura de la dispersión e, igualmente, el solvente define la microestructura. En

adelante, al menos que se especifique lo contrario, cuando hablemos de la estructura

de un líquido coloidal nos estaremos refiriendo a su mesoestructura. Aquí estamos interesados en las conocidas como funciones de distribución de dos puntos. Las funciones

de distribución de dos puntos describen el grado de orden, que en promedio temporal,

cada coloide “observa” en los demás coloides que lo rodean. Se dice que las funciones

de distribución describen qué tan distinto es el líquido de un gas ideal.

En los sistemas homogenéos, las funciones de distribución de dos puntos no dependen

del origen, esto es, que cualquier coloide puede tomarse como referencia. Además, si

el sistema es isotrópico, entonces el orden que cada coloide “ve” no depende de la

dirección de observación. Por lo tanto, en los sistemas homogéneos e isotrópicos las

funciones de distribución de dos puntos son funciones únicamente del radio-vector que

une al origen con el punto de observación. En este trabajo nos ocuparemos, únicamente,

de capas homogéneas e isotrópicas2 y las expresiones matemáticas que en adelante

se proporcionan serán válidas únicamente para este tipo de sistemas. Existen varias

expresiones equivalentes que definen a la función de distribución. Aquí daremos dos

definiciones, una basada en un proceso operacional y otra que pone de manifiesto el

hecho de que la función de distribución es una función de auto-correlación.

2

En los sistemas homogéneos e isotrópicos las funciones de distribución de dos puntos reciben el

nombre de “funciones de distribución radiales”. Aquí usaremos simplemente el término “función de

distribución” para significar que son de dos puntos y que son radiales.

16

Capítulo 3. Marco teórico y conceptual

Figura 3.1: Interpretación (3.5)

de la función de distribución de un

líquido coloidal bidimensional. La

figura es una “fotografía” de una

capa de uno de los sistemas estudiados en este trabajo. El origen

del sistema coordenado se toma en

la posición instantánea de una partícula arbitraria. El radio vector r

es el radio medio del anillo de longitud dr y área da. Dada la densidad numérica microscópica de partículas n, la g(r) nos proporciona

el número promedio de partículas

que caen dentro del anillo.

Consideremos un líquido coloidal homogéneo en ν dimensiones (ν = 1, 2, 3). Supongamos

que el volumen de la dispersión posee una dimensión lineal mínima de magnitud bl –en

un volumen esférico, al igual que en una superficie circular, bl sería la longitud del

diámetro, en un volumen cúbico bl sería la longitud de la arista, etc.–. Supongamos,

además, que bl es mucho mayor que cualquier escala de longitud característica de la

mesoestructura. Denotemos por dN al número de coloides, cuyo diámetro mínimo es

σmin , y que están localizados dentro de un elemento de volumen dν r. Este elemento

de volumen se encuentra centrado en la posición r y debe cumplir que (dν r)−1/ν <

σmin ≤ dmin , en donde dmin es la menor de las escalas de longitud características de la

mesoestructura. La función de distribución se define como

(3.4)

dN = ng(r)dν r,

en donde n es la densidad numérica macroscópica de coloides –n es el límite termodinámico del cociente N/V , en el cual N es el número de coloides en la dispersión y V es

el volumen del líquido coloidal.

En el caso particular de un sistema bidimensional homogéneo

(3.5)

dN = ng(r)da,

da = 2πrdr.

La figura 3.1 muestra la fotografía a escala de una dispersión coloidal bi-dimensional.

La fotografía corresponde a una de las capas que estudiamos en este trabajo. El tamaño

de los círculos es, a escala, alrededor de 3/4 del tamaño original de los coloides. Los

circulos se dibujan de ese tamaño porque así se ilustra mejor la formación de dímeros