PARTE VI

Anuncio

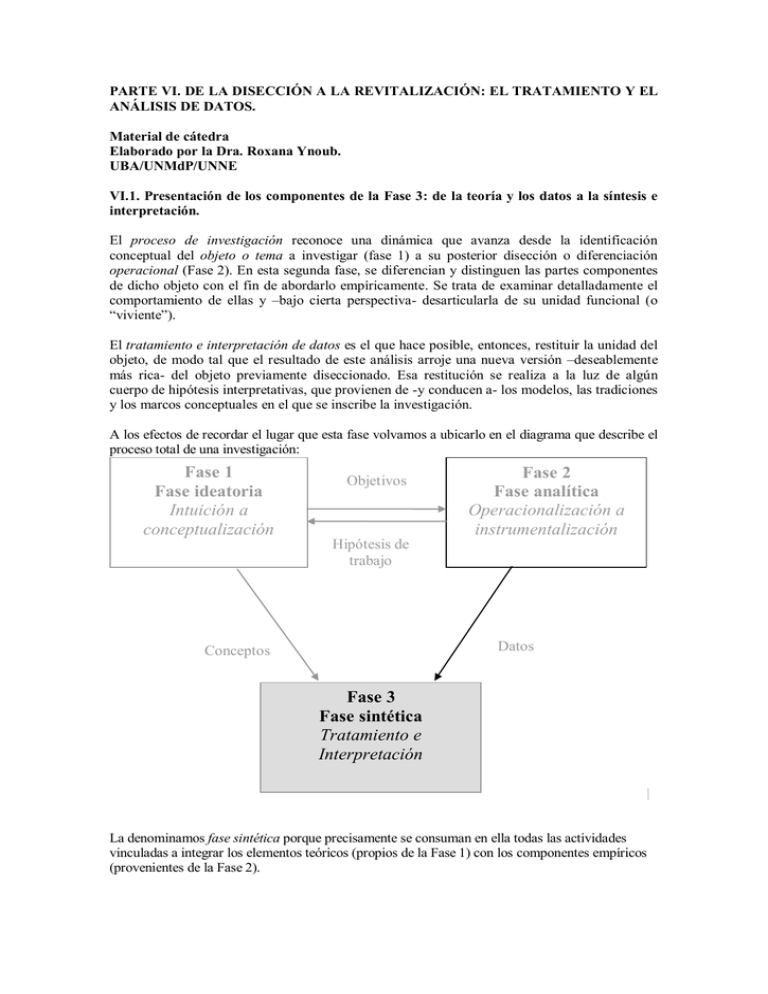

PARTE VI. DE LA DISECCIÓN A LA REVITALIZACIÓN: EL TRATAMIENTO Y EL ANÁLISIS DE DATOS. Material de cátedra Elaborado por la Dra. Roxana Ynoub. UBA/UNMdP/UNNE VI.1. Presentación de los componentes de la Fase 3: de la teoría y los datos a la síntesis e interpretación. El proceso de investigación reconoce una dinámica que avanza desde la identificación conceptual del objeto o tema a investigar (fase 1) a su posterior disección o diferenciación operacional (Fase 2). En esta segunda fase, se diferencian y distinguen las partes componentes de dicho objeto con el fin de abordarlo empíricamente. Se trata de examinar detalladamente el comportamiento de ellas y –bajo cierta perspectiva- desarticularla de su unidad funcional (o “viviente”). El tratamiento e interpretación de datos es el que hace posible, entonces, restituir la unidad del objeto, de modo tal que el resultado de este análisis arroje una nueva versión –deseablemente más rica- del objeto previamente diseccionado. Esa restitución se realiza a la luz de algún cuerpo de hipótesis interpretativas, que provienen de -y conducen a- los modelos, las tradiciones y los marcos conceptuales en el que se inscribe la investigación. A los efectos de recordar el lugar que esta fase volvamos a ubicarlo en el diagrama que describe el proceso total de una investigación: Fase 1 Fase ideatoria Intuición a conceptualización Objetivos Fase 2 Fase analítica Operacionalización a instrumentalización Hipótesis de trabajo Datos Conceptos Fase 3 Fase sintética Tratamiento e Interpretación | La denominamos fase sintética porque precisamente se consuman en ella todas las actividades vinculadas a integrar los elementos teóricos (propios de la Fase 1) con los componentes empíricos (provenientes de la Fase 2). Kant, llamaba “sintética” a nuestra facultad de juzgar. Sostenía que cuando conocemos algo, lo que hacemos es organizar de cierta manera lo que nos informan los sentidos. Esa organización surgiría de las estructuras de nuestro intelecto, las que, según él, podían ser reducidas a un conjunto de doce juicios/categorías1. Algo semejante le ocurre a un juez (adviértase que precisamente lo que el juez hace es ¡juzgar!): su tarea consiste en “encuadrar el hecho a derecho”. Su función, por lo tanto, será la de dar un veredicto, es decir, transformar en “cosa juzgada” esos hechos, para hacerlos interpretables por el derecho (lo que permitirá, entre otras cosas, dictaminar si hay culpables, estipular penas o sanciones, entre otras cuestiones)2. Son estas operaciones del juicio las que está comprometido en la Fase 3 del proceso. Ocurre, sin embargo, que el alcance de esa síntesis dependerá de la naturaleza de la investigación, del esquema en el que ella transite. En algunos casos, los modelos de los que se parten, constituyen ya genuinas teorías y la integración de los datos se parece más a una operación de subsunción o encuadre del tipo diagnóstico (en estos casos prima la inferencia abductiva). Mientras que en otras situaciones, especialmente en aquellas investigaciones teóricamente más innovadoras, el trabajo interpretativo se encamina precisamente a la construcción, ampliación o especificación de los cuerpos teóricos ya existentes. Se esperaría que en estos casos predominen inferencias analógicas por recurso a modelos menos sistematizados teóricamente. En lo que sigue consideraremos con algún detalle cada uno de los componentes que conforman esta fase como sus mutuas dependencias. VI.2. Aspectos sustanciales vinculados al tratamiento e interpretación de datos. Para ubicar el alcance de las operaciones comprometidas en esta fase, interesa recordar que todo objeto de investigación constituye un sistema complejo es decir un sistema cuasi-descomponible en el que se distinguen –o pueden distinguirse- partes componentes -o subsistemas constitutivos- y contextos –o supra-sistemas regulativos-. El proceso de construcción y delimitación del objeto de investigación, consiste, precisamente, en identificar las entidades o elementos focales del estudio (supuesto de individuación), en identificar las partes o aspectos que se tomarán en cuenta de estas entidades (supuestos de partición) y en determinar los contextos en que las entidades o elementos focales se integran (supuesto de participación) (cfr. Samaja, J.; 1993:255). 1 A su turno, estas estructuras/categorías se derivarían de la estructura de la acción que está apoyada en la misma sensibilidad: es decir, en nuestra experiencia espacio-temporal. El tratamiento de este asunto excede los objetivos de este trabajo, por lo que sólo lo mencionamos tangencionalmente. 2 La gran diferencia entre el dominio de la experiencia jurídica, y el dominio de la experiencia cognitiva que examina Kant, estriba en que el filósofo se ocupa de identificar las grandes estructuras que organizan nuestro intelecto cualquiera sea el contenido que las ocupe. Dicho de otro modo, Kant se ocupa de identificar aquellas estructuras sin las cuales no podemos pensar (o tener) experiencias. Al menos experiencias intersubjetivamente compartibles como las que gobiernan la cognición epistémica. Es por eso que concibe a este examen como un examen trascendental, es decir, un examen de las condiciones de posibilidad del conocimiento. Su propia naturaleza trascendental hace que estos organizadores cognitivos se nos trasparenten, no están ante nosotros como parte de nuestra experiencia, porque ellas sólo constituyen las formas en que se estructura nuestra experiencia. En cambio, el jurista, tiene ante sí el código, como asunto tematizado y tematizable cada vez que se aplica el derecho. Este código puede ser discutido, revisado, modificado. De cualquier modo, el código jurídico también funciona como condición de posibilidad para tener experiencias jurídicas, es decir, para que ciertos hechos se constituyan en “hechos lícitos o ílicitos”. De modo que, concomitantemente, podríamos postular que el tratamiento y análisis de datos está llamado a precisar los vínculos o determinaciones de las entidades que integran el sistema focal (supuesto de vinculación), a restituir la relación de las partes componentes con el sistema focal (supuesto de reintegración) y a incorporar los distintos subsistemas en una unidad sintetizadora (supuesto de totalización). Esquemáticamente esas dos fases y los supuestos implicados en cada una se podrían expresarse de la siguiente manera: Principios implicados en: Fase analítica (operacionalización) Fase sintética (integración de datos) a) Supuesto de individuación (entidades) a) Supuesto de vinculación (entre entidades) b) Supuesto de partición (dimensiones) b) Supuesto de determinación (entre dimensiones) c) Supuesto de participación (contextos) c) Supuesto de reintegración (entre niveles) Por ejemplo, si se investigara un asunto como Las determinaciones familiares en los procesos de deserción escolar. con alta probabilidad los investigadores producirán información referente a las familias de estos niños (eventualmente comparada con información proveniente de familias de niños no desertores), información referida a los miembros familiares y a los niños desertores, información referida al sistema escolar, etc.. El resultado de la investigación no será (o deseablemente no se espera que sea) la compilación desagregada de toda la información relevada; sino una síntesis que arroje algún nuevo saber sobre el objeto –entendido como unidad de diversas determinaciones. Esta actividad de síntesis y restitución de un nuevo sentido es el que está llamado a cumplir el tratamiento de los datos. Más específicamente, es a partir de él que deberán medirse las hipótesis de la investigación: no sólo, ni principalmente de manera externa a ese tratamiento -es decir, luego de que ya se ha consumado- sino de un modo consustancial en tanto son las hipótesis las que determinarán el tipo de tratamiento a seguir; aunque, a su turno, el tratamiento y análisis de datos puede iluminar nuevas hipótesis no previstas al inicio de la investigación; lo que ocurre de manera privilegiada, pero no exclusiva!, en los llamados estudios descriptivo-exploratorios. VI.3. Diferenciación e integración entre la interpretación y el tratamiento de datos. Aunque se trata de actividades mutuamente vinculadas el tratamiento y la interpretación conviene considerarlos de manera diferenciada: a) el tratamiento se refiere a las actividades de manipulación, síntesis e integración de resultados. Vamos a proponer dos dimensiones o perspectivas en las que puede concebirse este tratamiento: a.1. La perspectiva formal: es decir, examinando los distintos tipos de “compactación” de los datos; bajo el supuesto de que “tratar datos” es reducir, compactar o sintetizar información, y, a.2. La perspectiva funcional: atendiendo a los fines a los que sirve el tratamiento, los que están vinculados a los esquemas, diseños y objetivos de investigación. b) El análisis o interpretación por su parte, se refiere a los procesos de interpretación por los cuales los datos se integran al cuerpo de la teoría conforme a las hipótesis, objetivos y marcos conceptuales de la investigación. Como vamos a examinarlo luego, interpretar datos es “ir más allá de los datos”: es decir, transformarlos en material significante para extraer algún significado de ellos. Veamos cada uno de estos aspectos con algún detenimiento. VI.3.1. Tratamiento de datos desde la perspectiva formal: la compactación de datos según direcciones o centramientos de los componentes de la matriz. En la tradición inaugurada por John Galtung (1973) –continuada y ampliada por Samaja, J. (1993)- se clasifican los distintos tratamientos de datos por referencia a distintos direccionamientos en la “compactación” de la información que conforma la matriz de datos (o matrices de datos) de la investigación (cfr. Cap. III). Con la metáfora de la compactación se evoca la tarea que tiene entre manos quién se propone avanzar en la sistematización y síntesis de sus datos. Como ya lo adelantamos, si en el paso de las hipótesis a la operacionalización se trata de ir desde la unidad de síntesis a las unidades de análisis; en el tratamiento de los datos el procedimiento involucrado es exactamente el inverso: desde las unidades de análisis a las unidades de síntesis. Eso significa agregar, reducir la información conforme a una lógica que la torne aprehensible de manera configurada y sintetizada –iluminando aquellas relaciones y determinaciones que se pretendían explorar o probar con la hipótesis. Esa tarea de compactación puede hacerse entonces en torno a los elementos de la matriz, resultando –en principio- dos direcciones de síntesis-: la dirección de la variable (que Galtung identifica con la metáfora espacial de la dirección vertical); y la dirección de la “unidad de análisis” (a la que hace coincidir con la dirección horizontal). Estos son los dos centramientos que identifica Galtung; conforme a un esquema como el siguiente 3: 3 Cfr. Samaja, J. (1993). Interesa señalar que Galtung propone un tercer criterio que llama Análisis combinado pero del que no reconoce una lógica diferenciada, sino algo así como una “combinatoria” de los otros dos: “En este caso –señala- hay muchas posibilidades, pero realmente no existe ninguna teoría general. (...) El análisis combinado vertical y horizontal puede tomar muchas formas, según cómo se proceda. Por ejemplo, se puede elegir comenzar con algún análisis horizontal, construyendo índices basados en algunos conjuntos de variables. A partir de esto se puede hacer algún análisis vertical, agregando los valores del índice como nuevas columnas a la matriz de datos y combinándola con las otras variables, y así sucesivamente”. (op. cit. : 219). Samaja, en cambio, avanza en un criterio formal para describir un tercer tipo de análisis al incluir el concepto de nivel de integración y sistemas de matrices de datos. Este tercer criterio lo define como centramiento en el valor (cfr. Samaja, J. op. cit.: Parte III y IV) y lo presenta esquemáticamente de la siguiente manera: Este nuevo centramiento remite ya no sólo a la estructura de la matriz de datos, sino a la relación entre matrices de distintos niveles de concreción: el nivel llamado “sub-unitario” se refiere, precisamente, a la información que oficia de insumo o nutriente para la construcción de las categorías que conforman las variables del nivel de anclaje (es decir, el nivel considerado focal en un determinado momento del proceso de investigación). El análisis centrado en el valor puede combinar –lógicamente- los tratamientos “verticales” y “horizontales”, pero metodológicamente cumple una función distinta a la del centramiento en la variable y la unidad de análisis respectivamente: se refiere a la construcción de un sistema de clasificación o variable; tarea que implica el tratamiento de los valores del nivel sub-unitario. VI.3.1. Tratamiento de datos desde la perspectiva funcional: fines a los que sirve cada tipo de tratamiento. El criterio formal puede considerarse a su turno, atendiendo a lo que vamos a denominar, el criterio funcional, es decir, considerando los fines a los que sirve el tratamiento. De acuerdo con ello es posible reconocer que el centramiento en la dirección de la variable tiene como objeto “computar” datos, en la perspectiva de agregar la información según los distintos valores de las variables para identificar las distribuciones de esos valores en la población o la muestra estudiada. De igual modo, el conjunto de “medidas síntesis” –como las llamadas medidas de posición y de tendencia central constituyen información que ofician de descriptores del conjunto de casos o unidades considerando a este conjunto como una nueva totalidad o unidad (sea muestral o poblacional). De modo tal que el capítulo correspondiente al centramiento en la dirección de la variable corresponde a lo que usualmente trata la estadística descriptiva y la estadística inferencial. La diferencia entre estas dos ramas de la estadística estriba en que en el primer caso, los cálculos se destinan a caracterizar la muestra o población de la que se obtiene la información empírica. En el segundo caso, en cambio, se trata de utilizar esa información empírica para estimar o inferir –en base a teoría de probabilidades- valores de una población o universo al que no se accede de modo directo. La estadística inferencial permite estimar, por ejemplo, con qué probabilidad los valores obtenidos en una muestra (aquellas medidas síntesis a las que nos referirmos previamente), representan, o se corresponden con un valor no conocido de una población de referencia (a esto se lo llama “estimación de parámetros”). De igual modo, permite inferir si la variación que presentan dos o más variables consideradas conjuntamente, resulta probable o improbable. Es decir, permite estimar si su variación puede atribuirse al mero azar, o por el contrario, parecen ser concomitantes, y por lo tanto puede sospecharse que miden un mismo asunto o están determinándose de algún modo unas a otras (esta es la base de lo que usualmente se conoce como “prueba de hipótesis”). De cualquier modo, en ambas ramas de la estadística se trata de centramientos en las variables, aunque con fines diferenciables conforme a lo que acabamos de señalar. En lo que respecta al centramiento en la dirección de la unidad de análisis el tratamiento tiene como finalidad la identificación de pautas, tipologías e índices. En esos casos, más que computar o agregar la información, se trata de combinarla, ya que se consideran conjuntamente los valores provenientes de distintas variables, para las distintas unidades. Esas pautas o perfiles manifiestos, pueden a su turno, considerarse en términos de propiedades latentes de las unidades, lo que permite hacer de las tipologías construidas indicadores de nuevas variables. Finalmente, el tratamiento centrado en la dirección del valor corresponde a todos aquellas técnicas dirigidas a la construcción de dimensiones de análisis, desde información originalmente no categorizada. Un ejemplo de este tipo de tratamiento es el que se ha propuesto bajo el rótulo de “método comparativo-constante”, destinado precisamente a categorizar, clasificar material originariamente no estructurado. Esquemáticamente esto se podría presentar en los siguientes términos: Centramiento en: Tratamiento: Fines: Variable Cómputo de valores por agregación. Describir el comportamiento de las variables, y/o sus covariaciones, estimando la determinación o el efecto que unas producen sobre otras. Unidad de análisis Comparación de valores, vector de valores o estructura de valores. Construir tipologías o identificar pautas. Identificar isomorfismos entre valores manifiestos y latentes. Valores /variable Comparación y/o computación de valores de niveles subunitarios. Codificación o categorización. A su turno cada uno de estos “fines” y “tratamientos” pueden especificarse conforme a técnicas y aplicaciones específicas, tal como lo hemos señalado previamente. Al modo de ejemplo podrían indicarse las siguientes: Centramiento en: Variable Ejemplos de técnicas p/tratamiento de datos: Estadística descriptiva Ejemplos de aplicaciones: Diseños experimentales. Estadística inferencial. Descripciones exploratorias. Validación y construcción de test Análisis correlacionales Unidad de análisis Análisis de pautas, índices, numéricos, segmentaciones. Elaboración de nosografías. Estudios estructurales. Segmentaciones poblacionales. Análisis narrativos. Valores/Variable Indicador/ Variable Codificación. Estudios culturales. Método comparativo constante. Aplicaciones instrumentales. Estudios hermeneúticos. Investigaciones hermeneúticas. Ampliaremos cada uno de estos temas en capítulos específicos, por lo que aquí sólo quedan señalados. VI.4. El análisis o la interpretación: ir “más allá de los datos”. El tratamiento de datos permite “compactar” o agregar la información producida de modo de tornarla manejable e interpretable. Una vez producido ese tratamiento la tarea consiste en interpretarla. Esto vale incluso en aquellas investigaciones que se inscriben en el llamado paradigma cualitativo en el que la construcción del dato, surge en el mismo momento en que es analizado. En ese caso, se deben distinguir dos momentos “interpretativos” con funciones muy distintas. Por una parte, lo que podríamos llamar “micro-interpretaciones” que van permitiendo categorizar o clasificar la información (como cuando se “rotula” una frase o se le adscribe una categoría interpretativa en el tratamiento de material discursivo o equivalente). Otro momento corresponde al análisis e interpretación más integral, en la que esos fragmentos previamente interpretados y transformados en dato, cobran nuevo sentido en mapas, redes semánticas o cuadros más abarcativos, a partir de los cuales emergen hipótesis de interpretación. En tal sentido la función de interpretación de datos propia de la fase 3 implica, como ya lo adelantamos “ir más allá de los datos” para integrarlos al cuerpo de una teoría o concepción teórica más amplia. El concepto de intepretación tiene un alcance específico en semiótica: interpretar un signo es poner algo en reemplazo de él. La definición peirciana de signo, dice que: “signo es algo que se pone en lugar de otra cosa, en algún aspecto o capacidad suya para alguien”. Si se señala con el dedo en una cierta dirección; ese gesto será efectivamente un signo si la mirada no se detiene en el dedo y se dirige a la cosa señalada 4. Si en cambio, en vez de dirigir la mirada a lo señalado se la dirige al dedo, “cae” la función de signo. Lo mismo ocurre con los datos: el análisis de datos supone ir más allá de ellos transformándolos en signos o material significante. Este más allá surge de las prácticas disciplinarias y las tradiciones teóricas que iluminan dichos datos. Si al presentar los datos “sólo se ven los datos” entonces han fracaso en su función. Veámoslo a la luz de un ejemplo sencillo. La demografía ha diseñado una estrategia de presentación de datos que resultan significativas para representar la “estructura de poblaciones según sexo y edad” bajo la forma de lo que llama “pirámide poblacional” 5: En esta “pirámide” cada escalón representa una cohorte de nacimientos, en sentido vertical, usualmente en tramos quinquenales o por decenio de edad. Del lado izquierdo se presentan los valores correspondientes a varones y del lado derecho a mujeres. El largo de cada escalón (en el sentido horizontal) expresa el porcentaje (o el número de casos) correspondiente a cada grupo. La pirámide siempre refiere a una unidad (de análisis) territorial: un país, una región, una provincia, etc. Empíricamente se observa que distintas configuraciones de esta pirámide remiten a distinto nivel de desarrollo de un grupo poblacional, de modo tal que, a partir del patrón demográfico se pueden inferir un conjunto de otros atributos o características de esa población. En los siguientes ejemplos se observan representaciones de tres tipos empíricamente frecuentes de pirámide poblacional: 1) la primera corresponde a una población en expansión (alta natalidad, alta mortalidad); 2) la segunda a una población estable (natalidad moderada y 4 El signo debe opacare y transparentarse al mismo tiempo: es decir, debe ser percibido y debe no ser percibido simultáneamente para que cumpla su función de signo (cfr. Recanati, 1981). 5 La pirámide de población es una representación gráfica de varias generaciones que refleja los patrones de natalidad y mortalidad y el efecto de los procesos migratorios, tanto pasados como presentes. distribución relativamente homogénea entre los distintos grupos de edad); 3) y la tercera a lo que se llama una población en declinación (baja natalidad, alta esperanza de vida). 1 2 3 Para un especialista estos gráficos tienen valor significante, es decir, ve allí “algo más” y algo distinto a lo que ve un lego (que sólo se “informa” del número o el porcentaje de población por edad y sexo). Estos gráficos le indican, por ejemplo, que la tasa de fecundidad es elevada en el primer caso, estable en el segundo y baja en el tercero (en este último podrá anticipar que no supera a los 2 hijos por mujer al final de la vida fértil). Que en el primer caso tendrán seguramente un peso muy importante las enfermedades infecto-contagiosas, mientras que en el tercero predominarán las enfermedades degenerativas. Que con alta probabilidad el patrón distributivo de ingresos es inequitativo en el primer caso, lo que se traduce en mayor pobreza, intermedio en el segundo, y más equitativo en el tercero. Comparando gráficos como estos pueden estimarse diferencias poblacionales (demográficas y sociales) entre distintas unidades territoriales de un mismo país o una misma región. Se puede todavía ir más lejos y hablar – como lo hace también la demografía- de transiciones demográficas asociadas a grandes estadios en el desarrollo social (según ciclos de desarrollo industrial, epidemológicos, etc.). Por supuesto que el alcance o la riqueza interpretativa no surge de la sola “pirámide poblacional”, esa riqueza dependerá de por lo menos dos tipos de cuestiones: a) por una parte, de la “intertextualidad” que domine el analista de estos datos (sea o no demógrafo/a de profesión). b) por la otra, de las tradiciones disciplinarias que abonen la evidencia empírica en relación al uso de este tipo de datos. De manera general podría enunciarse una ley general según la cual el análisis de datos tiene como tarea invariante: -la comparación de un estado de cosas existente (o dado empíricamente) con -un estado de cosas posible -en el marco de un modelo (o presunción) asumida como necesaria. Dicho de otro modo, se trata de: • Examinar lo empíricamente encontrado, • En el marco de lo lógicamente posible, para • Determinar su grado de “necesariedad” Así por ejemplo, una mera “distribución de frecuencias” sólo tiene sentido para el analista –con interés científico- si está en condiciones de comparar esa distribución (existente o dada) con algún modelo o patrón (ideado o inferido); para estimar hasta qué punto ella coincide o no con lo esperado: es decir, para evaluar hasta qué punto la diferencia que observa puede estimarse como contingente o necesaria desde la perspectiva del asunto que investiga. Veámoslo de manera más precisa (en base a un ejemplo desarrollado en Galtung, J. –1973): una distribución es una partición de N unidades en R partes. Entendiendo por R un espacioresultado conformado por el número de valores en los que potencialmente pueden ir a parar las N unidades analizadas. Si el espacio-resultado es unidimensional R es igual a r (es decir, al número de valores de la variable) si es bi-dimensional R=r1 x r2 ; si es n dimensional R= r1 x r2 …rn.). A modo de ejemplo, si se tienen tres unidades para un espacio con R=2, se obtienen cuatro distribuciones posibles o particiones de tres en dos partes: Distribuciones “posibles” (de N en R) R f1 f2 F3 f4 S 0 3 1 2 N 3 0 2 1 Supongamos que estas son distribuciones de “respuestas a un test” (N=3, es decir tres casos de respuesta) con dos valores posibles (r1=”positivo” o r2 =”negativo”); cada tipo de distribución se debería leer entonces de la siguiente manera: 1. “tres respuestas positivas y ninguna negativa” 2. “dos respuestas positivas y una negativa” 3. “una respuesta positiva y dos negativas”. 4. “ninguna respuesta positiva y tres respuestas negativas” Ante una distribución empírica o dada (cualquiera de las cuatro), el analista deberá juzgarla por referencia a las distribuciones lógicamente posibles, para evaluar luego si se corresponde con lo esperado (conforme a algún modelo o hipótesis). Tamaño de la muestra N Si aumentan N y R el número de posibles particiones de N en R se torna inmanejable. Galtung presenta al respecto la siguiente tabla (op.cit.: 229): 1 2 3 4 5 . . . 10 1 1 1 1 1 1 1 Tamaño del espacio-resultado R 2 3 4 5 2 3 4 5 3 6 10 15 4 10 20 35 5 15 35 70 6 21 56 126 ……. 10 . . . . . . . . 92378 Si un investigador maneja –por caso- una muestra de 120 unidades; potencialmente distribuibles en dos variables dicotómicas (lo que da un espacio-resultado de 4) no tiene que conocer (y aunque quisiera le sería prácticamente imposible hacerlo) todas las distribuciones en que potencialmente podrían presentarse los casos. Pero sin duda debe saber que la distribución que ha obtenido (empíricamente) es una entre unas cuantas distribuciones lógicamente posibles. Usualmente el camino que se sigue es el inverso: se postula cierto comportamiento esperado (conforme a alguna presunción o modelo) y se juzga lo dado (empíricamente) para saber si las variaciones o diferencias entre lo dado empíricamente y lo postulado teóricamente son o no relevantes. De igual modo ocurre con la estadística inferencial. Los resultados empíricos se deben juzgar por referencia a su ubicación en el espacio que de una función continua de probabilidades. Este espacio define el conjunto de posibilidades. Dicho de otro modo, el valor que se ha obtenido empíricamente es “uno” entre un conjunto de posibles valores que se podrían haber obtenido con una muestra aleatoria de tamaño “n” (los que considerados conjuntamente constituyen la totalidad de ese espacio de probabilidades). La decisión estadística depende de cómo se juzgue ese valor por referencia a los valores posibles que podrían haberse obtenido, y cómo se defina la zona de alta o baja probabilidad. Ahora bien, el alcance de esa decisión, que tendrá consecuencias en lo que se llama “significación estadística” no define ipso facto la “significación sustancial” de un dato. Se requiere para ello juzgar esos resultados a la luz de un modelo, una teorización que le confiera la significación disciplinaria específica. Y esta significación no se deriva nunca de una mera aplicación técnica, sino de los modelos en el que ese hallazgo pueda ser integrado. Por lo demás, interesa señalar que estos principios no son privativos del análisis e interpretación de datos cuantitativos. Podrían aplicarse de igual modo en aquellas investigaciones de orientación interpretativa o hermeneútica. Así, por ejemplo, cuando Sigmund Freud analiza “la técnica del chiste”, su estrategia consiste en examinar lo “empíricamente dado” a la luz de lo “lógicamente posible” (o esperable); para luego examinar en base a ello su carácter necesario en el marco de su teoría interpretativa. Así comenta, el caso de un chiste que lo inspira en esta dirección: En el fragmento de los Reisebilder titulado «Los baños de Lucas» nos presenta Heine la regocijante figura de Hirsch-Hyacinth, agente de lotería y extractador de granos, que, vanagloriándose de sus relaciones con el opulento barón de Rotschild, exclama: «Tan cierto como que de Dios proviene todo lo bueno, señor doctor, es que una vez me hallaba yo sentado junto a Salomón Rotschild y que me trató como a un igual suyo, muy «famillionarmente» (familionär)». A los efectos de examinar la “técnica del chiste”, lo primero que propone es explicitar lo que queda implícito en él, es decir, lo que hubiese sido esperable en el contexto del discurso. Lo señala en los siguientes términos: “Intentemos expresar con la mayor fidelidad el mismo pensamiento en palabras distintas. (…) No alteraremos en nada este sentido, dando al pensamiento otra forma que quizá se adapta más a la frase de Hirsch-Hyacinth: «Rotschild me trató como a su igual, muy familiarmente, aunque claro es que sólo en la medida en que esto es posible a un millonario». «La benevolencia de un rico es siempre algo dudosa para aquel que es objeto de ella», añadiríamos nosotros”. Al explicitar el contenido latente del chiste, Freud advierte que pierde así su efecto cómico. Considera entonces que dicho efecto proviene de la forma del enunciado antes que de su contenido. En el examen de esa forma, encuentra dos mecanismos comprometidos en la estructura discursiva del chiste: los denomina proceso de condensanción y formación sustitutiva. En el caso del ejemplo, la palabra famillionarmente» (familionär) –la que no tiene ninguna significación en el código lingüístico- condensa en una sola expresión dos términos: familiarmente y millonario. De modo tal que ella sola sustituye a ambos: “Es, pues, la nueva palabra una formación mixta de los dos componentes «familiarmente» y «millonario» y podemos representar gráficamente su génesis en la forma que sigue: FAMILI ÄR MILIONÄR ----------------------------FAMILIONÄR Ahora bien, para que estos mecanismos adquieran carácter necesario, debe mostrar su regularidad en el marco del fenómeno que se describe; deben iluminarse a partir de un modelo de alcance más amplio. Eso ocurre al menos de dos maneras en el desarrollo del trabajo de Freud. Por una parte, una vez identificado el mecanismo en el análisis de un caso, se pregunta si ese mecanismo puede hacerse extensivo a un conjunto más amplío de ejemplares semejantes: “Nuestra esperanza de que la técnica del chiste no podía por menos de revelarnos la íntima esencia del mismo nos mueve, ante todo, a investigar la existencia de otros chistes de formación semejante a la del anteriormente examinado”. Pero además, estos mecanismos se irán develando progresivamente como un modo de funcionamiento típico de los procesos inconscientes. Como una regla general de su funcionamiento, dado que la vuelve a encontrar en otras “formaciones del inconsciente” como los actos fallidos o los sueños. Y la justificación y comprensión de ellos, no vendrá sólo de la descripción de su forma (o de la “técnica del chiste” –como la llama en este trabajo-) sino también de la identificación de su funcionalidad y de los fines a los que sirven según el modelo teórico que desarrolla: su teoría general del psiquismo humano (como por ejemplo, en el marco de su tesis sobre la represión y ocultamiento de experiencias o representaciones que deben mantenerse alejadas de la conciencia). Dicho de otra manera, deberá mostrar no sólo la consistencia de estas interpretaciones para caracterizar los hechos (en este caso, los chistes que analiza) sino también la coherencia interna que estas interpretaciones guardan con el cuerpo más amplío de una teoría que las integra y les confiere su carácter retóricamente convincente. Esta doble exigencia –entre consistencia entre el modelo y los datos; y, coherencia interna del modelo- parece ser un principio general que vale para cualquier tipo de tratamiento e interpretación de datos. La coherencia interna en el marco del proceso de investigación requiere integrar los resultados en un mapa nomológico que recupere los desarrollos del marco conceptual, de los objetivos asumidos y los problemas e hipótesis planteados. Conforme con ello, el alcance del análisis de datos estará fuertemente determinado por el cuerpo conceptual o teórico que guía la investigación; del que emanan los modelos y las hipótesis que iluminan las intepretaciones disponibles para el analista. Mientras que éstas hunden sus raíces en los métodos pre y protocientíficos al que nos hemos referido al tratar el tema de hipótesis: es decir, en sus intuiciones y representaciones práxicamente pregnantes. El alcance y la riqueza de esa interpretación no depende de que la información sea densa o analítica, cualitativa o cuantitativa, discursiva o estadística: depende, por el contrario, de la profundidad y riqueza de los modelos y marcos conceptuales que maneja el equipo de investigación; de la capacidad que esos marcos tengan para “hacer hablar” a esa información. Analizando registros estadísticos Emilio Durkheim interpretó las tasas de suicidio como expresión de distintos tipos de solidaridad social: la distinta propensión al suicidio entre diferentes grupos religiosos, institucionales, familiares, etc. expresaría diferentes formas de integración del individuo al grupo: “La causa [del suicidio] no puede encontrarse más que en una propiedad que todos estos grupos sociales tienen en común, aunque tal vez en diferentes grados. Ahora bien, la única que satisface esta condición es la de que todos ellos son grupos sociales, fuertemente integrados. Llegamos así a esta conclusión general: el suicidio varía en razón inversa del grado de integración de los grupos sociales de que forma parte el individuo. (…) del grado de integración de la sociedad religiosa, doméstica y política. (1965:164). El lector/a interesado puede ampliar con provecho el texto de Durkheim en la fuente de referencia. Sin duda es una obra enormemente instructiva para comprender el proceso de tratamiento y análisis de datos. Sus hipótesis interpretativas se dirigen a comprender el metabolismo representacional (y moral) de las sociedades que analizó (aunque no trabajó con discursos sino con registros estadísticos). Buscaba identificar patrones que permitieran enunciar comportamientos regulares (no coyunturales); tal como lo tiene planteado todo trabajo con vocación científica. No presentó los índices de suicidio como lo puede hacer la noticia periodista -para horrorizar o para sorprender a nadie-: se proponía identificar alguna regularidad, que pudiera luego ser corroborada o refutada por otros estudios 6. Bibliografía de referencia. Durkheim, E. (1965) -El suicidio. Estudio de Sociología. Ed. Shapire, Buenos Aires. Galtung, J. (1973) Teoría y Técnicas de la investigación social. Buenos Aires. EUDEBA, Tomo I y II. Glasser y Strauss (1967) The discovery of grounded theory. Strategy for qualitative reaserch. New York, Ed. Aldine (Traducción inédita de Floreal Forni). Lazarsfeld, P. (1966), "De los conceptos a los índices empíricos", en Boudon y Lazarsfeld, Metodología de las Ciencias Sociales, Vol. I y II, Barcelona, Ed. Laia, 1979. Pereda, S. (1987) Psicología experimental. I. Metodología. Ed. Piramide. Madrid, Cap. 2 pto. 5.3. “El método experimental” (60 a 66) Cap. 7 pto. 5 “Las variables relevantes” (pág. 145 a 168) Cap. 8 Récanati, F.; 1981. La transparencia y la enunciación. Introducción a la pragmática, Ed. Hachette, Buenos Aires. Samaja, J. (1993) Metodología y Epistemología. Buenos Aires, Ed. Eudeba. Torrado, S. (1998) Familia y diferenciación social. Cuestiones de Método. Buenos Aires, Ed. Eudeba. 6 En esa dirección interesa diferenciar también el alcance del tratamiento y análisis de datos en los estudios diagnósticos (sean éstos poblacionales, clínicos o de laboratorio) de los estudios científicos propiamente dichos. Sin duda que la elaboración de un buen diagnóstico exige seguir el método científico, pero los resultados producidos en el marco de dichos diagnósticos no tienen la pretensión de ir más allá que la de informar sobre un estado de situación, por referencia a un marco de categorías e indicadores ya establecidos. Así, por ejemplo, si se estudia la “incidencia de pobreza en la población Argentina a lo largo de la última década”, el resultado de ese informe puede reducirse a estimar distribuciones de población pobre; medida con algún indicador ya consagrado como el NBI (Necesidades Básicas Insatisfechas) o LP (Línea de Pobreza) según edad, sexo, composición familiar, etc., etc., etc. sin aportar pese a ello ninguna novedad relevante al cuerpo conceptual de la teoría social; aún cuando la información producida pueda ser muy útil para la planificación de políticas o la intervención social. Si en cambio el estudio se dirige a crear indicadores para la evaluación de la pobreza –o para discutir el alcance conceptual y eventualmente operacional del concepto de «pobreza»- entonces sí puede hablarse de investigación científica en sentido estricto: y el tratamiento y el análisis de datos tienen entonces planteada otra tarea y otra exigencia de validación y justificación.