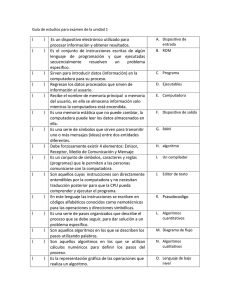

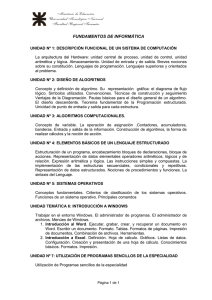

Transparencias

Anuncio

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

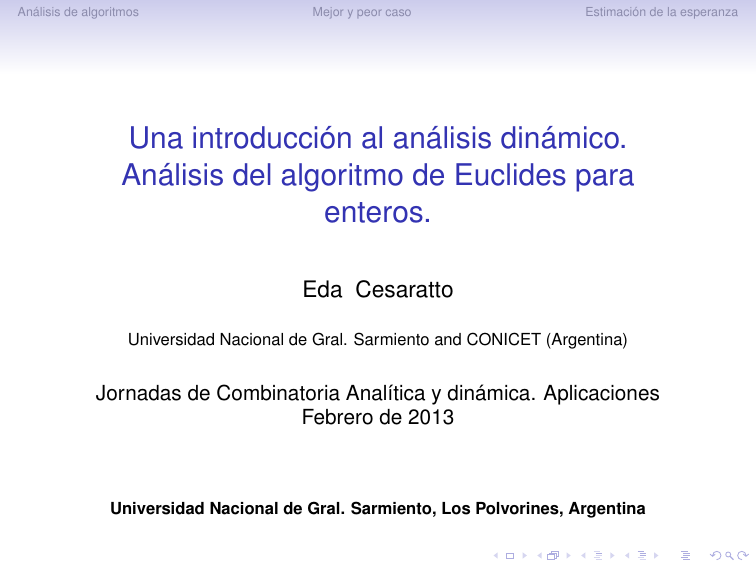

Una introducción al análisis dinámico.

Análisis del algoritmo de Euclides para

enteros.

Eda Cesaratto

Universidad Nacional de Gral. Sarmiento and CONICET (Argentina)

Jornadas de Combinatoria Analítica y dinámica. Aplicaciones

Febrero de 2013

Universidad Nacional de Gral. Sarmiento, Los Polvorines, Argentina

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Objetivos del curso

• Problema: estimar, en promedio, la cantidad de pasos que

realiza el algoritmo de Euclides para enteros

• Metodología: Análisis dinámico de algoritmo de Euclides

Referencias principales:

D. Knuth, The Art of Computer Programming, 3rd edition, Addison Wesley, (1998).

B. Vallée, Dynamical analysis of a class of euclidean algorithms,

Theoretical Computer Science 297, no 1-3, 447–486 (2003).

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Entrada: un par de enteros (u, v ) de los que suponemos que

0 < u < v.

Salida: un entero que es igual al mcd(u, v ).

Algoritmo de Euclides: v1 = u, v0 = v .

0 ≤ 0 < v2 < v1

v0 = m1 v1 + v2

... = ... + ...

vk −1 = mk vk + 0

vk +1 = 0

El mcd es igual al último resto no nulo vk := mcd(u, v ).

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Entrada: un par de enteros (u, v ) de los que suponemos que

0 < u < v.

Salida: un entero que es igual al mcd(u, v ).

Algoritmo de Euclides: v1 = u, v0 = v .

0 ≤ 0 < v2 < v1

v0 = m1 v1 + v2

... = ... + ...

vk −1 = mk vk + 0

vk +1 = 0

El mcd es igual al último resto no nulo vk := mcd(u, v ).

Los números (m1 , m2 , . . . , mp ) se llaman cocientes parciales.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Algoritmo de Euclides y fracciones continuas

Ejemplo: u = 4 y v = 11.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Algoritmo de Euclides y fracciones continuas

Ejemplo: u = 4 y v = 11.

11 = 2 · 4 + 3

0<3<4

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Algoritmo de Euclides y fracciones continuas

Ejemplo: u = 4 y v = 11.

11 = 2 · 4 + 3

4 = 1·3 + 1

0<3<4

0<1<3

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Algoritmo de Euclides y fracciones continuas

Ejemplo: u = 4 y v = 11.

11 = 2 · 4 + 3

4 = 1·3 + 1

3 = 3·1 + 0

0 < 3 < 4

0<1<3

v4 = 0

El máximo común divisor es v3 = 1 y los cocientes parciales son

m1 = 2, m2 = 1, m3 = 3.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

4=1·3+1

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

4/3 = 1 + 1/3

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

1

3/4 =

1 + 1/3

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

1

3/4 =

1 + 1/3

11 = 2 · 4 + 3

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

1

3/4 =

1 + 1/3

11/4 = 2+3/4 = 2+

1

1 + 1/3

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

1

4/11 =

1

2+

1

1+

1

3

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

De Euclides a las fracciones continuas

Algoritmo de Euclides: u = 4 y v = 11.

0 < 3 < 4

11 = 2 · 4 + 3

4 = 1·3 + 1

0<1<3

3 = 3·1 + 0

v4 = 0

Fracciones continuas

1

4/11 =

1

2+

1

1+

1

3

La función

φ(u, v ) = (m1 , . . . , mk , vk ) es

biyectiva.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

¿Por qué analizar un algoritmo?

Para anticipar

• el tiempo de ejecución

• el espacio de memoria requerido.

Con el objeto de

• evaluar si es viable

• comparar con otro algoritmos diseñados para la misma

tarea

Algoritmo de Euclides

Anticipar cuántas divisiones va a realizar el algoritmo.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Análisis del algoritmo de Euclides

• La entrada es un par de números enteros (u, v ) en el

conjunto

Ω = (u, v ) ∈ Z2 : 0 < u < v , gcd(u, v ) = 1

• La salida ṽk del algoritmo de Euclides es un número

natural

• La traza es la sucesión de cocientes parciales mi que son

números naturales.

Para cada par (u, v )

C(u, v ) = núm. de pasos del algoritmo de Euclides sobre (u, v )

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

La noción de talla

La talla (size) de un par (u, v ) se define como v .

Sea ΩN el conjunto de entradas que tienen talla igual a N

n

o

ΩN = (u, v ) ∈ Z2 : 0 < u < v ≤ N, gcd(u, v ) = 1

Ω2 = {(1, 2)} y card Ω2 = 1

Ω4 = {(1, 2), (1, 3), (1, 4), (2, 3)} y card Ω4 = 4

Primera pregunta combinatoria.

¿Cuántos elementos tiene ΩN ?

card ΩN = card {pares de naturales (u, v ) coprimos y con v ≤ N }

Teorema (clásico): card ΩN ∼

3

N2

π2

Análisis de algoritmos

Mejor y peor caso

Mejor caso

Para

v =N

u = 1,

resulta

N =N ·1+0

Entonces, C(u, v ) = 1.

Estimación de la esperanza

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Peor caso

El análisis del peor caso es atribuido a Lamé (1844).

Algunos autores lo consideran el primer estudio relacionado con

el análisis de algoritmos (Shallit, 1994).

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Peor caso

El análisis del peor caso es atribuido a Lamé (1844).

Algunos autores lo consideran el primer estudio relacionado con

el análisis de algoritmos (Shallit, 1994).

Idea

• La mayor cantidad de divisiones se debe realizar cuando

todos los cocientes parciales mi son iguales a 1

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Peor caso

El análisis del peor caso es atribuido a Lamé (1844).

Algunos autores lo consideran el primer estudio relacionado con

el análisis de algoritmos (Shallit, 1994).

Idea

• La mayor cantidad de divisiones se debe realizar cuando

todos los cocientes parciales mi son iguales a 1

• En ese caso los restos deben cumplir la recurrencia

vn−1 = vn + vn+1

(Fibonacci)

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Peor caso

El análisis del peor caso es atribuido a Lamé (1844).

Algunos autores lo consideran el primer estudio relacionado con

el análisis de algoritmos (Shallit, 1994).

Idea

• La mayor cantidad de divisiones se debe realizar cuando

todos los cocientes parciales mi son iguales a 1

• En ese caso los restos deben cumplir la recurrencia

vn ∼ φn

φ = (1 +

√

5)/2

(φ es el número de oro)

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Peor caso

El análisis del peor caso es atribuido a Lamé (1844).

Algunos autores lo consideran el primer estudio relacionado con

el análisis de algoritmos (Shallit, 1994).

Idea

• La mayor cantidad de divisiones se debe realizar cuando

todos los cocientes parciales mi son iguales a 1

• En ese caso los restos deben cumplir la recurrencia

N ∼ v0 ∼ φn

(φ es el número de oro)

Teorema Si 0 < u < N, el número de pasos requeridos por el

algoritmo de Euclides aplicado a u y v es, a lo sumo,

blogφ ((3 − φ)N)c (φ es el número de oro)

.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Comparación con el caso de polinomios

Polinomios

• La salida ṽk pertenece a

P = {v ∈ Fq [X ] : lc(v ) = 1} ,

|v | = deg v

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Comparación con el caso de polinomios

Polinomios

• La salida ṽk pertenece a

P = {v ∈ Fq [X ] : lc(v ) = 1} ,

|v | = deg v

• Los cocientes parciales mi pertenecen a

F = {v ∈ Fq [X ]; deg(v ) ≥ 1}

|v | = deg v

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Comparación con el caso de polinomios

Polinomios

• La salida ṽk pertenece a

P = {v ∈ Fq [X ] : lc(v ) = 1} ,

|v | = deg v

• Los cocientes parciales mi pertenecen a

F = {v ∈ Fq [X ]; deg(v ) ≥ 1}

|v | = deg v

• El conjunto de pares para los cuales el costo es

exactamente k es

Ωk = ∪n Ωn,k

|(u, v )| = deg v

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Comparación con el caso de polinomios

Polinomios

• La salida ṽk pertenece a

P = {v ∈ Fq [X ] : lc(v ) = 1} ,

|v | = deg v

• Los cocientes parciales mi pertenecen a

F = {v ∈ Fq [X ]; deg(v ) ≥ 1}

|v | = deg v

• El conjunto de pares para los cuales el costo es

exactamente k es

Ωk = ∪n Ωn,k

|(u, v )| = deg v

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Comparación con el caso de polinomios

Polinomios

• La salida ṽk pertenece a

P = {v ∈ Fq [X ] : lc(v ) = 1} ,

|v | = deg v

• Los cocientes parciales mi pertenecen a

F = {v ∈ Fq [X ]; deg(v ) ≥ 1}

|v | = deg v

• El conjunto de pares para los cuales el costo es

exactamente k es

Ωk = ∪n Ωn,k

La función φ : Ωk 7→ F k × P,

|(u, v )| = deg v

φ(u, v ) = (m1 , . . . , mk , ṽk )

es una biyección que preserva talla.

Enteros

La función φ es una función que NO preserva la talla.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Comparación con el caso de polinomios

Polinomios

• La salida ṽk pertenece a

P = {v ∈ Fq [X ] : lc(v ) = 1} ,

|v | = deg v

• Los cocientes parciales mi pertenecen a

F = {v ∈ Fq [X ]; deg(v ) ≥ 1}

|v | = deg v

• El conjunto de pares para los cuales el costo es

exactamente k es

Ωk = ∪n Ωn,k

La función φ : Ωk 7→ F k × P,

|(u, v )| = deg v

φ(u, v ) = (m1 , . . . , mk , ṽk )

es una biyección que preserva talla.

Enteros

La función φ es una función que NO preserva la talla.

Ejemplo: u = 4 y v = 11, m1 = 2, m2 = 1, m3 = 3 y v3 = 1.

Notar que 2 + 1 + 3 + 1 = 7 6= 11.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Análisis probabilístico

D. Knuth, The Art of Computing Programming, Vol. 2,

Addison-Wesley, (1969).

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio

teorema

Para entradas aleatorias (u, v ) ∈ ΩN , la esperanza de la

variable CN que cuenta el número de divisiones del algoritmo

de Euclides satisface

EN [CN ] =

12 log 2

log N (1 + (N))

π2

con (N) → 0 donde N → ∞.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio

teorema

Para entradas aleatorias (u, v ) ∈ ΩN , la esperanza de la

variable CN que cuenta el número de divisiones del algoritmo

de Euclides satisface

EN [CN ] =

12 log 2

log N (1 + (N))

π2

con (N) → 0 donde N → ∞.

Mejor caso: 1

Peor caso: logφ ((3 − φ)N) ∼ 2.07 ln N + 0.67.

Caso promedio:∼

12 log 2

π2

log N ∼ 0.36 ln N

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio. Análisis dinámico

• Problema combinatorio: número de pasos del Algoritmo

de Euclides sobre los pares de enteros (u, v ) con

0 < u < v ≤ N, u y v coprimos

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio. Análisis dinámico

• Problema combinatorio: número de pasos del Algoritmo

de Euclides sobre los pares de enteros (u, v ) con

0 < u < v ≤ N, u y v coprimos

• Funciones generatrices bivariadas

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio. Análisis dinámico

• Problema combinatorio: número de pasos del Algoritmo

de Euclides sobre los pares de enteros (u, v ) con

0 < u < v ≤ N, u y v coprimos

• Series de Dirichlet bivariadas

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio. Análisis dinámico

• Problema combinatorio: número de pasos del Algoritmo

de Euclides sobre los pares de enteros (u, v ) con

0 < u < v ≤ N, u y v coprimos

• Series de Dirichlet bivariadas

• Esperanza y series de Dirichlet

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio. Análisis dinámico

• Problema combinatorio: número de pasos del Algoritmo

de Euclides sobre los pares de enteros (u, v ) con

0 < u < v ≤ N, u y v coprimos

• Series de Dirichlet bivariadas

• Esperanza y series de Dirichlet

• Expresión alternativa: operadores de tranferencia.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Caso promedio. Análisis dinámico

• Problema combinatorio: número de pasos del Algoritmo

de Euclides sobre los pares de enteros (u, v ) con

0 < u < v ≤ N, u y v coprimos

• Series de Dirichlet bivariadas

• Esperanza y series de Dirichlet

• Expresión alternativa: operadores de tranferencia.

• Extracción de coeficientes: teoremas tauberianos

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Serie de Dirichlet

Series de Dirichlet bivariadas

S(s, w) =

1

(u,v )∈Ω v s

P

S(s, 0) = S0 (s) :=

exp[wC(u, v )]

1

(u,v )∈Ω v 2s .

P

Supongamos que S(s, w) se puede derivar alrededor de w = 0,

sean an y bn tales que P

P

∂w S(s, w)|w=0 = n≥1 na2sn

S0 (s) = n≥1 nb2sn .

Como por definición

P an y bn son iguales a P

an := (u,n)∈Ω C(u, n)

bn := (u,n)∈Ω 1,

EN [CN ] =

P

an

Pn≤N

b

n≤N n

P

=

n≤N

an

card ΩN

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Extracción de coeficientes. Teorema tauberiano de

Delange

Theorem P

Sea F (s) = n an n−2s una serie de Dirichlet con coeficientes

an ≥ 0 tal que F (s) converge en <s > σ > 0. Si vale que

(i) F (s) es analítica en <s ≥ σ > 0, s 6= σ, y

(ii) en un entorno de s = σ, para algún γ ≥ 0, se tiene

F (s) = A(s)(s − σ)−` + C(s), donde A, C, son analítica en

σ, con A(σ) 6= 0.

Entonces, cuando N → ∞,

X

n≤N

an =

A(2σ)

N 2σ (log N)`−1 (1 + (N)),

2(` − 1)!σ

(N) → 0.

Análisis de algoritmos

Mejor y peor caso

Teorema tauberiano dibujado

singularidades

σ

Dominio dePuna serie de Dirichlet S(s) = n an n−2s

Estimación de la esperanza

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Teorema tauberiano dibujado

singularidades

σ

polo doble

σ

Dominio dePuna serie de Dirich- Bajo estas circunstancias:

PN

2σ log N

let S(s) = n an n−2s

n=1 an ∼ N

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Ejercicio guiado

Probar que card ΩN ∼

3

N2

π2

1. Escribir la serie de Dirichlet de card ΩN de dos formas

distintas.

P

P

P

2s = ζ(2s)

2s

2.

d≥1

gcd(u,v )=d 1/v

gcd(u,v ) 1/v

P

P

2s = ζ(2s − 1).

3.

d≥1

gcd(u,v )=d 1/v

4. Usar que ζ(s) ∼ 1/(s − 1) para concluir que

ζ(2s − 1)/ζ(2s) ∼ 1/(2ζ(2)(s − 1)).

5. ζ(2) =

π2

6

6. Concluir usando el teorema Tauberiano de Delange.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Euclides y Gauss

El sistema dinámico inducido por

la transformación de Gauss

V : [0, 1] 7→ [0, 1]

V (x) = { x1 } V (0) = 0

Cualquier número α ∈ [0, 1]

admite ser expresado como

una fracción continua

mi (α) = bV i (α)c

...

x

1

α=

1

m1 +

m2 +

1

..

.+

1

mk +

1

..

.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Euclides y Gauss

El sistema dinámico inducido por

la transformación de Gauss

V : [0, 1] 7→ [0, 1]

V (x) = { x1 } V (0) = 0

Cualquier número α ∈ [0, 1]

admite ser expresado como

una fracción continua

mi (α) = bV i (α)c

...

x

1

α=

1

m1 +

m2 +

1

..

.+

1

mk +

1

..

.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Euclides y Gauss

El sistema dinámico inducido por

la transformación de Gauss

V : [0, 1] 7→ [0, 1]

V (x) = { x1 } V (0) = 0

Cualquier número α ∈ [0, 1]

admite ser expresado como

una fracción continua

mi (α) = bV i (α)c

...

x

1

α=

1

m1 +

m2 +

1

..

.+

1

mk +

1

..

.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Euclides y Gauss

El sistema dinámico inducido por

la transformación de Gauss

V : [0, 1] 7→ [0, 1]

V (x) = { x1 } V (0) = 0

Cualquier número α ∈ [0, 1]

admite ser expresado como

una fracción continua

mi (α) = bV i (α)c

...

x

1

α=

1

m1 +

m2 +

1

..

.+

1

mk +

1

..

.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Ramas inversas

El sistema dinámico de Euclides

es inducido por la transformación

de Gauss V : [0, 1] 7→ [0, 1]

V (x) = { x1 } V (0) = 0

Ramas inversas:

1

h[m] : x 7→ m+x

y

1/3

...

1

x

h3 (x) =

Conjunto de ramas inversas:

H := {h;

h[m] : x 7→

1

m+x ,

m ≥ 1}

1

3+x

x

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Ramas inversas

Ramas inversas: H := {h[m] : x 7→

1

m+x ,

m ≥ 1}

Sea h := h[m1 ] ◦ h[m2 ] ◦ . . . ◦ h[mk ] .

Vale que

u

=

v

1

= h[m1 ] ◦ h[m2 ] ◦ . . . ◦ h[mk ] (0)

1

m1 +

m2 +

1

..

.+

1

mk

Cada racional vu queda asociado a una única h en Hk . Para esta

rama h vale que

1

= |h0 (0)| C(u, v ) = k

v2

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Expresión alternativa para la serie de Dirichlet

Operador de transferencia (Ruelle)

Sea f ∈ C 1 ([0, 1]), el operador de transferencia se define como

X

Hs [f ](x) =

|h0 (x)|s f ◦ h(x)

h∈H

para los números complejos s con <s > 12 y w en un entorno

de w = 0.

Propiedad de las cuasi-potencias

X

|h0 (x)|s f ◦ h(x)

Hks [f ](x) =

h∈Hk

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Expresiones alternativas para las series de Dirichlet

• S(s, w) =

1

(u,v )∈Ω v 2s

P

exp[wC(u, v )]

• v12 = |h0 (0)|

C(u, v ) = C(h) = k

• Hks [f ](x) =

h∈Hk

P

|h0 (x)|s f ◦ h(x)

Expresión alternativa:

S(s, w) ∼

X

k ≥1

ek w

X

|h0 (0)|s =

X

ek w Hks [1](0)

k ≥1

h∈Hk

−1

S(s, w) = (Id − ew Hs )

[1](0).

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

Recordemos que

S(s, w) = (Id − ew Hs )−1 [1](0)

Propiedad espectral “fácil”

limn→∞ kHns k1/n < 1

si y solo si

<s > 1 o (<s = 1 y s 6= 1).

Entonces, S(s, w) tiene abscisa de

convergencia

σ(w) ∼ 1 cuando w ∼ 0.

sing.

σ(w)

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

• λ(s) es el autovalor más grande en valor absoluto,

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

• λ(s) es el autovalor más grande en valor absoluto,

• vale 1 solamente en s = 1,

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

• λ(s) es el autovalor más grande en valor absoluto,

• vale 1 solamente en s = 1,

• Ps ◦ Ns = Ns ◦ Ps = 0,

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

• λ(s) es el autovalor más grande en valor absoluto,

• vale 1 solamente en s = 1,

• Ps ◦ Ns = Ns ◦ Ps = 0,

• kNs k < 1.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

• λ(s) es el autovalor más grande en valor absoluto,

• vale 1 solamente en s = 1,

• Ps ◦ Ns = Ns ◦ Ps = 0,

• kNs k < 1.

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

• λ(s) es el autovalor más grande en valor absoluto,

• vale 1 solamente en s = 1,

• Ps ◦ Ns = Ns ◦ Ps = 0,

• kNs k < 1.

S(s, w) = (Id − ew Hs )−1 [1](0).

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Propiedades espectrales de Hs

El operador de transferencia satisface la siguiente descomposición en un entorno de s = 1 y w = 0:

Hs = λ(s)Ps + Ns

donde

• λ(s) es el autovalor más grande en valor absoluto,

• vale 1 solamente en s = 1,

• Ps ◦ Ns = Ns ◦ Ps = 0,

• kNs k < 1.

S(s, w) = (Id − ew Hs )−1 [1](0).

S(s, w) ∼

1

1−ew λ(s) Ps [1](0)

s∼1w ∼0

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Serie de Dirichlet y extracción de coeficientes

S(s, w) ∼

1

1−ew λ(s) Ps [1](0).

polo simple

σ(w)

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Serie de Dirichlet y extracción de coeficientes

∂w S(s, w) ∼

ew

P [1](0)

(1−ew λ(s))2 s

∂w S(s, w) ∼

1

P [1](0).

(s−σ(0)λ0 (s))2 s

σ(w)

• El polo s = σ(w) satisface la ecuación ew λ(s) = 1.

• σ(0) = 1

• λ0 (1) = −1/ζ(2).

Tranferencia final

∂w S(s, w)|w=0 = (s−1)λ1 0 (1))2 Ps [1](0).

⇒

2

EN [C] = ∂w S(s,w)|w=0 ∼ 12πlog

log N

2

card ΩN

Análisis de algoritmos

Mejor y peor caso

Estimación de la esperanza

Más acerca de algoritmos euclidianos

Brigitte Vallée y sus coautores:

• Análisis en promedio de variantes del algoritmo de

Euclides, incluyendo versiones rápidas

• Análisis del Algoritmo binario

• Análisis en distribución de variantes del algoritmo de

Euclides tradicional