Probabilidad

Anuncio

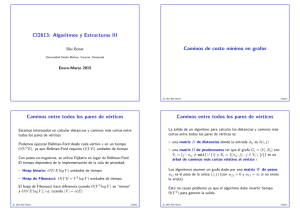

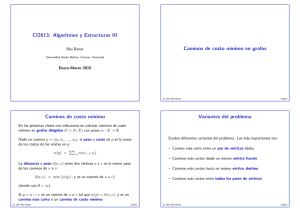

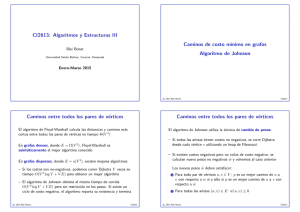

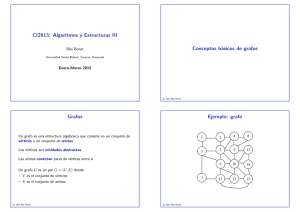

CI2612: Algoritmos y Estructuras de Datos II

Análisis probabilı́stico

Blai Bonet

Universidad Simón Bolı́var, Caracas, Venezuela

c 2016 Blai Bonet

Objetivos

Espacio de probabilidad

Las probabilidades se definen sobre un espacio de probabilidad

• Estudiar los elementos básicos de la teorı́a de probabilidad para

realizar los análisis necesarios de algoritmos

El espacio de probabilidad lo conforman:

– el espacio muestral Ω que contiene todos los posibles resultados

del experimento o proceso probabilı́stico

• Ejemplos de análisis probabilı́stico

– el conjunto F de eventos a considerar (en nuestro caso todos los

subconjuntos de Ω)

– la función o medida de probabilidad P(·) definida sobre los

eventos

c 2016 Blai Bonet

c 2016 Blai Bonet

Ejemplo: Lanzar una moneda

Eventos

Considere el experimento de lanzar una moneda

Existen dos posibles resultados del experimento: Ω = {H, T }

El conjunto de eventos es F = {∅, {H}, {T }, {H, T }}:

Para cada ω ∈ Ω, el evento {ω} se llama evento atómico y

representa un único resultado del experimento

Los otros eventos denotan conjuntos de posibles resultados los

cuales son útiles para el análisis del experimento

– El evento ∅ denota que el experimento no dió ninguń resultado

– El evento {H} denota que la moneda salió cara

Por ejemplo, si el experimento es lanzar un dado, podemos hablar del

evento que el dado cae en un número par

– El evento {T } denota que la moneda salió cruz

– El evento {H, T } denota que la moneda salió cara o cruz

Si la moneda es insesgada (resultados equiprobables), definimos:

P(∅) = 0, P({H}) = P({T }) = 12 , y P({H, T }) = 1

c 2016 Blai Bonet

Después de realizar el experimento, podemos decir cuando un evento

es cierto o falso. Si el resultado del experimento es ω, decimos que el

evento E es cierto si ω ∈ E. Si ω ∈

/ E, el evento E es falso

c 2016 Blai Bonet

Función (medida) de probabilidad

La función de probabilidad P es una función P : F → [0, 1] que asigna

probabilidaddes a los eventos y debe satisfacer:

Probabilidad del evento complemento

Considere un evento E que denota un posible resultado del

experimento

P1. P(Ω) = 1

P2. para toda colección {Ei }i de eventos que sean disjuntos dos a

dos (i.e. Ei ∩ Ej = ∅ para todo 1 ≤ i < j ≤ n):

P(∪ni=1 Ei ) = P(E1 ) + P(E2 ) + · · · + P(En )

P(E) es la probabilidad de que dicho resultado suceda mientras que

P(E c ), donde E c = Ω \ E, es la probabilidad de que no suceda

Por la aditividad de la medida y la propiedad P1:

P(E c ) = P(Ω) − P(E) = 1 − P(E)

Por lo tanto, 1 = P(Ω) = P(Ω) + P(∅) =⇒ P(∅) = 0

c 2016 Blai Bonet

c 2016 Blai Bonet

Ejemplo: Lanzar dos monedas

Independencia de dos eventos

Ahora considere dos monedas insesgadas e “independientes”

Definimos:

Considere un espacio (Ω, F, P) y dos eventos E1 , E2 ∈ F

E1 es independiente de E2 si conocer alguna información sobre la

ocurrencia de E1 no altera nuestra creencia sobre la ocurrencia de E2

(y vice versa)

– Ω = {HH, HT, T H, T T }

– F = {E ⊆ Ω}

– P(E) = 14 para todo evento atómico E (la probabilidad de los

demás eventos queda determinada por la propiedad P2)

Probabilidad primera moneda salga cara: P({HH, HT }) =

Probabilidad segunda moneda salga cara: P({HH, T H}) =

1

2

E1 es independiente de E2 ssi P(E1 ∩ E2 ) = P(E1 ) P(E2 )

En el ejemplo de las dos monedas, considere E1 = {HH, HT } y

E2 = {HH, T H}, los eventos que la primera y segunda moneda salen

cara respectivamente:

1

2

P(E1 ∩ E2 ) = P({HH}) =

1

4

=

1

2

×

1

2

= P(E1 ) P(E2 )

c 2016 Blai Bonet

c 2016 Blai Bonet

Independencia de más de dos eventos

Dos formas de definirla

Considere la colección E = {E1 , E2 , . . . , En } de eventos:

– E es independiente dos a dos ssi Ei es independiente de Ej para

cualquier (i, j) con i 6= j; i.e. P(Ei ∩ Ej ) = P(Ei ) P(Ej ) para todo

1≤i<j≤n

Q

– E es mutuamente independiente ssi P(∩E∈A E) = E∈A P(E)

para todo subconjunto A ⊆ E de eventos

Las definiciones no son equivalentes, pero la segunda implica la

primera

Probabilidad condicional

Considere el experimento de lanzar un dado insesgado y los eventos

A = “el dado cae en múltiplo de 3 ó 5” y B = “el dado cae par”

Claramente: P(A) =

3

6

=

1

2

y P(B) =

3

6

=

1

2

pero P(A ∩ B) =

1

6

¿Cuál es la probabilidad del evento A si sabemos que B es cierto?

De las tres posibilidades para el evento B (i.e. el dado sale 2, 4, o 6),

solo una hace cierta al evento A. Por lo tanto, la respuesta es 13

Definimos la probabilidad condicional P(A|B) = P(A ∩ B)/P(B)

[por lo general denotamos P(A ∩ B) con P(A, B)]

c 2016 Blai Bonet

c 2016 Blai Bonet

Independencia y probabilidad condicional

Considere dos eventos independientes A y B:

P(A|B) =

P(A, B)

P(A) × P(B)

=

= P(A)

P(B)

P(B)

Regla de la cadena

Considere una colección de n eventos {A1 , A2 , . . . , An }

P(A1 , A2 ) = P(A1 |A2 ) × P(A2 )

P(A1 , A2 , A3 ) = P(A1 |A2 , A3 ) × P(A2 , A3 )

= P(A1 |A2 , A3 ) × P(A2 |A3 ) × P(A3 )

Ahora considere dos eventos A y B tales que P(A|B) = P(A)

P(A, B) = P(A|B) × P(B) = P(A) × P(B)

P(A1 , A2 , A3 , A4 ) = P(A1 |A2 , A3 , A4 ) × P(A2 , A3 , A4 )

= P(A1 |A2 , A3 , A4 ) × P(A2 |A3 , A4 ) × P(A3 , A4 )

= P(A1 |A2 , A3 , A4 ) × P(A2 |A3 , A4 ) × P(A3 |A4 ) × P(A4 )

Conclusión, A y B son independientes ssi P(A|B) = P(A)

P(A1 , . . . , Ak ) = Πki=1 P(Ai |Ai+1 , . . . , Ak )

c 2016 Blai Bonet

c 2016 Blai Bonet

Variables aleatorias

Considere la siguiente propuesta:

Usted paga n bolı́vares para tener el chance de lanzar una

moneda. Si la moneda sale cara, usted recibe un pago mH y si la

moneda sale cruz usted recibe mT (ambos pagos en bolı́vares)

¿Vale la pena aceptar la propuesta?

Variables aleatorias

Una variable aleatoria X sobre un espacio (Ω, F, P) es una función

desde el espacio muestral a los reales (i.e. X : Ω → R)

Definimos,

P(X = x) = P({w ∈ Ω : X(w) = x})

En el ejemplo, Ω = {H, T } y definimos la variable aleatoria

Z : Ω → R igual al beneficio neto obtenido de aceptar la propuesta:

Z(H) = mH − n

Utilizaremos variables aleatorias y cálculo de esperanza para responder

la pregunta

Z(T ) = mT − n

E.g., para mH 6= mT , P(Z = mH − n) = P({H})

c 2016 Blai Bonet

c 2016 Blai Bonet

Esperanza

Resolución del problema de apuesta

El beneficio neto Z de aceptar la propuesta es:

Z(H) = mH − n

Dado (Ω, F, P) y variable aleatoria X : Ω → R, la esperanza de X se

define como:

P

P

E[X] =

ω∈Ω X(ω) P({ω}) =

x x P(X = x)

La esperanza cuantifica el valor esperado (promedio) de la variable

aleatoria X:

Z(T ) = mT − n

El beneficio neto esperado es:

P

E[Z] =

ω∈Ω Z(ω) P({ω})

= Z(H) P({H}) + Z(T ) P({T })

1

2

= (mH − n) ×

Si realizamos el experimento muchas veces, y promediamos los

valores de X obtenidos, el promedio tiende a E[X] a medida que

el número de repeticiones del experimento se incrementa

=

1

2 (mH

+ (mT − n) ×

1

2

+ mT ) − n

Entonces, E[Z] > 0 cuando mH + mT > 2n

c 2016 Blai Bonet

c 2016 Blai Bonet

Independencia de variables aleatorias

Propiedades de esperanza

E[αX + βY ] =

P

=

P

Dos variables aleatorias X, Y definidas sobre el mismo espacio

(Ω, F, P) son independientes ssi

= α

P(X = x, Y = y) = P(X = x) × P(Y = y)

ω∈Ω

[αX(ω) + βY (ω)] P({ω})

[αX(ω) P({ω}) + βY (ω) P({ω})]

P

ω∈Ω X(ω) P({ω}) + β

ω∈Ω Y (ω) P({ω})

ω∈Ω

P

= αE[X] + βE[Y ]

para todo x, y ∈ R

Si Y = g(X) para g : R → R, entonces Y es variable aleatoria y

Una colección {Xi }ni=1 de variables aleatorias definidas sobre el mismo

espacio es independiente ssi

Qn

P(∩ni=1 Xi = xi ) =

i=1 P(Xi = xi )

para todo x1 , x2 , . . . , xn ∈ R

c 2016 Blai Bonet

E[Y ] =

P

y

yP(Y = y) =

P

x

g(x)P(X = x)

Si X e Y son independientes,

P

xyP(X = x, Y = y) =

x,y xyP(X = x)P(Y = y)

P

P

=

x xP(X = x)

y yP(Y = y) = E[X] E[Y ]

E[XY ] =

c 2016 Blai Bonet

P

x,y

Variables aleatorias indicadoras

Cota para la probabilidad de la unión

Considere una colección de eventos {E1 , E2 , . . . , En }

Una variable aleatoria X : Ω → R tal que Rg(X) = {0, 1} se llama

variable aleatoria indicadora

Calculemos su esperanza:

Queremos obtener una cota para P(∪1≤i≤n Ei )

Defina A1 = E1 , A2 = E2 \ E1 , . . . , Ai = Ei \ (E1 ∪ · · · ∪ Ei−1 )

E[X] =

P

=

P

ω∈Ω X(ω) P({ω})

Los conjuntos {Ai }i son disjuntos dos a dos y ∪1≤i≤n Ei = ∪1≤i≤n Ai

ω∈Ω,X(ω)=1 P({ω})

= P({ω ∈ Ω : X(ω) = 1})

P(∪1≤i≤n Ei ) = P(∪1≤i≤n Ai ) =

X

P(Ai ) ≤

1≤i≤n

= P(E)

donde E es el evento E = {ω ∈ Ω : X(ω) = 1} = {X = 1}

X

P(Ei )

1≤i≤n

ya que P(Ai ) ≤ P(Ei ) porque Ai ⊆ Ei

c 2016 Blai Bonet

c 2016 Blai Bonet

Esperanza de variables enteras

Regla de probabilidad total

Considere una v.a. entera no-negativa X; i.e. con rango {0, 1, 2, . . .}

E[X] =

P

x≥0 x P(X

= x) =

P

x≥1 x P(X

Consider un evento A y una colección de eventos {Bi }i que

particionan el espacio muestral Ω

= x)

P(A) =

X

P(A ∩ Bi )

i

= 1)

= 2)

= 3)

= 4)

..

.

P(X = 2)

P(X = 3)

P(X = 4)

..

.

P(X = 3)

P(X = 4)

..

.

P(X = 4)

..

.

···

..

.

P(X ≥ 1)

P(X ≥ 2)

P(X ≥ 3)

P(X ≥ 4)

···

P(X

P(X

P(X

P(X

La prueba es sencilla ya que la colección de eventos {A ∩ Bi }i es una

colección disjunta dos a dos

Por aditividad de P,

X

E[X] =

c 2016 Blai Bonet

P

x≥1 P(X

≥ x)

P(A ∩ Bi ) = P(∪i (A ∩ Bi )) = P(A ∩ ∪i Bi ) = P(A ∩ Ω) = P(A)

i

c 2016 Blai Bonet

Desigualdad de Markov

La desigualdad de Markov permite acotar la probabilidad de una

variable X no negativa utilizando la esperanza de X

Para todo t > 0,

P (X ≥ t) ≤

E[X]

t

Ejemplos de análisis probabilı́stico

Sea X : Ω → R una v.a. no negativa definida sobre (Ω, F, P)

E[X] =

X

x≥0

≥

∞

X

x=t

x P(X = x) =

t−1

X

x P(X = x) +

x=0

x P(X = x) ≥ t

∞

X

∞

X

x P(X = x)

x=t

P(X = x) = t P(X ≥ t)

x=t

c 2016 Blai Bonet

c 2016 Blai Bonet

Paradoja del dı́a de nacimiento 1/3

Paradoja del dı́a de nacimiento 2/3

Ahora acotaremos P(Bm ) donde Bm es el evento que los dı́as de

nacimiento de las primeras m personas son todos distintos

¿Cuántos estudiantes deben haber en un salón para que la

probabilidad que dos de ellos nazcan el mismo dı́a sea > 12 ?

Observe Bm = Bm−1 ∩ Am donde Am es el evento que las T

personas

m

1, . . . , m − 1 nacen en dı́as distinto a bm . Entonces, Bm = i=1 Ai

Asumiremos que el año tiene n = 365 dı́as (obviando años bisiestos) e

indizamos a las personas con los enteros 1, 2, . . . , k

Sea bi ∈ {1, 2, . . . , n} el dı́a de nacimiento de la persona i. Asumimos

P(bi = r) = 1/n y P(bi = r & bj = s) = 1/n2 para todo i, j, r, s

La probabilidad que las personas i y j nazcan el mismo dı́a es

Pn

Pn 1

P(bi = bj ) =

r=1 P(bi = r & bj = r) =

r=1 n2 =

Para responder la pregunta queremos calcular el número k de personas tal

que 1 − P(Bk ) ≥ 12 . Es decir, k tal que P(Bk ) ≤ 12

P(Bk ) = P(B1 ) × P(A2 |B1 ) × P(A3 |B2 ) × · · · × P(Ak |Bk−1 )

= 1×

n−1

n

×

n−2

n

× ··· ×

n−k+1

n

= 1 × (1 − n1 ) × (1 − n2 ) × · · · × (1 −

≤ e−1/n × e−2/n × · · · × e−(k−1)/n

1

n

1

= e− n

Pk−1

i=1

i

= e−k(k−1)/2n ≤

k−1

n )

[α < 1 =⇒ 1 − α ≤ e−α ]

1

2

cuando −k(k − 1)/2n ≤ ln(1/2). Para n = 365, basta k ≥ 23

c 2016 Blai Bonet

c 2016 Blai Bonet

Paradoja del dı́a de nacimiento 3/3

Resolvamos ahora usando variables indicadoras y la linealidad de la

esperanza. Considere la v.a. indicadora Xij = II{bi = bj }:

E[Xij ] = P(Xij = 1) = P(bi = bj ) = 1/n

Sea X el número de pares

P de personas distintas con el mismo dı́a de

nacimiento: i.e. X = 1≤i<j≤k Xij

E[X] =

P

1≤i<j≤k

E[Xij ] =

P

1

1≤i<j≤k n

=

k 1

2 n

k(k−1)

2n

=

Si E[X] ≥ 1 entonces existe al menos un i y j tal que Xij = 1

E[X] ≥ 1 cuando k(k − 1)/2n ≥ 1 lo que implica k ≥ 12 (1 +

√

1 + 8n)

Para n = 365, cuando k ≥ 28 esperamos que exista al menos 1 par de

personas que cumplan el mismo dı́a

Más fácil pero la cota k ≥ 28 es menos ajustada que k ≥ 23

Pelotas y cajas

Considere el proceso de lanzar n pelotas idénticas en b cajas

distintas, numeradas 1, 2, . . . , b

Los lanzamientos son independientes y la probabilidad de que una

pelota caiga en una caja cualquiera es 1/b

– ¿Cuántas pelotas caen (en promedio) en una caja dada?

Respuesta: n/b pelotas por caja en promedio

– ¿Cuántas pelotas debemos lanzar (i.e. determinar n) hasta que 1

pelota caiga en una caja dada?

Respuesta: debemos lanzar b pelotas en promedio

– ¿Cuántas pelotas debemos lanzar (i.e. determinar n) hasta que toda

caja contenga al menos 1 pelota? (Coleccionista de cupones)

Respuesta: debemos lanzar b ln b pelotas en promedio

c 2016 Blai Bonet

c 2016 Blai Bonet

Coleccionista de cupones 1/2

Coleccionista de cupones 2/2

Cada vez que una pelota cae en una caja vacı́a lo llamamos un hit

Distribución y esperanza de la variable ni

Queremos calcular el número esperado de lanzamientos hasta obtener b hits

Particionamos los lanzamientos en episodios:

Sea pi la probabilidad de que un lanzamiento en el i-ésimo episodio

sea un hit y qi = 1 − pi

– el primer episodio consiste en los lanzamientos hasta el primer hit

(incluyendo el hit)

– el i-ésimo episodio consiste en los lanzamientos después de (i − 1)-ésimo

hit y hasta el i-ésimo hit (incluyendo el hit)

Sea ni el número de lanzamientos enPel i-ésimo episodio. El número total de

b

lanzamientos para obtener b hits es i=1 ni

hP

i

Pb

Pb

Pb 1

b

b

E

n

=

i

i=1

i=1 E[ni ] =

i=1 b−i+1 = b

i=1 i = b(ln b + O(1))

P(ni ≥ k) = P(ni > k − 1) = qik−1

E[ni ] =

k≥1

P(ni ≥ k) =

X

k≥1

qik−1 =

X

k≥0

qik =

1

1

=

1 − qi

pi

Observe que pi = (b − i + 1)/b ya que durante el i-ésimo episodio,

i − 1 cajas tiene pelotas y b − i + 1 cajas no tienen pelotas

donde E[ni ] = b/(b − i + 1) (ver próximo slide)

c 2016 Blai Bonet

X

c 2016 Blai Bonet

Resumen

Ejercicios (1 de 2)

• Elementos de teorı́a de probabilidades:

– espacio de probabilidades: espacio muestral, eventos, función de

probabilidad

– independencia de eventos, probabilidad condicional y regla de la

cadena

1. (8.4-3) Sea X una variable aleatoria que es igual al número de caras en

dos lanzadas de una moneda insesgada. Calcule E[X 2 ] y E[X]2

2. (5.2-3) Use variables indicadoras para computar el valor esperado de la

suma de n dados lanzados (insesgados)

– variables aleatorias e independencia de variables

– esperanza y propiedades

– cota para la unión, regla de probabilidad total y desigualdad de

Markov

3. (5.2-4) Use variables indicadoras para resolver lo siguiente. Cada uno de

los n clientes en un restaurant dejan sus sombreros con el guardaropas.

Al salir, el guardaropas devuelve los sombreros totalmente al azar. ¿Cuál

es el número esperado de clientes que obtienen su sombrero al salir del

restaurant?

• Ejemplos de análisis probabilı́stico

c 2016 Blai Bonet

c 2016 Blai Bonet

Ejercicios (2 de 2)

4. (5.2-5) Sea A[1 . . . n] un arreglo con n enteros distintos. Si i < j y

A[i] > A[j], decimos que el par (i, j) es una inversión de A. Suponga

que los elementos de A forman una permutación uniforme sobre

{1, 2, . . . , n}. Use variables indicadoras para calcular el número esperado

de inversiones en A

5. Responda la primera y segunda pregunta para el problema de las pelotas

y las cajas

c 2016 Blai Bonet