La señal de audio - Cursos en Abierto de la UNED

Anuncio

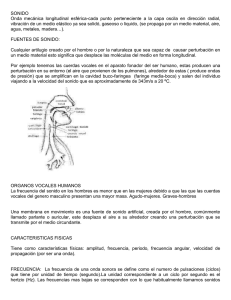

TEMA 4 La señal de Audio 4.1 DEFINICIÓN Y CARACTERÍSTICAS DEL SONIDO Una posible definición de sonido es la sensación auditiva producida por una alteración física en un medio. El elemento generador del sonido se denomina fuente sonora. La generación del sonido tiene lugar cuando dicha fuente entra en vibración y ésta es transmitida a las partículas de aire adyacentes, que a su vez, la transmiten a las partículas contiguas originándose variaciones en la presión del aire (compresiones y descompresiones). Estas variaciones de presión se propagan en el medio originando lo que recibe el nombre de ondas sonoras. El grado de compresión y descompresión del aire es la amplitud de la presión de la onda sonora o presión sonora y está relacionada con el nivel sonoro. La distancia entre dos picos adyacentes de compresión o descompresión conforme la onda sonora viaja en el aire se conoce con el nombre de longitud de onda. En el aire, el sonido se propaga a una velocidad aproximada de 343 m/s (metros por segundo). Esta velocidad puede variar con la densidad del aire, afectada por factores como la temperatura o la humedad relativa. En cualquier caso, para distancias de decenas de metros las variaciones son mínimas. Aunque en este curso nos interesa principalmente la propagación del sonido en el aire, se puede dar en cualquier medio. Cuanto más denso sea el medio, mayor será la velocidad de propagación del sonido en el mismo. Así por ejemplo, en el agua, un valor típico de velocidad del sonido son 1500 m/s (el agua es más densa que el aire). En el agua, la densidad varía mucho en función de factores como la profundidad, la temperatura o la salinidad y sí hay que tenerlos en cuenta. En materiales metálicos, el sonido se propaga a velocidades superiores a las anteriores, por ejemplo, en el acero el sonido se propaga a una velocidad en torno a 5000 m/s. Cuando las ondas sonoras llegan al oído, el cerebro interpreta las variaciones de presión como sonido. La velocidad con que oscila la fuente sonora es la frecuencia de la onda sonora y se mide TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 en Hertzios (Hz) o ciclos por segundo. Para que la vibración sea audible para un ser humano, la fuente debe oscilar a un ritmo de entre 20 y 20000 ciclos por segundo. Esto es lo que se denomina frecuencia y se mide en Hertzios (Hz). El periodo es el inverso de la frecuencia y es el tiempo que transcurre desde que una partícula se encuentra en una posición hasta que vuelve a hacerlo. Las características de una onda sonora pueden representarse gráficamente mediante un eje vertical para la amplitud y un eje horizontal para el tiempo. Si dicha representación es una función seno o coseno, diremos que la fuente vibra con un movimiento vibratorio armónico simple y la onda sonora se denomina senoidal. En este caso, la onda representa un sonido puro, puesto que tiene su energía concentrada en una única frecuencia, y se denomina tono puro. El silbido de una persona se aproxima bastante a una onda sinusoidal. La mayoría de los sonidos reales están hechos a base de combinaciones de diferentes modelos vibratorios, de los que resulta una forma de onda más compleja. Cuanto más compleja es una forma de onda, más tiende a parecerse al ruido y cuando la onda presenta un modelo muy aleatorio y poco estructurado se dice que dicho sonido es ruido. No obstante, podemos considerar ruido como sonido no deseado, ya que hay veces en las que precisamente lo que buscamos es generar ruido artificialmente con distintos propósitos. En el apartado de síntesis se da algún ejemplo de este tipo de situaciones. El espectro es la representación de las frecuencias que componen una señal de audio. Se obtiene calculando la energía que aporta cada frecuencia al sonido total. Normalmente la representación no se hace en términos de energía directamente, sino que se calcula el nivel (se definirá en el siguiente apartado) respecto a la energía de referencia. Con esto se obtiene el nivel espectral. La representación espectral (o el espectro) puede resultar muy útil puesto que aporta información sobre cuanto contribuye cada frecuencia o cada banda de frecuencia al sonido total. Esto no es mas que un cambio de representación, es decir se trata de la misma señal pero representada en el dominio de la frecuencia en lugar de hacerlo en el dominio del tiempo que nos resulta más directo y habitual. Sin embargo, el disponer de la señal en el dominio de la frecuencia nos proporciona de forma directa información muy valiosa acerca del contenido frecuencial de la misma. Este aspecto es fundamental a la hora de realizar la digitalización para evitar problemas de ‘aliasing’ que se comentarán más adelante. El tono de un sonido está directamente relacionado con la frecuencia de la oscilación, pero ambos términos no son sinónimos. De hecho, muchos sonidos como los generados por instrumentos de percusión no tienen un tono definido. Lo que hace que un sonido tenga un tono definido es su periodicidad, es decir la forma de la onda. No importa lo compleja que sea si repite su patrón a intervalos regulares y siempre de la misma manera. Todas estas ondas pueden descomponerse en serie de componentes conocidos como armónicos, mediante un proceso matemático denominado análisis de Fourier. Los sonidos musicales, a excepción de los generados por instrumentos de percusión no temperados están formados por una frecuencia fundamental que es la frecuencia de vibración más grave y es la que determina el tono del sonido (tono o armónico 4.2 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 fundamental) y una serie de armónicos (frecuencias múltiplos enteros de la fundamental). La presencia y número de armónicos confieren al sonido la cualidad subjetiva de timbre. El timbre podría definirse como el ‘color’ de un sonido y nos permite distinguir y caracterizar distintos tipos de instrumentos o a reconocer a las personas por su voz. Dos instrumentos musicales distintos pueden hacer sonar la misma nota musical, lo que implica que su tono fundamental es el mismo, pero la percepción de las mismas puede ser radicalmente distinta. Esta diferenciación la establece el timbre y es lo que mos permite distinguir una nota generada por un piano de la misma nota generada por una trompeta. Lo que cambia es el timbre, o lo que es lo mismo, el contenido armónico de la señal o para ser más precisos la cantidad de armónicos y las proporciones relativas entre ellos y entre ellos y el fundamental. En general, las ondas asociadas a la frecuencia fundamental tienen amplitud mayor, mientras que las amplitudes de los armónicos disminuyen conforme crece la frecuencia. Esto no siempre se corresponde con la realidad, puesto que muchas formas de onda tienen armónicos de amplitud mayor que la del tono fundamental. También es fácil encontrar espectros en los que desaparecen algunos armónicos. Por último, para un determinado sonido pueden existir frecuencias superiores a la fundamental que no están relacionados con ésta mediante un simple múltiplo entero de ésta. En este caso se habla de sobretonos en lugar de armónicos. Es decir, todo armónico es sobretono pero no todo sobretono es armónico. Por ejemplo, en campanas puede percibirse a veces la presencia de varios sobretonos fuertes. Se dice que dos ondas de la misma frecuencia están en fase cuando sus semiciclos de compresión (positivos) y descompresión (negativos) coinciden exactamente en el tiempo y en el espacio. Si se superponen dos señales en fase y de igual amplitud, se obtiene otra señal de la misma frecuencia y doble amplitud. Se dice que dos señales están en contrafase cuando el semiciclo positivo de una coincide con el semiciclo negativo de la otra. Si se suman estás señales se obtiene ausencia de señal. Estos son dos casos extremos y lo más frecuente es tener sonidos de la misma frecuencia parcialmente desfasados entre sí. Figura 4.1 Gráfica que muestra el rango de sonidos audibles y detectables por el oído humano. En el eje horizontal se muestra la frecuencia y en el vertical el Nivel de Presión Sonora. La curva sombreada inferior indica el umbral de audición, donde se ve que la máxima sensibilidad se presenta sobre los 4kHz. Tecnología de los Contenidos Multimedia 4.3 TEMA 4. LA SEÑAL DE AUDIO 4.2 UNED - CURSO 2009-2010 NIVEL DE PRESIÓN SONORA Y DECIBELIOS Según se ha mencionado con anterioridad, la presión sonora constituye una manera habitual de expresar la magnitud de un sonido. En principio el valor a considerar es la diferencia entre el valor fluctuante de la presión sonora total y su valor de equilibrio correspondiente a la presión atmosférica. Debido a la variación de dicha magnitud con el tiempo, se utiliza como valor representativo su promedio temporal, que recibe el nombre de valor eficaz o RMS (Root Mean Square). Ahora bien, el uso de dicho valor eficaz no resulta muy útil debido por una parte, al amplio rango de presiones que el oído humano es capaz de detectar y, por otra, a la respuesta logarítmica del mismo. En efecto, la gama de presiones que el oído humano es capaz de detectar va desde 2·10-5 Pa (valor umbral mínimo de audición) hasta 200 Pa (umbral de dolor), es decir, extraordinariamente amplia (140dB), por lo que la aplicación de una escala lineal no sería nada práctico. Pa es la abreviatura de Pascal que es una unidad de presión que se define como la presión ejercida por una fuerza de un Newton sobre una superficie de un metro cuadrado. Además, el oído humano no responde linealmente a los estímulos que recibe, sino que más bien lo hace de forma logarítmica. Por ejemplo, si la presión de un tono puro de 1kHz se dobla, la sonoridad o sensación subjetiva producida por el mismo, no llegará a ser el doble. De hecho, para obtener una sonoridad doble, es necesario multiplicar la presión sonora por un factor de 3,16. Este comportamiento del oído humano hace conveniente el empleo de una escala logarítmica para representar la presión sonora. Esta escala se expresa en valores relativos a un valor de referencia. Dicho valor de referencia es 2x10-5Pa (umbral de audibilidad). En este caso se habla de NPS que son las siglas de Nivel de Presión Sonora (SPL = Sound Pressure Level en inglés) y la unidad utilizada es el decibelio (dB). La utilización del umbral de audición como referencia tiene como objetivo que todos los sonidos audibles sean representados por valores NPS positivos. El uso de decibelios reduce la gama de presiones sonoras a niveles de presión sonora de 0 a 140dB, donde 0dB representa una presión igual al umbral de audición (no significa, por tanto, ausencia de sonido) y 140dB el umbral aproximado de dolor. De esta manera, las cifras manejadas son mucho más simples y, además, se dan las siguientes relaciones entre cambios de nivel sonoro y su efecto subjetivo: • 1dB: mínimo cambio de nivel sonoro perceptible. • 5dB: cambio de nivel claramente percibido • 10dB: incremento asociado a una sonoridad doble. Además el NPS disminuye aproximadamente 6dB cada vez que se duplica la distancia debido a la relación del cuadrado de la distancia. En la tabla 4.1 se muestran niveles de presión sonora correspondientes a sonidos y ruidos típicos. 4.4 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 Fuente Sonora Tabla 4.1 NPS(dB) Despeque de un reactor 150 Concierto de rock 120 Discoteca 112 Taladradora a 15m 94 Camión pesado a 15m 86 Calle de ciudad 80 Interior de automóvil 74 Aspiradora a 3m 68 Conversación normal a 1m 60 Transformador grande a 15m 54 Oficina, aula 50 Dormitorio (noche) 30 Estudio de grabación 20 Niveles de presión sonora de algunos sonidos cotidianos. 4.2.1 NIVELES DE LA SEÑAL DE AUDIO Cuando la señal de audio parte de un micrófono, atraviesa una mesa de mezclas, se graba en un multipista y llega a un altavoz, a lo largo de todos esos pasos, sufre varios cambios en el nivel de tensión. El nivel de potencia de una señal se define como: L = 10log P Pre donde Pre es el valor de referencia que se toma para establecer la escala de niveles y log(·) representa el logaritmo decimal. Puesto que la potencia y la tensión tienen entre sí una relación cuadrática (de la ley de Ohm tenemos: P=V2/R), el nivel de tensión L en dB se define como: L = 10log V Vre donde Vre es el valor de la tensión de referencia. Cuando se trabaja con sonido, el valor 0dB es un nivel de referencia nominal empleado para alinear equipos y ajustar niveles de grabación. Su valor corresponde normalmente a una referencia de 0.775 V (0dBu). El valor 0dB no significa ausencia de señal, significa que la señal a la que se refiere tiene el mismo nivel que la de referencia. Para indicar el estándar de referencia que se emplea en cada caso suele colocarse una letra después de ‘dB’ (por ejemplo, dBm o dBu). A continuación se dan algunos ejemplos de las diferentes abreviaturas empleadas normalmente, que indican el nivel de referencia empleado. No hay que olvidar que los decibelios son una unidad de medida relativa, por lo que no sirven de nada si no se especifica el nivel de referencia. Tecnología de los Contenidos Multimedia 4.5 TEMA 4. LA SEÑAL DE AUDIO Tabla 4.2 UNED - CURSO 2009-2010 Abreviatura Referencia dBV 1 Voltio dBu 0,775 Voltios (Europa) dBv 0,775 Voltios (EE.UU.) dBW 1 vatio dBm 1 milivatio Tabla de sufijos de dB y los correspondientes niveles de referencia. dBV, dBu y dBv son medidas de tensión mientras que dBW y dBm lo son de potencia. El valor de 0.775 Voltios viene porque es el nivel de tensión que libera un milivatio de potencia sobre una resistencia de 600 Ohmios, que es una resistencia estandar en sistemas de comunicaciones. Según esto tendremos: • dBu = dBm sobre una resistencia de 600 Ohmios • 0 dBu = 0.775 Voltios Aunque los niveles utilizados por los dispositivos de audio varían en un rango muy amplio, se suelen distinguir tres tipos diferentes: • Nivel de micrófono (mic level). Se consideran de este tipo hasta -20dBu (77.5mV). Se obtienen a la salida de giradiscos, micrófonos, cintas magnéticas, pastillas de guitarras... • Nivel de línea (line level). Se consideran de este tipo, niveles entre -20 y 30dBu. Son señales procedentes de mesas de mezclas, procesadores de señal, teclados electrónicos y de la mayoría de aparatos que se encuentran en un estudio de grabación, excepto los amplificadores de potencia. • Nivel de altavoz (speaker level) o niveles superiores a 30dBu. Se obtienen a la salida de los amplificadores de potencia y sirven para atacar los altavoces. 4.3 EL SISTEMA AUDITIVO La audición es el resultado de una serie de procesos acústicos, mecánicos, nerviosos y mentales dentro de la combinación oído-cerebro que dan la impresión de sonido. La impresión que un humano recibe no es idéntica a la forma de onda acústica verdadera presente en el canal auditivo porque parte de la entropía de la onda se pierde. La agudeza del oído humano es asombrosa, ya que puede detectar cantidades minúsculas de distorsión y aceptar un enorme rango dinámico. El único criterio de calidad de que se dispone consiste en el hecho de que si el oído es incapaz de detectar distorsión alguna, se dice que el sonido es perfecto. Por tanto, el criterio de calidad es completamente subjetivo y sólo se puede comprobar mediante pruebas de audición. 4.6 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 El oído se divide en tres zonas, llamadas oído externo, oído medio y oído interno, de acuerdo a su ubicación en el cráneo. El oído externo es la parte del aparato auditivo que se encuentra en posición lateral al tímpano. Comprende la oreja y el conducto auditivo externo, que mide unos tres centímetros de longitud, como se puede observar en la figura 4.2. Figura 4.2 Oído externo El oído medio se encuentra situado en la cavidad timpánica llamada caja del tímpano, cuya cara externa está formada por el tímpano, que lo separa del oído externo. Incluye el mecanismo responsable de la conducción de las ondas sonoras hacia el oído interno. Es un conducto estrecho, que se extiende unos quince milímetros verticalmente y otros quince horizontalmente. La impedancia del oído es mucho más alta que la del aire y el oído medio actúa como un transformador adaptador de impedancias que mejora la transferencia de potencia. Hay una cadena formada por tres huesos pequeños y móviles que atraviesa el oído medio. Estos tres huesos reciben los nombres de martillo, yunque y estribo. Los tres conectan acústicamente el tímpano con el oído interno, que contiene un líquido. La figura 4.3 muestra el oído medio. Figura 4.3 Oído medio El oído interno, o laberinto, se encuentra en el interior del hueso temporal que contiene los órganos auditivos y del equilibrio. Está separado del oído medio por la ventana oval. El oído interno Tecnología de los Contenidos Multimedia 4.7 TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 consiste en una serie de canales membranosos alojados en una parte densa del hueso temporal, y está dividido en: cóclea (en griego, ‘caracol óseo’), vestíbulo y tres canales semicirculares. La figura 4.4 muestra el oído interno. Estos tres canales se comunican entre sí y contienen un fluido gelatinoso denominado endolinfa. Figura 4.4 Oído interno Los sonidos penetran al oído a través de la oreja y chocan con el tímpano haciéndolo vibrar. Esta vibración es recibida por los tres huesecillos articulados en cadena y controlados por dos pequeños pero poderosos músculos. El final de la cadena lo constituye el estribo que está alojado en un nicho llamado ventana oval que es el lugar por donde ingresa el sonido (oído interno) a la cóclea o caracol. Los movimientos del estribo producen desplazamientos del líquido en el oído interno que estimulan las terminaciones nerviosas o células ciliadas, lugar donde realmente comienza el proceso auditivo. Las células nerviosas estimuladas, envían la señal por el nervio auditivo hasta los centros del cerebro, donde el estimulo eléctrico es procesado. Figura 4.5 4.8 Membrana basilar extendida. Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 Como se observa en la figura 4.5, la membrana basilar se extiende a lo largo de la cóclea. Esta membrana varía en masa y rigidez a lo largo de su longitud. En el extremo más próximo a la ventana oval y al tímpano, la membrana es rígida y ligera, así que su frecuencia de resonancia es alta. En el extremo distante, próximo al ápice, la membrana es pesada y suave, y resuena a baja frecuencia. El rango de frecuencias de resonancia disponible determina el rango de frecuencias de la audición humana, que va desde los 20Hz hasta los 20KHz, sin embargo, en la práctica sólo llega hasta los 16 kHz aproximadamente. Frecuencias diferentes en la entrada de sonido causan que diferentes áreas de la membrana basilar vibren. Cada área tiene diferentes terminaciones nerviosas para permitir discriminar el tono. La membrana basilar además tiene músculos diminutos controlados por los nervios que juntos actúan como una especie de sistema de retroalimentación positiva que mejora el factor de resonancia. El comportamiento resonante de la membrana basilar es exactamente el mismo que el de un analizador de espectros; la parte de dicha membrana que resuena como resultado de la aplicación de un sonido es una función de la frecuencia. El oído analiza el sonido con bandas de frecuencia, conocidas como bandas críticas. Los anchos de las bandas críticas dependen de la frecuencia, tal y como se ilustra en la figura 4.6. Por debajo de los 500 Hz, el ancho de banda crítico es aproximadamente constante (alrededor de los 100 Hz), mientras que por encima de los 500 Hz crece en proporción a la frecuencia: el ancho de banda crítico centrado en una frecuencia superior a 500 Hz es de alrededor del 20% de la frecuencia central. Basándose en los valores obtenidos mediante la figura 4.6, es posible subdividir el rango de frecuencias audibles en intervalos adyacentes de anchura igual a una banda crítica y que no se solapan entre sí. Esta subdivisión se presenta en la figura 4.7. En el rango audible de 20 Hz a 20 KHz se encuentran 25 bandas críticas adyacentes, numeradas en forma consecutiva en la figura. Figura 4.6 Ancho de las bandas críticas en función de la frecuencia Tecnología de los Contenidos Multimedia 4.9 TEMA 4. LA SEÑAL DE AUDIO Figura 4.7 UNED - CURSO 2009-2010 Bandas críticas adyacentes en el rango de frecuencias audibles En la tabla 4.3 se muestran los valores que definen las primeras 24 bandas críticas. Estos valores se han convertido en un estándar “de facto” para describir la distribución de las bandas críticas en función de la frecuencia. Nº Banda 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 Tabla 4.3 4.10 Frec. central 50 150 250 350 450 570 700 840 1000 1170 1370 1600 1850 2150 2500 2900 3400 4000 4800 5800 7000 8500 10500 13500 Frec. Superior 100 200 300 400 510 630 770 920 1080 1270 1480 1720 2000 2320 2700 3150 3700 4400 5300 6400 7700 9500 12000 15500 Ancho de banda 100 100 100 100 110 120 140 150 160 190 210 240 280 320 380 450 550 700 900 1100 1300 1800 2500 3500 Distribución de las bandas críticas en función de la frecuencia Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO 4.4 UNED - CURSO 2009-2010 PERCEPCIÓN DEL SONIDO Como ya se ha comentado, la banda de frecuencias audibles va desde los 20Hz (sonidos más graves) hasta los 20kHz (sonidos más agudos) para una persona normal de 18 a 25 años disminuyendo paulatinamente con la edad. El rango dinámico del oído va desde los 0dB hasta los 120dB (umbral de molestia) o hasta 140dB (umbral de dolor). Se comprueba fácilmente que un sonido nos parece más agudo cuanto mayor es su frecuencia. El oído humano interpreta las frecuencias de manera casi logarítmica. La apreciación subjetiva de un oyente cuando se pasa de un tono de 400 Hz a otro de 800, será análoga a la de pasar de un tono de 3000 Hz a otro de 6000 Hz. Es decir, el oído interpreta el mismo cambio de tono cada vez que se duplica la frecuencia. Sin embargo la ‘distancia’ en frecuencia en el primer caso es de 400 Hz y en el segundo de 3000 Hz. Ahora bien, el oído humano no tiene la misma sensibilidad para todo el margen de frecuencias. La figura 4.1 muestra las variaciones de los umbrales de audición y de dolor en función de la frecuencia. A partir de esta figura podemos concluir que: • Para niveles bajos de presión sonora, el oído es muy insensible a bajas frecuencias, es decir, el nivel de presión sonora de un sonido grave tiene que ser mucho más elevado que el correspondiente a un sonido de frecuencias medias para que ambos produzcan la misma sonoridad. Por ejemplo un nivel NPS=70dB a 20Hz produce la misma sonoridad o sensación subjetiva de nivel sonoro que un nivel NPS=5dB a 5kHz. • Para dichos niveles bajos, el oído presenta también cierta atenuación a altas frecuencias. • A medida que los niveles aumentan, el oído tiende a responder de forma más homogénea en toda la banda de frecuencias audibles, hasta el punto de que cuando son muy elevados, la sonoridad asociada a tonos puros de diferente frecuencia es muy parecida. El oído es menos sensible para frecuencias bajas y altas. Esta característica de menor agudeza para los tonos graves favorece el enmascaramiento de los sonidos que produce el cuerpo humano. Este comportamiento del oído con el nivel de presión sonora explica que se perciben más los graves y agudos si el volumen de un equipo de música es alto. Este es el motivo por el que escuchar la música a niveles altos nos permite apreciarla con mayor brillantez. De hecho, para evitar volúmenes muy elevados, muchos equipos de música incorporan un conmutador (Loudness) para compensar este fenómeno. Cuando activamos el Loudness en estos equipos, se produce un incremento de las bajas y altas frecuencias cuando el volumen es bajo. Este efecto se reduce progresivamente conforme aumentamos el volumen del equipo. Esto nos permite escuchar la música con el mismo nivel subjetivo entre frecuencias, independientemente del volumen de reproducción del equipo. La figura 4.1 muestra claramente este comportamiento donde se ve que la curva de audivilidad se va haciendo más plana cuando el NPS Aumenta. El nivel sonoro depende en gran medida de la naturaleza del sonido. Los sonidos de banda ancha tienden a parecer más fuertes que los de banda estrecha. Por otra parte los sonidos distorsionados parecen, psicológicamente, ser más fuertes que los que no tienen distorsión, debido quizás a que Tecnología de los Contenidos Multimedia 4.11 TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 se asocia distorsión con sobrecarga del sistema. Si se reproducen dos sonidos musicales con niveles idénticos, uno de ellos con bastante distorsión y el otra sin ella, el oyente percibirá el primero más fuerte. Otro factor importante es que, para una determinada frecuencia, el umbral de audición se incrementa en presencia de otro sonido de frecuencia similar, o lo que es lo mismo, un sonido puede enmascarar a otro. Para dar la sensación de que se dobla el nivel sonoro que se percibe de un sonido, se necesita un incremento de 9 a 10dB. Aunque 6dB equivalen a multiplicar por 2 la presión sonora real, el mecanismo de la audición parece necesitar un incremento superior en la señal para crear la sensación de que se ha doblado el volumen. 4.4.1 ENMASCARAMIENTO Un sonido en el rango audible sólo puede ser percibido por una persona, cuando su nivel de presión sobrepasa el límite inferior (umbral de audibilidad). En ausencia de todo ruido, este límite es el umbral absoluto de audibilidad. En presencia de ruido, el mismo sonido debe tener un nivel NPS (dB) más alto para que se pueda distinguir. Figura 4.8 Curvas de enmascaramiento para un tono de 1200Hz y distintos Niveles de Presión Sonora. Este fenómeno se conoce con el nombre de enmascaramiento. Se denomina enmascaramiento a la reducción total o parcial de la sensibilidad de un oyente para percibir un determinado sonido, provocado por la presencia simultánea de otro. Cuando un sonido hace que otro sea menos audible, porque ambos se producen al mismo tiempo, se dice que se produjo un fenómeno de enmascaramiento. El sonido cuyo umbral de audibilidad se ha modificado se denomina sonido enmascarado y al otro, sonido enmascarante. El efecto del enmascaramiento debido a un ruido depende del reparto espectral del mismo, ya que se origina no sólo por los sonidos que tienen la misma frecuencia que las componentes del ruido, sino también por otras. Sin embargo, el efecto es máximo para la frecuencia del ruido. 4.12 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 La gráfica de la figura 4.8 muestra el enmascaramiento de un tono o de un ruido de banda estrecha sobre otros adyacentes, donde la línea curva inferior delimita el umbral medio de audición. Algunas características de este enmascaramiento que se pueden observar en dicha figura son: • Una banda estrecha de ruido, produce más enmascaramiento que un tono puro de igual frecuencia central y misma intensidad. • Cuando el ruido es de bajo nivel, el enmascaramiento se produce en una banda de frecuencia estrecha alrededor de la frecuencia central del ruido. Para niveles superiores del ruido, se incrementa el margen de frecuencias afectadas • El efecto de enmascaramiento no es simétrico en torno a la frecuencia central del ruido enmascarante. Las frecuencias superiores sufren más los efectos de enmascaramiento. La gráfica muestra las zonas que estarían bajo los efectos del enmascaramiento, con un ruido de banda estrecha centrado en 1200 Hz, y para distintos niveles de presión sonora del ruido. Para el caso más extremo, el ruido de 110 dB (la curva más alta), obtenemos la mayor zona enmascarada. Por ejemplo, en este caso, el oyente no detectaría un tono de 8 kHz y 50 dB de nivel de presión; tampoco detectaría un sonido de 4 kHz y 70 dB de nivel de presión. También se produce enmascaramiento parcial entre tonos puros cuando están muy próximos en frecuencia, influenciándose más cuanto más cerca estén sus frecuencias. Si tonos puros muy separados en frecuencia tienen sonoridades similares y suenan simultáneamente, la sonoridad percibida será la suma de las sonoridades asociadas a dichos tonos. En cambio, si los tonos de igual sonoridad están muy próximos en frecuencia, al sonar simultáneamente darán una sonoridad ligeramente superior a la sonoridad de cualquiera de ellos. El enmascaramiento parcial puede llegar a ser total cuando hay además de una gran proximidad en frecuencia, una notable diferencia en cuanto a sonoridad, es decir, un sonido fuerte oculta totalmente a un sonido débil, que no puede percibirse y por tanto, no contribuye a la sonoridad. La rama de la acústica que estudia la percepción humana del sonido se denomina psicoacústica y últimamente ha cobrado importancia al ser la base para algunos de los algoritmos de compresión más eficientes. Este efecto de enmascaramiento es fundamental para la compresión de audio digital ya que los tonos enmascarados se pueden ignorar puesto que no serán percibidos. Esto nos permite conseguir una secuencia digital de audio que ocupe menos espacio de almacenamiento o que requiera menos capacidad de un canal de comunicaciones. Los algoritmos de compresión que utilizan este fenómeno y otros similares, se conocen como codificadores basados en la percepción o métodos psicoacústicos (PAC: Perceptual Audio Coding) y se tratarán en un capítulo posterior. El oído es incapaz de registrar energía en algunas bandas cuando existe más energía en otra banda cercana. La vibración de la membrana en sintonía con una sola frecuencia no puede ser localizada en una zona infinitamente pequeña, por lo que las zonas cercanas se ven obligadas a vibrar a la misma frecuencia con una amplitud que decrece con la distancia. Otras frecuencias Tecnología de los Contenidos Multimedia 4.13 TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 son excluidas a menos que la amplitud sea lo bastante alta como para dominar la vibración local de la membrana. En el campo auditivo el rango de frecuencias audibles va de los 20 Hz a los 16 kHz (en la práctica), pero el oído no es igualmente sensible a todas estas frecuencias. Las más audibles son las ubicadas en la zona central del espectro, aproximadamente entre 1 kHz y 5 kHz. Para obtener el nivel de enmascaramiento se procede de la siguiente manera: Supóngase que se tienen dos sonidos, A y B. Se mide el umbral auditivo de A sin B. Luego se pasa el sonido B de fondo y se vuelve a medir el umbral de A. El enmascaramiento es la diferencia, en dB, entre el umbral de A en presencia de B y en ausencia de éste. Por ejemplo, si el umbral de A es de 30 dB y el umbral de A en presencia de B es de 50 dB entonces el enmascaramiento producido es de 20 dB. La interacción entre dos estímulos presentados al mismo tiempo depende en gran medida de las características de los sonidos. Seguidamente se describen las características básicas que rigen el enmascaramiento. Un sonido posee mayor poder enmascarante cuando se intenta enmascarar a otro que tenga una frecuencia parecida. En cambio, resulta muy difícil de enmascarar con otro de frecuencia diferente, alejada en el espectro. El enmascaramiento podrá realizarse, pero el nivel de presión sonora necesario tendrá que ser mayor que en el primer caso. Un sonido de determinada frecuencia tiene más poder enmascarante sobre otro de frecuencia más aguda que sobre otro de frecuencia más grave a la misma distancia frecuencial. Por lo tanto, si se está buscando el efecto de enmascaramiento, es más fácil lograrlo con un sonido enmascarante de frecuencia más grave que el enmascarado. La curva de sensibilidad que representa el umbral de audición de una señal en función de su frecuencia en ausencia de señal perturbadora se representa en la figura 4.9, donde la señal A es audible, puesto que sobrepasa el umbral de percepción. Figura 4.9 4.14 Umbral de audibilidad en función de la frecuencia Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 Más recientemente, se ha observado que esta curva se ve afectada en presencia de múltiples señales. Por ejemplo, en el caso de dos señales de frecuencias relativamente cercanas, la señal más fuerte hace subir el umbral de audición en sus proximidades, cuyo efecto es disminuir la sensibilidad del oído alrededor de estas frecuencias. La figura 4.10 representa este caso, donde la señal A, antes audible, es ahora enmascarada por la cercana señal B, más potente que A. Este efecto recibe el nombre de enmascaramiento frecuencial, y se detalla más adelante. En presencia de una entrada de espectro complejo, como la música, el umbral aumenta en casi todas las frecuencias. Una consecuencia de este comportamiento es que el siseo de una cinta de caset de audio analógico es sólo audible durante los pasajes silenciosos de la música. Figura 4.10 Enmascaramiento frecuencial (A enmascarado por B) También existe un efecto de enmascaramiento temporal que básicamente consiste en que un sonido de elevada amplitud enmascara igualmente los sonidos más débiles inmediatamente anteriores o posteriores, tal y como ilustra la figura 4.11. Este fenómeno se detallará más adelante. Figura 4.11 Enmascaramiento temporal Tecnología de los Contenidos Multimedia 4.15 TEMA 4. LA SEÑAL DE AUDIO 4.5 UNED - CURSO 2009-2010 LOCALIZACIÓN ESPACIAL DE LAS FUENTES En el caso más general, en campo abierto, es decir, en ausencia de reflexiones, el cerebro localiza la fuente de sonido, basándose en la diferencia de nivel entre un oído y otro, y en la diferencia de tiempo (retardo) entre ambos oídos. Como se había dicho, el sonido viaja a una velocidad de 343 m/s y la separación entre oídos es de unos 20 cm, los posibles retardos llegan hasta 600 µs (1 microsegundo = 0.000001 segundo). La diferencia de nivel entre los oídos, es debido principalmente a la ‘sombra’ acústica que crea la cabeza. Este efecto se acusa más en altas frecuencias ya que estas son más directivas. Las altas frecuencias se localizan principalmente por diferencia de nivel, y las bajas por diferencia de fase (retardo). Para acabar de localizar la fuente del sonido, está el movimiento de la cabeza, que es algo instintivo y colabora de forma determinante a la ubicación de la fuente. En este apartado, nos centraremos en un caso concreto de los posibles: dos fuentes sonoras emitiendo señales coherentes. Se elige este caso porque es el más general. Los dos altavoces de un sistema estéreo emiten, en su mayor parte señal coherente, es decir señal altamente correlacionada y en algunos casos incluso la misma señal. Figura 4.12 Esquema de ubicación de una pareja de altavoces de un sistema estéreo. La posición estéreo por definición, es cuando los altavoces y el oyente forman un triángulo equilátero de tres metros de lado. Además se suelen elevar los altavoces unos pocos grados sobre el plano de audición. Para simular los distintos efectos se suelen añadir retardos entre los dos altavoces, mediante la electrónica. Se puede añadir retardo a toda la señal, o solo a unas frecuencias para crear distintos ambientes. Si el oyente se sitúa a la misma distancia de los dos altavoces, los escucharía al mismo nivel, suponiendo que la señal que entra ambos altavoces es la misma, solo con posibles retardos. Variando solo el retardo entre altavoces, tendríamos los siguientes casos: 1.- Retardos entre 0 y 630 µs: el oyente identifica que hay una única fuente de sonido cuya posición depende del retardo entre las dos señales. El cerebro ‘suma’ las señales de los dos oídos para determinar la posición de la fuente. Este efecto se denomina ‘localización suma’ y es la base de los efectos estereofónicos con dos altavoces. 2.- Retardos entre 1 ms y 40-50 ms: el oyente identifica una única fuente sonora que sitúa en la posición del altavoz cuya señal está llegando primero a sus oídos (el que no está retardado). 4.16 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 Las componentes de señal que llegan a los oídos en primer lugar son tomadas en consideración y las últimas son suprimidas en el proceso de cálculo. Este es el llamado efecto del Primer Frente de Onda, muy importante a la hora de diseñar sistemas de refuerzo sonoro mediante varios altavoces como sucede, por ejemplo, en salas de cine o en conciertos de Pop/Rock en grandes espacios. 3.- Retardos superiores a 50 ms: el oyente identifica dos fuentes de sonido, cada una en la posición de un altavoz. La segunda fuente de sonido se percibirá como eco de la primera. Los límites de los márgenes de los retardos no son fijos, ya que dependen también de las condiciones ambientales del experimento y también de la percepción subjetiva de cada individuo. Por ejemplo, para retardos entre 630 µs y 1 ms, se tendrá Localización Suma o Ley del Primer Frente de Onda en función del sujeto y de las condiciones del experimento. 4.6 ACÚSTICA MUSICAL Al principio del capítulo se ha definido el sonido en su sentido más general y desde el punto de vista puramente físico, sin embargo, no podemos olvidar que hay un tipo de sonido de especial interés y es el sonido musical. La música emplea el sonido para producir y generar en el oyente distintas emociones y tiene sus propias reglas para conseguir un sonido agradable, aunque esto último depende fuertemente de la obra musical y del oyente, puesto que la componente subjetiva en el campo musical es muy elevada. Sin embargo, gustos musicales aparte, hay un cierto consenso en lo que es agradable de lo que no lo es tanto y esto está recogido en las reglas rítmicas, melódicas y armónicas. En una obra musical tenemos un conjunto de instrumentos que generan distintos sonidos de forma coordinada y perfectamente sincronizada. Además cada instrumento genera habitualmente distintos sonidos o notas musicales. Cada uno de estos sonidos es relativamente simple pues presentan una frecuencia fundamental y un conjunto de armónicos relacionados de forma sencilla con esta frecuencia fundamental tal y como ya se ha explicado. Pero al final lo que percibimos en conjunto, como combinación de todos estos sonidos, es un sonido realmente complejo. Para que este sonido sea agradable deben guardarse unas ciertas reglas rítmicas y armónicas. Estas reglas son fundamentales para que la sensación percibida sea agradable y la composición pueda generar y transmitir ciertas emociones. Toda obra musical está compuesta, tal y como se ha dicho, por un conjunto de sonidos que se reproducen de forma simultánea (varias notas sonando a la vez) y secuencial (orden de reproducción de las notas). Si nosotros alteramos el orden, pasaremos de percibir sensaciones agradables a algo que puede resultar difícilmente ‘digerible’. En este curso no entraremos en este tipo de aspectos pues entran de lleno en el campo de la composición e interpretación musical. Pero no podemos olvidar que la música es el gran campo de aplicación del procesamiento de audio sea de forma digital o no debido al gran mercado y elevado interés de conlleva. No en vano, muchos de los elementos procesadores de audio Tecnología de los Contenidos Multimedia 4.17 TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 se emplean casi exclusivamente en los entornos de producción musical por lo que resultan convenientes algunas nociones básicas. Al emitir dos o más sonidos simultáneamente se dice que se produce un acorde, que puede ser consonante o disonante según que la sensación experimentada sea agradable o desagradable. La sensación producida en el oído no depende de los valores absolutos de las frecuencias de los sonidos sino de la relación entre ellas. La música se construye a partir de una sucesión de notas que se caracteriza por la relación entre sus frecuencias. La relación fundamental en música es la octava. Una octava se define como un intervalo de frecuencias en el que la frecuencia superior es el doble de la frecuencia inferior y se correspondería con un salto de ocho teclas blancas en el piano. Por ejemplo, un sonido de 200Hz dista una octava de un sonido de 100Hz. Entre un sonido de 1kHz y otro de 250Hz hay una separación de dos octavas (250 - 500 Hz y 500 - 1000 Hz). Fue Pitágoras quien descubrió que existía una relación numérica entre tonos que sonaban ‘armónicos’ y fue el primero en darse cuenta de que la música, siendo uno de los medios esenciales de comunicación y placer, podía ser medida por medio de razones de enteros. Sabemos que el sonido producido al tocar una cuerda depende de la longitud, grosor y tensión de la misma. Entendemos que cualquiera de estas variables afecta la frecuencia de vibración de la cuerda. Lo que Pitágoras descubrió es que al dividir la cuerda en ciertas proporciones era capaz de producir sonidos placenteros al oído. Eso era una maravillosa confirmación de su teoría. Números y belleza eran uno. El mundo físico y el emocional podían ser descritos con números sencillos y existía una relación armónica entre todos los fenómenos perceptibles. Pitágoras encontró que al dividir una cuerda a la mitad producía un sonido que era una octava más agudo que el original (Do al Do superior); que cuando la razón era 2:3 se producía una quinta (la distancia de Do a Sol) y que otras razones sencillas producían sonidos agradables. La razón por la cual encontramos a estos intervalos más agradables que otros tiene que ver con la física de la cuerda tocada. Cuando una cuerda de 36 cm se rasga, no sólo se produce una onda de 36 cm, sino que además se forman dos ondas de 18 cm, tres de 12, cuatro de 9, y así sucesivamente. La cuerda vibra en mitades, tercios, cuartos, etcétera. Y cada vibración subsidiaria produce ‘armónicos’, estas longitudes de onda producen una secuencia de armónicos, 1/2, 1/3, 1/4... de la longitud de la cuerda. Los sonidos son más agudos y mucho más suaves que el sonido de la cuerda completa (llamada fundamental) y no se perciben de forma clara precisa y consciente pero son los que hacen que los instrumentos musicales suenen diferentes entre sí (timbre). Ya que Do y Sol, a una distancia de quinta, comparten muchos de los mismos armónicos, estos sonidos se mezclan produciendo un resultado agradable. Sin embargo, Pitágoras no sabía nada de armónicos. Él sólo sabía que la longitud de la cuerda con las razones 1:2 y 2:3 producía unas combinaciones de sonidos agradables y construyó una escala a partir de estas proporciones. En sus experimentos, Pitágoras descubrió tres intervalos que consideraba consonantes: el diapasón, el diapente y el diatesaron. Actualmente los llamamos 4.18 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 la octava, la quinta y la cuarta porque corresponden al octavo, cuarto y quinto sonidos de la que conocemos como escala pitagórica diatónica. La llamamos quinta porque corresponde a la quinta nota de la escala. Los pitagóricos no sabían de ondas sonoras ni de frecuencias ni de cómo la anatomía del oído afecta la altura de un sonido. De hecho, la regla que establece que la frecuencia está relacionada con la longitud de la cuerda no fue formulada sino hasta el siglo XVII, cuando el franciscano fray Marin Mersenne definió algunas reglas sobre la frecuencia de una cuerda vibrando. Una escala es una serie de notas ordenadas de forma ascendente o descendente, a la primera de las notas se le llama tónica. A continuación se describen las escalas musicales que han ido surgiendo a lo largo de la historia. La escala diatónica: Como mínimo desde la Edad Media las escalas que se han utilizado son las escalas diatónicas, que se pueden simbolizar con las teclas blancas del piano. Estas escalas tienen dos intervalos musicales diferentes: el semitono (entre las teclas blancas, Mi-Fa y Si-Do) y tonos completos (entre las otras parejas de notas adyacentes). Tienen siete notas por octava (la octava nota de esta serie es simplemente la repetición de la primera, pero situada una octava más arriba). Un intervalo es la diferencia de tono entre dos notas. Mientras el nombre de la nota expresa su tono o frecuencia de vibración, el intervalo indica la relación entre una nota y otra. La escala cromática: A finales del siglo XIX, y dado el hecho del uso cada vez más frecuente de los sostenidos y los bemoles, la música occidental comenzó a basarse no en la escala diatónica, sino en la cromática: 12 notas en una octava, separadas por un semitono: Do, Do#, Re, Re#, Mi, Fa, Fa#, Sol, Sol#, La, La#, Si (y nuevamente Do). La escala temperada: Los problemas de afinación en instrumentos con intervalos fijos (piano, guitarra), hizo construir una escala en la que el intervalo entre dos notas consecutivas fuese siempre el mismo. Esta es la escala temperada que es la que se emplea en la práctica. Consta también de doce notas, como la cromática, pero la relación de la frecuencia de una nota y la anterior es siempre igual a 12 2. En 1939 una conferencia internacional fijó la frecuencia de una nota de referencia, a partir de la cual poder deducir todas las demás. La nota y frecuencia escogidas fueron el La4 (La de la 4ª octava del piano) a 440 Hz. Posteriormente en 1995 fue adoptada por la Organización Internacional de Estandarización (ISO). A esta nota se le llama tono de referencia o tono de cámara y constituye un valor importante dentro del mundo de la música como lo demuestran el nombre de algunos grupos musicales como el que acompaña a Juan Luis Guerra o el grupo de Noko y los hermanos Trevor y Howard Gray (Apollo 440). Esta nota se emplea también para afinar los ins- Tecnología de los Contenidos Multimedia 4.19 TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 trumentos de una orquesta sinfónica. Tras afinar el primer violín o el oboe solista, éste da la nota de 440 Hz y los demás instrumentos se afinan en consonancia. Cuando el piano forma parte de la orquesta, es éste el que da la nota de referencia. A partir de esta se pueden deducir todas las Fa# Sol# La# Do# Re# Fa# Sol# La# Do# Re# Fa# Sol# La# Do# Re# Fa# Sol# La# Do# Re# Fa# Sol# La# Do# Re# Fa# Sol# La# Do# Re# Fa# Sol# La# Do# Re# La Si Do Re Mi Fa Sol La Si Do Re Mi Fa Sol La Si Do Re Mi Fa Sol La Si Do Re Mi Fa Sol La Si Do Re Mi Fa Sol La Si Do Re Mi Fa Sol La Si Do Re Mi Fa Sol La Si Do La# demás. Figura 4.13 Teclado estándar de piano con 88 teclas; 52 blancas y 36 negras. En la nomenclatura anglo-sajona las notas se designan mediante letra mayúsculas, de acuerdo con la siguiente equivalencia: 4.7 Do Re Mi Fa Sol La Si C D E F G A B DIGITALIZACIÓN DE AUDIO El sonido es un fenómeno analógico; es una onda continua en el tiempo surgida de las diferencias de presión del aire que nos rodea y que viaja a través de éste. Con un micrófono se puede generar una onda eléctrica análoga (o proporcional) a estas diferencias de presión. Esta señal eléctrica analógica no puede ser almacenada de esta forma en un sistema digital; para ello debemos digitalizarla, es decir, convertirla en una secuencia de números. La digitalización de una señal analógica requiere dos procesos. En primer lugar se toman muestras de la amplitud de dicha señal a intervalos regulares de tiempo (muestreo) y seguidamente se asigna a las muestras un valor numérico proporcional (cuantificación). Por ello hay dos aspectos a considerar, con qué frecuencia se debe muestrear la señal y con qué precisión se cuantificará su amplitud. El Teorema de Nyquist establece que “para poder reconstruir completamente una señal a partir de sus muestras digitalizadas, la frecuencia de muestreo debe ser, al menos, el doble de su componente de frecuencia más elevada”. Por otro lado la precisión depende de varios factores, entre ellos del nivel de ruido que se esté dispuesto a tolerar en la señal reconstruida, ya que la propia cuantificación de la señal es fuente de ruido, conocido como ruido de cuantificación. Los Discos Compactos (CD) de audio contienen información digital de sonidos muestreados a 44,1 kHz (el oído humano no puede captar sonidos por encima de los 20 KHz aproximadamente) y cuantificados utilizando un número binario de 16 dígitos binarios (16 bits, 216=65535 valores posibles por cada muestra). Como los canales son dos (izquierdo y derecho), el volumen de infor- 4.20 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 mación que es necesario procesar es de 1,4 Mbits/segundo (44100 muestras por segundo x 16 bits x 2 canales). Esta inmensa cantidad de información es difícil y costosa de manipular, aún para los modernos sistemas digitales actuales. Es necesario, por lo tanto, algún método de reducción o compresión para reducir este volumen de datos. Suponiendo que no se desea reducir la frecuencia de muestreo ni la precisión de la cuantificación, existen dos tipos de métodos para comprimir audio digital: compresión sin pérdida de información (lossless) y compresión con pérdida de información (lossy). Ejemplos de codificadores sin pérdida de información son el ZIP de propósito general y específicos para audio el Monkey Audio y el FLAC (Free Lossless Audio Codec), A finales de la década de los 80 y principios de los 90, un comité internacional denominado MPEG (Moving Pictures Expert Group), trabajando bajo los auspicios de la ISO (International Organization for Standarization) y el IEC (International Engineering Consortium) publicó, bajo la forma de un estándar internacional, un algoritmo para comprimir señales de audio sin pérdidas apreciables en la calidad, pero sí con pérdidas de información. Dicho estándar, el ISO/IEC-11172-3 es la tercera parte de un conjunto más amplio de normas que incluyen la compresión de señales de video (ISO/IEC-11172-2) y los sistemas asociados para su sincronización, procesamiento y transmisión (ISO/IEC-11172-1) sobre canales de comunicación o medios de almacenamiento con una capacidad máxima de 1,4 Mbits/segundo. El documento propone tres niveles (layers) de compresión, de creciente eficiencia y complejidad, con los que se pueden alcanzar relaciones de compresión de hasta 12:1 en el más elaborado de todos (Layer 3). La norma ha cobrado gran relevancia en el ámbito de Internet; los motivos son dos: la notable calidad de sonido del audio comprimido y su altísima relación de compresión; lo que permite archivos de sonido de poco tamaño, de alta calidad y muy fáciles de trasmitir a lo largo de la Red. Este esquema es el empleado por el célebre formato MP3. De hecho sus siglas provienen de la contración de MPEG-Layer 3. Puede definirse el sonido como una onda continua que viaja a través del aire; dicha onda está constituida por diferencias de presión y tiene las mismas propiedades que una onda normal: reflexión, refracción, difracción, etc.. Los sistemas desarrollados desde la época de Edison hasta finales de la década del '70, aproximadamente, tienen una característica en común: todos son sistemas analógicos. Es decir, el sistema procesa y/o almacena un registro análogo a la onda sonora que se pretende captar. Este registro puede ser mecánico, eléctrico o magnético. Por ejemplo: el surco que recorre una aguja sobre la superficie de un disco de vinilo es análogo a la onda de sonido original. Lo mismo sucede con las cintas magnéticas, la mayor o menor magnetización de la cinta es proporcional y análoga a la onda de sonido que excitó al sistema en primera instancia. Hoy en día prevalece otra forma de registrar y almacenar sonidos: el audio digital. Como ya se ha indicado la digitalización es un proceso mediante el cual una señal analógica (de audio por ejemplo) es representada por una secuencia finita de números. Mediante esta secuencia Tecnología de los Contenidos Multimedia 4.21 TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 de números es posible volver a reconstruir la señal analógica original. La digitalización es especialmente interesante porque los números son más fáciles de tratar por los sistemas electrónicos actuales y, fundamentalmente, porque la pérdida de calidad al transmitir, reproducir, copiar o almacenar la información digitalizada es nula. Para digitalizar una señal de audio es necesario conocer algunas de sus características, principalmente su componente de mayor frecuencia, es decir el ancho de banda de la señal, ya que mediante el teorema de muestreo de Nyquist obtenemos la frecuencia de muestreo mínima necesaria. Se utiliza la mínima porque dicho teorema establece una condición suficiente que por tanto garantiza la reconstrucción. Utilizar una frecuencia mayor tendría como consecuencia un número mayor de datos y con ello de coste de almacenamiento, sin aportar nada útil. El proceso consiste en tomar muestras de la amplitud de la señal a intervalos regulares de tiempo (muestreo) y asignarles un valor numérico proporcional (cuantificación). Supóngase que se pretende muestrear una onda sinusoidal como la de la figura 4.14.a. Si se toma una muestra por ciclo de la señal, la información puede indicar que la señal es constante (figura 4.14.b). Si se toman muestras a baja velocidad, por ejemplo 1,5 veces por ciclo de la señal, podría pensarse que es una señal sinusoidal de menor frecuencia (figura 4.14.c). Este fenómeno, que se produce cuando la frecuencia de muestreo no es al menos el doble de la mayor frecuencia contenida en la señal a digitalizar recibe el nombre de aliasing. (a) (b) 4.22 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 (c) Figura 4.14 Muestreo Como ya se ha dicho el Teorema de Nyquist o teorema del muestreo, demuestra que una señal de ancho de banda limitado puede ser totalmente reconstruida a partir de sus muestras si la frecuencia de muestreo es, al menos, el doble de la componente de mayor frecuencia de la señal. Supóngase el ejemplo del oído humano. Es capaz de percibir sonidos de hasta 22 KHz de frecuencia, ése es su ancho de banda. Entonces, según el Teorema de Nyquist, para poder digitalizar correctamente todo este ancho de banda se deberían tomar muestras al doble de frecuencia. La frecuencia de muestreo utilizada en los discos compactos de audio es de 44,1kHz, suficiente para poder cubrir todo el espectro audible del ser humano y lograr una alta calidad de sonido. Una vez decidida la velocidad con la que se tomarán las muestras, es necesario medir la amplitud de cada una de ellas y asignarles un número, este proceso se denomina cuantificación. La cuantificación entonces, consiste en asignarle un valor numérico a la amplitud de cada muestra de la señal. Por lo general dicho número se expresa en notación binaria; generalmente se utilizan 8 o 16 dígitos binarios (8 o 16 bits) para representarlo. A mayor cantidad de bits, mayor será la precisión con la que se medirá cada muestra; la elección de esta precisión depende de varios factores, entre ellos del nivel de ruido que se esté dispuesto a tolerar en la señal reconstruida. En sistemas analógicos parte de la señal es información útil y parte de ella son fluctuaciones aleatorias (ruido). La relación entre las potencias de las dos se denomina Relación Señal/Ruido (SNR): SNR = 10 log 2 Vseñal V = 20log señal 2 Vruido Vruido Esta relación es una medida de la calidad de la señal y generalmente es expresada en Decibelios (dB). Para el caso de señales digitalizadas, la precisión de una muestra está determinada por el número de bits usados para medir su amplitud (por ejemplo 8 o 16 bits). La calidad de la cuantización puede medirse a través de la Relación Señal/Ruido de Cuantización (SQNR). Si se utili- Tecnología de los Contenidos Multimedia 4.23 TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 zan N bits de resolución por cada muestra, la medición de la amplitud de dicha muestra solo podrá tomar 2N valores distintos, en un rango que va de -2N-1 a 2N-1. El error de cuantización es la diferencia entre el valor real de la señal analógica en un punto y el valor asignado a la muestra. El mayor (peor) error de cuantización es medio intervalo de cuantización (medio LSB Least Significant Bit). SNR = 20log Vseñal Vruido−cuantizacion 2 N −1 = 20log = 20 N log 2 = 6.02 N (db) 1 2 En otras palabras, cada bit suma 6 dB de resolución. De esta manera, con 16 bits se logra una máxima Relación Señal/Ruido de Cuantización de 96 dB. En resumen, la elección de la frecuencia de muestreo depende del ancho de banda de la señal; mientras que la elección de la cantidad de bits de resolución de cada muestra depende del nivel de ruido que estemos dispuestos a tolerar en la señal reconstruida. Este tipo de proceso de digitalización es más conocido por sus siglas en inglés: PCM, Pulse Code Modulation, o Modulación por Codificación de Pulsos. A modo de ejemplo, a continuación se muestra en la tabla 4.4 con las diferentes calidades de audio que pueden conseguirse con diferentes combinaciones de frecuencias de muestreo y resoluciones de cuantificación: Calidad Teléfono Radio AM Radio FM Compact Disc Tabla 4.4 Ancho de Banda 200–3400 Hz 5,6 KHz 11 KHz 22,05 KHz Frecuencia de Muestreo [KHz] 8 11,025 22,05 44,1 Bits por muestra Mono/Stereo Data Rate 8 8 16 16 mono mono stereo stereo 64 kbps 88,2 kbps 705,6 kbps 1,4 Mbps Distintas calidades de audio y su Data Rate asociado. Los valores de la columna Data Rate se calculan multiplicando la frecuencia de muestreo por la cantidad de bits por muestra y por la cantidad de canales (mono=1, stereo=2). El resultado es la cantidad de bits que debe procesar el sistema en un segundo y da una idea general del volumen de información que debe ser capaz de manejar. Si bien los sistemas digitales actuales son muy poderosos; capaces de almacenar, procesar y transmitir grandes cantidades de información en muy poco tiempo y espacio, existen determinadas señales cuyo volumen de información es extremadamente grande y por lo tanto dificultan y encarecen todos estos procesos. Tal es el caso, por ejemplo, del audio almacenado en un Disco Compacto. Como se observa en la tabla 4.4, el Data Rate de un CD es de aproximadamente 1,5 Mbits/segundo, un volumen más que importante de información si pensamos que esto se traduce 4.24 Tecnología de los Contenidos Multimedia TEMA 4. LA SEÑAL DE AUDIO UNED - CURSO 2009-2010 en unos 650Mbytes para tan sólo 74 minutos de audio (Capacidad de un CD-Audio convencional). Debido a esto, se han desarrollado a lo largo de los años diferentes métodos para reducir o comprimir la cantidad de datos a procesar por los sistemas digitales. Tecnología de los Contenidos Multimedia 4.25 TEMA 4. LA SEÑAL DE AUDIO 4.26 UNED - CURSO 2009-2010 Tecnología de los Contenidos Multimedia