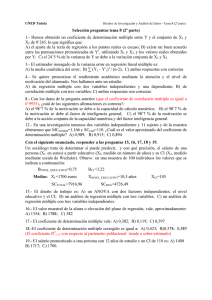

Regresión Múltiple

Anuncio

Regresión Lineal Múltiple

Santiago de la Fuente Fernández

Regresión Lineal Múltiple

Santiago de la Fuente Fernández

Regresión Lineal Múltiple

REGRESIÓN LINEAL MÚLTIPLE

Las técnicas de regresión lineal múltiple parten de (k+1) variables cuantitativas, siendo Y la variable

de respuesta y ( X1 , X2 , LL , Xk ) las variables explicativas.

Se trata de extender a las 'k' variables las técnicas de la regresión lineal simple. En esta línea, la

variable Y se puede expresar mediante una función lineal de las variables ( X1 , X2 , LL , Xk )

Y = β0 + β1 X1 + β2 X2 + L + βk Xk

Para ello, dispondremos de una modelo de probabilidad (la Normal). El estadístico fija los valores de

las variables regresoras X ki y obtiene 'al azar' los correspondientes valores Yi

Modelo: Y = β0 + β1 X1 + β2 X2 + L + βk Xk + U

Sea la muestra aleatoria: Yi = β0 + β1 X1 i + β2 X2 i + L + βK XK i + ui (i = 1, 2, L ,n)

Yi ε N(β0 + β1 X1 + β2 X2 + L + βk Xk , σ2 ) independie ntes , (i = 1, 2, L ,n)

ui ε N(0, σ2 ) independientes, (i = 1,2, L ,n)

⎛ u1 ⎞

⎛ Y1 ⎞ ⎛⎜ 1 X11 L Xk 1 ⎞⎟ ⎛ β0 ⎞

⎜ ⎟

⎜ ⎟

⎜ ⎟

⎜ u2 ⎟

⎜ Y2 ⎟ ⎜ 1 X12 L Xk 2 ⎟ ⎜ β1 ⎟

⎜

⎟

En forma matricial: ⎜ M ⎟ = ⎜ M M L M ⎟ ⎜ M ⎟ + ⎜ M ⎟

⎜ ⎟

⎜ ⎟

⎜ ⎟

⎜M ⎟

⎜ M ⎟ ⎜ M M L M ⎟ ⎜ M ⎟

⎟⎜ ⎟

⎜ ⎟

⎜ ⎟ ⎜⎜

⎝ un ⎠

⎝ yn ⎠ ⎝ 1 X1n L Xk n ⎟⎠ ⎝ βk ⎠

Y = X β + U siendo X =' matriz del diseño'.

•

Las hipótesis comunes entre las regresiones lineal y múltiple son:

a) Normalidad: ui ε N(0, σ2 )

b) Linealidad: E (u i ) = 0

c) Homocedasticidad: Var (u i ) = 0

d) Independencia: u i son independientes (i = 1, 2, L ,n)

•

Requisitos adicionales de la regresión múltiple:

a) n > k+1. El modelo depende de (k+2) parámetros. Para que la regresión tenga significado

debe haber un número suficiente de datos.

b) Ninguna de las variables explicativas X es combinación lineal de las otras (Colinealidad). Si

alguna de las Xi es combinación lineal exacta de alguna de las otras Xi , el modelo puede

simplificarse con menos variables explicativas. También hay que considerar si alguna de las

Xi está fuertemente correlacionada con otras.

Santiago de la Fuente Fernández 1

Regresión Lineal Múltiple

ESTIMACIÓN DE LOS PARÁMETROS

Sea la muestra aleatoria: Yi = β0 + β1 X1 i + β2 X2 i + L + βK XK i + ui (i = 1, 2, L ,n)

En forma matricial: Y = X β + U siendo X ='matriz del diseño'.

Datos

X1

Y

X2

……

XK

La nube de puntos está en un

espacio de dimensión (k+1).

Y1

X 11

X 21

……

X k1

2

Y2

X 12

X 22

……

X k2

M

M

M

M

……

M

n

Yn

X 1n

X 2n

……

X kn

1

⎛ n X2 n X X

∑ i1 i2

⎜ ∑ i1

i=1

⎜ i=n1

n

⎜ ∑ Xi2Xi1 ∑ X2i2 donde, X' X = ⎜ i=1

i=1

M

⎜ M

n

⎜ n

⎜ ∑ Xik Xi1 ∑ Xik Xi2

i=1

⎝ i=1

Es difícil de visualizar para k>2

βˆ = [X' X ] −1 X' Y

donde X' es la matriz transpuesta

del diseño

n

⎛ n X Y⎞

... ∑ Xi1Xik ⎞⎟

⎜ ∑ i1 i ⎟

i=1

⎜ i=n1

⎟

⎟

n

⎜

⎟

... ∑ Xi2Xik , X' Y = ∑ Xi2Yi ⎟

⎜ i=1

⎟

⎟

i=1

⎜ M ⎟

M ⎟

...

n

⎜n

⎟

⎟

... ∑ X2ik ⎟

⎜ ∑ Xik Yi ⎟

i=1

⎠

⎝ i=1

⎠

Cada uno de los coeficientes βi representa el efecto de la variable independiente sobre la variable

explicada. Es decir, el valor estimado β̂i indica la variación que experimenta la variable

dependiente cuando la variable independiente X i varía en una unidad y todas las demás

permanecen constantes.

Cuando el modelo tiene término independiente, las matrices anteriores se simplifican con las

siguientes expresiones:

⎛ n

⎜

⎜n

⎜ X i2

X' X = ⎜ ∑

i=1

⎜ M

⎜n

⎜ ∑ Xik

⎝ i=1

[

⎛ nY ⎞

⎜ ∑ i ⎟

i=1

i=1

⎜ ni=1 ⎟

⎟

n

n

2

∑ Xi2 ... ∑ Xi2Xik ⎟ , X' Y = ⎜ ∑ Xi2Yi ⎟

⎜ i=1

⎟

⎟

i=1

i=1

⎜ M ⎟

M

M ⎟

...

n

n

⎜n

⎟

⎟

∑ Xik Xi2 ... ∑ X2ik ⎟

⎜ ∑ Xik Yi ⎟

i=1

i=1

⎠

⎝ i=1

⎠

⎞

∑ Xi2 ... ∑ Xik ⎟

n

n

]

ˆ = SR2 =

u i = Yi − Ŷi = Yi − βˆ 0 + βˆ 1 X1 i + βˆ 2 X2 i + L + βˆ K XK i σ

n

1

∑ u2i

n − k − 1 i=1

Santiago de la Fuente Fernández 2

Regresión Lineal Múltiple

En un principio, para estimar la varianza del error aleatorio U, parece razonable utilizar la varianza de

los errores de predicción, también denominados residuos del modelo.

1 n

ˆ 2 = ∑ u2i . Sin embargo, este estimador es sesgado E (σˆ 2 ) ≠ σ2 ,

Es decir, parece razonable utilizar σ

n i =1

n

1

por tanto, se utiliza como estimador SR2 =

∑ u2i .

n − k − 1 i=1

DEMOSTRACIÓN ( Y = X β + U ⇒ βˆ = [X' X ] −1 X' Y )

Y = X β + U . El correspondiente modelo ajustado será Ŷ = X βˆ , con lo cual, Û = Y − Ŷ = Y − X βˆ

Denominando S a la suma de los cuadrados de los residuos:

S = Û' Û = [ û1 , û2 , LL , ûn ]

[

][

]

⎡û1 ⎤

⎢û ⎥

n

⎢ 2 ⎥ = ∑ û ( U' matriz transpuesta de U )

⎢ M ⎥ i=1 i

⎢ ⎥

⎣ûn ⎦

'

S = Y − X βˆ Y − X βˆ = Y' Y − βˆ ' X' Y − Y' X β + βˆ ' X' X B̂ = Y' Y − βˆ ' X' Y − βˆ ' X' Y + βˆ ' X' X B̂ = Y' Y − 2 βˆ ' X' Y + βˆ ' X' X B̂

14444244443

un escalar es igual a su transpuesto

βˆ ' X' Y=X' Y βˆ

Para minimizar S se aplica el criterio mínimo‐cuadrático, derivando respecto de β̂ :

S

= −2 X' Y + 2 X' X B̂ = 0 ⇒ X' X B̂ = X' Y a

ϑβˆ

[X' X]−1 (X' X ) B̂ = [X' X]−1 X' Y

a B̂ = [X' X ]−1 X' Y

DISTRIBUCIÓN DE β̂

a) Las estimaciones de los parámetros vienen dada por la expresión βˆ = [X' X ] −1 X' Y (siendo X' la

matriz transpuesta del diseño).

b) El vector de observaciones Y se distribuye según una normal multivariante de media X β y de

matriz de varianzas y covarianzas σ 2 I , es decir, Y∈ N( X β, σ2 I) .

c) β̂ es combinación lineal de las componentes del vector Y, por lo que se distribuye según una

variable aleatoria normal, donde su media y matriz de varianzas y covarianzas será:

(

)

•

E (βˆ ) = E [X' X ] −1 X' Y = [X' X ] −1 X'E (Y) = [X' X ] −1 X' X β = β ⇒ β̂ es un estimador insesgado de β

•

Var (βˆ ) = Var [X' X ] −1 X' Y = [X' X ] −1 X' [Var (Y)] X [X' X ] −1 = [X' X ] −1 X' σ2 X [X' X ] −1 = σ2 [X' X ] −1

(

)

(

de donde, βˆ ∈ N β, σ 2 [X' X ] −1

)

Santiago de la Fuente Fernández 3

•

Regresión Lineal Múltiple

[

Con el ajuste de mínimos cuadrados: u i = Yi − Ŷi = Yi − βˆ 0 + βˆ 1 X1 i + βˆ 2 X2 i + L + βˆ K XK i

(

]

)

βˆ i ∈ N β, σ2 q i +1, i +1 , donde q i +1, i +1 son los elementos de la diagonal principal [X' X ] −1 .

Análogamente, la covarianza entre β̂i y β̂ j será σ 2 q i +1 , i +1

•

La estimación de la varianza residual σ2 se hace mediante S2R =

[ ]

n

1

∑ u2i , pudiéndose

n − k − 1 i=1

comprobar que el estimador es insesgado: E S2R = σ2

(

)

De forma que estimaremos la varianza de βˆ i ∈ N β, σ 2 q i +1, i +1 mediante S 2R q i +1, i +1 .

Se demuestra que Se obtiene (n − k − 1) S2R

σ

2

≈ χn2−k−1

βˆ i − βi

≈ N(0,1) .

σ q i +1, i +1

Como la variable t‐Student con k‐grados de libertad se define: tk =

resulta que, t =

βˆ i − βi

σ q i +1 , i +1

1

(n − k − 1) SR2

σ

(n − k − 1)

=

N(0,1)

1 2

χk

k

βˆ i − βi

≈ tn−k−1

SR q i +1, i +1

d) CONTRASTE DE HIPÓTESIS [t‐Student]

Nos planteamos si la variable X i influye sobre la variable de respuesta Y. En otras palabras, si el

valor del parámetro en la población es cero o no.

Para ello, se establece la hipótesis nula H0 : βi = 0 frente a la hipótesis alternativa H1: βi ≠ 0 .

βˆ i

β̂i − βi

El estadístico observado t =

, bajo la hipótesis nula resulta, t =

SR q i +1, i +1

SR q i +1, i +1

estadístico

experimental

647

4 48

4 estadístico

teórico

6

474

8

βˆ i

≤ tα

. En caso contrario, se rechaza.

Se acepta la hipótesis nula H0 cuando ; (n−k −1)

SR q i +1, i +1

2

Si n > 30 , se acepta la hipótesis nula H0 cuando t ≤ 2 . En caso contrario, se acepta la hipótesis

alternativa H1 , concluyendo que la variable Xi i‐ésima influye en la respuesta.

Santiago de la Fuente Fernández 4

Regresión Lineal Múltiple

CÁLCULO DEL COEFICIENTE DE CORRELACIÓN PARCIAL

En un modelo de regresión lineal múltiple, Y = β0 + β1 X1 + β2 X2 + L + βk Xk , se puede calcular

fácilmente el coeficiente de correlación parcial entre la variable de respuesta Y y una variable

regresora X, controlado por el resto de variables regresoras. Para ello se utiliza el contraste

individual de la t respecto a la variable X, y que se define como:

ti =

SR

βˆ i

i = 1, 2,...,k ,

q i +1, i +1

Obteniéndose la siguiente relación: R2Y iC =

t2i

t2i + n − (k + 1)

donde C = {1, 2, ... , i − 1, i + 1, ... ,k } conjunto de índices de todas las variables regresoras excepto el

índice i‐ésimo.

e) INTERVALOS DE CONFIANZA DE LOS PARÁMETROS β̂i

Las estimaciones de los parámetros vienen dada por la expresión βˆ = [X' X ] −1 X' Y (siendo X' la

matriz transpuesta del diseño).

n

(

)

Por otra parte, βˆ i ∈ N β, σ2 q i +1, i +1 , donde la varianza residual σ2 se estima por SR2 =

donde q i +1, i +1 son los elementos de la diagonal principal [X' X ] −1 .

[

IC1− α (βi ) = βˆ i ± t α / 2 , (n−k −1) SR

q i +1 , i +1

∑ (yi − ŷi ) 2

i=1

n −k −1

]

CONTRASTE DE HIPÓTESIS ‐ INTERVALOS DE CONFIANZA

Hipótesis nula H0 : βi = 0 X i no influye en Y

Hipótesis alternativa H1: βi ≠ 0 X i influye en Y

Se acepta la hipótesis nula H0 , X i no influye en Y, con un nivel de confianza (1 − α) cuando el

cero se encuentra en el intervalo de confianza.

En caso contrario, cuando el cero no cae en el intervalo de confianza, se acepta la hipótesis

alternativa H1 , y en consecuencia, X i influye en Y.

Este contraste es equivalente al contraste de la t‐Student para cada βi

Santiago de la Fuente Fernández 5

,

Regresión Lineal Múltiple

f) INTERVALO DE CONFIANZA PARA LA VARIANZA DE LOS RESIDUOS

⎞

⎞ ⎛

⎛

⎟

⎜ (n − k − 1) S2 (n − k − 1) S2 ⎟ ⎜ SCR

SCR

R

R

IC = ⎜ 2

; 2

; 2

=⎜ 2

⎟

⎟

χα

χ α

χ α

σ2 ⎜ χ α

⎟

⎜

1− , (n−k−1)

1 − , (n−k−1) ⎟

2

2

⎠

⎠ ⎝ 2 , (n−k−1)

⎝ 2 , (n−k−1)

DESCOMPOSICIÓN DE LA VARIABILIDAD

n

n

i=1

i=1

[

]

2

=0

6447

448

n

n

i=1

i=1

n

SCT = ∑ ( Yi − Y ) 2 = ∑ ( Yi − Ŷ i) + ( Ŷi − Y ) = ∑ ( Yi − Ŷ i) 2 + ∑ ( Ŷi − Y ) 2 + 2 ∑ ( Yi − Ŷi ).( Ŷi − Y )

n

∑ ( Yi − Y ) 2

=

i=1

1

4243

SCT

suma cuadrados total

(n−1) grados libertad

n

∑ ( Yi − Ŷ i) 2

i=1

n

∑ ( Ŷi − Y ) 2

+

i=1

1

4243

SCE

i=1

1

4243

SCR

suma cuadrados exp licada suma cuadrados residual

k grados libertad

(n−k−1) grados libertad

n

n

n

n

i=1

i=1

i=1

∑ ( Yi − Y ) 2 = ∑ ( Yi − Ŷ i) 2 + ∑ ( Ŷi − Y ) 2 ⇒ 1 =

∑ ( Yi − Ŷ i) 2

i=1

n

∑ ( Yi − Y )

2

i=1

1

4243

SCR / SCT

n

+

∑ ( Ŷi − Y ) 2

i=1

n

∑ ( Yi − Y ) 2

i=1

1

4243

2

R =SCE / SCT

Una vez estimado el modelo es conveniente obtener una medida acerca de la bondad del ajuste

realizado. Un estadístico que facilita esta medida es el Coeficiente de Determinación ( R2 ), que se

n

define: R2 =

( Yi − Ŷ i) 2

SCE ∑

i =1

SCT

=

n

∑ ( Yi − Y ) 2

i =1

El Coeficiente de Determinación permite, además, seleccionar entre modelos clásicos que tengan el

mismo número de regresores, ya que la capacidad explicativa de un modelo es mayor cuanto más

elevado sea el valor que tome este coeficiente.

Por otra parte, el valor coeficiente de determinación crece con el número de regresores del modelo.

Por ello, si los modelos que se comparan tienen distinto número de regresores, no puede

establecerse comparación entre sus R2 .

En este caso debe emplearse el coeficiente de determinación corregido R 2 , que depura el

incremento que experimenta el coeficiente de determinación cuando el número de regresores es

mayor.

R 2 = 1 −

SCR n − k − 1

⎛ n−1 ⎞

2

=1−⎜

⎟ 1−R

SCT n − 1

⎝ n −k −1 ⎠

[

]

Santiago de la Fuente Fernández 6

Regresión Lineal Múltiple

ANÁLISIS DE LA VARIANZA: TABLA ANOVA

Variación

Suma cuadrados

Grados libertad

Media cuadrática

SCE

k

SCR

n −k −1

n

Explicada

SCE = ∑ ( Yi − Ŷ i) 2

k

i=1

n

Residual

SCR = ∑ ( Ŷi − Y ) 2

Total

SCT = ∑ ( Yi − Y ) 2

n−k −1

i=1

n

F‐Snedecor

F=

SCE / k

SCR / (n − k − 1)

n−1

i=1

CONTRASTE DE HIPÓTESIS:

Hipótesis nula H0 : β1 = β2 = LL = βk = 0 el modelo no es explicativo

Hipótesis alternativa H1: al menos un βi ≠ 0 el modelo es explicativo

A un nivel de confianza (1 − α) se rechaza H0 si F ≥ Fα ; k , (n−k−1)

F‐Snedecor ‐ COEFICIENTE DE DETERMINACIÓN

n

El coeficiente de determinación se define: R2 =

( Yi − Ŷ i) 2

SCE ∑

i=1

SCT

=

n

∑ ( Yi − Y ) 2

i=1

De otra parte, la distribución F‐Snedecor:

F=

=

n−k −1

1 n−k −1

SCE / k

SCE SCT n − k − 1

1 n −k −1

1

=

= R2

=

= R2

= R2

SCR

SCT − SCE

SCR / (n − k − 1)

SCT SCR

k

k

k

1 − R2

k

SCT

SCT

R2 n − k − 1

1 − R2

k

a

F =

R2 n − k − 1

1 − R2

k

RESUMEN DE CONTRASTES

Contraste Conjunto

F‐Snedecor

Modelo explicativo

Modelo explicativo

Modelo explicativo

Modelo no explicativo

Modelo no explicativo

Modelo no explicativo

Contrastes Individuales

t‐Student

Todas las Xi son explicativas

Algunas Xi son explicativas

Ninguna Xi es explicativa

Todas las Xi son explicativas

Algunas Xi son explicativas

Ninguna Xi es explicativa

Conclusión

Tomamos todas las Xi

Nos quedamos con las Xi explicativas

Posible Multicolinealidad (revisar el Modelo)

Posible Multicolinealidad (revisar el Modelo)

Posible Multicolinealidad (revisar el Modelo)

El Modelo no explica Y

Santiago de la Fuente Fernández 7

Regresión Lineal Múltiple

PREDICCIÓN EN EL MODELO DE REGRESIÓN

Una vez estimado y validado el Modelo, una de sus aplicaciones más importantes consiste en poder

realizar predicciones acerca del valor que tomaría la variable dependiente en el futuro o para una

unidad extramuestral.

Esta predicción se puede realizar tanto para un valor individual como para un valor medio, o

esperado, de la variable dependiente, siendo posible efectuar una predicción puntual o por

intervalos. Su cálculo se realiza mediante las siguientes expresiones:

•

Intervalo de confianza para un valor medio de Y para los valores ( X10 , X20 , LL , Xk 0 ) de las

variables explicativas.

Ŷ0 = βˆ 0 + βˆ 1 X10 + βˆ 2 X20 + L + βˆ K XK 0

IC E(Y0 )

•

⎡

⎢

⎢

= ⎢Ŷ 0 ± t α / 2 , (n−k −1) S R

⎢

⎢

⎢

⎢⎣

(1 X 10 X 20

⎛1 ⎞

⎜

⎟

⎜ X 10 ⎟

L X k 0 ) (X' X) −1 ⎜ X 20 ⎟

⎜

⎟

⎜M ⎟

⎜

⎟

⎝ XK0 ⎠

⎤

⎥

⎥

⎥

⎥

⎥

⎥

⎥⎦

Intervalo de confianza para un valor individual de Y para los valores ( X 10 , X 20 , L L , X k 0 ) de las

variables explicativas.

IC Y0

⎡

⎢

⎢

= ⎢Ŷ0 ± t α / 2 , (n−k −1) SR

⎢

⎢

⎢

⎣⎢

1 + (1 X 10 X 20

⎛1 ⎞

⎜

⎟

⎜ X 10 ⎟

L X k 0 ) (X' X) −1 ⎜ X 20 ⎟

⎜

⎟

⎜M ⎟

⎜

⎟

⎝ XK0 ⎠

⎤

⎥

⎥

⎥

⎥

⎥

⎥

⎦⎥

MATRIZ DE COVARIANZAS

⎡σ2y

⎢

La matriz de varianzas–covarianzas se define: VC = ⎢ Sx 1 y

⎢ Sx y

⎣ 2

S yx 1

σ2x1

Sx 2 x 1

S yx 2 ⎤ ⎧S yx 1 = Sx 1 y

⎥ ⎪

Sx 1 x 2 ⎥ ⎨ S yx 2 = Sx 2 y

σ2x2 ⎥⎦ ⎪⎩Sx 1 x 2 = Sx 2 x 1

Los coeficientes (βˆ 1 , βˆ 2 ) vienen dados, respectivamente, con signo negativo (−) , por el cociente de

los adjuntos (S yx 1 , S yx 2 ) entre el adjunto de σ2y :

βˆ 1 = −

σ2x1

donde, VC y =

Sx 2 x 1

VC yx 1

VC y

βˆ 2 = −

VC yx 2

VC y

Sx 1 y

Sx 1 x 2

VC

=

−

y

x

1

Sx 2 y

σ2x2

βˆ 0 = Y − βˆ 1 X1 − βˆ 2 X2

Sx 1 x 2

σ2x2

VC y x 2

Sx y

= 1

Sx 2 y

σ2x1

S2x 2 x 1

Santiago de la Fuente Fernández 8

Regresión Lineal Múltiple

2

2

Coeficiente de determinación múltiple: R = ryx 1x 2 = 1 −

Coeficientes de correlación parcial:

x1

= VCx 1x 1 VC

σ

y

σ

VCσ2 = VC yy VC

x2

ryx 1 .x 2 = −

= VCx 2 x 2

CV

σ2y C yy

VC yx 1

VC yy VCx 1x 1

ryx 2 .x 1 = −

VC yx 2

VC yy VCx 2 x 2

MATRIZ DE CORRELACIONES

La matriz de correlaciones de las variables explicativas Rx está formada por los coeficientes de

correlación lineal simple:

S yx 1

⎧

ryx 1 =

⎪

⎡1

⎤

ryx 1 ryx 2

⎧ryx 1 = rx 1 y

σ y σx 1

⎢

⎥

⎪r = r

⎪⎪

Rx = ⎢ rx 1 y 1

rx 1x 2 ⎥ donde ⎨ yx 2 x 2 y ⎨

⎪rx x = rx x

⎪

S yx 2

⎢ rx y rx x

1 ⎥⎦

2 1

⎩ 1 2

2 1

⎣ 2

⎪ ryx 2 =

σy σx 2

⎪⎩

ryx 1 − ryx 2 rx 1 x 2

⎧

⎪ryx 1 .x 2 =

(1 − ryx2 2 )(1 − rx21x 2 )

⎪

⎪

Coeficientes de correlación parcial: ⎨

⎪

ryx 2 − ryx 1 rx 2 x 1

⎪ ryx 2 .x 1 =

(1 − ryx2 1 )(1 − rx22 x 1 )

⎪⎩

Coeficiente de determinación múltiple: R = r

2

2

yx 1 x 2

=

ryx2 1 + ryx2 2 − 2 ryx 1 ryx 2 rx 1x 2

1 − rx21x 2

Santiago de la Fuente Fernández 9

Regresión Lineal Múltiple

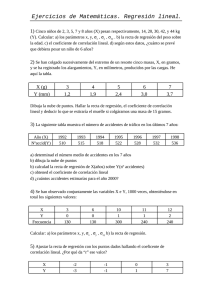

Ejercicio 1.‐ Se pretenden estimar los gastos en alimentación de una familia en base a la información

que proporcionan las variables regresoras 'ingresos mensuales y 'número de miembros de la

familia'. Para ello se recoge una muestra aleatoria simple de 15 familias, cuyos resultados se facilitan

en la tabla adjunta. (El gasto e ingreso se expresan en cien mil euros).

Gasto Alimentación

0,43

0,31

0,32

0,46

1,25

0,44

0,52

0,29

1,29

0,35

0,35

0,78

0,43

0,47

0,38

Ingresos

2,10

1,10

0,90

1,60

6,20

2,30

1,80

1,00

8,90

2,40

1,20

4,70

3,50

2,90

1,40

Tamaño

3

4

5

4

4

3

6

5

3

2

4

3

2

3

4

Solución: En forma matricial: Y = X β + U , βˆ = [X' X ] −1 X' Y , donde X' matriz transpuesta

⎛ 0,43 ⎞

⎛ 1 2,1 3 ⎞

⎜

⎟

⎜

⎟

⎜ 0,31 ⎟

⎜ 1 1,1 4 ⎟

⎜ 0,32 ⎟

⎜ 1 0,9 5 ⎟

⎜

⎟

⎜

⎟

⎜ 0,46 ⎟

⎜ 1 1,6 4 ⎟

⎜ 1,25 ⎟

⎜ 1 6,2 4 ⎟

⎜

⎟

⎜

⎟

⎜ 0,44 ⎟

⎜ 1 2,3 3 ⎟

⎜

⎟

⎜

⎟

⎜ 0,52 ⎟

⎜ 1 1,8 6 ⎟

Y = ⎜ 0,29 ⎟ = X β + U = ⎜ 1 1 5 ⎟

⎜

⎟

⎜

⎟

⎜ 1,29 ⎟

⎜ 1 8,9 3 ⎟

⎜ 0,35 ⎟

⎜ 1 2,4 2 ⎟

⎜

⎟

⎜

⎟

⎜ 0,35 ⎟

⎜ 1 1,2 4 ⎟

⎜ 0,78 ⎟

⎜ 1 4,7 3 ⎟

⎜

⎟

⎜

⎟

⎜ 0,43 ⎟

⎜ 1 3,5 2 ⎟

⎜

⎟

⎜

⎟

⎜ 0,47 ⎟

⎜ 1 2,9 3 ⎟

⎜ 0,38 ⎟

⎜ 1 1,4 4 ⎟

⎝

⎠

⎝

⎠

⎛ β0 ⎞ ⎛ u1 ⎞

⎜ ⎟ ⎜ ⎟

⎜ β1 ⎟ + ⎜ u2 ⎟

⎜ β ⎟ ⎜u ⎟

⎝ 2⎠ ⎝ 3⎠

Aplicando el criterio de los mínimos cuadrados ordinarios MCO, la función que mejor se ajusta a los

datos es la que minimiza la varianza del error U, lo que conlleva a un sistema de ecuaciones

normales:

Santiago de la Fuente Fernández

10

Regresión Lineal Múltiple

⎧ 15 Y = Nβ + β 15 X + β 15 X

i

0

1 ∑ 1i

2 ∑ 2i

⎪∑

i=1

i=1

i=1

⎪ 15

15

15

15

⎪

ecuaciones normales MCO ⎨ ∑ X1i Yi = β0 ∑ X1i + β1 ∑ X12i + β2 ∑ X1i X2i

i=1

i=1

i=1

⎪ i=1

15

15

15

15

⎪

2

X

Y

=

β

X

+

β

X

X

+

β

∑

∑

∑

∑

⎪⎩ i=1 2i i 0 i=1 2i 1 i=1 1i 2i 2 i=1 X2i

Con estos datos, se obtiene:

Yi

X1i

X2i

0,43

0,31

0,32

0,46

1,25

0,44

0,52

0,29

1,29

0,35

0,35

0,78

0,43

0,47

0,38

2,1

1,1

0,9

1,6

6,2

2,3

1,8

1

8,9

2,4

1,2

4,7

3,5

2,9

1,4

3

4

5

4

4

3

6

5

3

2

4

3

2

3

4

X12i

4,41

1,21

0,81

2,56

38,44

5,29

3,24

1

79,21

5,76

1,44

22,09

12,25

8,41

1,96

X22i

9

16

25

16

16

9

36

25

9

4

16

9

4

9

16

X1i X2i

X1i Yi

X2i Yi

6,3

4,4

4,5

6,4

24,8

6,9

10,8

5

26,7

4,8

4,8

14,1

7

8,7

5,6

0,903

0,341

0,288

0,736

7,750

1,012

0,936

0,29

11,481

0,84

0,42

3,666

1,505

1,363

0,532

1,29

1,24

1,6

1,84

5

1,32

3,12

1,45

3,87

0,7

1,4

2,34

0,86

1,41

1,52

15

15

15

15

15

15

15

15

i =1

i=1

i=1

i=1

i =1

i =1

i =1

i =1

∑ Yi = 8,07 ∑ X1i = 42 ∑ X2i = 55 ∑ X12i = 188,08 ∑ X22i = 219 ∑ X1i X2i = 140,8 ∑ X1i Yi = 32,063 ∑ X2i Yi = 28,96

⎫

⎪

i=1

i=1

i=1

15β0 + 42 β1 + 55β2 = 8,07 ⎫

⎪

15

15

15

15

⎪

⎪

2

con lo cual, ∑ X1i Yi = β0 ∑ X1i + β1 ∑ X1i + β2 ∑ X1i X2i ⎬ ⇒ 42 β0 + 188,08 β1 + 140,08 β2 = 32,063 ⎬

i=1

i=1

i=1

i=1

⎪

55β0 + 140,08 β1 + 219 β2 = 28,96 ⎪⎭

15

15

15

15

2 ⎪

∑ X2i Yi = β0 ∑ X2i + β1 ∑ X1i X2i + β2 ∑ X2i ⎪

i=1

i=1

i=1

i=1

⎭

15

15

15

∑ Yi = Nβ0 + β1 ∑ X1i + β2 ∑ X2i

en forma matricial,

X 'X

6444

47

4444

8

⎛ 15 42 55 ⎞

⎜

⎟

⎜ 42 188,08 140,8 ⎟

⎜ 55 140,8 219 ⎟

⎝

⎠

[X 'X ]

644444

7444448

⎛ βˆ 0 ⎞

−

1,36

0,092

− 0,282 ⎞

⎛

⎜ ⎟

⎜

⎟

⇒ ⎜ βˆ 1 ⎟ = ⎜ − 0,092 0,016 0,013 ⎟

⎜ ⎟

⎜ − 0,282 0,013 0,067 ⎟

⎜ βˆ 2 ⎟

⎝

⎠

⎝ ⎠

−1

⎛ β0 ⎞

⎛ 8,07 ⎞

⎜ ⎟

⎜

⎟

⎜ β1 ⎟ = ⎜ 32,063 ⎟

⎜β ⎟

⎜ 28,96 ⎟

⎝ 2⎠

⎝

⎠

X 'Y

647

4

8

⎛ 8,07 ⎞

⎜

⎟

⎜ 32,063 ⎟

⎜ 28,96 ⎟

⎝

⎠

⎛ βˆ 0 ⎞

⎛ − 0,16 ⎞

⎜ ⎟

⎜

⎟

⎜ βˆ 1 ⎟ = ⎜ 0,149 ⎟ ⇒ Y = − 0,16 + 0,149 X1 + 0,077 X2 + Re siduo (Modelo regresión lineal)

⎜ ⎟

⎜ 0,077 ⎟

⎜ βˆ 2 ⎟

⎝

⎠

⎝ ⎠

Santiago de la Fuente Fernández

11

Regresión Lineal Múltiple

A partir de la ecuación Ŷi = βˆ 0 + βˆ 1 X1i + βˆ 2 X2i se obtienen las predicciones y residuos asociados

ui = Yi − Ŷi a las observaciones muestrales. De este modo, para la primera observación

( Y1 = 0,43 ; X11 = 2,1 ; X21 = 3 ), se tiene:

⎧ Y = − 0,16 + 0,149 (2,1) + 0,077 (3) = 0,3839

⎨

⎩ u1 = Y1 − Ŷ1 = 0,43 − 0,3839 = 0,0461

En esta línea, considerando todos los puntos muestrales, se obtiene:

Predicciones: Ŷi

0,3839

0,3119

0,3591

0,3864

1,0718

0,4137

0,5702

0,374

1,3971

0,3516

0,3268

0,7713

0,5155

0,5031

0,3566

Residuos: ui = Yi − Ŷi

0,046

‐0,002

‐0,039

0,074

0,178

0,026

‐0,050

‐0,084

‐0,107

‐0,002

0,023

0,009

‐0,086

‐0,033

0,023

u2i = (Yi − Ŷi ) 2

0,0021

0,0000

0,0015

0,0054

0,0318

0,0007

0,0025

0,0071

0,0115

0,0000

0,0005

0,0001

0,0073

0,0011

0,0005

de donde, la suma de

cuadrados RESIDUAL, es

decir, la variabilidad de Y

respecto a la recta ajustada

será:

15

SCR = ∑ (Y1 − Ŷ1 ) 2 = 0,0721

i=1

SR2 =

SCR

0,0721

=

= 0,006

15 − 2 − 1

12

SR =

0,006 = 0,0775

15

∑ (Y1 − Ŷ1 ) 2 = 0,0721

i=1

INTERVALOS DE CONFIANZA PARAMÉTROS DEL MODELO (1 − α) = 0,90

•

Intervalo de confianza para la varianza

n − k − 1 = 15 − 2 − 1 = 12 SR2 = 0,006 SR2 = 0,0721 χ20,05, 12 = 21,026 χ 20 ,95, 12 = 5,226

⎛

⎞ ⎛

⎞

⎜ (n − k − 1) SR2 (n − k − 1) SR2 ⎟ ⎜ SCR

⎟ ⎡ 0,0721 0,0721 ⎤

SCR

IC = ⎜ 2

; 2

; 2

;

=⎜ 2

⎟

⎟=⎢

⎥ = [0,0034 ; 0,0138 ]

χ α

χ

χ α

σ2 ⎜ χ α

⎣ 21,026 5,226 ⎦

, (n−k−1)

1− , (n−k−1) ⎟ ⎜ α , (n−k−1)

1 − , (n−k−1) ⎟

2

2

⎝ 2

⎠ ⎝ 2

⎠

0,0034 ≤ σ2 ≤ 0,0138

(

)

) La varianza de los estimadores del modelo βˆ ∈ N β, σ2 [X' X ] −1 :

q i +1, i +1 ≡ elemento de [X'X ] −1

Var ( βˆ i ) = σ2 [X' X ]−1 ≈ SR2 [X' X ]−1 = (0,006)

Santiago de la Fuente Fernández

644474448

⎛ 1,36 ⎞

⎜

⎟

⎜ 0,016 ⎟

⎜ 0,067 ⎟⎠

⎝

SR2 q i +1, i +1

644444744444

8

⎛ 0,00816 ⎞

⎜

⎟

0,000096 ⎟

=⎜

⎜ 0,0004 ⎟⎠

⎝

12

Regresión Lineal Múltiple

⎧ Var(β0 ) = 0,00816 ⇒ σβ = 0,00816 = 0,0903

0

⎪⎪

de donde se deduce, ⎨ Var(β1 ) = 0,000096 ⇒ σβ1 = 0,000096 = 0,0098

⎪ Var(β ) = 0,0004 ⇒ σ = 0,0004 = 0,02

2

⎪⎩

β1

•

[

Intervalo de confianza para los parámetros: IC1−α (βi ) = βˆ i ± t α / 2 , (n−k−1) SR

βˆ 0 = − 0,160

βˆ 2 = 0,077

βˆ 1 = 0,149

[

q i +1, i +1

]

t0 ,05 , 12 = 1,782

]

0,00816 = [ − 0,321 ; 0,001 ]

IC1−α ( β0 ) = − 0,160 ± (1,782)

[

]

IC1−α (β1 ) = 0,149 ± (1,782) 0,000096 = [ 0,1315 ; 0,1665 ] (Ingreso)

[

IC1−α ( β2 ) = 0,077 ± (1,782)

•

]

0,0004 = [ 0,0414 ; 0,1126 ] (Tamaño)

Contraste de Hipótesis individual para X 2 (tamaño familiar)

Nos planteamos si la variable X 2 (tamaño) influye sobre la variable de respuesta Y (gastos). En

otras palabras, si el valor del parámetro en la población es cero o no.

Para ello, se establece la hipótesis nula H0 : β2 = 0 frente a la hipótesis alternativa H1: β2 ≠ 0 .

βˆ − β

βˆ 2

El estadístico observado t = 2 2 , bajo la hipótesis nula resulta: t =

SR q33

SR q33

Por tanto,

βˆ 2 = 0,077

SR q33 = (0,0775) 0,0004 = 0,00155

El estadístico experimental t =

t0 ,05 , 12 = 1,782

βˆ 2

0,077

=

= 49,67

SR q33 0,00155

Siendo t > t 0 ,05 , 12 se rechaza la hipótesis nula, afirmando, con un 90% de fiabilidad, que el

número de miembros de la familia influye en los gastos de alimentación.

* Obsérvese que en el Intervalo de Confianza para β2 : IC1−α (β2 ) = [ 0,0414 ; 0,1126 ] el cero no

se encuentra en el intervalo, con lo que se rechaza la hipótesis nula H0 : β2 = 0 , concluyendo que

el número de miembros de la familia (tamaño) si influye en los gastos de alimentación (Y).

Santiago de la Fuente Fernández

13

Regresión Lineal Múltiple

MODELO LINEAL DE REGRESIÓN MÚLTIPLE: HERRAMIENTAS DE SOFTWARE

•

EXCEL Y LA REGRESIÓN MÚLTIPLE

Se puede utilizar el análisis de la regresión lineal múltiple para estimar el gasto de familias en

alimentación (Y) basándose en las variables X1='Ingresos mensuales' y X2='número de miembros de

la familia'.

Excel dispone de análisis de Regresión para

ajustar el modelo de regresión múltiple,

simultáneamente proporciona las

estimaciones de los parámetros, la

contrastación individual, y el análisis de los

residuos.

En el menú Herramientas, tenemos el

diálogo Análisis de datos, donde elegimos

Regresión, obteniéndose un cuadro de

diálogo que permite realizar un ajuste para

la regresión múltiple.

Los Campos de Entrada tienen las funcionalidades:

Rango Y de entrada: Introducir la referencia

correspondiente al rango de datos dependientes. El rango

debe estar formado por una única columna.

Rango X de entrada: Introducir la referencia

correspondiente al rango de datos independientes. Excel

ordenará las variables independientes de este rango en

orden ascendente de izquierda a derecha. El número

máximo de variables independientes es 16.

Santiago de la Fuente Fernández

14

Regresión Lineal Múltiple

Rótulos: Activar esta casilla cuando la primera fila o la primera columna del rango (o rangos) de entrada

tienen rótulos. No activar en el caso de que el rango de entrada carezca de rótulos. Excel genera los

rótulos de datos correspondientes para la tabla de resultados.

Nivel de confianza: Activar esta para incluir más niveles de confianza en la tabla de resúmenes de

resultados. Introducir el nivel de confianza a aplicar además del nivel predeterminado del 95%.

Constante igual a cero: Activar esta casilla para que la línea de regresión pase por el origen.

Rango de salida: Introducir la referencia correspondiente a la celda superior izquierda de la tabla de

resultados. Dejar por lo menos siete columnas disponibles para la tabla de resultados sumarios, donde

aparecen: tabla de análisis, número observaciones, coeficientes, error típico del pronóstico Y, valores de

R2 y error típico de coeficientes.

En una hoja nueva: Hacer clic en esta opción para insertar una hoja nueva en el libro actual y pegar los

resultados, comenzando por la celda A1 de la nueva hoja de cálculo. Para dar un nombre a la nueva hoja

de cálculo, anotarlo en el cuadro.

En un libro nuevo: Hacer clic para crear un nuevo libro y pegar los resultados en una hoja nueva del libro

creado. Si desea incorporar la opción gráfica tiene que teclear esta opción.

Residuos: Activar esta casilla para incluir los residuos en la tabla de resultados.

Residuos estándares: Activar esta casilla para incluir residuos estándares en la tabla de resultados de

residuos.

Gráficos de residuos: Si activa esta casilla se genera un gráfico por cada variable independiente frente al

residuo.

Curva de regresión ajustada: Si activa esta casilla se genera un gráfico con los valores pronosticados

frente a los valores observados.

Trazado de probabilidad normal: Activando esta casilla se genera un gráfico con probabilidad normal.

Finalmente, con las opciones activadas en la figura anterior, en la tabla de resultados aparecen los

estadísticos de regresión, cuadro de análisis de la varianza del modelo, estimadores, contrastes de

significación de F‐Snedecor y de t‐Student con sus p‐valores asociados, intervalos de confianza para

los parámetros y para las predicciones al 90% y 95%, y residuos.

Santiago de la Fuente Fernández

15

Regresión Lineal Múltiple

La siguiente figura presenta el gráfico de cada variable independiente (X1, X2) contra los residuos, lo

que se utiliza para detectar el problema de no linealidad, heteroscedasticidad, y autocorrelación en

el modelo del ajuste.

Lo mejor es que todas las gráficas presenten una estructura aleatoria de puntos.

La figura adjunta presenta el gráfico para

detectar la hipótesis de normalidad en el

modelo.

La gráfica ideal es la diagonal del primer

cuadrante.

Santiago de la Fuente Fernández

16

Regresión Lineal Múltiple

Las siguientes gráficas visualizan cada variable independiente contra los valores predichos, lo que

sirve para detectar problemas de heteroscedasticidad.

Lo ideal es que todas las gráficas presenten una estructura aleatoria de puntos.

SPSS Y LA REGRESIÓN MÚLTIPLE _______________________________________________________

Con datos introducidos en SPSS, intentamos ajustar un modelo mediante Mínimos Cuadrados

Ordinarios (MCO).

Para ello, se elige en el Menú Analizar / Regresión / Lineal, como se indica en la figura adjunta.

En el cuadro de la Regresión lineal se introduce la variable dependiente (Y) y las variables

independientes ingresos (X1) y tamaño familiar (X2). En el botón [Opciones]:

Santiago de la Fuente Fernández

17

Regresión Lineal Múltiple

En las opciones [Estadísticos y Gráficos], se procede como aparece en las selecciones adjuntas.

En el botón [Gráficos] se selecciona residuos contra valores predichos. Al pulsar Aceptar se obtiene

el ajuste del modelo.

En el Visor de SPPS, el ajuste del Modelo:

Respecto a la autocorrelación, el estadístico de Durbin‐Watson de 1,177 no deja claro la presencia o

n

no de autocorrelación: DW =

∑ (ui − u i−1 ) 2

i =2

n

∑ u2i

i =1

⎧DW ≈ 2 si ρ = 0

⎪

≈ 2(1 − ρ) ⇒ ⎨DW ≈ 0 si ρ = 1

⎪DW ≈ 4 si ρ = − 1

⎩

El análisis de la varianza indica que el modelo de regresión es significativo (p‐valor aproximadamente

cero, F2, 12=113,141, p‐valor < 0,001). Por tanto, se rechaza la hipótesis nula de que la variabilidad

observada en la variable respuesta sea explicada por el azar, admitiendo que hay algún tipo de

asociación entre la variable dependiente y las independientes.

Santiago de la Fuente Fernández

18

Regresión Lineal Múltiple

El Modelo estimado sería: Y = − 0,16 + 0,149 X 1 + 0,077 X 2

En la figura del histograma de los

residuos se observa que se ajusta bien

a una distribución normal.

En la figura se presenta el gráfico de normalidad que

se ajusta muy bien a la diagonal del primer cuadrante.

En el gráfico de residuos tipificados contra

valores predichos existen dudas sobre la

aleatoriedad porque los puntos se

concentran siguiendo rectas paralelas, lo

que permite vislumbrar problemas de

heteroscedasticidad.

Santiago de la Fuente Fernández

19

Regresión Lineal Múltiple

ANÁLISIS DE LA VARIANZA: TABLA ANOVA

n

∑ ( Yi − Y ) 2

Descomposición de la variabilidad:

i=1

1

4243

SCT

suma cuadrados total

(n−1) grados libertad

Variación

Suma de Cuadrados

SCE = ∑ ( Ŷi − Y ) 2 = 1,3595

Residual

SCR = ∑ ( Yi − Ŷ i) 2 = 0,0721

Total

SCT = ∑ ( Yi − Y ) 2 = 1,4316

suma cuadrados explicada

k grados libertad

SCE

= 0,6797

2

15 ‐ 2 ‐ 1

SCR

= 0,006

15 − 2 − 1

15 ‐ 1

SCT

= 0,1023

15 − 1

15

15

i=1

i=1

1

4243

SCE

2

i=1

i=1

n

∑ ( Ŷi − Y ) 2

+

i=1

1

4243

SCR

suma cuadrados residual

(n−k−1) grados libertad

Gr. libertad Media cuadrática

15

Explicada

n

∑ ( Yi − Ŷ i) 2

=

F‐Snedecor

F=

SCE / 2

= 113,28

SCR /(15 − 2 − 1)

Cálculos

Yi

(Yi − Y) 2

Ŷi

u2i = (Yi − Ŷi ) 2

(Ŷi − Y) 2

0,43

0,31

0,32

0,46

1,25

0,44

0,52

0,29

1,29

0,35

0,35

0,78

0,43

0,47

0,38

0,011664

0,051984

0,047524

0,006084

0,506944

0,009604

0,000324

0,061504

0,565504

0,035344

0,035344

0,058564

0,011664

0,004624

0,024964

0,3839

0,3119

0,3591

0,3864

1,0718

0,4137

0,5702

0,374

1,3971

0,3516

0,3268

0,7713

0,5155

0,5031

0,3566

0,0021

0,0000

0,0015

0,0054

0,0318

0,0007

0,0025

0,0071

0,0115

0,0000

0,0005

0,0001

0,0073

0,0011

0,0005

0,0237

0,0511

0,0320

0,0230

0,2849

0,0155

0,0010

0,0269

0,7381

0,0347

0,0446

0,0544

0,0005

0,0012

0,0329

∑ Yi = 8,07

SCT = ∑ (Yi − Y) 2 = 1,4316

SCR = ∑ (Yi − Ŷi ) 2 = 0,0721

SCE = ∑ (Ŷi − Y) 2 = 1,3646

15

i =1

15

i=1

15

i=1

15

i =1

A un nivel de confianza (1 − α) se rechaza la hipótesis nula, H0 : β1 = β2 = 0 (el modelo no es

explicativo), cuando Fk , (n−k−1) ≥ Fα ; k , (n−k−1)

F2 , 12 =

SCE / 2

= 113,28 > 3,8853 = F0 ,05; 2 , 12

SCR /(15 − 2 − 1)

Así, pues, se rechaza la hipótesis nula, el contraste conjunto de la F‐Snedecor indica claramente la

influencia del modelo en la variable respuesta.

Santiago de la Fuente Fernández

20

Regresión Lineal Múltiple

Cálculo de los coeficientes de correlación (múltiple y simple)

Estimado el modelo es conveniente obtener una medida acerca de la bondad del ajuste realizado.

Un estadístico que facilita esta medida es el Coeficiente de Determinación ( R2 ), que se define:

n

R2 =

( Yi − Ŷ i) 2

SCE ∑

1,3595

i=1

SCT

=

n

∑ ( Yi − Y )

=

2

1,4316

= 0,9496

i=1

Coeficiente de Correlación múltiple: R = 0,9496 = 0,9745

Coeficiente de Determinación corregido

por el número de grados de libertad

R2 = 1 −

SCR n − k − 1

0,006

=1−

= 0,9413

SCT n − 1

0,1023

Coeficiente de Correlación múltiple corregido: R = 0,9413 = 0,9702

Coeficiente de correlación simple entre las

variables (Gasto, Ingreso):

ρ(Gasto, Ingreso) =

Cov(Gasto, Ingreso)

= 0,9424

σGasto σIngreso

También se puede calcular el coeficiente de determinación de la regresión (Gasto, Ingreso). La tabla

ANOVA del modelo será:

SCE 1,272

=

= 0,8882

SCT 1,432

ρ(Gasto, Ingreso) = R = 0,8882 = 0,9424

R2 =

Análogamente, ρ(Gasto, Tamaño) =

Cov(Gasto, Tamaño)

= − 0,126

σGasto σTamaño

Coeficientes de Correlación parcial:

Coeficiente de correlación simple entre (Gasto, Ingreso): ρ(Gasto, Ingreso) = 0,942

Santiago de la Fuente Fernández

21

Regresión Lineal Múltiple

Coeficiente correlación parcial entre variables (Gasto, Ingreso): ρ(Gasto, Ingreso; Tamaño) = 0,974

mediante la expresión: tingreso =

βˆ 1

2

R

S . q i +1, 1 +1

=

0,149

= 15,05

0,000096

t2ingreso

15,052

El coeficiente de determinación, R (Gasto,Ingreso; Tamaño) = 2

=

= 0,9496

tingreso + n − (k + 1) 15,052 + 12

2

Coeficiente de correlación. Este coeficiente mide la relación entre las variables Gasto e Ingreso libres

de la influencia de la variable Tamaño.

Análogamente, el Coeficiente correlación parcial ente las variables (Gasto, Tamaño):

ρ(Gasto, Tamaño; Ingreso) = 0,741

Estimación de la media condicionada

Supongamos que se trata de estimar el gasto medio de una familia con unos ingresos de treinta mil

euros (X1 = 3) con cuatro miembros familiares (X2 = 4)

Aplicando el modelo de regresión: Ŷ0 = −0,160 + 0,149 (3) + 0,077(4) = 0,595

⎡

⎢

IC E(Y0 ) = ⎢Ŷ0 ± t α / 2 , (n−k−1) SR

⎢

⎣

(1 X 1

⎡

⎢

IC E(Y0 ) = ⎢(0,595) ± (1,782) (0,075)

⎢

⎢⎣

SR =

⎛1⎞

⎜ ⎟

X2 ) (X' X) −1 ⎜ X1 ⎟

⎜X ⎟

⎝ 2⎠

⎤

⎥

⎥

⎥

⎦

⎛ 1,36 − 0,092 − 0,282 ⎞

⎟

⎜

(1 3 4) ⎜ − 0,092 0,016 0,013 ⎟

⎜ − 0,282 0,013 0,067 ⎟

⎠

⎝

−1

⎛1⎞

⎜ ⎟

⎜ 3⎟

⎜4⎟

⎝ ⎠

⎤

⎥

⎥ = [0,557 ; 0,633]

⎥

⎥⎦

0,006 = 0,0775 t0 ,05; 12 = 1,782 1 − α = 0,90

⎛ 15 42 55 ⎞

⎜

⎟

X' X = ⎜ 42 188,08 140,8 ⎟ ⇒

⎜ 55 140,8 219 ⎟

⎝

⎠

[X' X]

−1

⎛ 1,36 − 0,092 − 0,282 ⎞

⎜

⎟

= ⎜ − 0,092 0,016 0,013 ⎟

⎜ − 0,282 0,013 0,067 ⎟

⎝

⎠

⎛ 1,36 − 0,092 − 0,282 ⎞ ⎛ 1 ⎞

⎛1⎞

⎜

⎟⎜ ⎟

⎜ ⎟

(1 3 4) ⎜ − 0,092 0,016 0,013 ⎟ ⎜ 3 ⎟ = (− 0,044 0,008 0,025) ⎜ 3 ⎟ = 0,08

⎜ − 0,282 0,013 0,067 ⎟ ⎜ 4 ⎟

⎜4⎟

⎝

⎠⎝ ⎠

⎝ ⎠

Santiago de la Fuente Fernández

22

Regresión Lineal Múltiple

Ejercicio 2.‐ Partiendo de la información:

(a)

(b)

(c)

(d)

yj

x1 j

x2 j

1

3

4

6

7

10

15

16

18

20

2

1

3

4

5

8

7

9

11

12

17

15

13

10

9

8

6

5

3

4

Estimar el modelo de regresión

Obtener una medida de fiabilidad del ajuste lineal

¿Qué parte de la variabilidad de Y queda explicada a través del plano de regresión?

Calcular los coeficientes de correlación lineal simple

(a) En forma matricial: Y = X β + U , βˆ = [X' X ] −1 X' Y , donde X’ matriz transpuesta

⎛ 1 ⎞

⎛ 1 2 17 ⎞

⎜ ⎟

⎜

⎟

⎜ 3 ⎟

⎜ 1 1 15 ⎟

⎜ 4 ⎟

⎜ 1 3 13 ⎟

⎜ ⎟

⎜

⎟

⎜ 6 ⎟

⎜ 1 4 10 ⎟

⎜ 7 ⎟

⎜ 1 5 9 ⎟

⎜

⎟

⎟

= Xβ + U = ⎜

Y=

⎜ 10 ⎟

⎜ 1 8 8 ⎟

⎜ ⎟

⎜

⎟

⎜ 15 ⎟

⎜ 1 7 6 ⎟

⎜ 16 ⎟

⎜ 1 9 5 ⎟

⎜ ⎟

⎜

⎟

⎜ 18 ⎟

⎜ 1 11 3 ⎟

⎜ 20 ⎟

⎜ 1 12 4 ⎟

⎝ ⎠

⎝

⎠

⎛ β0 ⎞ ⎛ u1 ⎞

⎜ ⎟ ⎜ ⎟

⎜ β1 ⎟ + ⎜ u2 ⎟

⎜ β ⎟ ⎜u ⎟

⎝ 2⎠ ⎝ 3⎠

[ ] −1 X' Y

Los coeficientes β estimados bajo la condición mínimo cuadrática, vienen dados por: β = X' X

⎡ 1 1 1 1 1 1 1 1 1 1⎤

[X' X] = ⎢⎢ 2 1 3 4 5 8 7 9 11 12⎥⎥

⎢⎣17 15 13 10 9 8 6 5 3 4 ⎥⎦

Santiago de la Fuente Fernández

⎡1 2

⎢1 1

⎢

⎢1 3

⎢

⎢1 4

⎢1 5

⎢

⎢1 8

⎢1 7

⎢

⎢1 9

⎢1 11

⎢

⎢⎣1 12

17⎤

15⎥

⎥

13⎥

⎥

10⎥

90 ⎤

⎡10 62

9⎥ ⎢

⎥

⎥ = ⎢62 514 405 ⎥ ⇒ X' X = 30294 ≠ 0

8⎥

⎢90 405 1014⎥⎦

6⎥ ⎣

⎥

5⎥

3⎥

⎥

4 ⎥⎦

23

Regresión Lineal Múltiple

Adviértase que cuando la matriz es singular, es decir, cuando X' X = 0 , no existe matriz inversa y,

En consecuencia, las estimaciones de los coeficientes β quedan indeterminadas.

Esto ocurre porque existe multicolinealidad entre X1 y X2 , esto es, que existe una relación lineal

entre estas variables. Para ello se calcula la regresión de X1 sobre X2 y su correspondiente

coeficiente de correlación lineal será 1.

90 ⎤

90 ⎤ ⎡ 357171 − 26418 − 21150⎤

⎡10 62

⎡10 62

⎢

⎥

⎢

[X' X] = ⎢62 514 405 ⎥ ⇒ Adj [X' X] = Adj ⎢62 514 405 ⎥⎥ = ⎢⎢− 26418 2040

1530⎥⎥

⎢⎣90 405 1014⎥⎦

⎢⎣90 405 1014⎥⎦ ⎢⎣− 21150

1530

1296⎥⎦

[X' X]

−1

90 ⎤

⎡10 62

1

⎢

= ⎢62 514 405 ⎥⎥ =

30294

⎢⎣90 405 1014⎥⎦

⎡ 357171 − 26418 − 21150⎤ ⎡ 11,7902

⎢− 26418

2040

1530⎥⎥ = ⎢⎢ − 0,8721

⎢

⎢⎣− 21150

1530

1296⎥⎦ ⎢⎣− 0,6982

⎡ 1 1 1 1 1 1 1 1 1 1⎤

De otra parte, [X' Y ] = ⎢ 2 1 3 4 5 8 7 9 11 12⎥

⎢

⎥

⎢⎣17 15 13 10 9 8 6 5 3 4 ⎥⎦

⎡β0 ⎤

1

β = ⎢⎢β1 ⎥⎥ = [X' X ] −1 X' Y =

30294

⎢⎣β2 ⎥⎦

− 0,8721

0,0673

0,0505

− 0,6982 ⎤

0,0505⎥⎥

0,0428⎥⎦

⎡ 1⎤

⎢ 3⎥

⎢ ⎥

⎢ 4⎥

⎢ ⎥

⎢ 6 ⎥ ⎡100⎤

⎢ 7⎥ ⎢ ⎥

⎢ ⎥ = ⎢843⎥

⎢10⎥ ⎢621⎥

⎢15⎥ ⎣ ⎦

⎢ ⎥

⎢16⎥

⎢18⎥

⎢ ⎥

⎣⎢20⎦⎥

⎡ 357171 − 26418 − 21150⎤ ⎡100⎤ ⎡ 10,32⎤

⎢− 26418

2040

1530⎥⎥ ⎢⎢843⎥⎥ = ⎢⎢ 0,93 ⎥⎥

⎢

⎢⎣− 21150

1530

1296⎥⎦ ⎢⎣621⎥⎦ ⎢⎣− 0,67⎥⎦

El modelo de regresión será: y = 10,32 + 0,93 x1 − 0,67 x 2

También se podía haber realizado teniendo en cuenta las ecuaciones normales mínimo

cuadráticas:

⎧ 10 Y = Nβ + β 10 X + β 10 X

i

0

1 ∑ 1i

2 ∑ 2i

⎪∑

i=1

i=1

i=1

⎪ 10

10

10

10

⎪

ecuaciones normales MCO ⎨ ∑ X1i Yi = β0 ∑ X1i + β1 ∑ X12i + β2 ∑ X1i X2i

i=1

i=1

i=1

⎪ i=1

10

10

10

10

⎪

2

X

Y

X

X

X

=

β

+

β

+

β

∑

∑

∑

∑

⎪⎩ i=1 2i i 0 i=1 2i 1 i=1 1i 2i 2 i=1 X2i

Con estos datos, se obtiene:

Santiago de la Fuente Fernández

24

Regresión Lineal Múltiple

Tabla I

Yi

X1i

X2i

Yi2

X12i

1

3

4

6

7

10

15

16

18

20

2

1

3

4

5

8

7

9

11

12

17

15

13

10

9

8

6

5

3

4

1

9

16

36

49

100

225

256

324

400

100

62

90

1416

X1i X2i

X1i Yi

X2i Yi

4

1

9

16

25

64

49

81

121

144

X22i

289

225

169

100

81

64

36

25

9

16

34

15

39

40

45

64

42

45

33

48

2

3

12

24

35

80

105

144

198

240

17

45

52

60

63

80

90

80

54

80

514

1014

405

843

621

⎫

⎪

10 β0 + 62 β1 + 90 β2 = 100 ⎫

⎪

10

10

10

10

⎪

⎪

con lo cual, ∑ X1i Yi = β0 ∑ X1i + β1 ∑ X12i + β2 ∑ X1i X2i ⎬ ⇒ 62 β0 + 514 β1 + 405 β2 = 843 ⎬

i=1

i=1

i=1

i=1

⎪

90 β0 + 405 β1 + 1014 β2 = 621 ⎪⎭

10

10

10

10

2 ⎪

∑ X2i Yi = β0 ∑ X2i + β1 ∑ X1i X2i + β2 ∑ X2i ⎪

i=1

i=1

i=1

i=1

⎭

10

10

10

i=1

i=1

i=1

∑ Yi = Nβ0 + β1 ∑ X1i + β2 ∑ X2i

en forma matricial,

X 'X

64447

444

8

⎛ 10 62 90 ⎞

⎜

⎟

⎜ 62 514 405 ⎟

⎜ 90 405 1014 ⎟

⎝

⎠

[X 'X ]

6444444

4

74444444

8

ˆ

⎛ β0 ⎞

⎡ 357171 − 26418 − 21150⎤

⎜ ⎟

1 ⎢

ˆ

⎜

⎟

⇒ β1 =

− 26418

2040

1530⎥⎥

⎢

⎜ ⎟

30294

1530

1296⎦⎥

⎜ βˆ 2 ⎟

⎣⎢− 21150

⎝ ⎠

−1

⎛ β0 ⎞

⎛ 100 ⎞

⎜ ⎟

⎜

⎟

⎜ β1 ⎟ = ⎜ 843 ⎟

⎜β ⎟

⎜ 621 ⎟

⎝ 2⎠

⎝

⎠

X 'Y

67

8

⎛ 100 ⎞

⎜

⎟

⎜ 843 ⎟

⎜ 621 ⎟

⎝

⎠

⎛ βˆ 0 ⎞

⎡ 10,32⎤

⎜ ⎟

⎜ βˆ ⎟ = ⎢ 0,93 ⎥ ⇒ Y = 10,32 + 0,93 X − 0,67 X + Re siduo (Modelo regresión lineal)

1

2

⎢

⎥

⎜ 1⎟

ˆ

⎢

⎥

⎜ β2 ⎟

⎣− 0,67⎦

⎝ ⎠

(b) La fiabilidad del ajuste se refleja mediante R2 coeficiente de determinación lineal:

A partir de la ecuación Ŷi = βˆ 0 + βˆ 1 X1i + βˆ 2 X2i se obtienen las predicciones y residuos asociados

ui = Yi − Ŷi a las observaciones muestrales.

De este modo, para la primera observación ( Y1 = 1 ; X11 = 2 ; X21 = 17 ), se tiene:

⎧Ŷ1 = 10,32 + 0,93 (2) − 0,67 (17) = 0,79

⎨

⎩ u1 = Y1 − Ŷ1 = 1 − 0,79 = 0,21

En esta línea, considerando todos los puntos muestrales, se obtiene:

Santiago de la Fuente Fernández

25

Regresión Lineal Múltiple

Yi

Ŷi

ui = Yi − Ŷi

(Yi − Y) 2

u2i = (Yi − Ŷi ) 2

(Ŷi − Y) 2

1

3

4

6

7

10

15

16

18

20

100

0,79

1,2

4,4

7,34

8,94

12,4

12,81

15,34

18,54

18,8

0,21

1,8

‐0,4

‐1,34

‐1,94

‐2,4

2,19

0,66

‐0,54

1,2

81

49

36

16

9

0

25

36

64

100

416

0,0441

3,24

0,16

1,7956

3,7636

5,76

4,7961

0,4356

0,2916

1,44

21,7266

84,8241

77,44

31,36

7,0756

1,1236

5,76

7,8961

28,5156

72,9316

77,44

394,3666

10

SCT = ∑ (Yi − Y) 2 = 416

i=1

10

SCR = ∑ (Y1 − Ŷ1 ) 2 = 21,7266

i=1

10

SCE = ∑ (Ŷi − Y) 2 = 394,3666

i=1

10

R2 =

( Yi − Ŷ i) 2

SCE ∑

394,3666

i=1

SCT

=

10

∑ ( Yi − Y ) 2

=

416

= 0,948 coeficiente de determinación lineal

i=1

Coeficiente de determinación lineal corregido por

el número de grados de libertad

R2 = 1 −

SCR n − k − 1

21,7266 / 7

=1−

= 0,933

SCT n − 1

416 / 9

(c) La parte de variabilidad contenida en Y que queda explicada por el método es precisamente

R2 = 0,948 = 94 ,8% , que es suficientemente alta.

(d) Para calcular los coeficientes de correlación lineal simple, se recurre a la tabla I, para calcular

medias, varianzas y covarianzas

10

y=

∑ yi 100

i=1

N

=

10

10

= 10

σ2y =

∑ y2i

i=1

10

x1 =

∑ x1i 62

i=1

N

=

10

x2 =

N

=

10

1416

− 102 = 41,6

10

10

= 6,2

σ2x1 =

10

∑ x2i 90

i=1

N

− y2 =

∑ x12i

i=1

N

− x12 =

514

− 6,22 = 12,96

10

− x22 =

1014 2

− 9 = 20,4

10

10

=9

σ2x2 =

∑ x22i

i=1

N

10

m1y =

∑ x 1i y i

i=1

N

− x1 y =

843

− (6,2).10 = 22,3

10

− x2 y =

621

− 9 .10 = −27,9

10

10

m2 y =

∑ x 2i y i

i=1

N

10

m12 =

∑ x 1i x 2 i

i=1

N

− x1 x2 =

405

− (6,2). 9 = −15,3

10

Santiago de la Fuente Fernández

26

Regresión Lineal Múltiple

Los coeficientes de correlación lineal simple serán:

r1y =

r2 y =

r12 =

m1y

σx 1 σ y

m2 y

σx 2 σ y

=

22,3

= 0,96

12,96 41,6

=

− 27,9

= − 0,96

20,4 41,6

− 15,3

m12

=

= − 0,94

σx 1 σx 2

12,96 20,4

Práctica en SPSS ____________________________________________________________________

En el Visor de SPSS, se reflejan los resultados:

Santiago de la Fuente Fernández

27

Regresión Lineal Múltiple

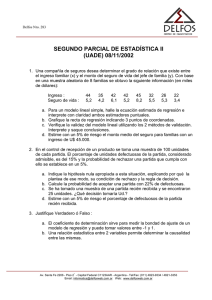

Ejercicio 3.‐ El gerente de una empresa estudia las posibles relaciones entre beneficios anuales,

gastos en publicidad anuales y horas extraordinarias anuales de los empleados. Para ello utiliza

datos, de estas tres variables, proporcionadas por algunas empresas del sector. Se desea saber:

Beneficios

(millones)

1,3

3,5

2,8

3

3,3

4

3,7

Gastos Publicidad

(millones)

0,3

1,5

0,7

1,1

1,2

2

2

Horas extras

(100 horas)

4

9

6

7,5

8

7

8

a) Matriz de varianzas–covarianzas.

b) Matriz de correlación.

c) ¿Qué porcentaje de la varianza de los beneficios explicaría una función lineal de los gastos en

publicidad?

d) ¿Qué porcentaje de la varianza de los beneficios explicaría una función lineal de las horas

extraordinarias anuales de los empleados?

e) Establecer una relación lineal que explique anualmente los beneficios mediante los gastos en

publicidad y horas extras.

f) Hallar el coeficiente de correlación múltiple. ¿Qué porcentaje de la varianza de beneficios queda

explicado por el modelo lineal obtenido en el apartado anterior?

g) Si una empresa destina 900.000 euros a publicidad y sus empleados realizan 500 horas

extraordinarias al año, ¿cuál sería la estimación de los beneficios de dicha empresa?

h) Coeficientes de correlación parcial de beneficios con gastos en publicidad y de beneficios con

horas extras de los empleados.

g) Coeficiente de correlación múltiple.

Santiago de la Fuente Fernández

28

Regresión Lineal Múltiple

⎡σ

⎢

a) La matriz de varianzas – covarianzas viene definida: VC = ⎢ Sx 1 y

⎢ Sx y

⎣ 2

2

y

Yi

X1i

X2i

Yi2

X12i

1,3

3,5

2,8

3

3,3

4

3,7

21,6

0,3

1,5

0,7

1,1

1,2

2

2

8,8

4

9

6

7,5

8

7

8

49,5

1,69

12,25

7,84

9

10,89

16

13,69

71,36

0,09

2,25

0,49

1,21

1,44

4

4

13,48

7

y=

N

= 3,0857 σ2y =

7

∑ y2i

7

x1 =

∑ x1i 8,8

i=1

=

N

7

= 1,2571 σ2x1 =

∑ x2i 49,5

i=1

=

N

7

Yi X1i

Yi X2i

X1i X2i

0,39

5,25

1,96

3,3

3,96

8

7,4

30,26

5,2

31,5

16,8

22,5

26,4

28

29,6

160

1,2

13,5

4,2

8,25

9,6

14

16

66,75

S yx 2 ⎤

⎥

Sx 1 x 2 ⎥

σ2x2 ⎥⎦

⎧S yx 1 = Sx 1 y

⎪S = S

x2y

⎨ yx 2

⎪Sx x = Sx x

2 1

⎩ 1 2

← Tabla operaciones

i=1

N

− y2 =

71,36

− 3,08572 = 0,6727

7

7

7

x2 =

σ

Sx 2 x 1

2

x1

7

∑ yi 21,6

i=1

=

X22i

16

81

36

56,25

64

49

64

366,25

S yx 1

∑ x12i

i=1

N

− x12 =

13,48

− 1,25712 = 0,3454

7

− x22 =

366,25

− 7,07142 = 2,3167

7

7

= 7,0714 σ2x2 =

∑ x22i

i=1

N

7

S yx 1 =

∑ yi x1i

i=1

N

− y x1 =

30,26

− (3,0867).(1,2571) = 0,4438

7

− y x2 =

160

− (3,0867).(7,0714) = 1,0369

7

7

S yx 2 =

∑ y i x 2i

i=1

N

7

Sx 1 x 2 =

∑ x1i x2i

i=1

N

− x1 x2 =

66,75

− (1,2571). (7,0714) = 0,6462

7

⎡0,6727 0,4438 1,0369⎤

En consecuencia, la matriz de varianzas‐covarianzas: VC = ⎢⎢0,4438 0,3454 0,6462⎥⎥

⎢⎣1,0369 0,6462 2,3167⎥⎦

b) La matriz de correlaciones de las variables explicativas Rx está formada por los coeficientes de

correlación lineal simple:

⎡1

ryx 1 ryx 2 ⎤

⎧ryx 1 = rx 1 y

⎢

⎥

⎪

Rx = ⎢ rx 1 y 1

rx 1x 2 ⎥ donde ⎨ryx 2 = rx 2 y

⎪rx x = rx x

⎢ rx y rx x

1 ⎥⎦

2 1

⎩ 1 2

2 1

⎣ 2

ryx 1 =

S yx 1

σy σx 1

=

S yx 2

0,4438

1,0369

= 0,9207 ryx 2 =

=

= 0,8306

σ y σx 2

0,6727 0,3454

0,6727 2,3167

Santiago de la Fuente Fernández

29

Regresión Lineal Múltiple

rx 1 x 2 =

Sx 1 x 2

σx 1 σx 2

=

0,6462

= 0,7224

0,3454 2,3167

0,9207 0,8306 ⎤

⎡ 1

Por tanto, la matriz de las correlaciones será: Rx = ⎢⎢0,9207

1

0,7224 ⎥⎥

⎢⎣0,8306 0,7224

1 ⎥⎦

NOTA.‐ En la regresión lineal múltiple surge el problema de que exista una correlación lineal simple

perfecta entre dos (o más variables) explicativas, ya que esto implica que una (o más) columna(s) de

la matriz X de observaciones son combinación lineal de otra(s), con lo que el rango de esta matriz X

se reduce.

En un principio el rango de [X' X ] es p (número de variables explicativas), pero si existe alguna

combinación lineal entre las columnas de X, entonces el rango es menor que p, con lo que el

determinante de X' X = 0 , lo que impide calcular la matriz inversa [X' X ] −1 , y en consecuencia el

vector de coeficientes β = [X' X ] −1 X' Y queda indeterminado.

Analizando la matriz de las correlaciones Rx se decide si existe o no multicolinealidad:

Sí Rx = 0 a Existe multicolinealidad

Sí Rx ≈ 0 a Existe cuasi‐multicolinealidad o multicolinealidad imperfecta

En caso de multicolinealidad se requiere modificar el modelo o realizar algún tipo de transformación

que la elimine.

c) Se requiere hallar el coeficiente de determinación entre (Y , X1 ) : R2yx 1 = ryx2 1 = 0,92072 = 0,8477

Es decir, el 84,77% de la varianza de los beneficios (Y) queda explicado por una función lineal del

gasto en publicidad (X1 )

d) Se requiere hallar el coeficiente de determinación entre (Y , X2 ) : R2yx 2 = ryx2 2 = 0,83062 = 0,6899

Es decir, el 68,99% de la varianza de los beneficios (Y) queda explicado por una función lineal de las

horas extras de los empleados (X2 )

e) Hay que determinar el plano de regresión de los beneficios (Y) sobre el gasto en publicidad (X1 ) y

las horas extras de los empleados (X2 )

Ŷi = βˆ 0 + βˆ 1 X1i + βˆ 2 X2i

Se tiene como referencia la matriz de las varianzas‐covarianzas:

⎡σ2y

⎢

VC = ⎢ Sx 1 y

⎢ Sx y

⎣ 2

S yx 1

σ2x1

Sx 2 x 1

Santiago de la Fuente Fernández

S yx 2 ⎤ ⎡0,6727 0,4438 1,0369⎤

⎥

Sx 1x 2 ⎥ = ⎢⎢0,4438 0,3454 0,6462⎥⎥

σ2x2 ⎥⎦ ⎢⎣1,0369 0,6462 2,3167⎥⎦

30

Regresión Lineal Múltiple

Los coeficientes (βˆ 1 , βˆ 2 ) , respectivamente, con signo negativo (−) , vienen dados por el cociente de

los adjuntos (S yx 1 , S yx 2 ) entre el adjunto de σ2y :

βˆ 1 = −

0,4438

1,0369

βˆ 1 = − (−)

0,3454

0,6462

VC yx 1

VC y

βˆ 2 = −

VC yx 2

VC y

βˆ 0 = Y − βˆ 1 X1 − βˆ 2 X2

0,6462

2,3167 0,3581

=

= 0,9360 βˆ 2 = (−)

0,6462 0,3826

2,3167

0,4438

1,0369

0,3454

0,6462

0,3454

0,6462

− 0,0714

=−

= 0,1866

0,6462

0,3826

2,3167

βˆ 0 = Y − βˆ 1 X1 − βˆ 2 X2 = 3,0857 − (0,9360)(1,2571) − (0,1866)(7,0714) = 0,5895

La ecuación del plano de regresión es: Y = 0,5895 + 0,936 X1 + 0,1866 X2

Otra forma de enfocar la situación, desde la Tabla de operaciones, mediante las ecuaciones MCO:

7

7

7

Nβ0 + β1 ∑ X1i + β2 ∑ X2i = ∑ Yi ⎫⎪

i=1

i=1

i=1

7 β0 + 8,8 β1 + 49,5 β2 = 21,6 ⎫

⎪

7

7

7

7

⎪

⎪

2

con lo cual, β0 ∑ X1i + β1 ∑ X1i + β2 ∑ X1i X2i = ∑ X1i Yi ⎬ ⇒ 8,8 β0 + 13,48 β1 + 66,75 β2 = 30,26 ⎬

i=1

i=1

i=1

i=1

⎪

49,5 β0 + 66,75 β1 + 366,25 β2 = 160 ⎪⎭

7

7

7

7

⎪

2

β0 ∑ X2i + β1 ∑ X1i X2i + β2 ∑ X2i = ∑ X2i Yi ⎪

i=1

i=1

i=1

i=1

⎭

en forma matricial,

X 'X

644447

44448

⎛ 7 8,8 49,5 ⎞

⎟

⎜

⎜ 8,8 13,48 66,75 ⎟

⎜ 49,5 66,75 366,25 ⎟

⎠

⎝

[X 'X ]

6444444

7444444

8

ˆ

⎛

⎞

β

0,6181 − 0,6085⎤

⎛ β0 ⎞ ⎛ 21,6 ⎞

⎜ 0 ⎟ ⎡ 3,6687

⎟

⎜ ⎟ ⎜

⎢

ˆ

⎜

⎟

0,8648 − 0,2412⎥⎥

⎜ β1 ⎟ = ⎜ 30,26 ⎟ ⇒ β1 = ⎢ 0,6181

⎜

⎟

⎜ β ⎟ ⎜ 160 ⎟

0,1289⎥⎦

⎜ βˆ 2 ⎟ ⎢⎣− 0,6085 − 0,2412

⎠

⎝ 2⎠ ⎝

⎝ ⎠

−1

X 'Y

6

47

4

8

⎛ 21,6 ⎞

⎟

⎜

⎜ 30,26 ⎟

⎜ 160 ⎟

⎠

⎝

⎛ βˆ 0 ⎞

⎡0,5895⎤

⎜ ⎟

⎜ βˆ ⎟ = ⎢0,9360⎥ ⇒ Y = 0,5895 + 0,936 X + 0,1866 X (Modelo regresión lineal)

1

2

⎢

⎥

⎜ 1⎟

⎢⎣0,1866⎥⎦

⎜ βˆ 2 ⎟

⎝ ⎠

Con el modelo de regresión, a partir de la ecuación, Y = 0,5895 + 0,936 X1 + 0,1866 X2 , se obtienen

las predicciones y residuos asociados ui = Yi − Ŷi a las observaciones muestrales.

De este modo, para la primera observación ( Y1 = 1,3 ; X11 = 0,3 ; X21 = 4 ), se tiene:

⎧Ŷ1 = 0,5895 + 0,936 (0,3) + 0,1866 (4) = 1,6167

⎨

⎩ u1 = Y1 − Ŷ1 = 1,3 − 1,6167 = −0,3167

Santiago de la Fuente Fernández

31

Regresión Lineal Múltiple

Considerando todos los puntos muestrales, se obtiene:

Yi

X1i

X2i

Ŷi

ui = Yi − Ŷi

1,3

3,5

2,8

3

3,3

4

3,7

21,6

0,3

1,5

0,7

1,1

1,2

2

2

8,8

4

9

6

7,5

8

7

8

49,5

1,6167

3,6729

2,3643

3,0186

3,2055

3,7677

3,9543

‐0,3167

‐0,1729

0,4357

‐0,0186

0,0945

0,2323

‐0,2543

(Yi − Y) 2 u2i = (Yi − Ŷi ) 2 (Ŷi − Y) 2

3,1887

0,1003

2,1580

0,1716

0,0299

0,3448

0,0816

0,1898

0,5204

0,0073

0,0003

0,0045

0,0459

0,0089

0,0144

0,8359

0,0540

0,4651

0,3774

0,0647

0,7545

4,7086

0,4479

4,2616

7

SCT = ∑ (Yi − Y) 2 = 4 ,7086

i=1

7

SCR = ∑ (Y1 − Ŷ1 ) 2 = 0 ,4479

i=1

7

SCE = ∑ (Ŷi − Y) 2 = 4 ,2616

i=1

7

( Yi − Ŷ i) 2

SCE ∑

4 ,2616

i=1

R =

= 7

=

= 0,9051 coeficiente de determinación lineal

SCT

( Y − Y ) 2 4 ,7086

2

∑

i=1

SR2 =

i

SCR

0,4479

=

= 0,112 varianza residual

n −k −1

4

Coeficiente de determinación lineal corregido

por el número de grados de libertad

R2 = 1 −

SCR n − k − 1

0,4479 / 4

=1−

= 0,8573

SCT n − 1

4 ,7086 / 6

h) El coeficiente de correlación parcial entre los Beneficios (Y) y el Gasto en Publicidad (X1 ) se puede

obtener mediante la expresión:

ryx 1 .x 2 =

VC yx 1

VC yy VCx 1x 1

VCij son los adjuntos de la matriz de las varianzas‐covarianzas:

⎡σ2y

⎢

VC = ⎢ Sx 1 y

⎢ Sx y

⎣ 2

VC yx 1 = −

VC yy =

S yx 1

σ

Sx 2 x 1

2

x1

S yx 2 ⎤ ⎡0,6727 0,4438 1,0369⎤

⎥

Sx 1x 2 ⎥ = ⎢⎢0,4438 0,3454 0,6462⎥⎥

σ2x2 ⎥⎦ ⎢⎣1,0369 0,6462 2,3167⎥⎦

0,4438 0,6462

= −0,3581

1,0369 2,3167

0,3454 0,6462

0,6727 1,0369

= 0,3826 VCx 1x 1 =

= 0,4833

0,6462 2,3167

1,0369 2,3167

El coeficiente de correlación parcial entre Y e X1: ryx 1 .x 2 = −

Santiago de la Fuente Fernández

VC yx 1

VC yy VCx 1x 1

=

0,3581

= 0,833

(0,3826)(0,4833)

32

Regresión Lineal Múltiple

# El coeficiente de correlación parcial entre los Beneficios (Y) y el Gasto en Publicidad (X1 ) se puede

obtener también mediante la expresión:

ryx 1 − ryx 2 rx 1 x 2

ryx 1 .x 2 =

(1 − ryx2 2 )(1 − rx21x 2 )

⎡1

ryx 1

⎢

Rx = ⎢ rx 1 y 1

correlaciones simples Rx de la variable explicativa

⎢ rx y rx x

2 1

⎣ 2

Donde los rij son los elementos de la matriz de

con lo cual, ryx 1 .x 2 =

ryx 1 − ryx 2 rx 1 x 2

(1 − r )(1 − r

2

yx 2

Análogamente, ryx 2 .x 1 =

2

x1x 2

=

)

0,9207 − (0,8306)(0,7224)

(1 − 0,83062 )(1 − 0,72242 )

ryx 2 − ryx 1 rx 2 x 1

(1 − r )(1 − r

2

yx 1

2

x 2x1

)

=

0,9207 0,8306 ⎤

ryx 2 ⎤ ⎡ 1

⎥ ⎢

1

0,7224 ⎥⎥

rx 1x 2 ⎥ = ⎢0,9207

1 ⎥⎦

1 ⎥⎦ ⎢⎣0,8306 0,7224

= 0,833

0,8306 − (0,9207)(0,7224)

(1 − 0,92072 )(1 − 0,72242 )

= 0,613

# También, los Coeficientes de correlación parcial se calculan mediante la expresión:

βˆ i

ti =

R2 (Y , X1 ; X2 ) =

SR2 . q i +1 , 1 +1

t2i

coeficiente de determinación parcial

t2i + n − (k + 1)

se tenía:

tgastos _ publi =

βˆ 1

2

R

S . q i +1, 1 +1

=

0,936

= 3,0075

(0,112) (0,8648)

El coeficiente de determinación parcial:

ryx2 1 .x 2 = R2 (Beneficios , Gastos _ Publi;Horas extras) =

t2gasto _ publi

t2gasto _ publi + n − (k + 1)

=

3,00752

= 0,6933

3,00752 + 4

El coeficiente de correlación parcial:

ryx 1 .x 2 = R(Beneficios , Gastos _ Publi;Horas extras) = 0,6933 = 0,833

Análogamente, thoras _ extras =

Santiago de la Fuente Fernández

βˆ 2

2

R

S . q i +1, 1 +1

=

0,1866

= 1,5530

(0,112) (0,1289)

33

Regresión Lineal Múltiple

El coeficiente de determinación parcial:

= R (Beneficios ,Horas extras; Gastos _ Publi) =

2

yx 2 . x 1

2

r

2

thoras

_ extras

1,5532

= 0,37615

2

thoras

1,5532 + 4

_ extras + n − (k + 1)

=

El coeficiente de correlación parcial:

ryx 2 .x 1 = R(Beneficios ,Horas extras; Gastos _ Publi) = 0,37615 = 0,6133

f) El Coeficiente de correlación múltiple viene definido por:

ryx2 1 x 2 = 1 −

CV

R2 = ryx2 1x 2 =

σ2y C yy

⎡σ2y

⎢

matriz de varianzas‐covarianzas: VC = ⎢ Sx 1 y

⎢ Sx y

⎣ 2

S yx 1

σ

Sx 2 x 1

2

x1

ryx2 1 + ryx2 2 − 2ryx 1 ryx 2 rx 1x 2

1 − rx21x 2

S yx 2 ⎤ ⎡0,6727 0,4438 1,0369⎤

⎥

Sx 1x 2 ⎥ = ⎢⎢0,4438 0,3454 0,6462⎥⎥

σ2x2 ⎥⎦ ⎢⎣1,0369 0,6462 2,3167⎥⎦

0,6727 0,4438 1,0369

0,3454 0,6462

= 0,3826

CV = 0,4438 0,3454 0,6462 = 0,0245 VC yy =

0,6462 2,3167

1,0369 0,6462 2,3167

ryx2 1x 2 = R2 = 1 −

R =r

2

2

yx 1 x 2

=

CV

σ C yy

2

y

=1−

0,0245

= 0,905 , o bien,

(0,6727)(0,3826)

ryx2 1 + ryx2 2 − 2ryx 1 ryx 2 rx 1x 2

1 − rx21x 2

Santiago de la Fuente Fernández

=

0,92072 + 0,83062 − 2. 0,9207. 0,8306. 0,7224

= 0,905

1 − 0,72242

34

Regresión Lineal Múltiple

Guía Práctica en SPSS ________________________________________________________________

Estimaciones

Ofrece las estimaciones de los coeficientes de regresión parcial no estandarizados (B) y

estandarizados (Beta), junto con las pruebas de significación individuales para contrastar las

hipótesis de que el valor poblacional de esos coeficientes es cero.

En la columna encabezada por [Coeficientes no estandarizados] se encuentran los coeficientes βi

que forman parte de la ecuación en puntuaciones directas:

Beneficios = 0,590 + 0,936 (Gastos _ Publicidad) + 0,187 (Horas _ extras)

Estos coeficientes no estandarizados se interpretan en los términos ya conocidos. Señalar que estos

coeficientes no son independientes entre sí. De hecho, reciben el nombre de coeficientes en

regresión parcial porque el valor concreto estimado para coeficiente se ajusta teniendo en cuenta la

presencia del resto de variables independientes. Conviene, por tanto, interpretarlos con cautela.

El signo del coeficiente de regresión parcial de una variable puede no ser el mismo que el del

coeficiente de correlación simple entre esa variable y la dependiente. Esto se produce a los ajustes

que se llevan a cabo para obtener la mejor ecuación posible. Aunque existen diferentes

explicaciones para justificar el cambio de signo de un coeficiente de regresión, una de las que deben

Santiago de la Fuente Fernández

35

Regresión Lineal Múltiple

de ser más seriamente consideradas es la que se refiere a la presencia de un alto grado de asociación

entre alguna de las variables independientes (Colinealidad).

# Los Coeficientes Beta están basados en las puntuaciones típicas y, por tanto, son directamente

comparables entre sí. Indican la cantidad de cambio, en puntuaciones típicas, que se producirá en la

variable dependiente por cada cambio de una unidad en la correspondiente variable independiente

(manteniendo constantes el resto de variables independientes).

Estos coeficientes proporcionan una pista muy útil sobre la importancia relativa de cada variable

independiente en la ecuación de regresión. En general, una variable tiene tanto más peso

(importancia) en la ecuación de regresión cuanto mayor (en valor absoluto) es su coeficiente de

regresión estandarizado.

Observando los coeficientes Beta del ejercicio, la variable Gastos_Publicidad es la más importante.

# Pruebas de significación

Las pruebas t y sus niveles críticos (últimas dos columnas de la tabla) sirven para contrastar la

hipótesis nula de que un coeficiente de regresión vale 0 en la población. Niveles críticos (Sig) muy

pequeños (generalmente menores que 0,05) indican que debemos rechazar la hipótesis nula.

Un coeficiente de cero indica ausencia de relación lineal, de modo que los coeficientes

significativamente distintos de cero informan sobre qué variables son relevantes en la ecuación de

regresión.

Observando el nivel crítico asociado a cada prueba t, las dos variables utilizadas

(Gastos_Publicidad, Horas_extras) tienen coeficientes significativamente distintos de cero (en

todas, Sig<0,05). Por tanto, las dos variables independientes contribuyen significativamente a

explicar lo que ocurre con la variable dependiente (Beneficios).

Ajuste del modelo

Muestra el coeficiente de correlación múltiple, su cuadrado corregido y no corregido, y el error típico

de los residuos. También incluye la tabla resumen de ANOVA, que contiene al estadístico F de Fisher‐

Snedecor para contrastar la hipótesis nula de que el coeficiente de correlación múltiple Ryx 1x 2 = 0

R2 = 0,905 coeficiente determinación múltiple

R 2 = 0,905 coeficiente determinación múltiple

corregido

El estadístico F contrasta la hipótesis nula de que

el valor poblacional de Ryx 1x 2 es cero.

En consecuencia, permite decidir si existe relación lineal significativa entre la variable dependiente y

el conjunto de variables independientes tomadas juntas.

El valor de un nivel crítico (Sig < 0,05) indica que existe relación lineal significativa, pudiendo afirmar

que el hiperplano definido por la ecuación de regresión ofrece un buen ajuste a la nube de puntos.

Santiago de la Fuente Fernández

36

Regresión Lineal Múltiple

⎧ SCE = 7 (Ŷ − Y) 2 = 4 ,261 gl = k = 2

∑ i

⎪

i=1

7

⎪⎪

En este caso, ⎨ SCR = ∑ (Y1 − Ŷ1 ) 2 = 0,448 gl = n − k − 1 = 7 − 2 − 1 = 4

i=1

⎪

7

⎪ SCT = ∑ (Yi − Y) 2 = 4 ,709 gl = n − 1 = 7 − 1 = 6

⎪⎩

i=1

7

R2 =

( Yi − Ŷ i) 2

SCE ∑

i=1

SCT

=

7

∑ ( Yi − Y ) 2

=

4 ,261

= 0,905 coeficiente de determinación múltiple

4 ,709

i=1

SR2 =

SCR

0,448

=

= 0,112 varianza residual

n−k −1

4

R2 = 1 −

F=

0,448 / 4

SCR n − k − 1

=1−

= 0,857 coeficiente de determinación múltiple corregido

SCT n − 1

4 ,709 / 6

SCE k

4 ,261 / 2

=

= 19,023 estadístico observado F de Fisher‐Snedecor

SCR n − k − 1 0,448 / 4

Adviértase la relación entre el coeficiente de determinación múltiple y el estadístico F:

2

0,905

⎡n − k − 1 ⎤ ⎡ R ⎤

F = ⎢

=2

= 19,023

⎢

2⎥

⎥

(1 − 0,905)

⎣ k ⎦ ⎣1 − R ⎦

H0 : β1 = β2 = 0

⎧

Contraste de la Hipótesis nula ⎨

19,023 > 6,9443 = F0 ,05; 2 ,4

Se

rechaza

H

si

F

F

≥

0

α

;

k

,

(

n

−

k

−

1

)

⎩

Intervalos de confianza

Situados en la tabla [Coeficientes de regresión], permitiendo que además de obtener una estimación

puntual de los coeficientes de regresión parcial, se pueda obtener el intervalo de confianza para

estos coeficientes.

Estos intervalos informan sobre los límites en que se encuentra el valor poblacional de cada

coeficiente. Los límites se obtienen sumando y restando 1,96 (SPSS trabaja por defecto con un nivel

de significación 0,95) errores típicos al valor del correspondiente coeficiente de regresión.

Una amplitud grande en los intervalos de confianza indica que las estimaciones obtenidas son poco

precisas y, probablemente, inestables (coas que puede ocurrir, por ejemplo, cuando existen

problemas de colinealidad).

Santiago de la Fuente Fernández

37

Regresión Lineal Múltiple

Matriz de covarianzas

Muestra una matriz con las covarianzas y correlaciones existentes entre los coeficientes de regresión

parcial.

Descriptivos

Ofrece la media y la desviación típica de cada variable y el número de casos utilizados en el análisis.

Además, ofrece la matriz de correlaciones entre el conjunto de variables utilizadas en el análisis,

En la matriz de correlaciones, cada coeficiente de correlación aparece acompañado de su

correspondiente nivel crítico (que permite decidir sobre la hipótesis de que el coeficiente de