AJUSTE

Anuncio

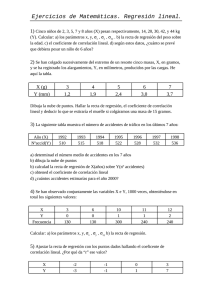

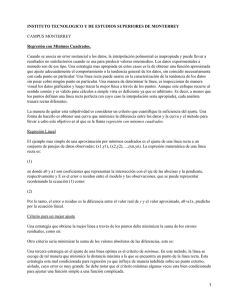

AJUSTE PLANTEAMIENTO DEL PROBLEMA DIFERENCIA ENTRE INTERPOLACIÓN Y AJUSTE METODOLOGÍA DEL AJUSTE MÉTODO DE MÍNIMOS CUADRADOS MODELO LINEAL MODELO EXPONENCIAL EJEMPLO PLANTEAMIENTO DEL PROBLEMA Cuando los datos tienen errores sustanciales, la interpolación polinomial es inapropiada y puede dar resultados poco satisfactorios cuando se utiliza para predecir valores intermedios. Con frecuencia los datos experimentales son de este tipo. DIFERENCIA ENTRE INTERPOLACIÓN Y AJUSTE INTERPOLACIÓN : se caracteriza por suponer que los datos que intervienen en el problema son exactos; por lo cual en la construcción de la FUNCIÓN DE INTERPOLACIÓN se exige que la misma satisfaga todos y cada uno de los valores que constituyen los datos . DIFERENCIA ENTRE INTERPOLACIÓN Y AJUSTE AJUSTE : supone que los datos ingresados están afectados en cierto grado de errores debido al modelado, por lo que, no resulta indispensable que la CURVA DE AJUSTE correspondiente, pase exactamente por los puntos que representan los datos, sino que, en promedio la aproximación sea óptima de acuerdo a un cierto y determinado criterio, denominado CRITERIO DE AJUSTE. GRÁ GRÁFICO DE DISPERSIÓ DISPERSIÓN Disposición: Eje de abscisas: variable independiente (X) Eje de ordenadas: variable dependiente (Y) Frecuentemente X es una variable controlada (no aleatoria) Un punto por cada observación (par de valores X-Y) Aproximación al tipo de relación existente entre las variables Problema general Se debe encontrar un criterio para establecer una base para el ajuste. Una forma de hacerlo es obtener una curva que minimice la discrepancia entre los puntos y la curva. Una técnica para lograr tal objetivo, es llamada regresión por mínimos cuadrados. Problema general En el ejemplo, los datos sugieren una recta, más o menos, y entonces una relación lineal entre y y x. Aquí son varias rectas que se acercan a los puntos REGRESIÓN LINEAL Una aproximación por mínimos cuadrados es ajustar una línea recta a un conjunto de observaciones definidas por puntos:(x1;y1),(x2;y2),…,(xn,yn). La expresión matemática para la línea recta es: y = a0 + a1 x + e (1.1) Regresión lineal Donde a y a son coeficientes que representan la intersección con el eje y y la pendiente, respectivamente, e es el error, o diferencia, entre el modelo y las observaciones, el cual se representa al reordenar la ecuación 1.1 como: 0 1 e = y − a 0 − a1 x Regresión lineal Así, el error o residuo es la discrepancia entre el valor verdadero de y y el valor aproximado, a 0 + a 1 x que predijo la ecuación lineal. Regresión lineal La recta de mejor ajuste será: Regresión lineal Esta recta se llama la recta de mejor ajuste, recta de regresión, o recta de mínimos cuadrados asociada a los datos. CRITERIO PARA UN MEJOR AJUSTE Una estrategia para ajustar una “mejor” línea a través de los datos será minimizar la suma de los errores residuales de todos los datos disponibles; como sigue: CRITERIO PARA UN MEJOR AJUSTE La estrategia consiste en minimizar la suma de los cuadrados de los residuos entre la y medida y la y calculada con el modelo lineal: CRITERIO PARA UN MEJOR AJUSTE Este criterio tiene varias ventajas, entre ellas el hecho de que se obtiene una línea única para cierto conjunto de datos. Antes de analizar tales propiedades, presentaremos una técnica para determinar los valores de a y a que minimizan la ecuación 0 1 Ajuste de una línea recta por mínimos cuadrados Para determinar los valores de a0 y a1, la ecuación se deriva con respecto a cada uno de los coeficientes: Ajuste de una línea recta por mínimos cuadrados Observe que hemos simplificado los símbolos de sumatoria; a menos que se indique otra cosa, todas las sumatorias van desde i=1 hasta n. Al igualar estas derivadas a cero, se dará como resultado un Sr mínimo. Si se hace esto, las ecuaciones se expresan como: Ajuste de una línea recta por mínimos cuadrados 0 = ∑ y i − ∑ a 0 − ∑ a1 xi 0 = ∑ yi xi − ∑ a0 xi − ∑ a 1 x i2 Ahora, si observamos que ∑ a0 = na0 expresamos las ecuaciones como un conjunto de dos ecuaciones lineales simultáneas, con dos incógnitas (a0 y a1). Ajuste de una línea recta por mínimos cuadrados na0 + (∑ xi )a1 = ∑ yi ( ∑ x i ) a 0 + ( ∑ xi2 ) a1 = (1.2) ∑xy i i (1.3) Éstas se llaman ecuaciones normales y se resuelven en forma simultánea Ajuste de una línea recta por mínimos cuadrados Este resultado se utiliza conjuntamente con la ecuación para obtener a1 = n∑ xi yi − ∑ xi ∑ yi n∑ xi2 − (∑ xi ) 2 Este resultado se utiliza conjuntamente con la ecuación (1.2)para obtener a 0 = y − a1 x Donde y y x son las medias de y y x respectivamente. Ajuste de una línea recta por mínimos cuadrados EJEMPLO Obtenga la ecuación de demanda que se ajusta mejor a los siguientes datos, y úsela para pronosticar ventas anuales de casas preciadas a $140,000. Precio 160 180 200 220 240 260 280 126 103 82 75 82 40 20 (Miles de dólares) Venta de nuevas casas este año CURVA EXPONENCIAL DE MEJOR AJUSTE Para obtener la curva exponencial de mejor ajuste de la forma: y = Ar x Tomando logaritmo en ambos miembros: log y = log( Ar x ) Las propiedades de logaritmo nos dan: log y = log A + log r x log y = log A + x log r CURVA EXPONENCIAL DE MEJOR AJUSTE Esto expresa log y como una función lineal, con: Pendiente = a1= log r Intersección = a0 = log A Por lo tanto si calculamos la recta de mejor ajuste usando log y como una función de x, entonces la pendiente y la intersección en y serían dados como mas arriba, y después podemos obtener los coeficientes r y A por: CURVA EXPONENCIAL DE MEJOR AJUSTE r = 10 a1 A = 10 a0 COEFICIENTE DE CORRELACIÓN Hay un número que mide la "bondad de ajuste" de la recta de regresión llamado coeficiente de correlación. Este número, que se representa por r, está entre −1 y 1. Cuanto más se acerca r a−1 o 1, el ajuste es mejor. Si el ajuste es malo, se acerca r a 0. Si el ajuste es exacto, r=−1 para una recta con pendiente negativa, o r=1 para una recta de pendiente positiva COEFICIENTE DE CORRELACIÓN Las figuras más abajo muestran varios conjuntos de puntos con sus rectas de regresión, y los valores correspondientes de r. COEFICIENTE DE CORRELACIÓN El coeficiente de correlación se puede calcular con la siguiente formula: Coeficiente de correlación r: r= n(∑ xy) − (∑ x)(∑ y) n(∑ x2 ) − (∑ x)2 * n(∑ y 2 ) − (∑ y)2 COEFICIENTE DE DETERMINACIÓN Una pregunta importante que se plantea en el análisis de regresión es la siguiente: ¿Qué parte de la variación total en Y se debe a la variación en X? ¿Cuánto de la variación de Y no explica X? El estadístico que mide esta proporción o porcentaje se denomina coeficiente de determinación (r2). Si por ejemplo, al hacer los cálculos respectivos se obtiene un valor de 0.846. Esto significa que el modelo explica el 84.6 % de la variación de la variable dependiente. COEFICIENTE DE DETERMINACIÓN El significado del Coeficiente de Determinación es que nos proporciona el porcentaje de causas comunes que tienen las dos variables relacionadas para explicar su variabilidad o evolución si se expresa en tantos por 100. El campo de variación del coeficiente de determinación es 0≤R²≤1. Bibliografía Pace G. “Métodos Numéricos” Edictorial de la UNNE, 1997 Chapra, S.C. y Canale, R. “Métodos Numéricos para Ingenieros” 5ta Ed., México, McGraw-Hill, 2007