ANÁLISIS DE FACTORES: FA.

Anuncio

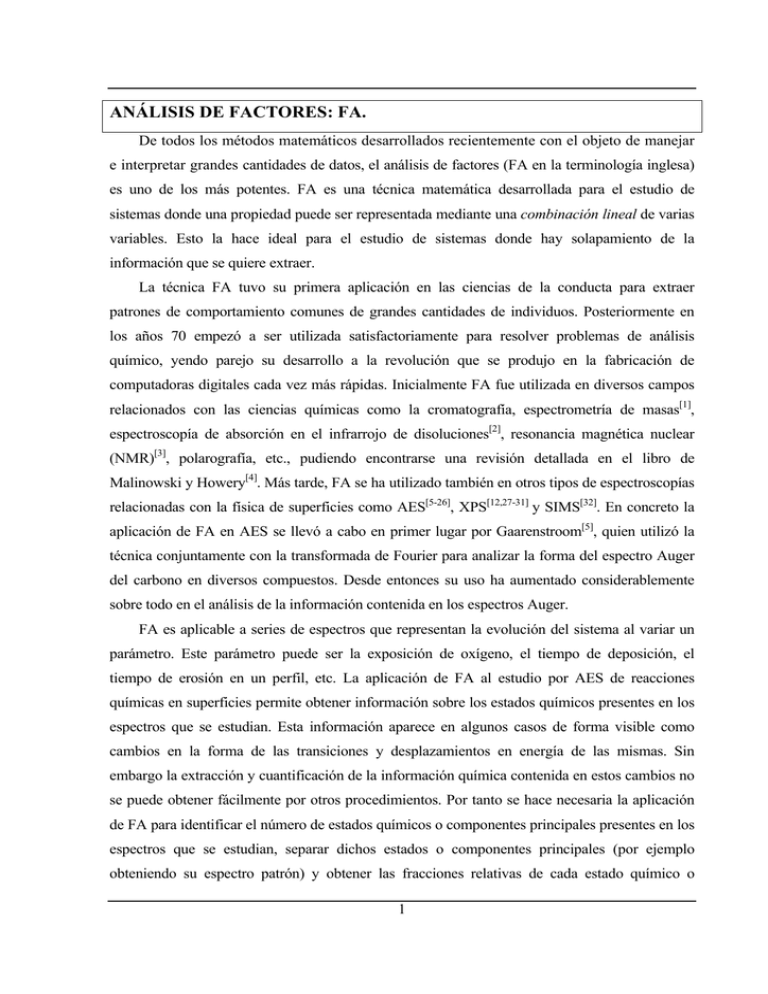

ANÁLISIS DE FACTORES: FA. De todos los métodos matemáticos desarrollados recientemente con el objeto de manejar e interpretar grandes cantidades de datos, el análisis de factores (FA en la terminología inglesa) es uno de los más potentes. FA es una técnica matemática desarrollada para el estudio de sistemas donde una propiedad puede ser representada mediante una combinación lineal de varias variables. Esto la hace ideal para el estudio de sistemas donde hay solapamiento de la información que se quiere extraer. La técnica FA tuvo su primera aplicación en las ciencias de la conducta para extraer patrones de comportamiento comunes de grandes cantidades de individuos. Posteriormente en los años 70 empezó a ser utilizada satisfactoriamente para resolver problemas de análisis químico, yendo parejo su desarrollo a la revolución que se produjo en la fabricación de computadoras digitales cada vez más rápidas. Inicialmente FA fue utilizada en diversos campos relacionados con las ciencias químicas como la cromatografía, espectrometría de masas[1], espectroscopía de absorción en el infrarrojo de disoluciones[2], resonancia magnética nuclear (NMR)[3], polarografía, etc., pudiendo encontrarse una revisión detallada en el libro de Malinowski y Howery[4]. Más tarde, FA se ha utilizado también en otros tipos de espectroscopías relacionadas con la física de superficies como AES[5-26], XPS[12,27-31] y SIMS[32]. En concreto la aplicación de FA en AES se llevó a cabo en primer lugar por Gaarenstroom[5], quien utilizó la técnica conjuntamente con la transformada de Fourier para analizar la forma del espectro Auger del carbono en diversos compuestos. Desde entonces su uso ha aumentado considerablemente sobre todo en el análisis de la información contenida en los espectros Auger. FA es aplicable a series de espectros que representan la evolución del sistema al variar un parámetro. Este parámetro puede ser la exposición de oxígeno, el tiempo de deposición, el tiempo de erosión en un perfil, etc. La aplicación de FA al estudio por AES de reacciones químicas en superficies permite obtener información sobre los estados químicos presentes en los espectros que se estudian. Esta información aparece en algunos casos de forma visible como cambios en la forma de las transiciones y desplazamientos en energía de las mismas. Sin embargo la extracción y cuantificación de la información química contenida en estos cambios no se puede obtener fácilmente por otros procedimientos. Por tanto se hace necesaria la aplicación de FA para identificar el número de estados químicos o componentes principales presentes en los espectros que se estudian, separar dichos estados o componentes principales (por ejemplo obteniendo su espectro patrón) y obtener las fracciones relativas de cada estado químico o 1 componente principal en cada uno de los espectros de la serie experimental, es decir obtener sus concentraciones. Con esta información se puede reproducir cada espectro experimental mediante una combinación lineal de los espectros patrones de los componentes principales pesados con sus fracciones relativas en dicho espectro. De esta forma se descompone linealmente el conjunto de espectros experimentales que se estudian, obteniendo la información de tipo químico que se buscaba en AES, y que en general no es fácil de obtener por otros métodos. TEORIA DEL ANÁLISIS DE FACTORES. FA. La aplicación de FA consta de dos etapas: La primera etapa recibe el nombre de Análisis Principal de Factores, PFA, y en ella se generan dos cantidades; autoespectros abstractos que contienen la información espectral necesaria para construir los espectros reales de los factores principales del sistema y autovectores que son una representación abstracta de las concentraciones de los componentes principales en los espectros experimentales estudiados, donde dichos componentes (estados químicos) aparecen superpuestos. La elección del número adecuado de factores principales necesarios para reproducir los espectros originales dentro del error experimental se lleva a cabo utilizando dos tipos de criterios. Para el primer tipo de criterios, no es necesario el conocimiento del error experimental, mientras que el segundo tipo está basado en el conocimiento de dicho error. Una vez decidido el número de factores principales necesarios, se construyen los espectros abstractos y concentraciones abstractas a partir de la matriz de datos. En la segunda etapa, se realiza una transformación de las magnitudes abstractas con objeto de facilitar su interpretación. Existen dos tipos de transformaciones: transformaciones de Target Testing, TT, y Rotaciones Abstractas. Mediante Target Testing se transforman las cantidades abstractas en cantidades reales con significado físico. Dicha transformación se puede realizar como se verá más adelante a partir de espectros o a partir de concentraciones, y ofrece una serie de procedimientos para desarrollar y comprobar la válidez de modelos físicos relativos a la naturaleza de los factores principales, lo que la hace ideal para aplicaciones físico-químicas. Por otro lado en la transformación por Rotación Abstracta, se transforman unas magnitudes abstractas en otras también abstractas siguiendo una serie de criterios matemáticos[4], que permiten obtener unas soluciones rotadas más fáciles de interpretar (“clustering”). Este segundo tipo de transformación se utiliza cuando existe poca o ninguna información sobre el verdadero origen de los factores principales, con el único objetivo de obtener una serie de factores con una 2 estructura los más sencilla posible. La rotación abstracta se utiliza sobre todo en el campo de las ciencias de la conducta, y por tanto en adelante no se darán más detalles sobre dicho tipo de transformaciones, centrándonos tan sólo en las transformaciones de Target Testing. Para facilitar y entender mejor el proceso de cálculo es conveniente introducir la notación matricial, representando las matrices entre corchetes cuadrados [ ]. A continuación se describe el proceso en detalle indicando todos los pasos en notación matricial. Además al lado de cada ecuación se indican las dimensiones de las matrices utilizadas (entre paréntesis) para aclarar la descripción. Como ya se ha comentado anteriormente el proceso de FA se divide en dos etapas: 1.-Analisis Principal de Factores: En primer lugar se construye la matriz de covarianza [Z], [Z] = [DT]·[D] (M,M) = (M,N)·(N,M) (1) donde [D] representa la matriz de los datos experimentales. Su dimensión es (N,M), donde N representa el número de puntos que componen cada espectro y M el número de espectros de la serie que se estudia. Es decir [D] contiene M columnas, donde cada columna contiene un espectro experimental de la serie analizada. A continuación se diagonaliza la matriz de covarianza; [Z]·[Q] = []·[Q] (M,M)·(M,M) = (M,M)·(M,M) (2) aquí [Q] es la matriz que contiene los autovectores y [] es la matriz que contiene los autovalores. Para encontrar el número de factores principales necesarios para reproducir la matriz [D] dentro del error experimental hay dos tipos de métodos: (a) Métodos que no requieren el conocimiento del error experimental: (a.1) Cálculo de la función Imbedded Error (IE), dada por la ecuación (3). IE RE I M (3) siendo RE el error real[4] definido como M RE = o j j= I +1 N· (M - I) 3 (4) En la ecuación (4), I es el número de factores o componentes tomados en cuenta en la reproducción de [D] y los o j son los autovalores obtenidos al diagonalizar [Z] ordenados de mayor a menor. La función RE se calcula desde I=1 (si sólo se toma el autovalor mayor o primer componente principal), hasta I=M-1 si se toman los M-1 autovalores mayores. La función IE presenta un mínimo cuando el número adecuado de factores I=L es tomado para calcular su valor[4]. (a.2) Cálculo la función indicadora[4,33] IND, dada por la ecuación (5). IND = (RE) (M - I )2 (5) Como se ha comprobado empíricamente esta función presenta un mínimo más pronunciado que la función IE cuando el número adecuado de factores I=L es tomado para calcular su valor[33]. De esta forma hallando el mínimo de la función IND se obtendría el número adecuado de factores L. (a.3) Cálculo de la Varianza. Este parámetro da una medida del tanto por ciento de información que se retiene en la matriz [D] al tomar sólo I factores. Conviene señalar que en general para los L factores principales la varianza es mayor que el 99%. I Varianza = 100· o j j=1 M o j j=1 (6) (b) Métodos basados en el error experimental: (b.1) Cálculo de la desviación estándar residual (RSD) o error real (RE)[4]. Cuando el valor de RE(I) dado por la ecuación (4) se hace comparable al error experimental estimado ( ruido ), el número de factores I tomados en cuenta en su cálculo corresponderá al número adecuado de factores L. (b.2) Cálculo de la función 2(I), en función del número de factores I tomados en cuenta para reproducir la matriz de datos experimental [D] para dar [D]I cc. 4 2 (I ) N M (dik dikcc )2 j 1 k 1 ik2 (7) El valor esperado de 2(I) es igual a (N-I)·(M-I), de manera que cuando 2(I) calculado según la ecuación (7) se haga menor que 2(I) esperado entonces L=I-1. (b.3) Cálculo del error estándar de cada autovalor[6], (I), dado por la ecuación (8): M M Q 2jI ·QkI2 · 2jk ( I ) (8) j 1k 1 En este caso, si el error experimental asociado a cada punto es constante, jk ,= ruido , la ecuación (8) se simplifica a (I)= ruido . Puesto que los autovectores son ortonormales ([Q]-1=[Q]T), los autoespectros abstractos y las concentraciones abstractas se pueden obtener a partir de las ecuaciones (9) y (10). [Ra] = [D]·[Q+] (N,L) = (N,M)·(M,L) (9) [Ca] = [Q+]T (L,M) = (L,M) (10) En estas ecuaciones [Q+] contiene sólamente los autovectores abstractos de la matriz [Q] asociados con los L factores principales y ordenados de acuerdo a la magnitud de sus autovalores. A partir de los autoespectros y concentraciones abstractas se puede recuperar la matriz [D] de la siguiente manera, [D] = [Ra]·[Ca] (N,M) = (N,L)·(L,M) (11) esto es lo que se conoce en la literatura como reproducción cortocircuito[4]. Conviene mencionar que de esta forma se reconstruye [D] dentro del error experimental, pero sólo con la información de los L componentes principales asociados a los L autovalores principales. Los restantes (M-L) autovalores, algunos ordenes de magnitud menores que los principales, son debidos al ruido y no contienen información física. Por esta razón dichos autovalores y sus autovectores asociados no se utilizan en el proceso de target testing como se verá más adelante. 2.- Target Testing: Los espectros y las concentraciones reales de los factores principales pueden obtenerse a partir de las transformaciones dadas por las ecuaciones (12) y (13). 5 [Rr] = [Ra]·[T-1] (N,L) = (N,L)·(L,L) (12) [Cr] = [T]·[Ca] (L,M) = (L,L)·(L,M) (13) Las matrices [T] y [T-1] que transforman las magnitudes abstractas en reales pueden obtenerse por procedimientos de target testing[4,12] de dos tipos: (a) Target testing a partir de espectros. En este caso si se conocen espectros patrones adecuados que sirvan de referencia [Ref] y que sean buenas estimaciones de los espectros reales [Rr], se puede calcular la matriz [T-1] a partir de la ecuación (14); [T-1] = [+]-1·[Ra]T·[Ref] (L,L) = (L,L)·(L,N)·(N,L) (14) el cálculo de [T-1] se puede llevar a cabo columna por columna de forma independiente para cada espectro de referencia utilizado. La matriz [+] sólo contiene los L autovalores principales ordenados en la diagonal de mayor a menor. Invirtiendo [T-1] se halla [T] que junto con la ecuación (13) permite hallar las concentraciones reales [Cr]. Además a partir de [T-1] se puede hallar [Rr] utilizando la ecuación (12). En este caso se dice que el espectro de referencia Ref k , que corresponde a la columna k de la matriz [Ref], es representativo de un factor si después del cálculo se cumple Rr k Ref k (15) dentro del error experimental. (b) Target testing a partir de concentraciones. Si se conocen buenas estimaciones para las concentraciones reales de los componentes principales en algunos espectros experimentales que forman la matriz [D], es posible calcular todas las concentraciones reales. Las estimaciones se introducen en la matriz [Con], que debe tener un número mínimo de ellas en cada una de sus columnas que debe coincidir con el número de factores principales. La matriz [Con] tiene como dimensiones mínimas (LxL). De esta forma se obtiene la matriz [T]; [T] = [([Ca ff ]·[Ca ff ]T)-1·[Ca ff ]·[Con]]T (16) (L,L) = [((L,L)·(L,L))-1·(L,L)·(L,L)]T = [(L,L).(L,L)]T = (L,L) el cálculo de la matriz [T] se puede hacer fila por fila de forma independiente, introduciendo la matriz [Con] columna por columna. [Ca ff ] es la matriz [Ca], donde las columnas asociadas a espectros en [D] para los que no se introducen estimaciones son eliminadas. Esto recibe el nombre de free floating[4]. 6 Conocida la matriz [T], la ecuación (13) permite hallar [Cr]. Invirtiendo [T] y usando la ecuación (12) se puede hallar [Rr]. Las estimaciones introducidas en la matriz [Con] se consideran buenas estimaciones de las concentraciones si se cumple, [Cr]T k [Con] k (17) Se puede recuperar la matriz [D] a partir de las concentraciones y espectos reales, [D] = [Rr]·[Cr] = [Ra]·[T-1]·[T]·[Ca] = [Ra]·[Ca] (N,M) = (N,L)·(L,M) (18) Como se ve [D] es una combinación lineal de los L espectros reales de los factores principales (contenidos en la matriz [Rr]) multiplicados por sus pesos respectivos, que son las concentraciones contenidas en la matriz [Cr]. Esto se observa mejor si se escribe de forma explícita cada elemento de [D], L r r = Dik R · C jk j = 1 ij (19) donde se pone de manifiesto la combinación lineal antes mencionada. Matriz de datos [D] Combinación Magnitudes reales [Rr] y [Cr] [Z]=[D]T·[D] Matriz de covarianza [Z] reproducción cortocircuito diagonalización de [Z] IND L factores descomposición de [D] Target Testing [T] o [T1] Magnitudes abstractas [Ra] y [Ca] Figura 1: Esquema simplificado de los pasos del proceso de análisis de factores. 7 COMPARACION DE FA CON EL AJUSTE POR MINIMOS CUADRADOS. Otro procedimiento también muy utilizado consiste en ajustar los espectros experimentales [D] por un criterio de mínimos cuadrados (LSF: least squares fitting) mediante una combinación lineal de espectros patrones de referencia conocidos [Ref] dada por, [Ref]·[C] + [X], donde los coeficientes del ajuste [C] representan las concentraciones de cada patrón en el espectro experimental ajustado [D] y [X] representa el término independiente del ajuste. Con esto se consigue una cuantificación de forma similar a la obtenida con FA. Este método utiliza también la información de todo el espectro como FA. En general si se tiene un conjunto completo de espectros de referencia válidos, los resultados obtenidos por los dos métodos, F.A. y LSF, son equivalentes[34,35]. En este caso la aplicación del ajuste por mínimos cuadrados es más favorable en tiempo de cálculo comparada con FA, puesto que este último método requiere la diagonalización de una matriz (MxM) y el posterior proceso de Target Testing a partir de espectros patrones. Sin embargo FA tiene tres ventajas fundamentales sobre LSF: (a) En primer lugar permite la determinación del número de componentes principales necesarios para ajustar las medidas dentro del error experimental. Esto es útil para reconocer estados químicos relevantes que dada su baja concentración pudieran haber pasado desapercibidos en un primer estudio y que conducen a un ajuste mejor de los espectros experimentales. (b) En segundo lugar permite la posibilidad de llevar a cabo el análisis aún cuando falte algún espectro patrón de referencia [Ref]. Para ello se utiliza el Target Testing a partir de concentraciones, si es posible hacer hipótesis físicas razonables sobre las estimaciones de las concentraciones de los factores principales en L espectros experimentales como mínimo. De esta forma se pueden generar espectros patrones de factores principales que son relevantes en el sistema y que no son asequibles experimentalmente. (c) Además FA provee un procedimiento para verificar posibles estados patrones (es decir el modelo físico propuesto) mediante comparación de los posibles espectros de referencia [Ref] o de las estimaciones de la concentración [Con], con los valores devueltos por las ecuaciones (12) y (13). 8 REFERENCIAS. [1] E.R. Malinowski y M. Maccue, Anal. Chem. 49, 284 (1977) [2] P.C. Gillete, J.B. Lando y J.L. Koening, Anal. Chem. 55, 630 (1983) [3] D.W. Kormos y J.S. Waugh, Anal. Chem. 55, 633 (1983) [4] E.R. Malinowski y D.G. Howery, Factor Analysis in Chemistry. R.E. Krieger, Malabar FL (1989) [5] S.W. Gaarenstrom, J. Vac. Sci. Technol. 16, 600 (1979) [6] S.W. Gaarenstrom, Appl. Surf. Science 7, 7 (1981) [7] S.W. Gaarenstrom, J. Vac. Sci. Technol. 20, 458 (1982) [8] J.S. Solomon y S.R. Smith, J. Vac. Sci. Technol. A 5, 1809 (1987) [9] J. Steffen y S. Hofmann, Surf. Science 202, L607 (1988) [10] R. Vidal y J. Ferrón, Appl. Surf. Science 31, 263 (1988) [11] S. Hoffman y J. Steffen, Surf. Interface Anal. 14, 59 (1989) [12] C. Palacio y H.J. Mathieu, Surf. Interface Anal. 16, 178 (1990) [13] C. Jansson y P. Morgen, Surf. Interface Anal. 15, 1 (1990) [14] C. Jansson y P. Morgen, Surf. Science 233, 84 (1990) [15] C. Gatts y W. Losch, Vacuum 41, 1676 (1990) [16] T. Lang, A. Tschulik, H, Laimer y H. Störi, Vacuum 41, 1703 (1990) [17] C. Gatts y W. Losch, J. Vac. Sci. Technol. A 9, 2982 (1991) [18] E. Oesterschulze, K. Maeli y R. Kassing, Fresenius J. Anal. Chem. 341, 70 (1991) [19] G.G. Kurbatov, V.G. Beshenkov y V.I. Zaporozchenko, Surf. Interface Anal. 17, 779 (1991) [20] T. Pütz, A. Fuchs y H. Ehrhardt, Surf. Science 265, 219 (1992) [21] P. de Volder, R. Hoogewijs, R. De Gryse, L. Fiermans y J. Vennik, Appl. Surf. Science 64, 41 (1993) [22] U. Scheithauer, W. Hösler y G. Riedl, Surf. Interface Anal. 20, 519 (1993) [23] C. Chemelli, Surf. Interface Anal. 22, 60 (1994) [24] A. Arranz y C. Palacio, Vacuum 45, 1091 (1994) [25] A. Arranz y C. Palacio, Surf. Science 355, 203 (1996) [26] A. Arranz y C. Palacio, Thin Solid Films 317, 55 (1998) [27] M.J. Fay, A.Proctor, D.P. Hoffmann y D.M. Hercules, Anal. Chem. 63, 1058 (1991) [28] A.R. González-Elipe, J.P. Holgado, R. Alvarez y G. Munuera, J. Phys. Chem. 96, 3080 (1992) [29] J.N. Fiedor, A. Proctor, M. Houalla y D.M. Hercules, Surf. Interface Anal. 20, 1 (1993) [30] S.J. Scierka, A. Proctor, M. Houalla, J.N. Fiedor y D.M. Hercules, Surf. Interface Anal. 20, 901 (1993) [31] H. Bubert, M. Korte, R.P.H. Garten, E. Grallath y M. Wielunski, Anal. Chim. Acta 297, 187 (1994) [32] S.W. Gaarenstroom, Appl. Surf. Science 26, 561 (1986) [33] E.R. Malinowski, Anal. Chem. 49, 612 (1977) [34] N.H. Turner y W.W. Lee, Appl. Surf. Sci. 25, 345 (1986) [35] M.F. Koenig y J.T. Grant, J. Electron Spectrosc. Relat. Phenom., 41, 145 (1986) 9