Error Cuadrático Medio de Predicción para Modelos Estructurales

Anuncio

ESTADISTICA ESPAÑOLA,

V©I. 34, Núm. 129, 1992, págs. 117 a 135

Error Cuadrático Medio de P redicción para

M odelos Estructurales de Series Temporales

M. PILAR GONZALEZ

Departamento de Econometría y Estadística

e Instituto de Economía Pública

Universidad del País Vasco

RESUMEN

En este artículo se comparan, mediante un estudio de Monte Carlo,

el comportamiento en muestras pequeñas de dos estimadores alternativos del error cuadrático medio (ECM) de predicción con parámetros estimados para modelos estructurales de series temporales, uno

que incluye un término que trata de recoger el error proveniente de la

estimación de los parámetros, y otro que no incluye dicho término.

Para el modelo estructural más sencillo, el modelo de paseo aleatorio

más ruido, se comparan ambos estimadores con el verdadero ECM

de predicción con parámetros estimados para diferentes tamaños de

muestra, valores de los parámetros y horizontes de predicción.

Palabras clave: Filtro de Kalman, Modelos Estructurales, Error Cuadrático Medio de Predicción, Estimación Máximo-verosímil.

Clasificación AMS: 62M 10.

1.

INTRC^DUCCION

Los modelos estructurales de series temporales se formulan en términos de

componentes no observados tales como tendencia, estacionalidad, ciclo e irregular, que son de gran interés para los economistas porque cuentan con una

interpretación directa. La formulación general del modelo es:

Yr=Nt+Yr+Wr+£r

(1.1)

1 18

ESrADiSr^CA ESPAÑ4LA

donde yr es la serie abservada ^r, Yr ^ ^r Y^r representan ia tendencia, estacionalidad, el ciclo y el componente irregular respectivamente. Cada uno de estos

comp©nentes se especifica a priori de forma estocástica permitiéndoseles evolucionar a lo largo del tiempo mediante la introducción de variables aleatorias. Dependiendo de cuáles sean ias principales caracteristicas de la serie que se desean

recvger en el rnodelo, estos componentes no observab^es se cOmbinan de diferentes

maneras dando iugar a los distintos modelos estructurales (ver Harvey 1990).

Esta clase de rnodelos se puede representar fácilm®nte en el espacio de tos

estadas, lo que posibílita la utilización de potentes algoritmos basados en el fiitro

de Kalman para la estimación máxirno-verosímil de los parámetros, la extracción

de señales y!a predicción (Harvey 19$3). Por la tanto, baja el supuesto de que

los parámetros del madelo son conocidos podemos obtener el predictor óptímo

de fas futuras observaciones yT+s, s= 1, 2,... junto con el error cuadrático medio

(ECN1) de predición aplicando repetidamente las ecuaciones de prediccíón del

filtro de Kalman (ver Anderson & Moore 1979).

Ei problema se plantea porque coma ya señala Pierce ( 1975) rara vez conocermos los parámetros del modela y, en la práctica, para ilevar a cabo predicciones basadas en cualquier modelo hemos de estimar en primer lugar los parámetros de manera eficíente. Nuestros predictores son, por io tanto, únicamente

estimaciones de los predictores óptimos lo que conlleva un aumento en el ECM

de predicción. Estas cuestiones han despertado el interós en Ios últimos años

sobre la distribución del error de predicción con parámetros estimados.

En la sección 2 de este artículo se plantean dos estimadores prácticos para el

ECM de predicción con parámetros estimadas, uno que incluye términas que

tratan de recoger la variabilidad debida a!a estimación de los parámetros y otro

que no los inciuye. Restringiéndanos al caso del modelo estructural más sencillo,

el paseo aleatorio con ruido, en la sección 3 comparamos el comportamiento en

muestras pequeñas de ambos estimadores propuestos mediante un estudio de

Monte Carlo.

2.

ERROR CUADRATICO MED!(J DE PREDICCION CON PARAMETROS

EST^MADOS

Supongamos que la serie observada yt, t= 1, 2,,.. T, sígue un modelo estructural

invariante en el tiempo del tipo (1.1 } que se puede representar en el espacio de

las estados como:

Yt = Z'ar + ^t

(2.1j

ar - ^ at-1 + n t

ERROR CUADRATICO MEDIO DE PRED^CCION PARA MODELOS ESTRUCTURALES DE SERIES TEMPORA^ES

11^

donde yr es la serie observada, at(kx 1) es el denominado vector estado, y

,Et, r^t(kX1} son términos de error que no están correlacionados entre si ni con el

vector estado as, s_< t, y

^^^^-NC°(^E Q))

En los modelos estructurales de series temporales, el vector estado a,^ está

formado par ios elementos que determinan los componentes no observables de

la serie, como µ^, ^r, etc. Tanto z', de orden (1 xk), como C de orden (kxk), son

matrices conocidas que no dependen de los parámetros del rnodelo y cuya

estructura es distinta para cada Modelo Estructural que estemos considerando

en particular.

Vamos a denotar por yr (nx1) al vector de parámetros del modelo (2.1), que

incluye únicamente aÉ y los parámetros contenidos en Q.

En el modelo gaussiano (2.1 }, la predicción óptima (en el sentido de ECM

m í nimo} de las obsenraciones futuras yT+s, s= 1, 2, .. . viene dada por:

YT+s/T^^^ = Z'aT+slT(W)

donde

{2.2)

ar+^r(W )= E[ar+sl Yr^ Yr-^ ^•••, Y^ ]

Esta predicción yr+^{y,) se puede interpretar como la media de la distribución

de yT+s condicionada a las observaciones hasta e incluyendo yT. Si no suponemos

normalidad en el modelo (2.1) el predictor (2.2} ya no sería la esperanza condicionada ni sería óptimo. Sin embargo, seguirá siendo el predictor lineal de ECM

mínimo.

E! ECM de prediccián asociado, es decir, la varianza del error de predicción

es:

ECMCYr+^r{v^)] = Z'Pr+^r{^) z + QZ

(2.3}

donde Pr+^rr{^) = E{[ar+s - ar+^r-r{^)][ar+s ar+^r{w)]'3

Está formula nos proporciona el ECM de predicción condicionado a los parámetros del modeio. Por lo tanto, bajo el supuesto de que el vector de parámetros

y^ es conocido, la fórmula (2.3) es correcta. Tanto el predictor ( 2.2) como su ECM

asociado (2.3) se pueden obtener aplicando repetidamen#e las ecuaciones del

filtro de Kalman al modelo (2.1), con toda la información en ia serie yt, t= 1,

2,...,T.

Si trabajamos bajo el supuesto más realista de que desconocemos los parámetros del modelo y hemos de estimarlos a partir de la muestra disponible, el

E_STAf.^151ft:A ESPAtVC7fvA

12U

criterio de actuación suele ser el siguiente. En primer lugar estimamos los parámetros de forma eficiente por máxima verosimilitud (1) y posteriormente se sustituyen en (2.2) los valores desconocidos y^ por sus estimaciones máximos

verosimiles, ^. De esta forma el predictor de yT+s con parámetros estimados es:

Yr+srri V ) ^ Z'a r+^rr{ ^ )

(2,4)

Aunque el predictor yT+^{ yr) era óptimo cuando conocíamos !os parámetros del

modelo, esto no implica que yT+^{yr} sea el predictor óptimo para un modelo con

parámetros estimados. Sin embargo, yT+^{yr) es e! pr^dictor más usado en la

práctica y, por lo tanto, nos interesa estudiar sus propiedades.

E! error de predicción cometido se puede descomponer ahora en dos partes:

.YT+s ^ YT+sJT{^) ' U' T+s ^ YT+slTC^)1 + U' T+s/T^V^) ^ YT+slT{W )J

(2.5)

donde el primer sumando recoge e! error que proviene de la parte de perturbación

aleatoria de! modelo y e! segundo, el error debido a la estimación de fos parámetros.

Como los dos sumandos de (2.5) son independientes porque hemos supuesto

que !os términos de perturbación ^t y nr son normales independientes, e! ECM

de predicción con parámetros estimados se puede escribir como:

ECMoLVr+srr{W)J = ECYr+s - Yr^srrt^)l2 + ECVr+sir(v^) ^ Yr+sir{í^j^)J2

(2.6)

donde el primer sumando viene dado por (2.3), es decir, e! ECM de predicción

con parámetros conocidos y e! segundo representa lo que añadimos al ECM de

prediccián para recoger la variabilidad muestral de !as estimaciones de los

parámetros.

Es interesante señalar que el ECM de las estimaciones de los parámetros es

de orden 1/T por io que e! aumento en el ECM de predicción es de ese orden

mientras que el ECM de prediccíón de! «verdadero» modelo es de orden 1.

Aunque e! ECM del predictor yT+s,7-(y^) viene dado por (2.6), en la práctica e!

estimador usual del ECM de predicción que se utiliza se basa simplemente en

sustituir e! verdadero valor de los parámetros desconocidos por sus estimaciones

máximo-verosimiles en la fórr^ula ( 2.3}^Pero este estimador del ECM del predictor yT+^{y^}, denotado por ECM[yT+^{^)J, presenta dos problemas fundamentales en muestras finitas. En primer lugar, no tiene en cuenta e! error que proviene

de la estimación de los parámetros y, en segundo lugar, puede presentar sesgos

(1) Véase HARVEY, A. C. y S. PETERS (1984) para una discusión sobre los distintos

métodos de estimación máximo-verosímil de los paráme#ros desconocidos de los modelos

estruc#urales.

ERRC3R CUADRATICO MEDIO DE PREDICC^I4N PARA MC.^DEI_.OS ESTRUCT ^SRAt ES UE SER ^ ES TEMF'OR.F1l ES

1^1

como estímador de la correspondiente cantidad poblacional ECM[yT.^^-(y^)] debido a que las estimaciones de las parámetros en muestras finitas pueden estar

seriamente sesgadas.

Por otra parte, la fórmula (2.6^ no nos proporciona un estimador adecuado para

el ECM de predicción ya que presenta las dificultades de ser complicada de

calcular porque el segundo sumando habria que obtenerlo por medio de simulaciones. Bloomfield (1972), Yamamoto (1976) y^8ailiie (1980) entre otros, han

estudiado este término para modelos autorregresivos y han derivado expresiones

asintóticas basadas en la distribución asintática de los parámetros estimados. AI

aplicar estos resultados asintóticos a!os estudios con muestras finitas que generalmente se realizan en la práctica, se han de tener en cuenta que las estimaciones de los paráme#ros en muestras finitas pueden estar seriamente sesgadas

y que estos sesgos se trasladarán a la distribución condicianada de las predicciones dados los valores observados de la variable endógena utilizados para

iniciar las predicciones. Además cuando predecimos estamos condicionando a

ciertos valores de la variable endógena, la distribución de las estimaciones de

las parámetros estará también condicionada y esto afectará a la distribución de

los errores de predicción. En este sentido, se han desarrollado en la literatura

estudios sobre la distribución del error de predicción con parámetros estimados

condicionada a los datos observados. Los trabajos de Phillips (1979) y Fuller y

Hasza (1981) se centran en modelos autorregresivos y el de Ansley y Kohn

(1986} en modelos en el espacio de los estados.

^

Vamos a proponer un estimador alternativo para el ECM del predictor yT+^{^^ ),

derivando una expresión analítica para el segundo sumando del segundo miembro de ( 2.6) condicionada a 1os datos observados.

Podemos observar que, sustituyendo las expresiones (2.2) y(2.4), este segundo sumando de (2.6) se puede escribir como:

^T+slT^4^Í - .yT+s^l^{^)^2 ^

(2-7)

= Z^F^^ar+^rr{^) - ar+.^r{ 4^)]^ar+^r{^^) ! ar+^{4^))'}z

lo que significa que la parte del error de predicción que proviene de la estimación

de los parámetros es una combinación lineal del error de predicción del vector

estado que proviene de ia estimacián de los parámetros. Por lo #anta, para derivar

una expresión analítica para (2.7) podemos aplicar la aproximación propuesta

por Ansley y Kohn (1986).

Ansley y Kohn (1986) derivan una aproximación al ECM de predicción del

vector estado con parámetros estimados condicionado a ia muestra, que propor-

122

ESTApISTICA ESPAÑOLA

ciona una corrección de orden 1l T a Pr+^{y^) que es la expresión usual, bajo las

siguientes condiciones de regularidad:

i)

Para T grande, T^^2( yr- yr) -- N(o, Vt^r))

ii)

La diferencia

aT+^){^^ ~ ^T+^^) ' ^T+s^Ti^} (^-^) ♦ ^p(1^^

síendo yr un punto intermedio entre yr y el verdadero valor yr, y donde

A r+^r( 4^ ^ _

aa r^srr{ ^ )

a^

y el término Op(1IT^ se puede despreciar, para tamaños muestrales grandes,

camparado con AT^^(y^) ( y^-y^).

iii)

La esperanza condicionada:

ET(V^rw} (V^-4^}'^Ar+^{^) ^ = V(V^}lT + oP(1IT)

donde --^

V es la matriz de covarianzas de {os estimadores ^r evaluada en el

T

verdadero valor de los parámetros yr.

iv)

z, C, Q tienen segundas derivadas continuas con respecto a yr.

La aproximación a! ECM de predicción es de la forma:

Pr+^r{W }+ ^ IAr+^r(W} V(w) a'r+^r(v^)l

T

Hay señalar que Ansley y Kohn no condicionan el ECM de predicción a todos

los datos sino sólo al determinante principal dei término aT+^(w)-aT+^(yr), que

es el que recoge el error que proviene de la variabilidad muestral de ias estimaciones de los parámetros.

Apiicando lá corrección anterior a los Modelos Estructurales de Series Temporales, obtenemos la siguiente aproximación a! ECM de predicción con parámetros

estimados:

ECM *^YT+s/T{W}^ -- Z'PT+s/T{^} Z+ a^ + ^^Z'AT+s^r{4^} V(^) A'T+^rl{4^}Zj

T

(Z.8)

EI último sumando de (2.8) nos da la corrección de orden 1/T que trata de

recoger !a variabilidad debida a la estimación de los parámetros. De la expresión

(2.8) podemos obtener las siguientes conclusiones: i) 1a contribución al ECM de

predicción de la estimación dei error debido a ios parámetros desaparece cuando

T tiende a infinito, resuitado que no es sorprendente ya que los parámetros han

E:RROR CU4DRATICO MEDiO DE PREDICCIOPJ F^ARA MODELOS ESTRUCTI)RAIE:S DF 5ERIES T^MF'ORAIES

1Z3

sido estirnados consistentemente; ii) la eficiencia en prediccián se puede aurnentar, es decir, reducir el ECM de predicción, si mejoramos ia eficiencia del estimador yr. Por ejemplo, si disponemos de informacián a priori sobre restricciones en

algunos elementos de y^ y podemos obtener un estimador m^ximo-verosímii

res#ringido.

Un estimador dei ECM de predicción con parametros estimados se puede

obtener sustituyendo en (2.8} los verdaderos valores de los parámetros por sus

estimaciones máximo verosimiles yr. EI estimador de ECM* [yT+^ ( yr}] depende

sólo de la muestra yr y es fácil de calcular.

3.

COMPARACION DE ERRORES CUADRATICOS MEDI^S

DE PREDICCION

En la secci^in 2 hemos presentado dos estimadores posibles dei ECM de

predicción con parámetros estimados:

n

EC'^'U' T+s^lTC^^1 = 2'PT+sfItW ^2 + Q2

ECM * CYT+^r{ ^ }l = Z' ^°T+srr( ^ )Z + a2 + ^^- [z'A r+^{ yr > V( ^W) A' r+ sr1{ V^^ >z^

Mediante un estudio de Monte Car{a vamos a analizar su comportamiento

como estimadores del verdadero error cuadrático medio de predicción con parámetros estimados, ECMoCYr♦^r{W)l,

tomando como marco de trabajo el modela

^

estructural más sencillo, el modelo de paseo aleatorio con ruido.

3.^.

Modelo de Paseo Aleatorio con ruido

Supongamos que nuestro conjunto de observaciones yr, t= 1, 2, ..., T sigue

un modeio de paseo aleatorio con ruido:

Yr=Nr+^r

(3.1)

I^t - t^r-^ + ^1r

donde

^r

^1 r

U^ a

^ IV o g ^2

n

Este modelo, está escrito directamente en el espacio de los estados cón

Z^=c=1,yG?=añ

124

FSTAD(STfCA ESF'A(VOt_A

Si conocemas los parámetros del modelo la predicción óptima de las futuras

observaciones la pademos obtener aplicando (2.2) a nuestro modelo:

donde

YT+srr{^) = mr+srr{^Y) = mT{^)

.s-1,2,...

mT^^) _ ^N T+sI YT+ YT-1 + • • • + Y1 ^

s=1,2,...

(3.2)

Por la tanto, para el modefo que nos ocupa la predicción óptima para la serie

observada es la misma que para el vector estado.

EI ECM de predicción correspondiente sería, aplicando (2.3):

ECMCY r+ slr{ ^)l = Pr+ sn{ y, >+ ^? = 1°'r( r}r ) + s 6 ñ+ Q 2

(3.3)

Si los parámetros del modelo son desconocidos, la predicción de las futuras

observaciones yT+s, denominada yTf^{y,), la podemos obtener sustituyendo en

(3.2) los verdaderos valores de los parámetros por sus estimaciones máximo-verosímiles.

EI ECM del predictor yT+^{w) lo podemos estimar a partir de ( 3.3), sustituyendo

el vector de parámetros desconocidos ( Qñ, 6É ) por sus estimaciones máximo

verosímiles, o bien derivando la expresión (2.8) correspondiente al modelo (3.1).

Antes de aplicar la aproximación (2.8) para obtener el ECM de predicción con

parámetros estimados, vamos a comprobar que las condiciones de regularidad

señaladas por Ansley y Kohn se cumplen para nuestro modelo:

i) Supongamas que estimarnos y^ maximizando la aproximación a la función

de verosimilitud en el dominio de la frecuencia siguiente:

.

T-1

L(,^,y) ^

.

T-1

^{^

^ glogc ^e'^) - n ^ - ;^

1^^

(3.4)

^^ p g^ej ^

donde ^,^ = 2nj/T^`, j= 1, ..., T^`-1, y T"k = T-d, siendo d el orden de diferenciación

necesario para que la serie (^ -L}dyt sea estacionaria. Además I(^,j) es la ordenada

correspondiente de! periodograma y g(e^^) es la función generatriz espectral que

para el modelo (3.1) es de 1a forma g(e^^`) = 6^ + 2(1-cos^,^) a^.

Bajo ciertas condiciones de regularidad, Hannan (197^) prueba que ^ es un

estimador consistente que sigue una distribución asintótica normal con matriz de

ERRUR CI_lADFZATICO MEDIC^ C)E PF^FDCCCION PAR,A ti1C.)UELO;S E7TRl1C:Tl^RAlES D^ SER^E^S Tf"ti1f'C)Ft^LE.S

^^^:^

covarianzas V(y^)/T dada por la inversa de la matriz de información. EI elernento

ih-ésimo de la matriZ de información se puede aproximar por (Harvey 1990):

a9(e^^) dg(e^)

1

1/ 2 ^ ^^ 2

aWn

a4^^

9'(e^ )

por lo que para el modelo (3.1 } la rnatriz de covarianzas de los estimadares se

puede escribir como:

1/ 2 ^g( e'^

^) -2

1/ 2 ^

2(1 - cos^,^)

^^2

9^t e^ )

2(1 - cos^,^)

4(1 - 2cos^.^)2

1/ 2^

^^ 2

1/ 2^

^^ 2

9^( e^ )

9( e^ )

(3.5)

Esta teoría asintótica no es válida cuando el modelo (3.1 } no es estrictamente

invertible. La forma reducida de un paseo aleatorio con ruido es un IMA (1, 1)

con parámetro MA -1 _< e_< o. EI modelo no es invertible cuando e=-1, valor

que corresponde a^ñ = 0. Por lo tanto, el supuesto i) sólo se cumple si 6ñ > 0.

ii)

La diferencia

^^ r+^r{ 4^ ) - rr^ r+^-r{^) = Mr+^r{ ^ ) ( 4^- ^^ ) + Op(1 / %^

donde ^v es un punto intermedio entre y^ y el verdadero valor yr y

Mr+^w) _ amr+^^)

ay^

Este supuesto se cumple si mr+^-(r^) tiene derivadas continuas de segundo

orden con respecto a yr, ya que yr es un estimadar consistente de y^.

iii) EI tercer supuesto se cumple si (y^-y^) es aproximadamente independiente

de Mr+^-( ^^ ) .

Podríamos evitar la dificultad de probar este supuesto considerando que tenemos una muestra semiinfinita o que la muestra utilizada en la estimación de los

parámetros es independiente de los valares de la variable endógena con las que

iniciamos la predicción. Los trabajos de Fuller y Hasza (1980), Reinsel (1980),

entre otros, indican que para muestras de tamaño moderado, el supuesto de tener

procesos independientes es una hipótesis de trabajo razonable.

12f

ESTApISTiCA ESPANOLA

No vamos a probar rigurosamente este supues#o, pero vamos a dar una

veriFcación heurística del m'rsmo para el modelo de paseo aleatorio con ruido.

Para muestras grandes, e! predictor óptimo de yT+s puede ser estimado por (ver

Harvey 1990):

T--1

yi+s✓T{^^ ^ mT^^V^ ^ ^^^Í ^ l1 - ^^ÍY YT-Í

j^-0

donde, ba^o ei supuesto de que el tamaño muestral T es suficientemente grande

como para que Pt alcance el estado estacionario, es decir, Pt = P^_ ^= P

^( 4^ ) = F,(

P(W) + Qñ

+ ^.2 + Q2

W>

^

P(yr) _ [-añ + (4c^ña?

F

Cl^ )1^^ ^ 2

Como se puede comprobar fácilmente 4 <[1-^.(^)] < 1, lo que implica que al

aumentar j el término [1-^,(y^)}^ decrece exponenciaimente con límite inferior cero.

Por lo tanto, para T grande, como (yr-yr) depende de todas !as observaciones de

la misma manera, podemos incluir que ( y>,-yr) es aproximadamente independiente

de MT+^{y,}.

iv)

z, C, Q #ienen segundas derivadas continuas con respecto a yr.

Por I© tanto, podemos aproximar e1 ECM de predicción con parámetros estimados apiicando la expresión (2.8) a nuestro modelo:

ECM *[.YT+^rr{4^)^ = Pr+^r{W )+ Q? + ^ IMr+^r(4^) V(^)1V1'r+^n{^)^

T

3.2.

t3.6)

Resultados obtenidos

Los estimadores prácticos dei ECM de predicción con parámetros estimados

se obtienen sustituyendo en (3.3) y(3.6) los valores de fos parámetros por sus

es#irnaciones máximo, verosimiles. Estos estimadores dependen del tamaño

muestral, T, y del verdadero valor de los parámetros de! modelo (añ,c^?). Nos

interesan fundamentalmente los resultados que obtengamos para muestras pequeñas y moderadas, por Io que hemos considerado los tamaños muestrales,

T= 25, 5^, 100 , y 200. Como valores de 1os parámetros del modeio se han

elegido, Q^ = 0.01, 0.05, 0.1, 0.5, 1, 5, 10, 50, 100 y v? = 1.

ERROR CUADRATICO MEDIO DE PREDICCION PARA AAODEIOS ESTRUCTURALES DE SERIES TEMPORALES

^ 27

Para cada tamaño muestral T y para cada par de valores (a^,a?) se generan

artificialmente N= 1.000 muestras de yt que siguen el modelo (3.1). Una vez

generadas las variables aleatorias pseudonormales, r^t y>E^, ia serie de observaciones yt se obtienen a partir det modelo (3.1), utilizando como valor inicial de1

vector estado m^ = 0. Para cada tamaño muestral T, se han generado series de

observaciones yt de tamaño T+ 100. Las 100 primeras observaciorties se rechazan para evitar que nuestros datos dependan de los valores iniciales tornados

para generar la secie. Las T observaciones siguientes se utiíizan para estimar los

parámetros del modelo.

Para cada tamaño muestral T y para cada par de valores ( Q^, c^^ ) se han

calculado los siguientes estad ísticos:

1)

N

sQ^

+

Q2

+

^

ECMo^.Yr+srrE4^}^ - P^(^) +

^ [mr+^rtW ) - mr^^r{^)j^

N

2)

la

1

ECM(yr+^r(^)] = P^t^) + S^ñ + ^

N

N

3)

[Pr( 4^ ) + sQ2n+ QÉ ] ^^

ECM[yr+ ^r( ^ }] = ^ ^ ECA^II.Yr+ ^r{ 4r )] ^^ _ ^ ^

N ;a ^

N ^_ ^

4)

*

N

V M' T+ s/T{ 4^ )];

ECM [yT+ s/T{ W)] - P7{ yr )+ s Q ^+ Q? + ^ ^ ^MT+ s^rT( ^)-^--^

N ^^

T

5}

^ *

,^ ^ 1 N

^

^^ ^2

^

"

^ [Pr(^) + san + aF + MT+^{V^) V(T.#^) ^r+^r(V^)];

ECM [yr+^r{^)l

N fa ^

La cantidad (2) se caicu{a analíticamente asi camo la primera parte de (1) y

(4), mientras que el segundo sumando de (1) y (4) así como (3), y(5) se obtienen

mediante simulación. Existen distintas alternativas para calcular el ECM del

predictor yr+^{y,), como la utiiizada por Spitzer y Baillie (1983), que generan más

observaciones de la serie yr, y evalúan el ECM de predicción con parárnetros

estimados directamente por simulación. ^Sin embargo, ten^endo en cuenta que

queremos comparar los estimadores ECM[yT+^,T{ y^)j y ECM'k[yT+s^-( y^)] con un

valor del verdadero ECM de predicción con parámetros estimados que no esté

sujeto a grandes variabilidades muestrales, la ventaja de usar la descomposición

(2.6) es que nos permite hallar una parte importante del ECí1/I de predicción

analíticamente y, por lo tanto, es de esperar que nos proporcione estimaciones

más precisas.

Los parámetros del modelo ( a^,a?) se estiman por Máxima Verosimilitud en el

dominio de la frecuencia, maximizanda la función ( 3.4). Estrictamente hablando,

128

ESTADISTICA ESPAÑOLA

la expresián (3.4) sólo es igual a la función de verosimilitud si la serie estacionaria

cumple la condición de circularidad. Camo esta condícián es poco realista en

nuestro contexto de trabajo, es mejor considerar la función (3.4} como una

aproximación a la función de verosimilitud exacta. Esta función de verosimilitud

exacta se puede obtener en el dominio del tiempo mediante la descomposición

de los errores de predicción, que se obtienen junto con sus varianzas aplicando

las recursiones del filtr© de Kalman. En el caso de los modelos no estacionarios

como son, en general, los modelos estructurales de series temporales, es preciso

tener cuidado con las condiciones iniciales que se utilizan para el filtro de Kalman.

Para calcular las cantidades (1)-(5) es necesario obtener tanto la estimación

de m^{^r) como su error cuadrático medio P^(yr) evaluados para el verdadero

valor de los parámetros y para los parámetros estimados. Ambas cantidades se

obtienen mediante las recursiones de predicción y actualización del filtro de

Kalman inicializadas can mo = 0 y el prior difuso Po = k, donde k es un número

arbitrariamen#e grande. En el programa que ha realizada e! cálculo de estos

estadísticos no se impone la condición de que PT alcance el estado estacionario,

pero para el rnodelo (3.1) este estado se alcanza incluso para muestras de

tamaño T = 25.

A la hora de obtener los estadísticos (4) y(5) es preciso calcular el vector de

derivadas M+

, amT^^ . Estas derivadas del vector estado se

r ^r{ ^ } = amT+^

aQn2

aQ^2

han calculado analíticarnente y el conjunto de recursiones se corren de forma

paralela al filtro de Kalman, siendo ínícializadas como sigue:

amo _ arno _ aPo i aPo _ p

aQn a^? aQ^ a^?

Los estadísticos (1)-(5) han sido calculados para tres horizontes de predicción

s= 1, 3, 12. Para el modelo (3.1) que estamos considerando el predictor de yT+s,

s= 1, 2,... viene dado par (3.2} que es !a estimación de! vector estado en el

momento T: m^. Por lo tanto, como la corrección de orden 1/T al ECM de

predicción con parámetros estimados que hemos propuesto depende sólo de la

estimación del vec#ar estado en el momento T y de la matriz de covarianzas de

las estimadores, que son las mismas para todo s, sólo es necesaría calcularla

una vez para cada terna ^T,vñ,Q?) o(T,^ñ,^?).

Todos los cálcuios han sido realizados en un ordenador Hewlett-Packard serie

500. EI programa de Fortran utilizado ha sido escrito en doble precisión. La

estimación de los parámetros se Ileva a cabo maximizando 1a función de verosimilitud (3.4) mediante el algoritmo de scoring que presenta las ventajas de utilizar

sólo las primeras derivadas de ^la función de verosimilitud (como hemos visto la

ERROR CUAORATICO MEDIO DE PREDICCION PARA MODELOS ESTRUCTURALES DE SERI^ES TEMPORAi`ES

^Z^

matriz de información depende únicamente de ellas}, y de proporcionar directamente la matriz de covarianzas para los estimadores (3.5}. Los criterios de

convergencia utilizados para terminar las iteraciones han sido los habituales: i)

la diferencia entre parámetros sea menor de 10^4; ii) la diferencia entre los valores

de ia función sea menor que 10-$. En este trabajo se ha elegido la función de

verosimilitud (3.4}, en lugar de los mátodos en el dominio del tiempo, porque la

experiencia de cálculo de estimadores máximo-verosímiles para muestras pequeñas y moderadas, menores de 200, nos señala que los mátodos de estimación

en el dominio de la frecuencia son mucho más rápidos que en el dominio del

tiempo, y que el algoritmo de scoring proporciona muy buenos resultados en 1a

mayoría de los casos.

^os resultados obtenidos en las simulaciones para el modelo (3.1) se encuentran reflejados en los cuadros 1 y 2.

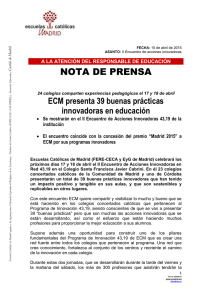

En primer lugar, hemos tratado de estudiar la importancia cuantitativa de los

problemas que plantea utilizar directamente un estimador de ECM[yT+^{^r)] para

calcular el ECM de predicción con parámetros estimados.

Por un lado, un estimador de ECM[yT+^{y,)] no tiene en cuenta que los

parámetros del modelo han sido estimados y que el error que proviene de ia

estimación de los parámetros producirá un incremento en el ECM de predicción

de manera que:

ECMo[YT+^r{W)] ^ ECMCYT+^r{V^)l

En la primera columna del Cuadro 1, se presentan para cada tamaño rnuestral

T, para cada valor del parámetro Qñ y para el horizonte de predicción s= 1, los

resultados de calcular la razón:

_ ^^^/% U' T+s/7{ ^ )^

R^ ^ EC^

CYT+^r{ ^w )]

con la que tratamos de medir los efectos de la variabilidad muestral de las

estirnaciones de los parámetros en el error cuadrático medio de predicción. Por

ejemplo, para ^? = 0.1 y T= 25, ECMo[yT+S,T{yJ)] es un 10 por 100 mayor que el

ECM[yT+s^(y^)]. Podemos observar que los efectos más serios se producen para

valores pequeños de a^, es decir, cuando nos encontramos cerca de la zona de

no invertibilidad. Esta razón disminuye, en general, conforme aumenta el parámetro Qñ, estabilizándose en torno al 4 ó 5 por 100, y decae rápidamente con el

tamaño muestral T.

130

ESTADISTICA ESPA^LA

^

CUADR01

^

ECM[yT♦^{yr)] como estimador del ECM de prediccián con parámetros

estirnados

T= 50

T= 25

T= 200

T= 100

R^

R2

R^

R2

R^

R2

R1

R2

Q? = 4^01

1.11

1.13

1.07

1.09

1.03

1.05

1.02

1.03

o^= 0.05

1.09

1.06

1.06

1.02

1.02

1.01

1.01

1.01

Qz

^-- p.1

1.10

1.06

1.04

1.05

1.02

1.04

1.0 ^

1. 02

,^2^-- p_5

1.05

0.97 ^

1.02

1.01

1.01

1.02

1.00

1.00

Q2

n-- 1.00

1.03

0.96

1.03

0.98

1.01

1.00

1.01

1.01

Q^ = 5.00

1.05

1.03

1.01

1.02

1.01

1.01

1.01

1. 00

Q^_^ o.ao

1.04

0.96

1.02

1.01

1.01

1.01

1.00

0.99

Q^= 50.00

1. 06

0. 93

1.03

0.98

1.01

0. 99

1.01

1. 00

Q^ = 100.0

1.04

0.99

1.02

1.01

1.01

1.00

1.00

1.00

n

Por otro lado, nos interesa c^omprobar ia calidad de ECM[yT+^(^)] como

estimador de su correspondiente cantidad poblacional ECM[yT+^-(y^)]. La columna R2 del Cuadro 1 trata de recoger los sesgos en la estimación de ECM[yT+^{y,}j

debidos a los sesgos en la estimación de ^os parámetros a través de la razón:

n

_ ECM CYT+^r{W )1

^2 ECM CYT+$rr( ^ )l

^

Se puede observar que para valores de Q^ pequeños, ECM[yT+^-{^r)j está sistemáticamente sesgado hacia arriba, hasta un 13 por 100 para T= 25 y un 9 por

100 para T= 50. Estos sesgos en la estimación de ECM[yT+,^{y ^ )] van disrninuyendo conforme aumenta añ y nos alejamos de la zona de no invertibilidad del

modelo, hasta cambiar de signo y, asi, para valores grandes de Q^, el estimador

n

ECM[yT♦^{ y,)] está sesgado hacia abajo, por ejemplo para Q^ = 50, es un 93 por

100 de ECM[yT+^{^r)]. Estos sesgos desaparecen rápidamente con el tamaño

muestral.

Los resultados obtenidos en la zona de no invertibilídad del modelo (valores

pequeños de 6ñ) pueden estar influenciados por el método de estimación elegido.

Los distintos métodos de estimación máximo-verosímil tienen las mismas propiedades asíntóticas, aunque pueden tener propiedades en muestras pequeñas

ERROR CUADRATICO MEDIO DE PREDICCION PARA AAODEIOS ESTRUCTURAIES DE SERiES TEMPORALES

131

diferentes. Harvey y Peters { 1984) realizan un pequeño ejercicio de simulación

en el que abtienen que las mayores diferencias entre fos estimadores en el

dominio del tiempo y el dorninio de la frecuencia aparecen cuando !os parámetros

de varianza están práximos a cero, aunque no hay evidencia clara de la dirección

del sesgo de ambos estimadores en esta zona práxima a la no invertibilidad.

^

^n el Cuadro 2 comparamos el camportamiento de ECM^yr♦ ^(yr)] y

ECM*(yr+^{ y^}] como estimadores de ECMo[yr+^{yr)] a través de !as razones:

n

__ ECM CYr+^(W )]

R3 ECMo CYT+^r{ 4^?]

^

_ ECM LYr+^{ ^ )l

ECMo IYr+^r( v^ )I

R4

Con el fin de comprobar la validez de la aproximación asintetica elegida, se

presentan también los resultados obtenidos para el estadístico ECM*[yT+^{y^ )]

mediante el cálculo de la razón:

*

_ ECM ^yr+^r( ^Y )]

R5

ECM0 U' T+s✓T{ ^ )]

n

En general el estimador ECM [yT+,^y^)] subestima el verdadero ECM de predicción con parámetros estimados. Esta subestimación aumenta de forma considerable conforme crece el horizonte de predicción s. Por ejemplo, para 6^ = 50,

n

^

el ECM[yT+^{ yr)] es el 88 pc+r 100 del verdadero ECM de prediccien para s= 1,

pasa a ser el 73 por 100 para s= 3 y se reduce al 67 par 100 para s= 12.

Podemos concluir que los efectos de la estimación de los parámetros en el ECM

de predicción son importan#es y deben ser tenidos en cuenta, sobre todo en

muestras pequeñas, T= 25, 50, como era de esperar. Por^lo tanto, ^arece

conveniente utilizar el estimador alternativo que proponemos ECM'"`[yT+^(y^)] que

corrige esta subestimación en la dirección adecuada aunque no siernpre en la

proporcien suficiente para solucionar totalmente el probfema. Por ejempio, para

62

n = 50 y s= 1 e! E^M^'"`[yT♦ S^( y^)] es el 92 por 100 del verdadero ECM. Además

podemos observar, que como era de esperar, la proporción en que el estimador

alternativo corrige la subestimación del verdadero ECM de predicción es menor

conforme el horizonte de predicción es más largo.

Las únicas excepciones al comportamiento anteriormente señalado se producen cuando nos encontramos con valores de o^ñ muy pequeños, cercanos a la

zona de no invertibilidad. En este caso habíamas observado en el Cuadro 1 que

tanto los efectos de la variabilidad muestral en las estimaciones de los parámetros como los sesgas en los e^tirnadores de las mi^mos apuntan en la misma

dirección y hacen que tanto ECM[yT+sn-{ y^)] como ECM'k[yT+sn{^,)] sobreestimen

el verdadero ECM de prediccien en cantidades que aunque no son muy importantes para s = 1, aumentan rápidamente con el h©rizonte de predicción.

132

ESTAOISTICA ESPAÑOLA

CUADRI^ 2

Comparación de Errores Cuadráticos Medios de Prediccián

con parámetros estimados

s=3

s=1

s=12

T

R^

R{

R^

R3

R4

RS

R^

R^

R5

Q2 - a.o^

^!

25

50

100

200

1.02

1.01

1.02

1.02

1.05

1.03

1.03

1.02

0.93

0.95

0.98

0.99

1.19

1.09

1.06

1.03

1.21

1.11

1.06

1.04

0.97

0.95

0.98

0.99

1.86

1.43

1.21

1.11

1.88

1.45

1.22

1.12

0.93

0.95

0.98

0.99

a^= 0 . 05

25

50

100

200

0.97

0.97

0.99

1. 00

1.00

0.98

1.00

1. 01

0.95

0.97

0.99

1.00

1.12

1.04

1.03

1.02

1.15

1.05

1.04

1.02

0.95

0.97

0.99

1.00

1.60

1.26

1.14

1. 06

1.62

1.27

1.14

1.06

0.96

0.98

0.99

1.00

QZ _- 0.1

^

25

50

100

2 00

0.97

1.01

1.02

1. 01

1.00

1.03

1.03

1. 02

0.95

0.99

0.99

1. 00

1.10

1.07

1.05

1. 0 3

1.13

1.09

1.06

1. 0 3

0.96

0.99

0.99

1. 00

1.45

1.21

1.11

1. 06

1.47

1.22

1.12

1. 06

0.97

0.99

1.00

1. 00

Q2 _- 0.5

^

25

50

100

200

0.92

0.98

1.00

1. 00

0.96

1.00

1.02

1. 00

0.99

1.00

1.00

1.00

1.00

1.02

1.03

1. 00

1.03

1.04

1.03

1.01

1.00

1.00

1,00

1.00

1.10

1.08

1.05

1. 01

1.11

1.08

1.05

1. 01

1.00

1.00

1.00

1. 00

Q2 __ ^ 0

^

25

50

100

200

0.93

0.95

0.98

1.01

0.96

0.97

1.00

1.01

0.99

1.00

1.00

1.00

0.94

0.97

0.99

1.01

0.95

0.99

1.00

1.01

1.00

1.00

1.00

1.00

0.94

0.99

1.00

1.01

0.95

1.00

1.00

1.01

1.00

1.00

1.00

1.00

^? = 5.0

^

25

50

100

200

0.98

1.00

1.00

1.00

1.02

1.02

1.01

1.00

1.00

1.00

1.00

1.00

0.89

0.96

0.99

0.99

0.91

0.96

0.99

1.00

1.00

1.00

1.00

1.00

0.84

0.93

0.98

0.99

0.84

0.93

0.98

0.99

1.00

1.00

1.00

1.00

Q2 _ ^ 0 0

n -

25

50

100

200

0.93

0.99

1.00

0.98

0.96

1.01

1.02

0.99

0.99

1.00

1.00

1.00

0.82

0.91

0.96

0.97

0.83

0.92

0.96

0.97

1.00

1.00

1.00

1.00

0.76

0.87

0.94

0.96

0.77

0.87

0.94

0.96

1.00

1.00

1.00

1.00

Q^

^-- 50.0

25

50

100

200

0.88

0.96

0.98

1.00

0.92

0.98

0.99

1.00

0.99

1.00

1.00

1.00

0.73

0.84

0.89

0.94

0.75

0.84

0.90

0.94

1.00

1.00

1.00

1.00

0.67

0.79

0.86

0.92

0.68

0.79

0.86

0.92

1.00

1.00

1.00

1.00

v2^-- 100.0

25

50

100

200

0.95

0.98

0.99

0.99

0.98

1.00

1.00

1.00

1.00

1.00

1.00

1.00

0.79

0.86

0.90

0.93

0.80

0.87

0.90

0.93

1.00

1.00

1.00

1.00

0.72

0.81

0.87

0.91

0.73

0.81

0.87

0.91

1.00

1.00

1.00

1.00

ERROR CUADRATICO MEDtO DE PREDICCION PARA MODELOS ESTRUCTURALES DE SERIES TEMPORALES

133

Si observamos los resultados obtenidos para ECM*[yT+^{y,)] vemos que funciona muy bien para todo tamaño muestral y para todos los valores de c^^, por lo

que parece que la aproximación asintótica es adecuada. Sin embargo,

ECM*[yT+^(y^)] no es un estimador factible del verdadero ECM de predicción con

parámetros estimados.

4.

CoNCLUSIONES

En este trabajo se ha estudiado la distribución del error de predicción bajo el

supuesto de que los parámetros son desconocidos y hay que estimarlos previamente. Para ello, se han propuesto dos estimadores alternativos del ECM de

predicción con parámetros estimados, uno que tiene en cuenta explícitamente en

cu^enta el error de predicción que provien^e de la estirnación de los parámetros,

ECM*`[yT+^{^^ )], y otro que no lo tiene, ECM[yT+^{^r)].

^

EI ECM de predicción alternativo que hemos derivado, ECM*[yT+^{yr)], es una

aproximación al ECM de predicción con parámetros estimados condicionado a

lo^ datos, ^ proporciona una corrección de orden 1 I T al estimador usual

ECM[yT+^{y,)], que trata de recoger el error generado por la variabilidad muestral

en la estimación de los parámetros.

Esta aproximación ha sido obtenida dentro del marco de los madelos en el

espacio de los estados. Teniendo en cuenta que ésta es una clase de mode{os

lineales muy general que incluye entre otros a los modelos estructurales de series

temporales y los modelos ARIMA, podemos aplicar la fórmula ECM*[yT+^{y^)]

para estimar el ECM de predicción con parámetros estimados dentro del campo

de los modelos estructurales que son el objetivo fundamental de nuestro estudio.

Tomando corno base el modelo estructural más sencillo, el modelo de paso

aleatorio con ruido, he Ilevado a cabo un sencillo estudio de simulación para obtener

algunas indicaciones sobre el camportamiento de los dos estimadores propuestos:

i)

ii)

Los efectos de la variabilidad muestral de las estimaciones de los parámetros en el ECM de predicción con parámetros estimados, son bastante

importantes.

^

EI estimador ECI^I^`[yT+s^{yr)] subestima, en general, el verdadero ECM de

predicción con parámetros estimados. Los efec#os son mayores para

tamaños muestrales pequeños, para valores de c^ñ próximos a la zona de

no invertibilidad y para horizontes de predicción largos. EI estimador

alternativo c^ue se ha propuesto corrige esta subestimación en la dirección

deseada aunque no siempre en la proporción suficiente para solucionar

totalmente el problema.

13d

ESTADISTiCA ESPAlJ^OLA

Si estudiamos el comportamiento de ECM*[yT+^(^^ )] para distintos valores

de T, Qñ y s, podemos concluir que la aproximación asintótica utilizada es

apropiada; el problema es que no se trata de un estimador factible.

En principio, pademos aplicar la aproximación al ECM de predicción con

parámetros es#imadios dada por ECM*[yT#^{yr)J, a modelos estructurales de

series temporales m^s complejos, a condición de comprobar que las condiciones

de regularidad necesarias se cumplen para cada modelo.

REFERENCIAS

AN^3ERSaN, B. D. O. y MooRE, J. B. (1979). Optimai Filtering, Englewoad Cliffs:

Prentice Hall.

ANSLEY, C. F. y KoHN, R. (1986). Prediction mean squared error for state space

models with estima#ed parameters, Biometrika, 76, 467-473.

BAILLIE, R. T. (1980}. Predictions for ARMAX models, Journal of Econometrics,

12, 365-314.

BLOOMFIIELD, P. (1972}. On the error of prediction of a time series, Biometrika, 59,

501-507.

FULLER, r/1/. A. y HASZA, D. P. (1980). Predictors for the first-order autoregressive

process, Journal of Econometrics, 13, 139-157.

FULLER, W. A. y HASZA, D. P. (1981). Properties of predictors f©r the autorregresive

time series, Journal of the American Statistical Association, 76, 155-161.

HANNAN, E. J. (1970). Multiple Tirne Series, New York: John vviley.

HARVEY, A. C. (1983). The formulation of Structural Time Series Models in discrete

and continuous time, Questioo, 7, 563-575.

HARVEY, A. C. (1990). Forecasting, Structural Time Series Models and the Kalman

Filter, Cambridge Academic Press.

HARVEY, A. C. y PETERS, S. (1984). Estimation procedures for Structural Time

Series Models, LSE Econometrics Programme, Discussion Paper núm. A44.

PHILLIPS, P. C. B. (1979), The sampling distribution of forecasts from a first order

autoregresion, Journal af Econometrics, 9, 241-261.

PiERCE, D. A. (1975). Forecasting in dynamic models with stochastic regressors,

Journal of Econometrics, 3, 349-374.

^

ERROR CUADRATICO MEO10 DE PREDICCIOW PARA MODEI.OS ESTRUCTURALES DE SERIES TEMF'ORALES

1^^

RE^rvsE^, G. { 1980), Asymptotic properties of prediction errors for the muftivariate

autoregressive rnode{ using estimated parameters, Journal of the Roya/ Statistical Society, Series B, 42, núm. 3, 328-333.

SPITZER, J. J. y^AILLIE, R. T. (1983). Sma{f sample properties of predictions from

the regression model with autoregressive errors, Journal of fhe American Statistica/ Association, 78, 258-263.

YannAMC^TO, T. (1976), Asymptotic mean squared error prediction for an autoregresive model with estimated coeff cients, Applied Statistics, 25, 123-127.

SUMMARY

FORECASTING MEAN SQUARED ERROR FOR STRUCTURAL TIME

SERIES MODELS

A simulation study is carried out to examine the behaviour in small

samples of various estimators of the forecasting mean squared error

(MSE) with estirnated parameters. The attention is focused on the

class of Structural Time Series Models.

Two practical estimates of the forecating MSE, one of which includes

terms reflecting parameter estimation and one which exludes these terms,

are compared to the mean squared error of forecast for the simplest

structural model, the random walk plus noise model, considering different

values of the parameters of the mode! and different sample sizes.

Key wt^rds: Kalman Filter, Structural Models, Forecasting Mean Squared error, maximum likelihood estimation.

AMS Classification: 62M 10.