TEMA 5 DISTRIBUCIONES BIDIMENSIONALES

Anuncio

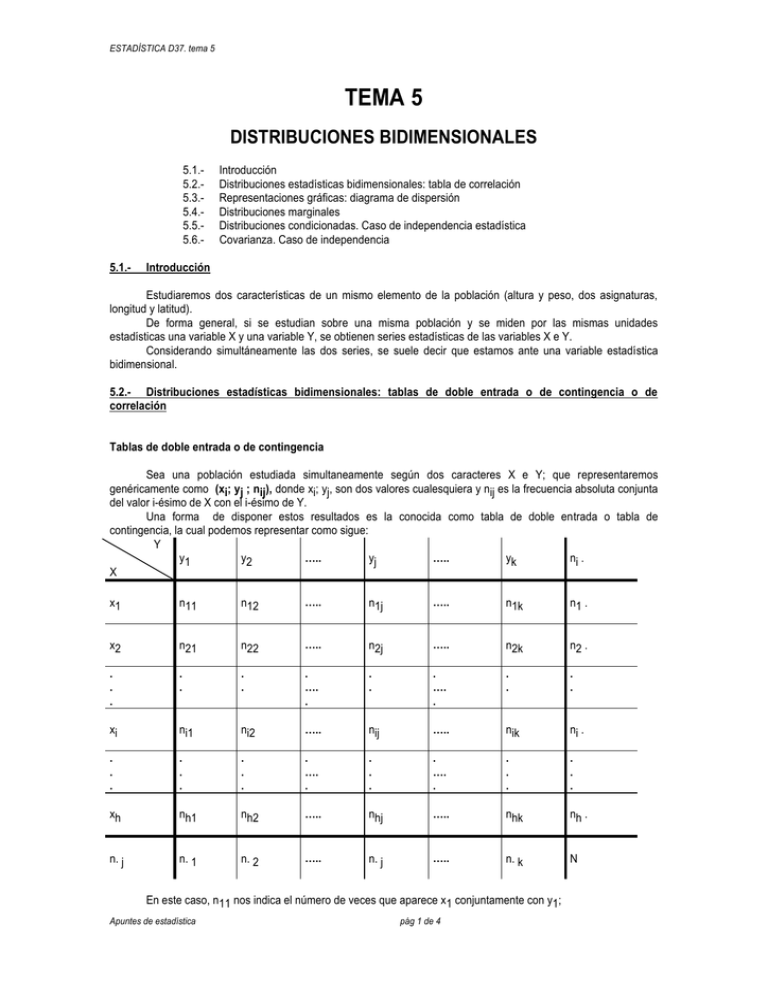

ESTADÍSTICA D37. tema 5 TEMA 5 DISTRIBUCIONES BIDIMENSIONALES 5.1.5.2.5.3.5.4.5.5.5.6.5.1.- Introducción Distribuciones estadísticas bidimensionales: tabla de correlación Representaciones gráficas: diagrama de dispersión Distribuciones marginales Distribuciones condicionadas. Caso de independencia estadística Covarianza. Caso de independencia Introducción Estudiaremos dos características de un mismo elemento de la población (altura y peso, dos asignaturas, longitud y latitud). De forma general, si se estudian sobre una misma población y se miden por las mismas unidades estadísticas una variable X y una variable Y, se obtienen series estadísticas de las variables X e Y. Considerando simultáneamente las dos series, se suele decir que estamos ante una variable estadística bidimensional. 5.2.- Distribuciones estadísticas bidimensionales: tablas de doble entrada o de contingencia o de correlación Tablas de doble entrada o de contingencia Sea una población estudiada simultaneamente según dos caracteres X e Y; que representaremos genéricamente como (xi; yj ; nij), donde xi; yj, son dos valores cualesquiera y nij es la frecuencia absoluta conjunta del valor i-ésimo de X con el i-ésimo de Y. Una forma de disponer estos resultados es la conocida como tabla de doble entrada o tabla de contingencia, la cual podemos representar como sigue: Y ….. ….. y1 y2 yj yk ni . X x1 n11 n12 ….. n1j ….. n1k n1 . x2 n21 n22 ….. n2j ….. n2k n2 . . . . . . . . . …. . . . . …. . . . . . xi ni1 ni2 ….. nij ….. nik ni . . . . . . . . . . . …. . . . . . …. . . . . . . . xh nh1 nh2 ….. nhj ….. nhk nh . n. j n. 1 n. 2 ….. n. j ….. n. k N En este caso, n11 nos indica el número de veces que aparece x1 conjuntamente con y1; Apuntes de estadística pág 1 de 4 ESTADÍSTICA D37. tema 5 n12, nos indica la frecuencia conjunta de x1 con y2, etc. 5.3.- Representaciones gráficas: diagrama de dispersión o nube de puntos Representamos en ejes coordenados, una de las dos variables en el eje X, y la otra en el eje Y. Para indicar el número de coincidencias, o bien ponemos símbolos diferentes, o bien indicamos entre paréntesis, el número n ii. Nube de puntos Pesos (kg.) 82 77 72 67 62 57 150 155 160 165 170 175 180 Alturas (cm.) 5.4.- Distribuciones marginales Dada la distribución bidimensional (xi ; yj ; nij), se llaman distribuciones marginales a cada una de las dos distribuciones unidimensionales que se pueden obtener, de forma que en cada una de ellas no se tenga en cuenta la otra, es decir, dada la siguiente distribución bidimensional; Y X y1 y2 y3 y4 ni. x1 n11 n12 n13 n14 n1 . x2 n21 n22 n23 n24 n2. x3 n31 n32 n33 n34 n3 . x4 n41 n42 n43 n34 n4. n.j n.1 n.2 n.3 n.4 N podemos obtener las siguientes distribuciones marginales X Y xi ni. yj n.j x1 n1. y1 n.1 x2 n2. y2 n.2 x3 n3 . y3 n.3 x4 n4. n y4 n.4 n Por tanto, podemos decir: Apuntes de estadística pág 2 de 4 ESTADÍSTICA D37. tema 5 n N i 1 j 1 n j . n. j nij n 5.5.- Distribuciones condicionadas. Caso de independencia estadística Al poner una restricción o condición a una de las dos variables, tenemos las distribuciones condicionadas. Se las suele representar como: X/Y , indica que el valor de X viene condicionado por Y Y/X indica que el valor de Y viene condicionado por X Independencia estadística Se dice que dos variables X e Y son independientes estadísticamente cuando la frecuencia relativa conjunta es igual al producto de las frecuencias relativas marginales en todos los casos, es decir: nij n n. j Para todo i, j i .·· n n n Si esto no se cumple para todos los valores se dice que hay dependencia estadística. 5.6.- Covarianza. Caso de independencia En el estudio conjunto de dos variables, lo que nos interesa principalmente es saber si existe algún tipo de relación entre ellas. Esto se ve gráficamente con el diagrama de dispersión. Veremos ahora una medida descriptiva que sirve para medir o cuantificar esta relación: n k S xy i 1 j 1 ( x i x )( y j y )n ij n Si Sxy >0 hay dependencia directa (positiva), es decir a grandes valores de x corresponden grandes valores de y. Si Sxy = 0 las variables están incorreladas, es decir no hay relación lineal. Si Sxy < 0 hay dependencia inversa o negativa, es decir a grandes valores de x corresponden grandes valores de y. Gráficamente, indicaría la Covarianza, que los datos, se ajustan a una recta, en los siguientes casos: Sxy >0 Sxy<0 PROPIEDADES DE LA COVARIANZA: 1.- Si a todos los valores de la variable x, les sumamos una constante k y a todos los valores de la variable y les sumamos una constante k’, la covarianza no varía. 2.- Si a todos los valores de una variable x los multiplicamos por una constante k y a todos los valores de la variable y los multiplicamos por una constante k’, su covarianza queda multiplicada por el producto de las constantes. 3.- A partir de las anteriores: si tenemos dos variables x, y con la covarianza Sxy, y transformaciones lineales de las variables de la forma z=ax+b, y t=cy+d, la nueva covarianza se relaciona con la anterior de la forma: Szt=acSxy. Apuntes de estadística pág 3 de 4 ESTADÍSTICA D37. tema 5 4.- Otra forma de calcular la Covarianza sería: S xy i x i y j n ij n j X Y . Será la que utilizaremos en la práctica. NOTA: El inconveniente de la covarianza, como medida de asociación es su dependencia de las unidades. Habrá que definir una nueva medida, que no está afectada por los cambios en las unidades de medida. Esta medida será el coeficiente de correlación lineal rxy, con la siguiente expresión: S xy r xy Sx Sy siendo Sx y Sy las desviaciones típicas de x e y. Este coeficiente es adimensional y siempre estará entre –1 y 1. Si hay relación lineal positiva, rxy>0 y próximo a 1. Si hay relación lineal negativa rxy<0 y próximo a –1. Si no hay relación lineal rxy será próximo a 0. Nota: Cuando las variables x e y son independientes, Sxy =0, y por tanto rxy=0. Es decir, si dos variables son independientes su covarianza vale cero. No podemos asegurar lo mismo en sentido contrario. Si dos variables tienen covarianza cero, no podemos decir que son independientes. Sabemos que linealmente no tienen relación, pero podrían tener otro tipo de relación y no ser independientes. Ejemplo: A partir de los siguientes datos, vamos a calcular la Covarianza y el coeficiente de correlación: Altura Peso 175 180 162 157 180 173 171 168 165 165 80 82 57 63 78 65 66 67 62 58 Los cálculos que necesitamos: x 169'6 s xy s x 7'2139 s y 8'7567 y 67'8 175 80 180 82 162 57 169'6 67'8 52'32 10 Ahora se puede calcular el coeficiente de correlación lineal rxy y el de determinación lineal R2 52'32 rxy 0'8282 7'2139 8'7567 que nos indica que las variables están relacionadas. Apuntes de estadística pág 4 de 4