ANALISIS DE REGRESION LINEAL

Anuncio

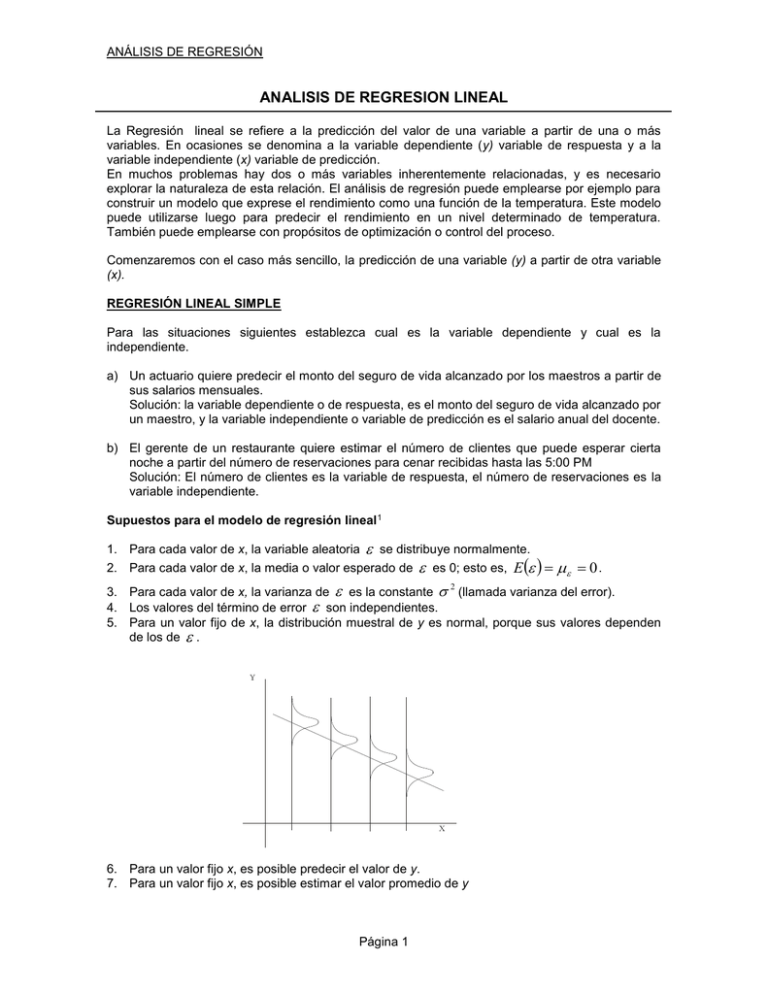

ANÁLISIS DE REGRESIÓN ANALISIS DE REGRESION LINEAL La Regresión lineal se refiere a la predicción del valor de una variable a partir de una o más variables. En ocasiones se denomina a la variable dependiente (y) variable de respuesta y a la variable independiente (x) variable de predicción. En muchos problemas hay dos o más variables inherentemente relacionadas, y es necesario explorar la naturaleza de esta relación. El análisis de regresión puede emplearse por ejemplo para construir un modelo que exprese el rendimiento como una función de la temperatura. Este modelo puede utilizarse luego para predecir el rendimiento en un nivel determinado de temperatura. También puede emplearse con propósitos de optimización o control del proceso. Comenzaremos con el caso más sencillo, la predicción de una variable (y) a partir de otra variable (x). REGRESIÓN LINEAL SIMPLE Para las situaciones siguientes establezca cual es la variable dependiente y cual es la independiente. a) Un actuario quiere predecir el monto del seguro de vida alcanzado por los maestros a partir de sus salarios mensuales. Solución: la variable dependiente o de respuesta, es el monto del seguro de vida alcanzado por un maestro, y la variable independiente o variable de predicción es el salario anual del docente. b) El gerente de un restaurante quiere estimar el número de clientes que puede esperar cierta noche a partir del número de reservaciones para cenar recibidas hasta las 5:00 PM Solución: El número de clientes es la variable de respuesta, el número de reservaciones es la variable independiente. Supuestos para el modelo de regresión lineal 1 1. Para cada valor de x, la variable aleatoria se distribuye normalmente. 2. Para cada valor de x, la media o valor esperado de es 0; esto es, E 0 . 3. Para cada valor de x, la varianza de es la constante (llamada varianza del error). 4. Los valores del término de error son independientes. 5. Para un valor fijo de x, la distribución muestral de y es normal, porque sus valores dependen de los de . 2 6. Para un valor fijo x, es posible predecir el valor de y. 7. Para un valor fijo x, es posible estimar el valor promedio de y Página 1 ANÁLISIS DE REGRESIÓN 1 Ejemplo 1: La revista Motor Trend presenta con frecuencia datos de rendimiento para automóviles, que compara el tamaño del motor en pulgadas cúbicas de desplazamiento (pcd) y las millas por galón (mpg) estimadas para ocho modelos representativos de automóviles subcompactos modelo 1984. tamaño del motor (pcd) x 121 120 97 98 122 97 85 122 coches compactos Chevrolet Cavalier Datsun Nissan Stanza Dodge Omni Ford Escort Mazda 626 Plymouth Horizon Renault Alliance/Encore Toyota Corolla millas/galón (mpg), y 30 31 34 27 29 34 38 32 Graficando los datos de la tabla en el “diagrama de dispersión” podemos observar la colección de los ocho pares de datos (x,y) como muestra de una población de pares, donde las medidas pulgadas cúbicas de desplazamiento (pcd) “x” pueden tomar cualquier valor en el rango de valores que se extiende de 85 a 122. Para cada pcd posible hay muchos millajes asociados con ella. Por ejemplo para un tamaño del motor de 97 hay un gran número de millajes asociados, uno por cada coche cuyo tamaño sea 97 pcd. Asumamos que existe una relación lineal para la población de pares de datos de pcd y mpg. (Se entiende por relación lineal cuando la variable y tiene una tendencia a crecer o decrecer, cuando la variable x aumenta). Diagrama de dispersión 39 37 35 m 33 p 31 g 29 27 25 80 90 100 110 pcd ddci d 1 Estadística, Richard C.Weimer, CECSA, Segunda edición, 2000 Página 2 120 130 ANÁLISIS DE REGRESIÓN Usamos el modelo probabilístico siguiente para explicar el comportamiento de los millajes para las ocho medidas de tamaño de motor, este se llama modelo de regresión lineal, y expresa la relación lineal entre tamaño de motor (x) y millas por galón (y). Modelo de regresión lineal y 0 1 x Donde y = variable dependiente 0 ordenada al origen 1 = pendiente x = variable independiente = Error aleatorio La expresión 0 1 x se denomina componente determinística del modelo de regresión lineal. La muestra de pares de datos se usará para estimar los parámetros 0 y1 de la componente determinística. La diferencia principal entre un modelo pobabilístico y uno determinístico es la inclusión de un término de error aleatorio en el modelo probabilístico. En el ejemplo los diferentes rendimientos para un mismo tamaño de motor se atribuyen al término de error en el modelo de regresión. Cálculo de la ecuación de regresión También es llamada ecuación de predicción de mínimos cuadrados. La ecuación de regresión estimada es: yˆ b0 b1 x. Donde: ŷ Valor predicho de ŷ para un valor particular de x. b0 = Estimador puntual de b1= Estimador puntual de 0 .(ordenada al origen) 1. (pendiente) Para el cálculo de b0 y b1 se utilizamos las siguientes fórmulas: x 2 SSx x 2 n y 2 SS y y 2 n Página 3 ANÁLISIS DE REGRESIÓN SSxy xy b1 x y n SSxy SSx b0 y b1 x Donde: SS = suma de cuadrados b1 = pendiente b0 = ordenada al origen n = número de pares de datos En la tabla incluimos las sumatorias que utilizaremos para el cálculo de las fórmulas. coches compactos tamaño del motor (pcd) x Chevrolet Cavalier 121 Datsun Nissan Stanza 120 Dodge Omni 97 Ford Escort 98 Mazda 626 122 Plymouth Horizon 97 Renault Alliance/Encore 85 Toyota Corolla 122 SUMAS 862 Media 107.75 millas/galón (mpg), y 30 31 34 27 29 34 38 32 255 31.875 x^2 14641 14400 9409 9604 14884 9409 7225 14884 94456 y^2 900 961 1156 729 841 1156 1444 1024 8211 xy 3630 3720 3298 2646 3538 3298 3230 3904 27264 Calculando b0 y b1 tenemos: SSx = 1575.50 SSy = 82.88 SSxy = -212.25 b1 = -0.13472 b0 = 46.39099 La ecuación de predicción de mínimos cuadrados es: yˆ b0 b1 x. => yˆ 46.39099 0.37472x Gráfica de la ecuación de regresión 50 y =46.391 -0.1347x Y 40 30 20 Y 10 Lineal (Y) 0 0 50 100 Variable X Página 4 150 ANÁLISIS DE REGRESIÓN Error Los errores se denominan frecuentemente residuales. Podemos observar en la gráfica de regresión los errores indicados por segmentos verticales. ¿Qué tan normales son los residuales? ¿Residuales individuales tendencias; o separados? Diagnóstico del Modelo de Residuales Gráfica Normal de Residuales Tabla de Residuales 20 Residual Residual 10 0 -10 -20 -2 -1 0 1 2 50 40 30 20 10 0 -10 -20 -30 -40 -50 Ignórese para grupos pequeños de información (<30) -3.0SL=-43.26 5 10 Número de Observación Histograma de Residuales Residuales vs. Ajustes 20 3 10 2 Residual Frecuencia X=0.000 0 Marcador Normal Histograma ¿curva de campana? 3.0SL=43.26 1 0 -10 -20 0 -25 -20 -15 -10 -5 0 5 10 15 450 500 550 Ajuste Buscar Buscarlas lasinconsistencias inconsistencias mayores mayores Página 5 ¿Aleatorio alrededor de cero, sin tendencias? ANÁLISIS DE REGRESIÓN Al usar el criterio de mínimos cuadrados para obtener la recta que mejor se ajuste a nuestros datos, podemos obtener el valor mínimo para la suma de cuadrados del error (SSE) SSE SSy b1 SSxy A la varianza de los errores e se le llama varianza residual siendo denotada por se2 , se encuentra dividiendo SSE entre n-2 S e2 SSE n2 La raíz cuadrada positiva de la varianza residual se llama error estándar de estimación y se denota por Se. Aplicando las fórmulas en obtenemos la suma de cuadrados del error, la varianza residual y el error estándar de la estimación: SSE = 82.88-(-0.13472)(-212.25) =54.2849 S e2 Se 54.2849 9.0475 6 = 3.007 Ejemplo 2: Una firma de renta de coches recabó los datos adjuntos sobre los costos de mantenimiento y, y las millas recorridas x para siete de sus automóviles. Automóvil Encuentre: A B C D E F G Millas recorridas x en miles 55 27 36 42 65 48 29 a) Una estimación puntual para b) Una estimación puntual para Costos de mantenimiento y (dólares) 299 160 215 255 350 275 207 0 . 1. c) Una estimación puntual para la varianza del error . d) Una estimación puntual para el costo promedio del mantenimiento de un coche con 36,000 millas recorridas. e) Prediga el costo para un coche con 29,000 millas recorridas. 2 Automóvil A B C D E F G Suma Media x 55 27 36 42 65 48 29 302 43.14 y 299 160 215 255 350 275 207 1761 251.57 Página 7 x^2 3025 729 1296 1764 4225 2304 841 14184 y^2 89401 25600 46225 65025 122500 75625 42849 467225 xy 16445 4320 7740 10710 22750 13200 6003 81168 ANÁLISIS DE REGRESIÓN SSx = 1154.86 SSy = 24207.71 SSxy = 5193.43 b1 = 4.4970 b0 =57.5567 SSE = 852.70 S e2 = 170.54 y = 57.5567 + 4.497x a) b0 =57.5567 b) b1 = 4.4970 c) S e2 = 170.54 d) 57.5567 + 4.497(36) = 219.44 usd e) 57.5567 + 4.497(29) = 187.96 usd Inferencias sobre el modelo de regresión lineal. yˆ 0 1 x , con propósitos de predicción, queremos estar razonablemente seguros de que la pendiente 1 de la ecuación de regresión E y x 0 1 x no es cero. Ya que si 1 0 , entonces para cualquier valor de x, E y x sería idéntica a 0 , Para usar la ecuación de regresión como se muestra en la figura. Siendo este el caso el modelo no sería apropiado. Con el propósito de determinar si la pendiente de la regresión poblacional es diferente de cero, separemos SSy en dos componentes, SSE y SSR. Tenemos la siguiente relación: SSy = SSE + SSR Donde: SSE = Suma de cuadrados del error SSR = Suma de cuadrados de la regresión SSE = SSy-b1SSxy SSR = b1SSy Página 8 ANÁLISIS DE REGRESIÓN Prueba de hipótesis utilizando la distribución F Si fuera cierta H 0 : 1 0 , el estadístico F serviría como estadístico de prueba: F está definido como: F SSR S e2 Con gl = (1,n-2), se puede usar el estadístico F para determinar si 1 es diferente de cero. Si la pendiente de la ecuación de regresión poblacional es diferente de cero, entonces la ecuación se puede usar con propósitos de predicción. Ejemplo 3: Para los datos del ejemplo 1 haga una prueba para determinar si 0.05 H 0 : 1 0 H 1 : 1 0 1 0 , usando En el ejemplo 1 y 2 obtuvimos los siguientes valores: SSxy = -212.25 b1 = -0.13472 S e2 9.0475 La suma de cuadrados para la regresión SSR se calcula mediante: SSR = b1SSxy = (-212.25)(-0.1347) =28.5901 Hallamos el estadístico de prueba F: F SSR 28 .5901 3.16 = 9.0475 S e2 F (1, n 2) F0.05(1,6) = 5.99. Como F = 3.16<5.99, no rechazamos H 0 : 1 0 . Concluimos que la ecuación yˆ 46.3889 0.1347x no debe usarse con Se encuentra el valor crítico propósitos de predicción, y no tenemos evidencia que apoye que el modelo lineal es correcto para nuestros datos. Prueba de hipótesis utilizando la distribución t Otra manera de realizar la prueba de hipótesis H 0 : 1 0 es usando la distribución t. El estadístico de prueba es: t b1 , donde gl = n-2 Se SSx Ejemplo 4: Usando los datos del ejemplo 1, haga una prueba para determinar si prueba de t y 0.05 . Página 9 1 0 usando la ANÁLISIS DE REGRESIÓN H 0 : 1 0 H 1 : 1 0 t b1 0.1347 = 1.7775 9.0475 1575.5 Se SSx Los valores críticos t.025 para gl = 6 son 2.447 . Como –t.025 < t no rechazamos H 0 : 1 0 . Por tanto no tenemos evidencia que sugiera que el modelo lineal es apropiado para nuestros datos. Análisis de correlación Establece si existe una relación entre las variables y responde a la pregunta,”¿Qué tan evidente es esta relación?". La correlación es una prueba fácil y rápida para eliminar factores que no influyen en la predicción, para una respuesta dada. Coeficiente de Correlación de Pearson Es una medida de la fuerza de la relación lineal entre dos variables x y y. Es un número entre -1 y 1 Un valor positivo indica que cuando una variable aumenta, la otra variable aumenta Un valor negativo indica que cuando una variable aumenta, la otra disminuye Si las dos variables no están relacionadas, el coeficiente de correlación se aproxima a 0. El coeficiente de correlación r se calcula mediante la siguiente fórmula: r SSxy SSxSSy Tabla de Correlación Por su importancia, ¿cuál es el coeficiente mínimo de correlación? n 3 4 5 6 7 8 9 10 11 12 13 14 95% de confianza 1.00 0.95 0.88 0.81 0.75 0.71 0.67 0.63 0.60 0.58 0.53 0.53 99% de confianza 1.00 0.99 0.96 0.92 0.87 0.83 0.80 0.76 0.73 0.71 0.68 0.66 n 15 16 17 18 19 20 22 24 26 28 30 95% de confianza 0.51 0.50 0.48 0.47 0.46 0.44 0.42 0.40 0.39 0.37 0.36 99% de confianza 0.64 0.61 0.61 0.59 0.58 0.56 0.54 0.52 0.50 0.48 0.46 Para un 95% de confianza, con una muestra de 10, el coeficiente (r) debe ser al menos .63 Página 10 ANÁLISIS DE REGRESIÓN Correlación Negativa Evidente 25 20 20 15 15 10 Y Y Correlación Positiva Evidente 25 5 0 5 10 15 20 5 Sin Correlación 0 25 10 0 0 5 10 25 X 15 20 25 X 20 15 25 Y Correlación Positiva 10 0 0 20 5 10 15 20 25 25 X 20 15 15 10 Y Y Correlación Negativa 5 5 10 5 0 0 5 10 15 20 0 25 0 X 5 10 15 20 25 X Ejemplo 5: En un esfuerzo por determinar la relación entre el pago anual de los empleados y el número de faltas al trabajo por causa de enfermedad, una corporación grande estudió los registros personales de una muestra de doce empleados. Los datos pareados aparecen en la siguiente tabla. Empleado 1 2 3 4 5 6 7 8 9 10 11 12 Pago anual (miles de dólares) 15.7 17.2 13.8 24.2 15 12.7 13.8 18.7 10.8 11.8 25.4 17.2 Inasistencias 4 3 6 5 3 12 5 1 12 11 2 4 Página 11 ANÁLISIS DE REGRESIÓN Determine el coeficiente de correlación e interprete el resultado. Empleado 1 2 3 4 5 6 7 8 9 10 11 12 SUMATORIA SSxy = SSx = SSy = r x 15.7 17.2 13.8 24.2 15 12.7 13.8 18.7 10.8 11.8 25.4 17.2 196.3 y 4 3 6 5 3 12 5 1 12 11 2 4 68 x^2 246.49 295.84 190.44 585.64 225.00 161.29 190.44 349.69 116.64 139.24 645.16 295.84 3441.71 y^2 16 9 36 25 9 144 25 1 144 121 4 16 550 xy 62.8 51.6 82.8 121.0 45.0 152.4 69.0 18.7 129.6 129.8 50.8 68.8 982.3 -130.06667 230.569167 164.666667 SSxy = -0.6675 SSxSSy Inasistencias Diagrama de dispersión 14 12 10 8 Serie1 6 4 2 0 Lineal (Serie1) 0 5 10 15 20 25 30 Pago anual (miles usd) En el diagrama de dispersión observamos que al aumentar x, y disminuye, por lo cual la correlación es negativa. Comparando el coeficiente de correlación calculado, con la tabla de correlaciones observamos que .66 > .58, por lo cual la correlación entre las variables es fuerte. Página 12 ANÁLISIS DE REGRESIÓN Regresión lineal en Excel Mediante el uso de análisis de datos resolveremos el Ejemplo 1. Seleccione: herramientas > análisis de datos > regresión En la ventana seleccione el rango de entrada para X y Y, el rango de salida y seleccione la opción: gráfico de residuales y curva de regresión ajustada. Página 13 ANÁLISIS DE REGRESIÓN Página 15 ANÁLISIS DE REGRESIÓN Análisis de resultados de la tabla de Excel: Analizando los resultados de Excel, tenemos los siguiente: En la sección Estadísticas de la regresión vemos que el coeficiente de correlación = .5873 comparando este valor con la tabla de correlaciones observamos que el valor .5873 < .71 lo cual indica una relación débil entre las variables. En la gráfica “de regresión ajustada” observamos que la correlación es negativa ya que al aumentar X, Y disminuye; Cabe mencionar que el coeficiente de correlación calculado por el sistema siempre es positivo, por lo cual debemos basarnos la gráfica de regresión para determinar el signo. Ecuación de la regresión: Para obtener la ecuación de regresión usamos los coeficientes de los renglones Intercepción y variable X1, estos son 46.3909 y – 0.1347 respectivamente, siendo la ecuación de regresión: y = 46.3909- 0.1347X1. Análisis de Varianza: La tabla muestra la suma de cuadrados de la regresión SSR = 28.5901, la suma de cuadrados de los residuos o error SSE = 54.2806, El promedio de los cuadrados de la regresión que es la varianza residual 2 el valor de F dividiendo SSR/ S e S e2 = 9.0468 . El sistema calcula como ya se trato anteriormente. El valor crítico F es menor que el valor F (0.125< 3.16), por lo que no tenemos evidencia para rechazar la H 0: 1 0 , en consecuencia el modelo de regresión no es apropiado. Análisis de residuos: muestra los pronósticos y residuos para cada observación, así como el gráfico de residuales, en el cual observamos inconsistencias ya que la mayoría de los puntos se encuentran en la región positiva. Página 17 ANÁLISIS DE REGRESIÓN ANÁLISIS DE REGRESIÓN MULTIPLE En ocasiones la información de una variable independiente no es suficiente, por ejemplo en el caso de los autos compactos además de tener la variable del tamaño del motor, podríamos tener otras variables, que nos permitan tener mayor información como por ejemplo el peso del coche, el tipo de recorrido, el tamaño de las llantas, estos factores también influyen sobre la razón del consumo de gasolina. Cuando se usa más de una variable independiente para predecir los valores de una variable dependiente, el proceso se llama análisis de regresión múltiple, incluye el uso de ecuaciones lineales y no lineales, en este estudio nos ocuparemos de las ecuaciones de regresión lineales. Ejemplo 6 Muchos programas de estudios premédicos usan los promedios de las calificaciones del MCAT de los estudiantes egresados como un indicador de la calidad de sus programas. Las variables que se sabe influencian esos promedios del MCAT(y) son: la combinación de las calificaciones del SAT en matemáticas y en oratoria (x1) y el GPA (x2) de los prospectos a médicos. La tabla muestra las medidas de x1, x2 y y de seis estudiantes que han cursado un programa de premedicina y que han presentado el MCAT Estudiante 1 2 3 4 5 6 Calificación SAT (X1) 1200 1350 1000 1250 1425 1340 GPA (X2) 3.8 3.4 2.9 3.3 3.9 3.1 Calificación promedio del MCAT (Y) 12.4 13.3 9.2 10.6 13.2 11.2 Con esta información podemos encontrar una ecuación lineal que nos permita predecir el promedio de calificaciones del MCAT para un estudiante si se conocen su GPA y su calificación combinada del SAT. La ecuación lineal para los datos del ejemplo tiene la forma yˆ b0 b1 x1 b2 x2 . Es posible encontrar los valores de b0, b1, y b2 usando el método de mínimos cuadrados, al igual que en el método de regresión lineal simple. El método en este caso requiere resolver tres ecuaciones lineales con tres incógnitas, estas ecuaciones, conocidas como ecuaciones normales, son: b1 x1 b2 x2 y nb 0 x y b x b x b x 1 0 1 1 2 1 2 2 2 x y b x b x x b x 2 0 2 1 1 2 2 2 2 Página 18 ANÁLISIS DE REGRESIÓN La siguiente tabla organiza los cálculos para obtener las ecuaciones: X1 1200 1350 1000 1250 1425 1340 7565 X2 3.8 3.4 2.9 3.3 3.9 3.1 20.4 Y 12.4 13.3 9.2 10.6 13.2 11.2 69.9 X1^2 1440000 1822500 1000000 1562500 2030625 1795600 9651225 X2^2 14.44 11.56 8.41 10.89 15.21 9.61 70.12 X1X2 4560 4590 2900 4125 5557.5 4154 25886.5 X1Y 14880 17955 9200 13250 18810 15008 89103 X2Y 47.12 45.22 26.68 34.98 51.48 34.72 240.2 Las ecuaciones normales para este ejemplo son: 69.9 6b0 7,565b1 20.4b2 89,103 7565b0 9,651,225b1 25,886.5b2 240.2 20.4b0 25,886.5b1 70.12b2 Resolviendo el sistema de ecuaciones lineales obtenemos: b0 = -2.537, b1=0.005425, b2 = 2.161. La ecuación de regresión es: yˆ 2.537 0.005425x1 2.161x2 Suma de cuadrados La suma total de cuadrados SST, se descompone en dos componentes: suma de cuadrados para la regresión, y suma de cuadrados del error. SST = SSR + SSE La suma de cuadrados para la regresión es aquella parte de la suma total de cuadrados que se atribuye a las variables independientes. Mientras que la suma de cuadrados del error es aquella porción de la suma de cuadrados total y que no se debe a las variables independientes, por ello se llama suma de cuadrados del error. SST y y 12.9950 2 SSE y yˆ 2.2403 SSR SST SSE 10.7547 2 Grados de libertad para la regresión: glT glR glE glT n 1 glR k glE n (k 1) donde: k = número de variables independientes Página 19 ANÁLISIS DE REGRESIÓN Cálculo de cuadrados medios: SSR 10.7547 5.3773 glR 2 SSE 2.2403 MSE 0.7468 glE 3 MSR Donde: MSR= Cuadrado medio de la regresión MSE= Cuadrado medio del error. Prueba de hipótesis Para determinar si el modelo lineal describe adecuadamente los datos, se usa la prueba F. Para los datos del ejemplo las hipótesis son: H 0 : 1 2 0 H 1 : 1 0 o 2 0 El valor del estadístico F se encuentra dividiendo MSR entre MSE. F MSR 5.3773 7.20 MSE 0.7468 Buscando el valor crítico para F (1, n 2) F0.05 1,4 =7.71. Como 7.71 > 7.20 no podemos rechazar H0, lo cual nos indica que podría ser arriesgado utilizar la ecuación de regresión con propósitos predictivos. Coeficiente de determinación múltiple R2 SSR SST Utilizando los datos del ejemplo: R2 10.7547 0.8276 82.8% 12.995 Esto significa que aproximadamente el 83% de la variación en el promedio de las calificaciones se atribuye a la variación de las variables independientes y solamente el 17% de la variación de la variable dependiente no se atribuye a eso. Página 20 ANÁLISIS DE REGRESIÓN Regresión múltiple en Minitab Ejemplo 7 La tabla enlista el consumo de combustible en millas por galón bajo condiciones normales de manejo, los pesos de los coches en libras y la capacidad del motor en cc para seis coches deportivos modelo 1990. Coche deportivo Capacidad Peso Chevrolet 5735 Kagiar XJ-S 5344 Mercedes-Benz 500 SL 2174 Porsche 911 3600 Maserrati 228 2790 BMW 325i 2494 Consumo 3330 4015 2865 3320 3020 3100 a) Determine una ecuación de regresión para predecir el promedio de consumo de combustible usando la capacidad del motor y el peso, y calcule el coeficiente de determinación R2. Una vez capturados los datos de las variables en Minitab seleccionamos STAT>REGRESIÓN>REGRESIÓN y se presenta la siguiente pantalla Página 21 17,9 18,7 16,5 17 15,5 22 ANÁLISIS DE REGRESIÓN Seleccionamos la variable de respuesta (response) que corresponde a la Columna 3 C3, y las variables de predicción (predictors): C1 y C2. Damos Clic en el Icono Graphs, y en la opción gráficos de residuos “residual plots” dejamos la opción que el sistema da por de fault: “Regular”. y seleccionamos la opción residual vs. fits y normal plot of residuals. También existen otras opciones de gráficos que podemos usar en caso de ser necesario. Página 22 ANÁLISIS DE REGRESIÓN En la opción Resultados “Results” seleccionamos el circulo: Regresión equation.... Damos clic en ok. Regression Analysis The regression equation is C3 = 10,9 - 0,00050 C1 + 0,00270 C2 Predictor Coef StDev Constant 10,91 12,90 C1 -0,000496 0,001329 C2 0,002702 0,004982 S = 2,805 R-Sq = 9,1% T P 0,85 0,460 -0,37 0,734 0,54 0,625 R-Sq(adj) = 0,0% Analysis of Variance Source DF SS Regression 2 2,368 Residual Error 3 23,605 Total 5 25,973 MS 1,184 7,868 F P 0,15 0,866 Analizando los resultados tenemos: De la tabla resultante podemos determinar que la ecuación de Regresión es Y = 10.9 – 0.00050X1+.00270X2 Donde X1 representa el tamaño del motor (capacidad) y X2 el peso del coche, Y representa el rendimiento predicho para el consumo del combustible. El coeficiente de determinación R-Sq o R2 es 9.1% y esto indica que el 9.1% de la variación en el consumo de combustible se atribuye a la capacidad y al peso. El 90.9% no se atribuye a estas variables. Página 23 ANÁLISIS DE REGRESIÓN Examinando el valor del estadístico F(F=0.15), que es significativo al nivel P = 0.866 concluimos que el modelo no es adecuado para fines de predicciòn en un nivel 0.05 Normal Probability Plot of the Residuals (response is C3) Normal Score 1 0 -1 -2 -1 0 1 2 3 4 Residual Residuals Versus the Fitted Values (response is C3) 4 3 Residual 2 1 0 -1 -2 17 18 19 Fitted Value Analizando los gráficos anteriores, podemos observar en el grafico de probabilidad que las observaciones aparentan ser normales. Sin embargo en el gráfico de residuales observamos una tendencia ya que la mayoría de los puntos se encuentran a bajo del cero. Página 24