tesis_Lorenzetti_2011.pdf

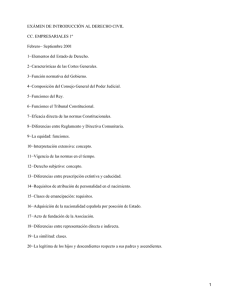

Anuncio